Ricerca di segnali gravitazionali da binarie in

coalescenza mediante una rete di rivelatori

interferometrici

Candidata: Simona Birindelli

Relatore: Andrea Viceré

5 ottobre 2004

Indice

1

Binarie coalescenti

9

1.1

Formazione di sistemi binari . . . . . . . . . . . . . . . . . . . .

9

1.2

Evoluzione . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11

1.2.1

Cenni sull’evoluzione di una singola stella . . . . . . . . .

11

1.2.2

Evoluzione di un sistema binario . . . . . . . . . . . . . .

15

1.2.3

Evoluzione all’interno di un ammasso . . . . . . . . . . .

25

Irraggiamento gravitazionale . . . . . . . . . . . . . . . . . . . .

28

1.3.1

Un po’ di storia...PSR B1916+13 . . . . . . . . . . . . .

28

1.3.2

Forma del segnale . . . . . . . . . . . . . . . . . . . . .

30

1.3.3

Approssimazioni successive . . . . . . . . . . . . . . . .

34

1.3.4

Tassi di coalescenze . . . . . . . . . . . . . . . . . . . .

36

1.3

2

I rivelatori interferometrici

39

2.1

Introduzione . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

39

2.2

Interferometro di Michelson e Morley . . . . . . . . . . . . . . .

41

2.3

Principio di funzionamento di un interferometro gravitazionale . .

43

2.4

Schema di un rivelatore . . . . . . . . . . . . . . . . . . . . . . .

46

2.4.1

Masse in caduta libera . . . . . . . . . . . . . . . . . . .

46

2.4.2

Tragitto del fascio luminoso . . . . . . . . . . . . . . . .

47

Rumore . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

48

2.5.1

2.5.2

Rumore sismico . . . . . . . . . . . . . . . . . . . . . .

Fluttuazioni della gravità locale . . . . . . . . . . . . . .

49

49

2.5.3

Rumore termico . . . . . . . . . . . . . . . . . . . . . .

50

2.5.4

Shot noise . . . . . . . . . . . . . . . . . . . . . . . . . .

50

2.5

1

INDICE

2.6

3

2.5.5

Fluttuazioni della pressione di radiazione . . . . . . . . .

51

2.5.6

Instabilità del laser . . . . . . . . . . . . . . . . . . . . .

52

Sensibilità . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

52

Analisi mediante una rete di interferometri

55

3.1

Introduzione . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

55

3.2

Cenni sull’analisi con un singolo rivelatore

. . . . . . . . . . . .

56

3.3

Analisi in coincidenza . . . . . . . . . . . . . . . . . . . . . . . .

58

3.3.1

Ricerca della coincidenza temporale . . . . . . . . . . . .

60

3.3.2

Consistenza delle ampiezze . . . . . . . . . . . . . . . .

61

3.3.3

Stime del fondo . . . . . . . . . . . . . . . . . . . . . . .

62

Analisi coerente . . . . . . . . . . . . . . . . . . . . . . . . . . .

63

3.4.1

Massimizzazioni analitiche . . . . . . . . . . . . . . . . .

65

3.4.2

Massimizzazione rispetto al tempo di coalescenza . . . . .

66

3.4.3

Griglia di parametri e determinazione delle incertezze . .

67

3.4

4

2

Confronto tra i due metodi

72

4.1

Introduzione . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

72

4.2

Verifica della consistenza del programma . . . . . . . . . . . . .

73

4.3

Calcolo delle probabilità di rivelazione . . . . . . . . . . . . . . .

78

4.4

Risultati ottenuti . . . . . . . . . . . . . . . . . . . . . . . . . . .

79

4.4.1

LIGO . . . . . . . . . . . . . . . . . . . . . . . . . . . .

80

4.4.2

Virgo . . . . . . . . . . . . . . . . . . . . . . . . . . . .

82

4.4.3

Rete Virgo-LIGO . . . . . . . . . . . . . . . . . . . . . .

83

Distribuzione delle sorgenti nel cielo . . . . . . . . . . . . . . . .

86

4.5.1

Parametri che influenzano l’efficienza di un rivelatore . . .

89

4.6

Il futuro prossimo: Virgo e LIGO advanced . . . . . . . . . . . .

92

4.7

Accuratezza nella determinazione dei parametri . . . . . . . . . .

95

4.7.1

Parametri derivanti dalla fase: le masse . . . . . . . . . .

95

4.7.2

Parametri derivanti dall’ampiezza: la distanza . . . . . . .

97

Conclusioni . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

99

4.5

4.8

Introduzione

Questo lavoro si ripropone di analizzare i metodi per l’analisi dei dati provenienti

da interferometri gravitazionali operanti simultaneamente in cerca di segnali emessi da sistemi binari di oggetti compatti, al fine di facilitare la scelta della procedura

ottimale. L’elaborazione di una strategia per l’analisi di dati gravitazionali è importante sia dal punto di vista della Relatività Generale, che riscontrerebbe un’ulteriore

conferma, che dal punto di vista dell’Astrofisica: si aprirebbe infatti un nuovo canale osservativo, oltre a quelli elettromagnetico e dei neutrini, tra l’altro in molti

casi complementare al primo, considerato che gli oggetti compatti sono per lo più

invisibili per via elettromagnetica, a parte le pulsar. In particolar modo i sistemi

binari potrebbero essere usati come candele standard per la misurazione di distanze

astronomiche.

La tesi è suddivisa in quattro parti, strutturate nel modo seguente:

Il primo capitolo è dedicato alle sorgenti, delle quali viene fornita una breve

evoluzione in cui sono descritti i processi che portano alla formazione di sistemi

binari compatti. Questi sono oggetti interessanti per la rivelazione in quanto hanno

un quadrupolo gravitazionale che varia nel tempo, perciò sono destinati alla perdita

di energia sotto forma di irraggiamento gravitazionale. Un contributo rilevante al

bilancio energetico del sistema, tale da farne restringere sempre di più la propria

orbita fino alla coalescenza delle due stelle in tempi minori dell’età dell’Universo,

è possibile soltanto per oggetti molto compatti, quali le stelle di neutroni o i buchi

neri. Viene poi analizzata la forma del segnale gravitazionale, prevista dalla teoria

della Relatività Generale, e facilmente riconoscibile per la sua peculiarità di avere

frequenza ed ampiezza crescenti nel tempo; essa è conosciuta con buona approssimazione e questo consente di determinare con accuratezza i parametri del sistema

3

INDICE

4

una volta trovato un segnale.

Il capitolo successivo si occupa del metodo di rivelazione delle onde gravitazionali, la cui principale difficoltà è data dall’effetto che queste hanno sui corpi:

sono infatti perturbazioni della metrica che al proprio passaggio producono delle forze di marea oscillanti, per cui gli oggetti vengono deformati e le distanze

tra i corpi modificate. I rivelatori interferometrici, dei quali viene riportata una

breve descrizione, basano il loro funzionamento proprio su quest’ultima conseguenza, sfruttando l’ulteriore caratteristica delle onde di avere due polarizzazioni

sfasate tra loro di π4 , il che raddoppia l’effetto della deformazione agendo in modo

opposto su due direzioni ortogonali, che risulteranno l’una dilatata, l’altra contratta di un fattore proporzionale alla lunghezza originaria ed all’ampiezza dell’onda

(estremamente piccola, dell’ordine di 10

22 nelle

circostanze più favorevoli).

Segue una parte relativa all’introduzione dell’analisi dei dati, per la quale il metodo più efficace, vista la forte presenza di rumore, risulta il filtro adattato, una tecnica che permette di correlare i dati con un determinato modello teorico di segnale, sostanzialmente “facendolo scorrere” sulla sequenza temporale in uscita dallo

strumento, e variandone i parametri sino a trovare quello che più approssima l’eventuale segnale presente. Utilizzando un singolo rivelatore, però, la probabilità di

falsi allarmi non è una quantità trascurabile, ed inoltre non è possibile identificare

completamente la sorgente che emette, determinandone i parametri fondamentali

che la caratterizzano, tra i quali la distanza dall’osservatore, le masse delle stelle,

la loro separazione, e la posizione della sorgente nel cielo. Viene quindi descritto lo scenario osservativo che si presenta avendo a disposizione più interferometri

distribuiti in vari punti della superficie terrestre, per mezzo dei quali è possibile

effettuare una ricerca più precisa, sia dal punto di vista dell’aumento del rapporto

segnale-rumore complessivo, che da quello della determinazione dei parametri.

Il capitolo segue con l’introduzione e la descrizione delle due tecniche di analisi più efficienti: quella in coincidenza e quella coerente. Nella prima ciascun

rivelatore analizza i propri dati in cerca di segnali con il metodo del filtro adattato, e compila una lista di eventi candidati; le liste vengono confrontate per trovare

delle coincidenze: eventi di forma e ampiezza ragionevolmente simili e con gli opportuni ritardi dovuti alle posizioni relative. Questa procedura raffina la ricerca, in

quanto tende a ridurre sensibilmente il numero di falsi allarmi.

INDICE

5

Il metodo coerente invece consiste nel considerare la rete come un unico rivelatore posto in posizione opportuna, una sorta di sistema di centro di massa, e

sommare coerentemente i contributi di ciascuno strumento, pesati con la propria

sensibilità ed orientazione. I vantaggi di questa procedura sono l’aumento della sensibilità della rete rispetto a quella di un singolo rivelatore, con conseguente

crescita significativa del rapporto segnale-rumore. Quest’ultima quantità è legata all’energia accessibile ad uno strumento, e dato che essa diminuisce al crescere

della distanza, l’utilizzo di una rete permetterebbe l’ allargarsi dell’orizzonte osservabile per via gravitazionale. L’unico inconveniente è che non è adatto situazioni

in cui il rumore non sia totalmente gaussiano.

Introdotte tutte le quantità teoriche necessarie, il quarto capitolo è dedicato alla

descrizione del lavoro effettuato, che consiste in un parallelo tra i due metodi per

una rete composta da Virgo e dai tre LIGO, e per una dei rispettivi interferometri

perfezionati che entreranno in funzione alcuni anni dopo i primi, Virgo advanced ed i LIGO advanced; il programma elaborato mediante Mathematica permette

comunque di cambiare i componenti della rete a seconda delle esigenze.

La quantità rilevante per il paragone è la probabilità di rivelazione come funzione della distanza, che è una stima dell’ orizzonte osservabile per ogni coppia di

masse delle stelle, una volta fissata la soglia di probabilità a partire dalla quale si

ritiene significativa la presenza di un evento rispetto ai falsi allarmi. In prima approssimazione non ci sono direzioni privilegiate nel cielo per la ricerca di binarie

coalescenti -in realtà non è proprio così, infatti l’omogeneità dell’Universo è tale

solo su larga scala, per distanze dell’ordine delle decine di Megaparsec non è più

valida, ed inizia ad essere determinante la presenza di strutture- per cui le simulazioni sono state fatte creando artificialmente gli eventi con il metodo Monte Carlo

per i quattro parametri angolari (posizione, polarizzazione dell’onda e inclinazione

dell’orbita rispetto al piano di vista).

I calcoli delle probabilità di rivelazione sono stati effettuati nell’ipotesi di rumore completamente gaussiano, e la procedura di analisi ottimale è risultata quella

coerente, che permette di allargare visibilmente l’orizzonte gravitazionale. Tuttavia

la presenza di contributi non gaussiani al rumore non è trascurabile, ed il metodo

coerente non permette di filtrare i falsi allarmi causati da questi eventi. Il metodo

della ricerca in coincidenza risulta invece un buon compromesso: permette infatti

INDICE

6

di raggiungere distanze sufficientemente grandi (con una riduzione di circa il 25%

rispetto al caso coerente), e al tempo stesso elimina sensibilmente il numero di falsi

allarmi. A tale scopo sono stati effettuati due diversi filtraggi, il primo che selezionasse gli eventi compatibili ad almeno due rivelatori, ed un secondo, più rigido,

che considerasse unicamente le coincidenze di tre strumenti, in modo da eliminare

il più possibile gli eventi che non provengano da sorgenti gravitazionali.

Lo studio effettuato, utilizzando il metodo Monte Carlo con formule analitiche,

permette di stimare la sensibilità di una rete di rivelatori in diverse condizioni di

utilizzo. Il passo successivo sarà l’implementazione dei metodi di analisi affinché

possano venire applicati ai dati reali.

Le onde gravitazionali

Le equazioni di Einstein legano la forma dello spazio-tempo alla distribuzione di

materia ed energia all’interno di esso. Sono 10 equazioni differenziali del secondo ordine nella metrica, non lineari e non linearmente indipendenti (quest’ultima

caratteristica esprime l’invarianza della fisica sotto cambiamento di sistema di riferimento), per cui nella maggior parte dei casi non si trovano soluzioni esatte, ma

approssimate.

Nel vuoto, e ad una distanza da una distribuzione di massa sufficiente affinché

lo spazio-tempo possa essere considerato piatto trascurando l’eventuale curvatura dell’Universo, è possibile linearizzare le equazioni e calcolare gli effetti della

sorgente come una perturbazione allo spazio piatto minkowskiano:

gαβ

con hαβ

ηαβ

hαβ

(1)

1. Le equazioni linearizzate risultano:

hαβ

0

(2)

che ricordano molto le equazioni di Maxwell, anche nelle soluzioni:

hαβ

aαβ exp ikλ xλ (3)

dove aαβ in un particolare sistema di coordinate detto trasverso a traccia nulla

7

INDICE

8

assume la forma:

0 0

a

0

A

0 1

0

0 0

0 0

0

0

ax

1 0

0

0 0 1 0

A

0 0 0 0

0

0 1 0 0

(4)

0 0 0 0

Ovvero onde piane monocromatiche con due diverse polarizzazioni, che si propagano nello spazio (la parte temporale è nulla) alla velocità della luce. Le due polarizzazioni presentano uno sfasamento relativo di 45 , il che, come sarà illustrato

avanti, comporta un diverso effetto osservabile su due direzioni ortogonali.

Per stimare l’ordine di grandezza dell’ampiezza A, è necessario soffermarsi

sulle caratteristiche di una sorgente di questo tipo di onde. Anche nel caso gravitazionale, come in quello elettromagnetico, è possibile introdurre uno sviluppo in

multipoli, che è valido data la grande distanza dei generatori. Il primo termine non

nullo, però, non è quello di dipolo, in quanto p¨ ∑a ma r¨a 0 per la conservazione

della quantità di moto, ed analogamente µ¨ 1

2c

2

∑a ma dtd 2 ra va 0 per la conservazione del momento angolare. Resta quindi soltanto il termine di quadrupolo,

la cui definizione è

Qi j

∑ ma

a

xia xaj 1 2 ij

r δ

3 a

(5)

che dà una luminosità gravitazionale, ossia una potenza irraggiata pari a:

Lgrav

è necessario osservare che

G

5c5

G ...i j ...

Q Qi j 5c5 1 4 10

(6)

59 erg s 1 !

Risulta per questo evidente che soltanto sorgenti con un’ enorme derivata terza

del momento di quadrupolo possano essere osservabili, e che quindi i candidati

debbano essere oggetti astrofisici molto compatti ed in moto con grandi velocità:

pulsar o buchi neri con qualche asimmetria che ruotino vorticosamente, stelle che

collassino in modo anisotropo, oppure sistemi binari molto stretti di buchi neri o

stelle di neutroni.

Capitolo 1

Binarie coalescenti

1.1 Formazione di sistemi binari

Circa la metà delle stelle attualmente catalogate appartiene ad un sistema binario, una configurazione fortemente favorita dai processi di formazione stellare. Le

condizioni ideali per la nascita e lo sviluppo degli embrioni si creano nelle nubi

molecolari, composte di materia interstellare (prevalentemente idrogeno neutro)

estremamente rarefatta, a temperature dell’ordine delle decine di gradi Kelvin. Nel

cercare la sua configurazione di equilibrio, la nube comincia a collassare, in parte

frenata dalla rotazione, o dall’eventuale presenza di campi magnetici. Il collasso si

interrompe quando gli urti tra le particelle iniziano ad essere significativi, tali cioè

da contrastare l’energia gravitazionale della nube stessa. In questa fase nascono le

protostelle, frammenti di gas autogravitanti di densità intorno ai 10 2 103 g cm 3 .

In assenza di moti rotatori la materia si aggregherebbe in forma sferica, guidata

dalla ricerca di stabilità, ma in seguito alla frammentazione il momento angolare

della nube viene spartito tra le sue componenti, ed è necessario tenere conto della

rotazione. Per fluidi lievemente rotanti la configurazione di equilibrio è un ellissoide biassiale, al crescere del rapporto tra energia cinetica e gravitazionale le protostelle percorrono idealmente la cosiddetta sequenza di Mc Laurin, dopodiché la

struttura che minimizza l’energia diventa un ellissoide triassiale sempre più distorto

all’aumentare della rotazione (sequenza di Iacobi), sino a raggiungere la forma di

”manubrio”, progenitrice di un sistema binario [16].

9

CAPITOLO 1. BINARIE COALESCENTI

10

Dalla crisalide della nube si è formato un protoammasso stellare, che evolverà

con tempi caratteristici termodinamici per raggiungere l’equilibrio in quanto gas

di stelle (gli ammassi globulari che osserviamo oggi, “vecchi” circa 10 10 anni),

mentre ciascuna delle componenti, singole stelle o sistemi binari, progredirà con

tempi caratteristici dell’evoluzione stellare.

Nei processi di assestamento dell’ammasso, che da ”aperto”, senza una forma

definita, assumerà un aspetto sferico, saranno importanti le interazioni tra le stelle,

che potranno portare alla formazione di nuovi sistemi binari, o alla modifica sostanziale

di alcuni di essi.

CAPITOLO 1. BINARIE COALESCENTI

11

1.2 Evoluzione

1.2.1 Cenni sull’evoluzione di una singola stella

Una volta emersa la sua figura all’interno della nube, la protostella prosegue il

suo collasso verso la stabilità, che viene raggiunta con l’innesco delle reazioni di

fusione. Non appena queste sono in grado di sorreggere completamente la stella

garantendone l’equilibrio idrostatico ed energetico, essa può “entrare” nella sequenza principale del diagramma H-R della luminosità in funzione della temperatura. Le equazioni che descrivono ad ogni istante della sua vita la condizione della

stella sono le seguenti [15]:

dP r dr

dM r dr

dL r dr

dT

dr

"

"

GM r ρ r

r2

(1.1)

4πr2 ρ r (1.2)

4πr2 ρ r ε

(1.3)

3kρ r ! L r !

trasporto radiativo

4acT 3 4πr 2

T r ! dP r !

ad P r ! dr trasporto convettivo adiabatico (interni stellari)

T r ! dP r !

P r ! dr trasporto convettivo superadiabatico (superficie)

(1.4)

La prima governa l’equilibrio idrostatico, la seconda esprime la relazione che

lega massa e densità di materia, la successiva altro non è che la conservazione

dell’energia, dove ε è la quantità di energia prodotta per unità di tempo e di massa;

la quarta equazione, infine, determina il gradiente di temperatura in funzione del

raggio per i vari meccanismi di trasporto di energia all’interno della stella nell’approssimazione

di radiazione di corpo nero. Il primo ad essere messo in moto è il trasporto radiativo, legato al moto dei fotoni che si diffondono dalle zone più calde a quelle più

fredde. Quando però i flussi di energia da trasportare sono troppo elevati la materia non è in grado di reggere gradienti di temperatura arbitrariamente grandi, diviene meccanicamente instabile e si instaurano i moti convettivi. Questi ultimi

consistono in veri e propri spostamenti di elementi di materia stellare che non

trovandosi più in equilibrio termodinamico con l’ambiente circostante, si spostano

CAPITOLO 1. BINARIE COALESCENTI

12

trasportando così energia da un punto all’altro della stella. Lo stesso avverrà se

la materia ha un’elavata opacità (k), che come è possibile vedere dall’espressione

per il trasporto radiativo ha lo stesso effetto di un grande flusso di energia per il

gradiente di temperatura.

L’integrazione delle quattro equazioni per l’equilibrio stellare richiede, oltre

alla definizione di adeguate condizioni al contorno, la conoscenza di altre tre relazioni, nelle quali è contenuta la “microfisica” di una struttura stellare:

1. l’equazione di stato della materia che la costituisce;

2. l’espressione per la produzione di energia (per unità di tempo e di massa)

come funzione delle grandezze fisiche locali quali la densità, la temperatura,

la composizione chimica...

3. per il trasporto radiativo e conduttivo del calore, l’opacità della materia stellare.

La massa influenza pesantemente la vita del corpo autogravitante [6], infatti già

dall’instaurarsi della fusione di idrogeno si creano due classi distinte di stelle, che

differiscono anche morfologicamente: quelle più piccole, dette di sequenza principale inferiore (fino a 1 2 M # ), che bruciano idrogeno tramite la catena protoneprotone, e sono caratterizzate da un nucleo radiativo, dove avvengono le reazioni,

circondato da un inviluppo convettivo inerte; e quelle di massa maggiore, in grado

di raggiungere temperature centrali maggiori, tali da far risultare più efficiente la

fusione tramite il ciclo CNO (che sostanzialmente utilizza i tre elementi pesanti

come catalizzatori), e che a causa delle elevate temperature, hanno il centro convettivo, mentre l’inviluppo esterno è radiativo.

Le distinzioni tra stelle di massa diversa si fanno sempre più nette col passare

del tempo, all’esaurimento del primo combustibile al centro, infatti, ogni stella innesca la fusione di idrogeno in uno strato più esterno, sprigionando un’energia tale

da doversi espandere sino a 10 volte le sue dimensioni iniziali per poter ristabilire

l’equilibrio (fase di gigante rossa). Quando anche questo strato diviene inerte la

stella è costretta a contrarsi fino al raggiungimento, nel nucleo, delle condizioni

di pressione e temperatura necessarie all’innesco della fusione dell’elio, ma ciò

CAPITOLO 1. BINARIE COALESCENTI

13

avviene soltanto per masse sufficientemente grandi, con un nucleo di elio di almeno 0 $ 5 M # . Le stelline meno massicce (M 0 5 % 0 8 M # ) invece non riescono

a raggiungere tali temperature, e sono costrette a contrarsi ulteriormente sino a che

la materia non diventa degenere (ρ & 10 6 g cm 3 ). A questo punto la contrazione si

arresta, contrastata dalla pressione del gas di elettroni; nasce così una nana bianca,

un oggetto denso e compatto destinato allo spegnimento perenne.

Per le stelle in grado di bruciare elio, il procedimento a fisarmonica continua

con combustibili man mano più pesanti, mentre la massa compie la sua selezione

naturale ad ogni ciclo, creando nane bianche di carbonio-ossigeno, e nel caso di

stelle più massicce, esplosioni di supernovae. Più in dettaglio, al momento in cui il

nucleo è composto di carbonio ed ossigeno ed anche lo strato in cui bruciava elio si

è spento, le stelle meno massicce si contraggono per raggiungere le condizioni di

innesco della fusione di C. La contrazione fa sì che la materia del nucleo degeneri,

e che l’innesco della fusione avvenga in modo violento, si ha un’esplosione che

espelle tutti gli strati esterni della stella e sprigiona energie elevatissime, di luminosità dell’ordine di 1010 soli (supernova da deflagrazione del carbonio). Il nucleo

rimanente si spegne come nana bianca di ossigeno e neon.

Le stelle di massa maggiore innescano pacificamente la fusione, senza dover

contrarre il nucleo, e procedono con la sintesi degli elementi pesanti sino alla fine,

ovvero fino a che questa è energeticamente conveniente. Il ferro è infatti l’ultimo

prodotto di reazione per cui la fusione è un processo esoenergetico. Quando la

stella giunge quindi ad avere un nucleo di ferro e nichel, l’unica chance di produrre energia è data dalla contrazione. La prima conseguenza è la degenerazione

della materia nucleare, che però stavolta non basta ad arrestare il collasso, poiché la

massa del nucleo residuo supera il limite di Chandrasekhar per un gas di elettroni

degeneri (1 44 M # ), e ad un certo punto pressione e temperatura raggiungono valori così elevati che inizia ad essere energeticamente possibile e sempre più favorita,

la reazione β inversa:

p

e

('

n

νe

(1.5)

che dà il via al processo di neutronizzazione. Intanto nella parte più interna del

nucleo, che collassa omologamente (secondo una legge del tipo r t αr 0 ) a ve-

locità subsonica, si crea un’onda d’urto causata dall’accensione di alcune reazioni

CAPITOLO 1. BINARIE COALESCENTI

14

in ambiente degenere, questa si propaga attraverso la parte esterna che collassa

invece a velocità supersonica ed in modo non omologo, e con una forte esplosione espelle tutti gli strati esterni della stella. Al contempo il nucleo, superstite

all’esplosione, si neutronizza pressochè completamente, e a questo punto il destino della stella è segnato dalla propria massa: se questa aveva una massa iniziale

nell’intervallo 8 % 20 M # , il prodotto della neutronizzazione, che è un gas di neutroni degeneri, risulta una struttura autogravitante in grado di arrestare il collasso.

E’ nata una stella di neutroni, un oggetto estremamente denso (ρ ) 10 9 g cm 3 ) e

compatto (R ) 10 km).

Per masse iniziali al di sopra delle 20 M # 1 dopo l’esplosione si ha una parziale

ricaduta del materiale espulso sul nucleo, la cui quantità cresce linearmente con

la massa della progenitrice. Il valore massimo della massa dei resti è di 3 M # (una

stella di neutroni vicina al suo limite di Chandrasekhar) e si raggiunge per una

massa iniziale di 20 7 M # . A partire da masse iniziali di circa 25 M # c’è una leggera

diminuzione ed un successivo appiattimento nella relazione che lega la massa dei

resti a quella iniziale, ciò è dovuto al vento stellare, che diventa così efficace da

spazzare via completamente gli strati più esterni di idrogeno. Al crescere della

massa originaria, quindi, il vento solare agisce da catalizzatore inibitore all’effetto

di ricaduta delle parti espulse, in quanto alleggerisce la stella prima dell’esplosione,

rendendo la crescita della massa rimanente non più lineare rispetto a quella iniziale,

ma più lenta.

Oggetti in origine più massicci di 42 M # collassano direttamente a buchi neri

allo spegnimento delle ultime reazioni, senza subire alcuna esplosione. Questa

è una conseguenza della saturazione della ricaduta: a causa dell’enorme massa,

infatti, tutta la materia espulsa dall’onda d’urto collassa inesorabilmente sul nucleo.

Stelle nate al di sopra delle 48 M # raggiungono altissime luminosità ed attraversano uno stadio in cui perdono massa ad una velocità molto alta, e questo ha

due effetti che portano nella stessa direzione: in primo luogo, la perdita di massa

aumenta se la stella è più massiccia, per cui le masse dei nuclei sono sempre più

1

Purtroppo esistono ancora molte incertezze associate alla fisica dell’esplosione di una supernova, a causa dei complicati meccanismi idrodinamici che avvengono durante il collasso del nucleo,

per cui è possibile che usando diversi modelli vengano trovati risultati con differenze significative. Il

modello di evoluzione stellare qui preso come riferimento è quello elaborato da Hurley, Pols e Tout

[9].

CAPITOLO 1. BINARIE COALESCENTI

15

piccole; inoltre per masse più grandi la fase di variabile blu luminosa ha inizio

prima nella vita della stella, che viene privata di idrogeno, di conseguenza anche il

nucleo di elio che si forma è più piccolo, e così il nucleo residuo. Per cui le stelle

che attraversano la fase di variabile blu luminosa muoiono come quelle di massa

minore, con un’esplosione di supernova e una parziale ricaduta di materia sul nucleo. Secondo il modello standard di vento stellare, il minimo nucleo si forma per

una massa iniziale di 52 5 M # , al di sopra della quale esso riprende la sua crescita

con l’aumento della massa. Per masse iniziali superiori di 72 3 M # , infine, si genera nuovamente un buco nero tramite una ricaduta completa della materia espulsa,

senza esplosioni.

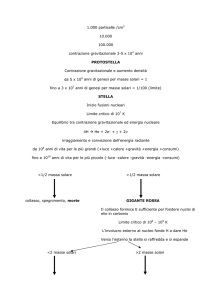

Riassumendo brevemente, a seconda della massa le stelle hanno una diversa

fine:

0 5 % 0 8 M #+* M

*

8 M#

nana bianca, sopra la massa solare supernova da defla-

grazione di carbonio, il cui nucleo diventa nana bianca

8 M#

M

*

20 M #

*

esplosione di supernova ed il nucleo rimanente (minore di

1,44 masse solari) è una stella di neutroni

20 M #

*

M

*

42 M #

esplosione di supernova con nucleo che collassa a buco nero

42 M #

*

M

*

48 M #

collasso a buco nero senza esplosione (il materiale ricade sul

nucleo)

48 M #

*

M

*

72 3 M #

esplosione di supernova con nucleo che collassa a buco

nero

M

*

72 3 M #

collasso a buco nero senza esplosione (il materiale ricade sul nu-

cleo)

1.2.2 Evoluzione di un sistema binario

La vita di un sistema binario è fortemente condizionata dalla separazione iniziale

tra le sue componenti. Se questa è elevata (dell’ordine di 10 5 , 6 R # ), è molto probabile che, a causa dell’interazione con le stelle “di campo” vicine nell’ammasso,

il legame si sciolga prima che avvenga qualsiasi fenomeno evolutivo.

CAPITOLO 1. BINARIE COALESCENTI

16

Se l’orbita è sufficientemente stretta da garantire l’esistenza del sistema stesso,

ma ancora piuttosto larga, ciascuna stella non sarà influenzata dalla presenza della

compagna, e procederà secondo l’evoluzione stellare standard per buona parte della

sua vita, almeno fino allo spegnimento delle reazioni di entrambe le componenti.

In ogni caso le interazoni mareali tenderanno a stabilire la circolarizzazione

dell’orbita, e la sincronizzazione tra periodo di rivoluzione e rotazione delle due

stelle, stato di minima energia. Il secondo processo, tramite la cessione di momento

angolare orbitale a quello rotazionale, ha come conseguenza il restringimento del

sistema, e, a seconda della separazione iniziale, può essere determinante per la sua

storia futura.

I meccanismi di circolarizzazione e sincronizzazione variano [9]: per sistemi

molto eccentrici anche il vento stellare può contribuire, ma la forma di dissipazione

più efficiente è legata alle forze mareali. Per stelle di sequenza principale inferiore pare che la causa principale delle instabilità mareali sia la viscosità turblenta

dell’inviluppo convettivo, fenomeno peraltro ancora poco conosciuto, mentre per

masse più grandi le cause scatenanti sembrano le oscillazioni del campo mareale

stesso.

I tempi caratteristici per la sincronizzazione e la circolarizzazione di stelle con

inviluppi radiativi sono generalmente ordini di grandezza maggiori rispetto a quelli

che caratterizzano l’equilibrio mareale delle stelle di sequenza principale superiore,

tuttavia entrambi risultano molto inferiori rispetto ai tempi evolutivi di una stella,

per cui è ragionevole considerarli fenomeni istantanei.

La circolarizzazione avviene quando le misure di una stella sono paragonabili

con la separazione del sistema:

R1

-

0 2 ap

(1.6)

dove a p è la distanza al periastro. Questa condizione è soddisfatta quando almeno

una delle due componenti evolve oltre la sequenza principale, oppure per sistemi

molto stretti. Non appena la relazione precedente è valida l’orbita si trasforma

conservando il momento angolare fino a che la nuova distanza al periastro diviene

pari a 5 raggi della stella più espansa, o fino alla circolarizzazione.

Se la separazione è minore di 104 raggi solari si avranno interazioni e scambio

CAPITOLO 1. BINARIE COALESCENTI

17

di massa tra le due componenti.

La presenza del sistema binario modifica lo spazio in sua prossimità, e nell’approssimazione di meccanica newtoniana e di orbite circolari, il potenziale in un

generico punto sarà dato da:

V x y z G

m1

r1

G

m2

r2

ω2

2

.

x

2

m2

m1

m2

a

y2 /

(1.7)

dove è stato scelto un sistema di riferimento corotante con il sistema stellare, con

origine nella componente primaria, e la secondaria sull’asse x come schematizzato

in figura. ω 10

m1 m2

a3

è la velocità angolare kepleriana di rivoluzione.

Sul piano dell’orbita le superfici equipotenziali hanno la forma mostrata nella

figura seguente:

CAPITOLO 1. BINARIE COALESCENTI

18

dove le due superfici chiuse tangenti in L 1 , punto singolare detto lagrangiano

interno, sono i Lobi di Roche, buche di potenziale pertinenti al campo individuale

di ciascuna stella, mentre i punti L 2 ed L3 sono le porte attraverso cui il sistema più

espellere materiale all’esterno.

Quando una delle componenti (generalmente la primaria, più massiva e di conseguenza più veloce nella sua evoluzione) espande il proprio raggio oltre il lobo

di Roche, inizierà a fluire materia verso la compagna attraverso L 1 . La risposta

del sistema a un fenomeno di trasferimento di massa dipende dalle fasi evolutive

e dalle masse delle due stelle, e gli scenari che si presentano a questo punto sono

molteplici [2].

Trasferimento dinamicamente stabile non conservativo. Si ha quando il donatore è una stella di sequenza principale e l’accettore in uno stadio qualunque della

sua evoluzione, oppure se il donatore è una gigante mentre la compagna non lo è,

e vale la relazione:

mdon

con cr

2

cr macc

(1.8)

2 5 o 1 a seconda dei casi.

Durante questa fase, parte della massa persa dalla primaria ( f a ) è trasferita alla

compagna, il resto viene perso dal sistema con un momento angolare specifico pari

CAPITOLO 1. BINARIE COALESCENTI

a

2π ja2

T

. La corrispondente separazione orbitale si modificherà secondo la formula:

af

ai

per fa

f

f

f

mdon macc

midon miacc

mdon

midon 4

3

2j 1

f

exp

.

2 j mdon midon miacc

/

(1.9)

0, mentre se è diverso da zero, si ha:

af

ai

f

e macc

19

f

miacc

f

mdon macc

midon miacc

3

f

mdon

midon 4

2 j 1 fa !

2

f

3

macc

miacc 4

2 faj 1 f a !

2

(1.10)

f fa midon mdon

. Secondo il modello standard la metà della massa

persa dalla primaria viene espulsa dal sistema, per cui j 1.

Il trasferimento di materia si interrompe quando per ciascuna componente il

lobo di Roche torna ad essere più largo del raggio della stella. Per stelle primarie evolute oltre la sequenza principale, il modello assume che esse perdano

completamente l’inviluppo e rimanga soltanto il nucleo di He o C-O.

Trasferimento di massa stabile conservativo. Questo caso è analogo al precedente, con la condizione f a

1 che corrosponde ad un trasferimento di massa

senza alcuna perdita da parte del sistema.

Trasferimento non stabile: inviluppo comune standard. Avviene quando la

stella primaria è in fase di gigante, mentre la compagna può essere in sequenza

principale, o una nana bianca, o anch’essa una gigante ricca di He e non viene

soddisfatta la condizione 1.8. In queste condizioni il trasferimento non è stabile, e

passa attraverso una fase di inviluppo comune, durante la quale entrambe le stelle

riempiono il proprio lobo di Roche e necessariamente fluirà materia verso l’esterno

tramite i punti lagrangiani secondari, a spese dell’energia orbitale del sistema, che

di conseguenza diventerà molto stretto. La separazione finale può essere calcolata

tramite la relazione:

f

αce

3

Gmdon macc

2a f

Gmidon macc

2ai

4

Gmidon mdon 5 inv

λRdon 5 lr

(1.11)

dove mdon 5 inv è la massa dell’inviluppo della stella primaria, R don 5 lr il raggio del suo

lobo di Roche, λ un parametro tale cheλ α ce

1. Il membro a destra dell’equa-

CAPITOLO 1. BINARIE COALESCENTI

20

zione rappresenta l’energia di legame dell’inviluppo della stella donatrice, mentre

il lato destro esprime la differenza tra le energie orbitali finale e iniziale, ed α ce

l’efficienza con la quale il processo strappa via l’inviluppo alla stella.

Trasferimento non stabile: doppio inviluppo comune. Se le due componenti

sono entrambe giganti con inviluppi convettivi ed è in atto un trasferimento di

massa è possibile che si formi una fase di inviluppo comune doppio, in cui i due

nuclei spiraleggiano nella fusione dei due inviluppi. Come nel caso precedente,

è possibile scrivere una relazione tra le energie utile per calcolare la separazione

finale:

f

f

Gm1 m2

2a f

αce

3

Gmi1 mi2

2ai 4

Gmi1 mi1 5 inv

λR1 5 lr

Gmi2 mi2 5 inv

(1.12)

λR2 5 lr

con le stesse notazioni.

Fase di inviluppo comune con accrescimento ipercritico. Se una delle stelle è un

buco nero o una stella di neutroni è possibile giungere ad una fase di inviluppo

comune soltanto se la separazione diviene uguale al raggio della gigante che cede

materia. In queste condizioni l’oggetto compatto strappa una quantità significativa

di massa alla compagna tramite un accrescimento ipercritico. Il risultato finale (la

massa accumulata e la nuova distanza) viene calcolato come soluzione numerica

delle equazioni differenziali:

m1 m2 6 6 m1 m2 m2 7 1 2λ 1 αce1 2m2 m2 5 nucl m1

m1 m22 a 1 6 6 m1 m2 m2 7 1 m2 a 1 6 m1 2λ 1 αce1 m2 m2 5 nucl 7

(1.13)

da

dm2

dm1

dm2

m1 6 6 m 1

m2 1

m2 7

1

1 m2 a

m1 m2 6 6 m1 m2 m2 7 1 2λ 1 αce1 2m2 m2 5 nucl m1

m1 m22 a 1 6 6 m1 m2 m2 7 1 m2 a 1 6 m1 2λ 1 αce1 m2 m2 5 nucl 98

7;:

(1.14)

ottenute imponedo il bilancio dell’energia durante la fase di inviluppo comune

αce ∆Eorb

∆Eleg .

Cronologicamente, un primo episodio di incontro ravvicinato può avvenire già

CAPITOLO 1. BINARIE COALESCENTI

21

in fase finale di sequenza principale della primaria, se il sistema è sufficientemente

stretto. In questo caso gli effetti evolutivi, che in questa fase portano ad un aumento

del raggio, si manifestano su tempi scala più lunghi di quelli del riaggiustamento

strutturale su raggi minori indotto dalla diminuzione di massa, perciò il trasferimento sarà stazionario e stabile per lungo tempo. Infatti per queste strutture il

riassestamento avviene su tempi scala dell’ordine del tempo di Kelvin:

tk

Eth

L1

3 Gm21

4 L1 R1

(1.15)

il quale indica quanto impiegherebbe una stella ad irraggiare tutta l’energia termica

a sua disposizione se non potesse più produrne in alcun modo, e la seconda uguaglianza vale solamente nella fase di sequenza principale e nell’ipotesi di simmetria

sferica. Il tempo scala per il trasferimento di massa è invece circa un ordine di

grandezza al di sopra, per cui in questo stadio ad una diminuzione di massa segue una diminuzione di raggio della stella, ed il trasferimento sarà stazionario. La

compagna su cui cade materia si vede depositare un’energia pari a:

Lgrav

Gm2 ṁ1

R2

(1.16)

Esiste tuttavia un limite fisico alla luminosità che una struttura stellare può emettere

senza che gli strati esterni diventino gravitazionalmente slegati, detto luminosità di

Eddington:

LEdd

4πcR

ke

(1.17)

dove ke è l’opacità superficiale.

Confrontando le due espressioni si ottiene una relazione per il tasso di accrescimento limite, oltre il quale la materia trasferita dalla primaria non è accettata

dalla compagna, e viene persa dal sistema:

ṁEdd

4πcR

ke

10

4

R

M #=< anno

ke

(1.18)

Quindi è la velocità di trasferimento che decide se esso sia conservativo o meno.

Un trasferimento cessa di essere stazionario quando viene a mancare la condizione che lo ha determinato, ovvero la risposta strutturale di diminuire il raggio ad

CAPITOLO 1. BINARIE COALESCENTI

22

una diminuzione di massa, oppure nel caso in cui le dimensioni del lobo di Roche

varino su tempi scala inferiori a quelli di riaggiustamento strutturale. In generale

la stazionarietà viene persa prima del raggiungimento della fase di gigante rossa da

parte della primaria.

Se il sistema è inizialmente più largo (a > 10 2 % 103 R # ), il primo contatto avviene quando la stella di massa maggiore è in fase di gigante. In questi casi le

proprietà fisiche dei profondi inviluppi convettivi sono tali da indurre un aumento

di raggio ad una diminuzione di massa, per cui l’aumento del raggio è positivamente reazionato dalla perdita di massa attraverso il punto lagrangiano interno e l’unico

freno ad un processo a valanga è costituito dall’inerzia della struttura a riaggiustarsi su raggi maggiori. Date condizioni iniziali portano il sistema a sperimentare una

fase di inviluppo comune, perché la secondaria accetta materiale soltanto fino a

che il tasso di trasferimento è entro il limite di Eddington, dopodiché la massa in

eccesso comincia a riempire il lobo di Roche della secondaria, e successivamente

anche i volumi contenuti dalle superfici equipotenziali esterne. L’espansione dell’inviluppo comune si arresta solamente quando viene raggiunta la prima superficie

critica singolare nel primo punto lagrangiano esterno, da cui potrà finalmente fluire

verso l’esterno.

Il trasferimento avviene su tempi scala termici, molto più brevi rispetto a quelli del caso stazionario, e si arresta solamente quando gran parte dell’inviluppo è

stato ceduto e della primaria non rimane che un nucleo circondato da un piccolo

inviluppo radiativo (pochi decimi di massa solare). E’ anche possibile, sebbene

meno probabile, che il trasferimento abbia termine perché la struttura recede dalle

condizioni espanse per motivi evolutivi (innesco di una nuova fusione centrale).

Alcuni aspetti evolutivi di un sistema binario immerso in un inviluppo comune

non sono ancora noti con precisione, tuttavia sicuramente il fatto che le componenti

stellari si muovano in un mezzo di densità non trascurabile determina l’insorgere di

attriti. Questi faranno sì che le orbite si restringano a causa della perdita di energia,

per cui il sistema che emerge da una fase di inviluppo comune risulta più legato di

quello originario.

Una coppia di stelle nel corso della sua esistenza può passare attraverso più

fasi di inviluppo comune, a seconda della separazione, delle masse, e di altre

caratteristiche del sistema stesso.

CAPITOLO 1. BINARIE COALESCENTI

23

Se entrambe le componenti sono poco massicce, dopo un primo episodio di

inviluppo comune la primaria è ridotta ad una nana (di He o di C-O a seconda della fase in cui è avvenuto il trasferimento di materia) in fase di raffreddamento, il

rapporto di masse è invertito, e, visto che l’orbita è più stretta, sicuramente avverrà

un nuovo scambio di materia. Quando la separazione è sufficientemente piccola

da far riempire il lobo di Roche della secondaria alla fine della sequenza principale, il trasferimento sarà conservativo, altrimenti si giungerà ad un nuovo stadio

di inviluppo comune. A seconda delle fasi evolutive delle stelle al momento dei

trasferimenti, potranno avvenire o meno nuovi scambi di massa, lo scanario che si

presenterà alla fine di questi, sarà tuttavia in ogni caso un sistema di nane molto

stretto (separazione dell’ordine di qualche raggio solare).

Stelle di massa maggiore attraversano una fase nella quale si scambiano materia in modo dipendente dalla separazione iniziale, dopodichè, quando una delle

due giunge al punto di dover esplodere come supernova, il destino del sistema è

nuovamente determinato dalla distanza tra di esse prima dell’evento. Se le due

componenti non erano sufficientemente legate il sistema viene distrutto e le stelle

continuano ciascuna la propria esistenza individualmente, altrimenti il risultato finale è un sistema più largo, con i rapporti di massa scambiati. La materia espulsa

dalla supernova non interagisce con la compagna, ma viene immediatamente persa

attraverso i punti lagrangiani. A questo punto la primaria è una stella di neutroni

o un buco nero, a seconda della sua massa iniziale, mentre la secondaria, procede

nella sua evoluzione, durante la quale è possibile che conduca il sistema verso una

seconda fase di inviluppo comune prima di espoldere anch’essa come supernova o

di morire come nana, a seconda della massa. Comunque, l’effetto dell’eventuale

secondo scambio di massa è quello di rendere la separazione ancora più stretta, e

far nascere così sistemi stretti di oggetti compatti.

Hurley, Tout e Pols [9] forniscono un esempio di sistema che dà origine ad una

coppia di stelle di neutroni. Nelle ipotesi di orbita già circolare e di velocità indotta

dall’esplosione della supernova alla compagna trascurabile, due masse iniziali di

13 1 e 9 8 M # alla distanza di 138 R # attraversano il primo scambio di massa dinamico quando la primaria è una gigante. Dopo una fase di inviluppo comune la

situazione che si presenta è una binaria composta da una stella di elio di 3 7 M # ed

una compagna in sequenza principale accresciuta a 18 7 M # . Il sistema evolve e la

CAPITOLO 1. BINARIE COALESCENTI

24

prima stella esplode come supernova, lasciando al suo posto una stella di neutroni

di 1 34 M # ed allarga un po’ la separazione. Si ha un ulteriore stadio di inviluppo comune non appena la secondaria riempie il proprio lobo di Roche, e riduce la

sua massa a 4 6 M # , mentre la primaria resta invariata e il sistema si fa sempre più

stretto (1 6 R # ). Dalla seconda esplosione di supernova emerge un sistema di stelle

di neutroni con periodo orbitale di 0 5 giorni.

Ci sono degli intervalli di masse per cui le stelle non subiscono espolsioni di

supernova ma collassano direttamente a buco nero, in questi casi non c’è alcuna

modifica dell’orbita dovuta alla nascita dell’oggetto (conseguenza che in Relatività

Generale continua a valere se il collasso avviene con simmetria sferica, ed è nota

come teorema di Birkhoff), e perciò i corrispondenti intervalli di masse dei buchi

neri saranno maggiormente popolati di sistemi stretti.

La seguente tabella riassume i principali canali di formazione dei sistemi compatti:

CAPITOLO 1. BINARIE COALESCENTI

25

dove a indica la stella primaria, b la secondaria e la legenda dei simboli è:

NC: trasferimento di massa non conservativo

SCE: fase di singolo inviluppo comune

DCE: fase di doppio inviluppo comune

HCE: inviluppo comune con accrescimento ipercritico

SN: esplosione di supernova o collasso del nucleo senza esplosione (per i valori

di masse che lo prevedono)

1.2.3 Evoluzione all’interno di un ammasso

Gli ammassi stellari appena nati hanno la forma irregolare della nube che li ha originati, a poco a poco, tramite interazioni tra le componenti raggiungono la propria

configurazione di equilibrio ed assumono una forma sferica con densità crescente andando verso il nucleo (ρnucl

>

10

1

%

106 M #?< Pc3 ), per questa caratteristica

vengono detti ammassi globulari.

La struttura di un ammasso può essere descritta in termini di sistema di N corpi, dove il numero di stelle varia da 10 4 a 107 a seconda delle dimensioni. Il tempo

di rilassamento è il tempo tipico impiegato dalle interazioni gravitazionali con le

altre stelle dell’ammasso a rimuovere completamente la storia della velocità originaria di una componente, in altre parole entro il tempo di rilassamento l’ammasso

raggiunge il proprio equilibrio termico come gas di stelle. Valori tipici richiesti per

questi assestamenti sono in media 10 9 anni, minori dell’età degli ammassi globulari

che osserviamo oggi, che quindi hanno raggiunto la configurazione stabile.

Non appena si sono formate le stelle dalla nube molecolare, il protoammasso

comincia a collassare cercando l’equilibrio. Inizialmente le stelle sono distribuite

in un ampio intervallo di posizioni e velocità in modo indipendente dalla massa,

e questo ha come effetto che le più massicce abbiano energia cinetica maggiore.

Attraverso gli urti resi sempre più frequenti col procedere del collasso, queste cederanno energia alle stelle più piccole, e tenderanno a concentrarsi per virializzazione

verso il centro dell’ammasso (processo di segregazione della massa). In 10 9 anni

le stelle di massa superiore a 2 masse solari hanno già esaurito i combustibili, e

sono oggetti compatti, per cui la popolazione del centro di un ammasso globulare

è in gran parte composta da oggetti degeneri.

CAPITOLO 1. BINARIE COALESCENTI

26

I sistemi binari sopravvissuti presenti hanno un’energia di legame molto maggiore dell’energia cinetica media di un corpo dell’ammasso, per cui di fatto a livello

globale possono essere considerati come un oggetto singolo. Questi possono aver

resistito alle interazioni grazie alla forte energia di autogravitazione, oppure essere

nati o essersi modificati nel corso del riassestamento dell’ammasso, per interazioni

con singole stelle, o per cattura mareale.

La cattura mareale avviene quando due stelle si avvicinano talmente tra loro da

provocare forti interazioni di marea, che hanno l’effetto di eccitare i modo di oscillazione non radiali delle stelle. Se l’energia assorbita in queste oscillazioni risulta

grande abbastanza da lasciare le due componenti con un’energia totale negativa,

si forma un sistema binario. Molto più spesso però l’effetto delle forze di marea

è così forte da portare le due stelle a coalescere, per cui la cattura mareale non è

un canale di formazione usuale per i sistemi binari. Le interazioni tra più corpi

statisticamente avvengono più di rado rispetto alle precedenti, ma nell’evoluzione

di un ammasso globulare sono le più frequenti cause della nascita di sistemi binari,

che comunque non sono moltissime rispetto al numero iniziale già presente.

Un fenomeno molto frequente nella vita di un ammasso sono le trasformazioni

di sistemi binari esistenti fin dalla nascita dell’ammasso stesso. Le trasformazioni

portano solitamente verso sistemi più stretti e con componenti più massicce.

Dall’interazione di un sistema binario con una singola stella o con altre binarie

risultano tre possibili scenari: la completa distruzione del sistema, uno scambio di

energia tra la binaria e la singola stella, o la sostituzione di una componente con una

stella di campo. Nell’urto l’energia di interazione viene suddivisa tra tutti i corpi

interessati, con la conseguenza che la stella di massa minore riceverà la velocità

maggiore, e sarà quella con maggior probabilità di fuga.

Queste interazioni sono tipicamente abbastanza complesse, e devono essere

studiate per via numerica. Tuttavia in linea generale se l’energia di legame iniziale era grande (maggiore dell’energia cinetica media delle stelle nell’ammasso), il

risultato dell’incontro è un restringimento dell’orbita, in quanto parte dell’energia

gravitazionale viene utilizzata per termalizzare la velocità della stella di campo alla

loro; se il sistema era largo già in partenza è la stella di campo che cede parte della sua energia, contribuendo ad indebilire ulteriormente il sistema. Tutto ciò può

essere riassunto nella “legge di Heggie”: I sistemi forti vengono rafforzati, quelli

CAPITOLO 1. BINARIE COALESCENTI

27

deboli indeboliti.

L’energia cinetica media delle stelle di campo di un ammasso è legata alla sua

temperatura media:

@

mv2 A

3kB T

(1.19)

con kB costante di Boltzmann. Studi numerici [3] sui risultati delle interazioni di

sistemi stretti indicano che l’energia di legame viene incrementata del 20% ad ogni

incontro, e dato che il numero di urti è proporzionale al semiasse maggiore dell’orbita (o equivalentemente ad E

1)

il tasso di rinsaldamento del legame orbitale

risulta indipendente dall’energia stessa:

∆E

>B

0 6

kB T

tril

(1.20)

dove tril indica il tempo di rilassamento dell’ammasso.

I diversi studi numerici sulle interazioni dei sistemi fortemente legati hanno in

comune la previsione di scambi della stella più piccola con una più massiccia. Attraverso interazioni di scambio quindi, la distribuzione di massa delle componenti

binarie si dirige verso stelle di massa più grande, aumentando così il numero di

futuri sistemi relativistici.

Il caso di sistemi di buchi neri è diverso, in quanto i loro progenitori evolvono

troppo velocemente rispetto al tempo di rilassamento dell’ammasso. Essi vengono subito attratti nel centro dalla segregazione di massa, e qui, essendo molto più

massicci delle altre stelle di campo tendono a creare una sorta di sottoammasso e

ad interagire soltanto tra di loro. I sistemi di buchi neri si formano tramite processi

a due o tre corpi, mentre le binarie di un buco nero con una stella meno massiccia vengono trasformati dagli urti che tendono a far sfuggire la componente più

leggera. La popolazione di buchi neri al centro dell’ammasso in sostanza evolverà

separatamente, poiché nessuna stella è così massiccia da poter influire sulla loro

dinamica.

CAPITOLO 1. BINARIE COALESCENTI

28

1.3 Irraggiamento gravitazionale

Una volta giunti allo stadio finale della propria esistenza, dopo processi di scambi

di materia, ed eventuali scambi di compagne in zone di alta densità stellare quali i

centri degli ammassi, i sistemi binari continuano ad essere degli oggetti tutt’altro

che inerti. Le stelle infatti hanno raggiunto densità estremamente elevate concentrate in raggi ridotti, condizioni alle quali gli effetti della Relatività Generale iniziano ad essere significativi, in particolare la perdita di energia orbitale sotto forma

di onde gravitazionali, che spinge i due oggetti sino alla coalescenza.

1.3.1 Un po’ di storia...PSR B1916+13

Una delle più grandi conferme della Relatività Generale degli ultimi 30 anni è

costituita appunto dai sistemi binari di stelle di neutroni, che hanno fornito la prima

evidenza sperimentale dell’esistenza delle onde gravitazionali.

Nel 1974 Hulse e Taylor scoprirono una pulsar con caratteristiche peculiari [8].

Una pulsar (abbreviazione di “pulsating radio source”) è una radiosorgente che

emette un segnale in forma di brevissimi impulsi regolarmente spaziati, con un

intervallo dell’ordine del secondo o una frazione. La brevità del periodo di pulsazione fornisce già indicazioni sulla natura dell’oggetto, considerato che la pulsazione è legata alla sua rotazione: anche una nana bianca è troppo grande, l’unico

candidato possibile è quindi una stella di neutroni. Come verifica è interessante

stimare il periodo di rotazione di una stella di neutroni con massa e momento angolare solari, ma raggio intorno ai 10 km. Assumendo per semplicità che la stella

di neutroni nasca da una compressione in scala a partire dalle dimensioni solari 2

, ad una riduzione di un fattore 7 104 nel raggio corrisponderà una riduzione di

un fattore 5 109 del momento d’inerzia, quindi un corrispondente aumento della

velocità angolare di rotazione. Partendo dal periodo del Sole si arriva a meno di

0,5 ms, il che mostra che i periodi osservati sono perfettamente compatibili con

l’ipotesi che si tratti di una stella di neutroni. Il meccanismo di emissione della

radiazione può essere spiegato ancora come conseguenza del collasso: ogni stella infatti ha un campo magnetico con l’andamento di un dipolo, ed anche questo

2

RC

D

Per maggior chiarezza, i parametri significativi del Sole sono i seguenti: M CED

7 F 105 km , L C D 3 G 8451033 erg s H 1 , Trotaz I 27 giorni

2 F 1033 g ,

CAPITOLO 1. BINARIE COALESCENTI

29

viene compresso, per la conservazione del flusso magnetico, quindi, la stella di

neutroni la stella acquista un intenso campo magnetico polare. In generale la direzione dei poli magnetici non corincide esattamente con l’asse di rotazione. Inoltre

i neutroni della stella non sono tutti stabili: le condizioni di densità tali da garantire

la completa neutronizzazione sussistoni in realtà solamente nel nucleo, mentre in

superficie i neutroni decadono, emettendo elettroni di alta energia. Attraversando

il forte campo magnetico, questi elettroni emettono radiazione di sincrotrone, concentrata nella direzione del loro moto e molto più intensa dove il campo è più forte,

ossia nelle regioni dei poli magnetici. Dato che la stella ruota, il risultato che si osserva dall’esterno è una radiazione che spazza un cono nello spazio, percepibile da

un osservatore che se ne trovi in prossimità. La stella emette energia a spese della

sua energia cinetica, col passare del tempo, quindi, il periodo della pulsar tende

lentamente ad aumentare.

La pulsar osservata da Hulse e Taylor aveva un periodo di 59 ms, ed una variazione della frequenza dovuta alla perdita di energia accennata sopra, di 2 47583 2 10

15 s 2 [8], ma possedeva

anche una variazione periodica con un periodo di 27906 9807804 6 s, si ampiezza relativa di circa 10

3.

L’interpretazione che ne dettero fu quella di un

effetto Doppler, derivante dal moto orbitale della stella in un sistema binario. Dal

periodo orbitale, tramite la terza legge di Keplero, fu possibile ricavare il valore dell’espressione

a3 m1 m2 !

m32

2

dove a è il semiasse maggiore dell’orbita, e, assumentdo

che le masse fossero dell’ordine di quella del Sole, trovarono a ) 2 10 6 km, poco

più del diametro solare, ed un’eccentricità e ) 0 62. Data la distanza ravvicinata,

constatarono che dovesse trattarsi di un sistema binario di stelle di neutroni.

Il sistema risultava così stretto da necessitare la mobilitazione della Relatività

Generale, la quale permise di raffinare le conoscenze: in primo luogo, la variazione di frequenza non era dovuta soltanto all’effetto Doppler, ma esisteva anche un

significativo redshift gravitazionale nel campo della compagna (circa 3 10

5

tra

apoastro e periastro), e un effetto di ritardo della luce dovuto alla presenza delle

masse non trascurabile. Inoltre dallo studio dettagliato del moto orbitale fu evidenziato un notevole spostamento del periastro (altro effetto previsto dalla teoria

einsteiniana), di 4 226621 11 J<

anno . Confrontando tutti questi effetti con le pre-

visioni teoriche determinarono tutti i parametri delle stelle, in particolare le masse:

m1

1 4410 5 M # ed m2

1 3784 5 M # .

CAPITOLO 1. BINARIE COALESCENTI

30

Ma le osservazioni prolungate nel tempo mostrarono un altro fatto: il periodo

orbitale non era costante, ma decresceva nel tempo:

Ṫ

12

2 422 6 10

(1.21)

Una diminuzione del periodo implica un restringimento dell’orbita, ed una conseguente perdita di energia del sistema, pari a

Ė

su un’energia totale di

)B

5 6 1031 erg s

1

9 67 1047 erg.

L’unico meccanismo che potesse spiegare questa perdita di energia era l’emissione di onde gravitazionali, che la teoria di Einstein prevede essere nell’approssimazione di quadrupolo:

Ė

G4 m21 m72

32

5 c5 a5 m1 m2 1

4

73 2

24 e

1 e2 37 4

96 e

7

2

(1.22)

dove l’apparente asimmetria tra le due masse è dovuta all’uso del semiasse dell’orbita di m1 , anzichè di quello del moto relativo.

E’ stato effettuato un confronto teoria-osservazioni, e nell’arco di circa 20 anni

di monitoraggio, ha dato il seguente risultato: 1 0032 K 0 0035, che nel 1993 è

valso ai due scienziati il Nobel per la fisica.

1.3.2 Forma del segnale

Un sistema binario ha un momento di quadrupolo gravitazionale dato da:

Qi j

dove η L

m1 m2

m1 m2 !

2

2η vi v j

M

n̂i nˆj a

(1.23)

, n̂i ed nˆj sono i versori delle direzioni delle due componenti, M

la massa totale.

Per avere un’idea degli ordini di grandezza e delle caratteristiche del sistema

“ideale” da rivelare, è utile calcolare il segnale irraggiato da un modello estremamente semplificato: si supponga che le stelle siano gemelle di massa m e che

CAPITOLO 1. BINARIE COALESCENTI

31

l’orbita sia circolare, allora il momento di quadrupolo risulta proporzionale alla

M a 2 . La sua derivata terza

...

2

Ma2 ω3 , e

richiede di dividere per la terza potenza del periodo, quindi Q > Ma

>

T3

massa totale ed al quadrato del raggio orbitale Q

poiché dalla terza legge di Keplero si ha che ω ∝

...

Q>

M

a

M

>

m

,

a3

risulta:

5

2

(1.24)

Di conseguenza la luminosità gravitazionale emessa è proporzionale alla quinta

potenza del rapporto nella formula precedente che, se espresso in unità geometriche, suggerisce come migliori sorgenti i sistemi stretti dove la separazione tra gli

oggetti sia dell’ordine del loro raggio di Schwarzschild.

L’evoluzione della perturbazione alla metrica spazio-temporale indotta da un

sistema binario può essere suddivisa in tre fasi:

1. una prima, in cui le stelle restringono sempre più la loro orbita fino al primo contatto, che ha la caratteristica di aumentare in frequenza ed ampiezza

con lo scorrere del tempo3 , fino a raggiungere il culmine nell’ ultima orbita

stabile, l’ultima posizione di semiequilibrio per l’energia, nell’istante immediatamente precedente alla forte interazione tra le due stelle che porterà al

contatto e successivamente alla nascita del buco nero.

2. La seconda, in cui avviene la fusione tra le due componenti, che dipende

fortemente dai modelli usati per descrivere l’equazione di stato delle stelle

di neutroni, e dai calcoli numerici sulla geometria generata da due buchi neri

nel caso di sistemi più pesanti.

3. Infine, la terza in cui si porta a compimento la nascita del buco nero generato dalla fusione delle due stelle, che approssimativamente ha la forma di

sinusoidi smorzate, ma con andamento dell’ampiezza e della fase difficili da

prevedere.

3 La metrica

“di base” perturbata dal passaggio dell’onda viene assunta minkowskiana, per cui ha

senso definire il tempo come abitualmente, in quanto gli effetti della radiazione gravitazionale sono

puramente perturbativi

CAPITOLO 1. BINARIE COALESCENTI

32

Nell’approssimazione di masse puntiformi ed orbite newtoniane circolari (alle

frequenze alle quali il segnale è rivelabile la circolarizzazione è avvenuta completamente4 ), la forma d’onda nella prima fase è data da:

h

hx

dove A >

GMc !

r

5

3

A 6 f t

A 6 f t

7

7

2

3

cos φ t 2

3

sin φ t (1.25)

è l’ampiezza dell’onda, inversamente proporzionale alla distanza

e funzione delle due masse tramite la massa di chirp M c

m1 m2 !

L

m1 m2 !

dell’onda, che in questa approssimazione vale:

φ t

16π f0 τ f0 11

con f0 frequenza gravitazionale per t

.

1

1

t

τ f0 5

8

/

3

5

1

5

, φ t è la fase

(1.26)

0, τ f 0 il tempo residuo prima della coa-

lescenza (tempo di chirp), mentre l’andamento della frequenza, che risulta doppia rispetto a quella orbitale, a causa della natura quadrupolare della radiazione

gravitazionale, è dato da:

ft

4

f0 1 t

τ f0 3

8

(1.27)

La binaria PSR B1913+16 attualmente ha eccentricità pari a 0,617 , quando raggiungerà

frequenze di emissione dell’ordine dei 10 Hz l’eccentricità si sarà ridotta fino a 5 G 3 F 10 H 6 [5]

CAPITOLO 1. BINARIE COALESCENTI

33

In base alla frequenza orbitale attuale, le componenti sono destinate a spiraleggiare fino a coalescere in tempi minori o maggiori del tempo di Hubble 5 secondo

la formula:

tcoal

a4

5c5

256G m1 m2 m1 m2 1 5 108

a4

m1 m2 m1 m2 (1.28)

dove la seconda espressione è in unità solari 6 .

Dalla relazione precedente si nota che per masse intorno al valore di quella

solare, occorre una separazione più stretta di 3 raggi solari perchè la coalescenza

avvenga in tempi minori dell’età dell’Universo. Per questo motivo i sistemi di nane,

sebbene abbiano la stessa sorte delle binarie più massicce, difficilmente saranno

osservabili, avendo come punto a proprio sfavore anche un segnale estremamente

più debole (la luminosità gravitazionale dipende fortemente dalla massa).

Una quantità che sarà interessante dal punto di vista della rivelazione è il tempo di permanenza del segnale in una determinata banda di frequenza, ottenibile

semplicemente invertendo la relazione 1.27:

∆t

τ f0

.

fmin f0

8

3

8

3

fmax f0

(1.30)

/

L’espressione per il segnale dato dalla 1.25 è indipendente dalla posizione della

sorgente nel cielo, poiché è calcolata nel suo stesso sistema di riferimento. Ad un

osservatore terrestre l’onda appare invece della forma:

h

hx

A 6 f t

A 6 f t

7

7

2

3 N

cos φ t cos 2θ 2

3 N

sin φ t cos 2θ cos i cos φ t sin 2θ cos 2 i 1

2

sin φ t sin 2θ cos iO

(1.31)

cos 2 i 1

O

2

5

La legge di Hubble v D H0 r lega la velocità di un oggetto alla sua distanza dall’osservatore,

ed esprime l’espansione dell’Universo al primo ordine. Da questa è possibile ricavare un ordine

di grandezza per l’età dell’Universo, dato proprio dall’inverso della costante di Hubble: H0H 1 I

1 G 8 F 1010 anni (tempo di Hubble).

6 Nel caso generale in cui l’orbita sia ancora ellittica con eccentricità e , il sistema è previsto

0

collassare su se stesso entro:

tcoal

D

5c5

a4 P 1 Q e 0 R 4

48

48G m m P m m e 19

T 1

S

1 2 1S

2R

e0

121 e2

304 0 U

3480

2299 V

0

29

e 19 T 1 S

P

1Q

121 e2

304 0 U

3

e2 2

R

1181

2299

de

(1.29)

CAPITOLO 1. BINARIE COALESCENTI

34

dove i descrive l’inclinazione del piano dell’orbita rispetto alla linea di vista, θ la

polarizzazione del’onda. La relazione tra i due sistemi di riferimento è rappresentata nella figura seguente, dove (α δ) indicano le coordinate equatoriali 7 della

sorgente:

1.3.3 Approssimazioni successive

Sempre nell’approssimazione di campo debole, ovvero molto lontano dalle sorgenti, è possibile raffinare i risultati ottenuti con le ipotesi newtoniane, aggiungendo

delle correzioni dette “Post-Newtoniane”.

Il formalismo Post-Newtoniano è sostanzialmente un’espansione in serie attorno all’ipotesi di campo debole (che riguarda quindi il potenziale gravitazionale) e

sorgente lenta (in moto con velocità non relativistiche, lo sviluppo è in potenze di

7

Le coordinate equatoriali permettono di identificare un punto sulla sfera celeste, dove sono

definite le quantità analoghe alla sfera terrestre (equatore, etc.) così è possibile assegnare delle

coordinate alla proiezione delle stelle su questa superficie fittizia. Esse sono così definite:

Declinazione (δ): arco di meridiano celeste compreso tra la stella e l’equatore celeste

Ascensione Retta (α): arco di equatore celeste compreso tra il meridiano celeste passante per

l’astro ed il punto γ, definito come il punto sull’equatore celeste in cui passa il Sole nel giorno

dell’equinozio di primavera.

CAPITOLO 1. BINARIE COALESCENTI

v

c ),

35

dove l’ordine zero è dato dalla teoria Newtoniana, e gli ordini successivi sono

le correzioni apportate dalla Relatività Generale.

Al secondo ordine Post-Newtoniano (2PN) il segnale gravitazionale ha la forma della 1.25, ma l’espressione per la fase in funzione della frequenza è [22]:

φ f

16π fr τ0

5

.

1

5

3

f

fr

3

4

25τ1 5 5

16τ0

5τ1

4τ0

1

1

3

f

fr

3

2

3

1

f fr

5τ2

2τ0

4

4

1

1

3

f

fr

3

(1.32)

/

4

dove fr è una frequenza di riferimento scelta arbitrariamente come unità di misura,

mentre i τi sono i raffinamenti del tempo di chirp newtoniano, definiti come:

τ0

L

5

f

256π r

1

5

3

πM fr τ1

L

1

η

5

f

192π r

τ1 5 5

τ2

L

5

f

128π r

1

1

L

1

πM fr 1

f

8 r

1

3

πM fr 1

753

336

2

3

πM fr 3058673

1016064

11 η η

4

1

1

η

5429 617 2 η

η η

1008

144

1

(1.33)

dove η identifica il rapporto tra massa ridotta e massa totale del sistema.

La frequenza di irraggiamento è data implicitamente dall’equazione differenziale:

df

dt

3 fr

8τ0

f fr

11

3

.

1

3τ1

4τ0

f

fr

2

3

5τ1 5 5

8τ0

f

fr

11

3

1

2

3

τ2

τ0

9

8

τ1 τ0

4

2

4

f 3/

fr

(1.34)

La soluzione delle equazioni di Einstein per l’irraggiamento di binarie è stata

calcolata anche fino al 2,5 PN [5] e successivi, tuttavia l’approssimazione newtoniana è sufficiente per stimare l’orizzonte osservabile per via gravitazionale tramite

una rete di rivelatori, semplificando notevolmente i calcoli.

CAPITOLO 1. BINARIE COALESCENTI

36

1.3.4 Tassi di coalescenze

Il tasso di coalescenza per le binarie al variare delle masse previsto dai modelli

di evoluzione proposti da Belczynski, Kalogera e Bulik è stato calibrato usando il

numero di esplosioni di supernova sperimentale, normalizzato alla nostra galassia

[2].

I diversi modelli scaturiscono da variazioni nel valore di parametri rispetto ad

uno di base, il modello evolutivo standard, ed in alcuni casi si osservano differenze

notevoli nell’evoluzione. Uno di questi casi è dato dalla velocità acquistata in seguito all’esplosione della stella come supernova, che è in valore inversamente proporzionale al numero di binarie che collidono, poiché essa contribuisce a slegare

gravitazionalmente le due stelle, e a rompere il sistema o comunque a renderlo più

largo. E’ inoltre interessante notare come le binarie che ricevano velocità dell’ordine di quella orbitale abbiano le migliori probabilità di sopravvivenza (Kalogera

1996).

Un altro effetto che tende a modificare il futuro di un sistema è la fase di inviluppo comune con accrescimento ipercritico, che oltre ad aumentare la massa

dell’oggetto compatto dandogli la possibilità di collassare a buco nero, porta ad

una configurazione più larga rispetto al caso di accrescimento normale, in quanto

parte dell’inviluppo viene catturato, e non ha quindi bisogno di essere espulso dal

sistema a spese dell’energia orbitale. Il contributo di questo fenomeno è comunque

piccolo, e non modifica la popolazione di binarie, e di consegenza i tassi di coalescenza, in maniera sostanziale. Il numero di buchi neri binari è invece fortemente

affetto dalla perdita di massa per vento stellare, che tende a farlo diminuire.

Il numero di coalescenze per galassia normalizzato alla Via Lattea è riportato

nella tabella seguente, dove gli autori hanno calcolato il flusso per ogni variazione

del modello standard (A):

nei modelli di tipo B è stata variata la velocità impressa dall’esplosione della

supernova (da 0 a 600 km s 1 )

il modello C non prevede l’accrescimento ipercritico

i modelli D variano il valore della massa di Chandraseckar per le stelle di

neutroni

nei modelli E cambia l’efficienza dell’inviluppo comune

CAPITOLO 1. BINARIE COALESCENTI

37

quelli di tipo F fanno variare la frazione di massa accresciuta dalla compagna

nei modelli di tipo G cambia l’efficienza del vento stellare

in quelli di tipo H ci sono diversi valori di masse dell’inviluppo convettivo di

elio nelle giganti

il modello I assume che le stelle si siano formate tutte 10 miliardi di anni fa

nel modello J è modificata la funzione di distribuzione di massa assumendo che

sia ∝ m

2 5 35

i modelli K alterano la frazione di binarie nella popolazione stellare (dimezzandola e raddoppiandola)

nei modelli L varia il momento angolare perso nella fase di inviluppo comune

i modelli M modificano la distribuzione iniziale del rapporto di masse

il modello artificiale N non prevede l’espansione alla fase di gigante di elio

infine il modello O allarga l’intervallo di masse per cui si ha una parziale

ricaduta di materiale sulla stella:

CAPITOLO 1. BINARIE COALESCENTI

38

Capitolo 2

I rivelatori interferometrici

2.1 Introduzione

Sebbene ci sia analogia tra le equazioni che le generano, per quanto riguarda la

rivelazione le onde gravitazionali sono estremamente più problematiche rispetto

a quelle elettromagnetiche. L’ostacolo principale è dato dalla natura stessa del

segnale gravitazionale: la radiazione che si propaga infatti è una perturbazione

dello spazio tempo, che modificherà quindi anche lo strumento di rivelazione. Per

riuscire quindi a misurare direttamente il passaggio di un’onda gravitazionale, è

necessario sfruttare l’effetto che questa produce sui corpi.

Le uniche componenti non nulle nel tensore di Riemann

1

di un’onda gravi-

tazionale producono delle forze di marea oscillanti, che producono deformazioni

proporzionali alle dimensioni dell’oggetto, per cui su di un singolo corpo dalle

dimensioni trascurabili non hanno alcun effetto.

Prese però due masse che seguano le proprie geodetiche, che sulla Terra si

traduce in “in caduta libera”, se ξi rappresenta la separazione spaziale tra le due

geodetiche, si ha:

d 2 ξi

dt 2

Ri0k0 ξk

(2.1)

1 Il tensore di Riemann è una quantità dipendente dalle derivate seconde della metrica, e si annulla

su uno spazio piatto

39

CAPITOLO 2. I RIVELATORI INTERFEROMETRICI

40

dove R indica il tensore di Riemann, che per un’onda gravitazionale è della forma:

Ri0k0

dove è usata la notazione Aαβ 5 β

∂Aαβ

∂xβ

1

hik 5 00

2

(2.2)

per la derivata. Quello che accade dunque

è che due masse investite da radiazione gravitazionale subiscono un’accelerazione

di marea data da:

d 2 δξi

dt 2

1

hik 5 00 ξk

2

Vista la microscopica ampiezza del tensore h è lecito considerare lo spostamento

molto piccolo rispetto alla distanza di equilibrio ξ k , attorno cui esse oscilleranno

con ampiezza:

δξi

1

hik ξk

2

I rivelatori interferometrici sfruttano proprio questo fenomeno, come verrà

spiegato in dettaglio nei paragrafi successivi.