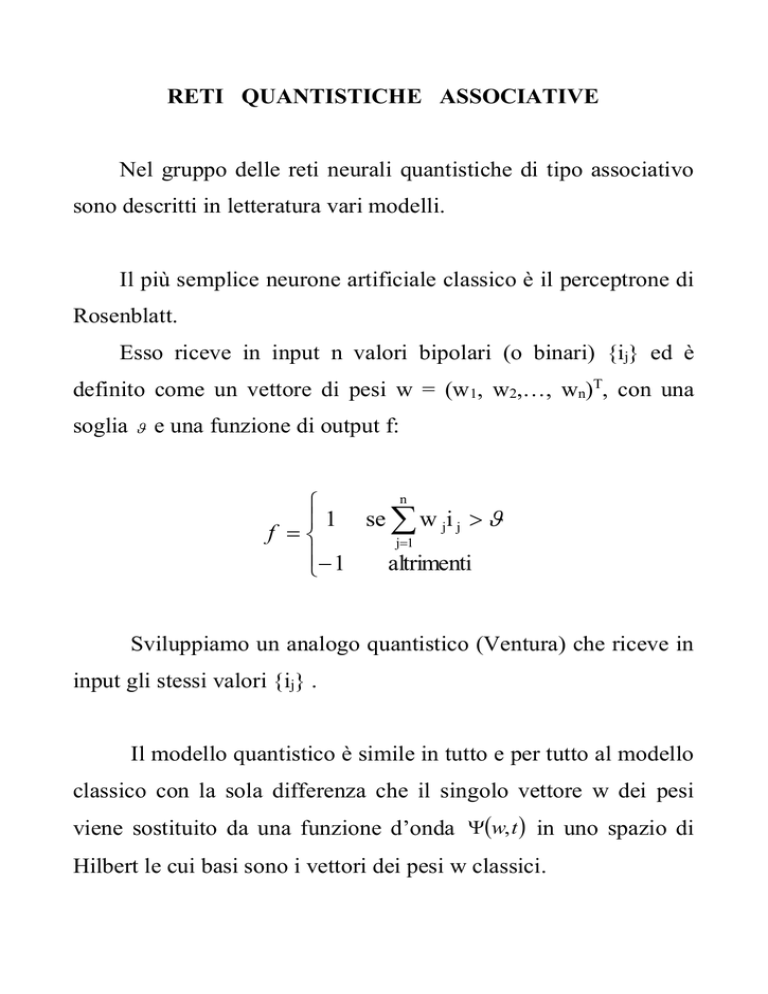

RETI QUANTISTICHE ASSOCIATIVE

Nel gruppo delle reti neurali quantistiche di tipo associativo

sono descritti in letteratura vari modelli.

Il più semplice neurone artificiale classico è il perceptrone di

Rosenblatt.

Esso riceve in input n valori bipolari (o binari) {ij} ed è

definito come un vettore di pesi w = (w1, w2,…, wn)T, con una

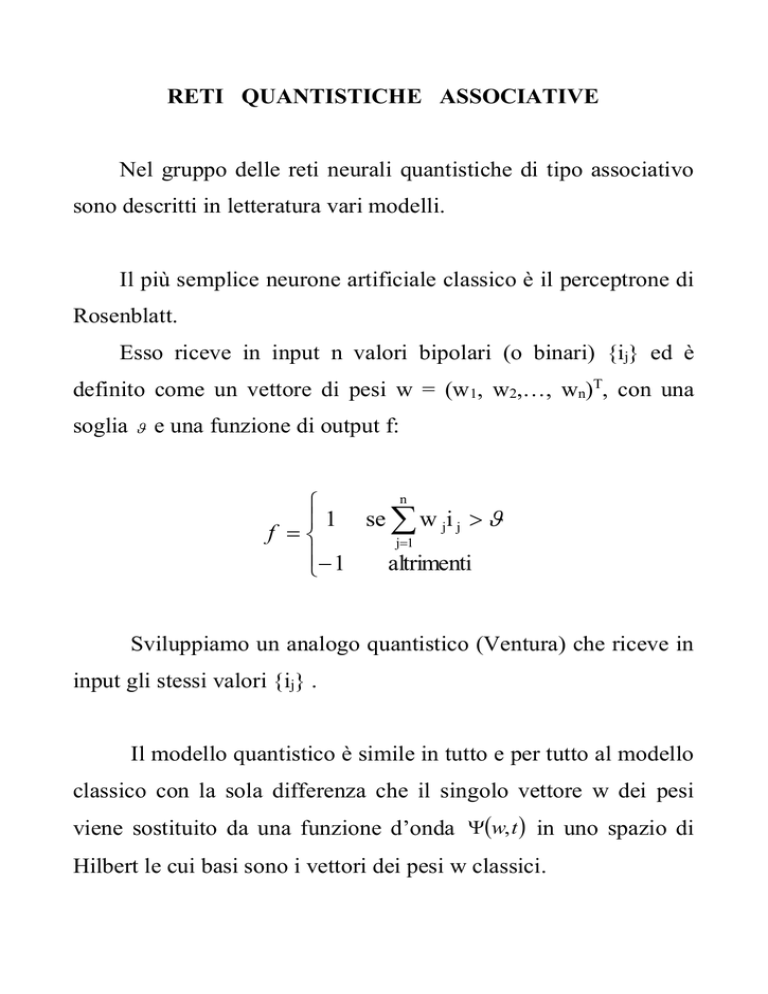

soglia e una funzione di output f:

n

1 se w ji j

f

j1

1

altrimenti

Sviluppiamo un analogo quantistico (Ventura) che riceve in

input gli stessi valori {ij} .

Il modello quantistico è simile in tutto e per tutto al modello

classico con la sola differenza che il singolo vettore w dei pesi

viene sostituito da una funzione d’onda w, t in uno spazio di

Hilbert le cui basi sono i vettori dei pesi w classici.

La funzione d’onda rappresenta le ampiezze di probabilità

(in genere complesse) per tutti i possibili vettori dei pesi nello

spazio dei pesi insieme alla condizione di normalizzazione

2

dw 1

In questo modo il vettore dei pesi del perceptrone è stato

sostituito da una sovrapposizione quantica di molti vettori di pesi,

che al momento dell’interazione con l’ambiente collassato in un

vettore di pesi classico con probabilità date da

2

.

Ad esempio consideriamo la funzione bipolare con un

singolo input e un singolo output, che inverte il suo input (NOT).

Per semplicità facciamo in modo che i pesi siano limitati:

wj

Per fare in modo che il neurone impari questa funzione è

necessario trovare w, t e la soglia .

Assumiamo per semplicità che la w, t sia invariante

rispetto al tempo

Trovare significa risolvere un classico problema “rigid

box” di meccanica quantistica , in cui si immagina una particella

immersa in un parallelepipedo di lato L.

L’equazione di Schroedinger è

ma essendo

si ottiene per ogni dimensione

con le soluzioni canoniche

con

per la condizione di continuità.

In questo caso uni-dimensionale le soluzioni sono della

forma:

w0 A sin(

n

w0 )

a

dove A è la costante di normalizzazione, n = 1,2,3,…,w0 è il

singolo elemento di w e a è una costante .

In un neurone quantistico i vettori peso esistono in

sovrapposizione coerente di tutti i possibili vettori peso nello

spazio dei pesi con ampiezza di probabilità diversa da zero.

Quando la sovrapposizione dei vettori peso interagisce con il

suo ambiente (ad esempio incontra un input) deve collassare in

uno stato base , un vettore peso classico entro i confini

wj

| |2.

, secondo una probabilità governata da

Nel caso generale le soluzioni saranno sempre equivalenti a

quelle del un parallelepipedo n dimensionale in modo che

abbia sempre la forma generale riportata sopra.

Per quanto riguarda il training, si tratterà di variare , che è

governata dall’equazione di Schroedinger. In essa l’unica variabile

che può essere cambiata è il potenziale U, quindi può essere

variata variando U.

Si tratta ancora di capire esattamente il significato degli n, e

anche

quali operatori assicurino un corretto collasso della

funzione d’onda.

Si dovrà trovare un operatore analogo ad una forma

matriciale per il vettore di input.

Quindi l’idea della sovrapposizione lineare può essere

applicata non solo al vettore peso di un neurone, ma anche ai suoi

input, ai suoi output, e alla sua funzione di attivazione.