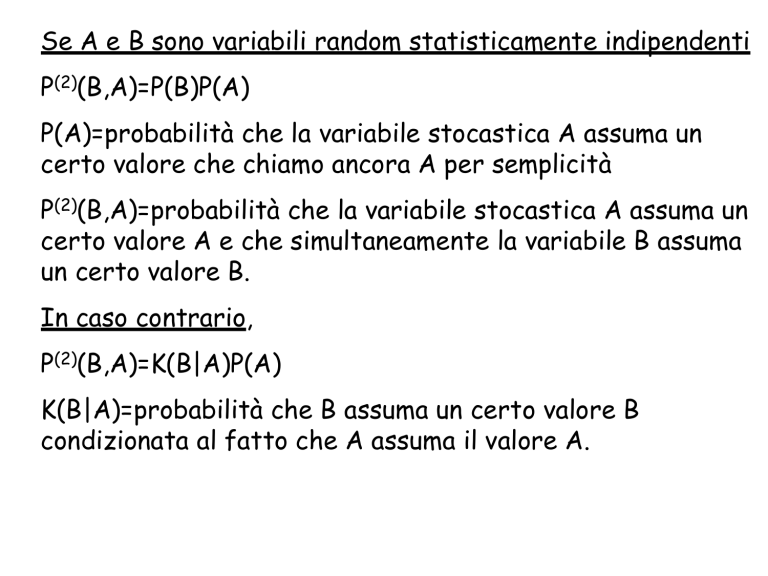

Se A e B sono variabili random statisticamente indipendenti

P(2)(B,A)=P(B)P(A)

P(A)=probabilità che la variabile stocastica A assuma un

certo valore che chiamo ancora A per semplicità

P(2)(B,A)=probabilità che la variabile stocastica A assuma un

certo valore A e che simultaneamente la variabile B assuma

un certo valore B.

In caso contrario,

P(2)(B,A)=K(B|A)P(A)

K(B|A)=probabilità che B assuma un certo valore B

condizionata al fatto che A assuma il valore A.

Consideriamo ora l’evoluzione di un sistema stocastico nello

spazio delle configurazioni.

Per definizione di sistema stocastico, non esiste una legge

deterministica che fornisca x=x(t)

Se il sistema visita in “successione temporale discretizzata”

(o meglio, a step successivi) gli stati x0,x1,x2,…, xn, xn+1,… , in

generale

Pn+1(xn+1) = probabilità di raggiungere lo stato xn+1 al passo

n+1

dipenderà dagli stati visitati in precedenza. Se posso

determinare la probabilità di raggiungere xn+1 dalla sola

conoscenza di xn ->

Se

P ( xn 1 , xn ) K ( xn 1 | xn ) Pn ( xn );

( 2)

n 1

K ( x' | x) 0

K ( x' | x) 1

x'

-> K è detta “matrice statistica” (definita positiva e “column

normalized”, una condizione abbastanza ovvia)

-> siamo in presenza di un “processo markoviano”

-> la successione delle configurazioni visitate è detta

“catena di Markov”

Osservazione: dato che

Pn 1 ( xn 1 ) P ( xn 1 , xn )

( 2)

n 1

xn

Pn 1 ( xn 1 ) K ( xn 1 | xn ) Pn ( xn )

xn

“Master equation”. Se conosco la probabilità P0 che al tempo

0 il sistema sia in x0 e conosco le “probabilità di

transizione”, tramite la master equation construisco tutta

la sequenza di probabilità al tempo successivo -> risolvo il

problema statistico

Definizione: sia

M

K ( x' | x)

la probabilità di finire in x’ a partire da x in M passi.

La catena di Markov si dice “ergodica” se per ogni coppia

(x’,x) dello spazio delle configurazioni esiste un intero M

tale per cui

K ( x' | x) 0

M

Domande chiave:

1) La master equation ammette una soluzione stazionaria, e

quindi tale per cui

Pn 1 ( xn 1 ) K ( xn 1 | xn ) Pn ( xn )

xn

P ( xn 1 ) K ( xn 1 | xn ) P ( xn ) ?????

xn

2) Sotto quali condizioni, assegnata una P0 al passo 0 la

catena di Markov converge ad una distribuzione

stazionaria, e quindi

P ( x) lim Pn ( x) ????

n

Pn1 ( xn1 ) K ( xn1 | xn ) Pn ( xn )

xn

Immaginiamo di chiedere che la soluzione stazionaria corrisponda alla

distribuzione relativa ad un certo n …

P ( xn ) Pn ( xn )

Pn1 ( xn1 ) K ( xn1 | xn ) P ( xn )

se

xn

K ( xn 1 | xn ) P ( xn ) K ( xn | xn 1 ) P ( xn 1 )

Pn 1 ( xn 1 ) K ( xn 1 | xn ) P ( xn )

xn

K ( xn | xn 1 ) P ( xn 1 )

xn

P ( xn 1 ) K ( xn | xn 1 ) P ( xn 1 ) cvd

xn

La condizione di “bilancio dettagliato”:

K ( x' | x) P( x) K ( x | x' ) P( x' )

e’ sufficiente a garantire che la master equation

Pn1 ( xn1 ) K ( xn1 | xn ) Pn ( xn )

xn

ammetta soluzione stazionaria.

Si dimostra inoltre (non lo facciamo, non è immediato) che se è soddisfatta la

condizione di bilancio dettagliato, e la catena di Markov è ergodica, allora partendo

da una distribuzione al tempo 0, e utilizzando la master equation per generare la

catena, ottengo una distribuzione stazionaria per n sufficientemente grandi.

Come si costruisce una catena di Markov che evolva, a grandi n, ad una distribuzione

desiderata P (x) ?

N.Metropolis (Los Alamos National Laboratory, primi anni ‘50) ha suggerito il

seguente schema: definisco una “probabilità di transizione” T(x’|x) che ha il ruolo

della K(x’|x) ma, in generale non soddisfa il bilancio dettagliato. A parte le ovvie

proprietò:

T ( x' | x) 0; T ( x' | x) 1

x'

Richiedo “solo” che T assicuri l’ergodicità. Di fatto, spesso ci si limita a

controllarlo “a naso”.

Dopodiche’ costruisco ….

K ( x' | x) A( x' | x)T ( x' | x) per x' x

1 K ( x' | x) K ( x | x) A( x' | x)T ( x' | x)

x ' x

x'

K ( x | x) 1 A( x' | x)T ( x' | x);

x ' x

P ( x' )T ( x | x' )

A( x' | x) min 1,

P ( x)T ( x' | x)

Soddisfa il detailed balance, ovvero

K ( x' | x) P ( x) K ( x | x' ) P ( x' ) ???

P ( x' )T ( x | x' )

K ( x' | x) P ( x) min 1,

P ( x)T ( x' | x)

P ( x)T ( x' | x)

P ( x)T ( x' | x)

K ( x | x' ) P ( x' ) min 1,

P ( x' )T ( x | x' )

P ( x' )T ( x | x' )

K ( x' | x) P ( x) min 1, P ( x)T ( x' | x)

1

K ( x | x' ) P ( x' ) min 1, P ( x' )T ( x | x' );

P ( x' )T ( x | x' )

;

P ( x)T ( x' | x)

1

1 1

K ( x' | x) P ( x) P ( x' )T ( x | x' );

K ( x | x' ) P ( x' ) P ( x' )T ( x | x' ) cvd

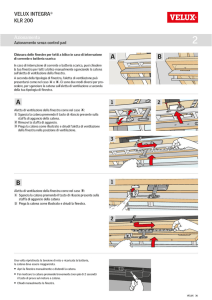

Il nostro MC è del tipo

x' x a ; (2rand () 1)

T(x’|x)

x-a

x

1

T ( x ' | x ) 2a

0

x+a

se

X’

x a x' x a

altrimenti

T ( x' | x) T ( x' | x)

K ( x' | x) A( x' | x)T ( x' | x);

P ( x' )

A( x' | x) min 1,

;

P ( x)

H ( x )

e

P ( x)

Qcan

A( x' | x) min 1, e

H ( x ') H ( x )

Non devo calcolare la funzione di

partizione!!! Infatti, si costruiscono quasi

sempre T simmetriche

T ( xforse | xold ) mossa

E Enew Eold H ( x' ) H ( x)

E 0 A( xforse | xold ) min 1, e H ( x ') H ( x ) 1

accetto sempre

E 0 A( xforse | xold ) e

accetto con prob. e

E

E

Adesso sappiamo che la nostra costruzione, nel limite di infiniti passi, porta il

sistema all’equilibrio, ovvero che le configurazioni visitate dopo molti passi hanno il

peso statistico corretto. Quindi, se voglio fare una media di una osservabile

all’equilibrio, parto da una configurazione, la porto all’equilibrio e poi medio sulle

configurazioni generate da quel punto in poi. Occhio! Se rifiuto una mossa, devo

considerare che la nuova configurazione (al passo n+1) è identica alla vecchia, se no

do’ il peso statistico sbagliato!!!!!!