IL SISTEMA NERVOSO CENTRALE

GENERALITA’

Il sistema nervoso svolge moltissimi compiti all’interno dell’organismo umano, tra cui:

• Fornisce sensazioni sull’ambiente interno ed esterno

• Integra le informazioni sensoriali

• Coordina le attività volontarie e involontarie

• Regola e controlla le strutture e gli apparati periferici

• E’ sede della cognizione, delle emozioni, della memoria, ecc.

La sua struttura anatomica generale è:

• Sistema Nervoso centrale (SNC)

– Encefalo (racchiuso nella cavità cranica)

– Midollo Spinale (racchiuso nel canale vertebrale)

• Sistema Nervoso periferico (SNP)

– Tutto il tessuto nervoso al di fuori del SNC (nervi e gangli nervosi)

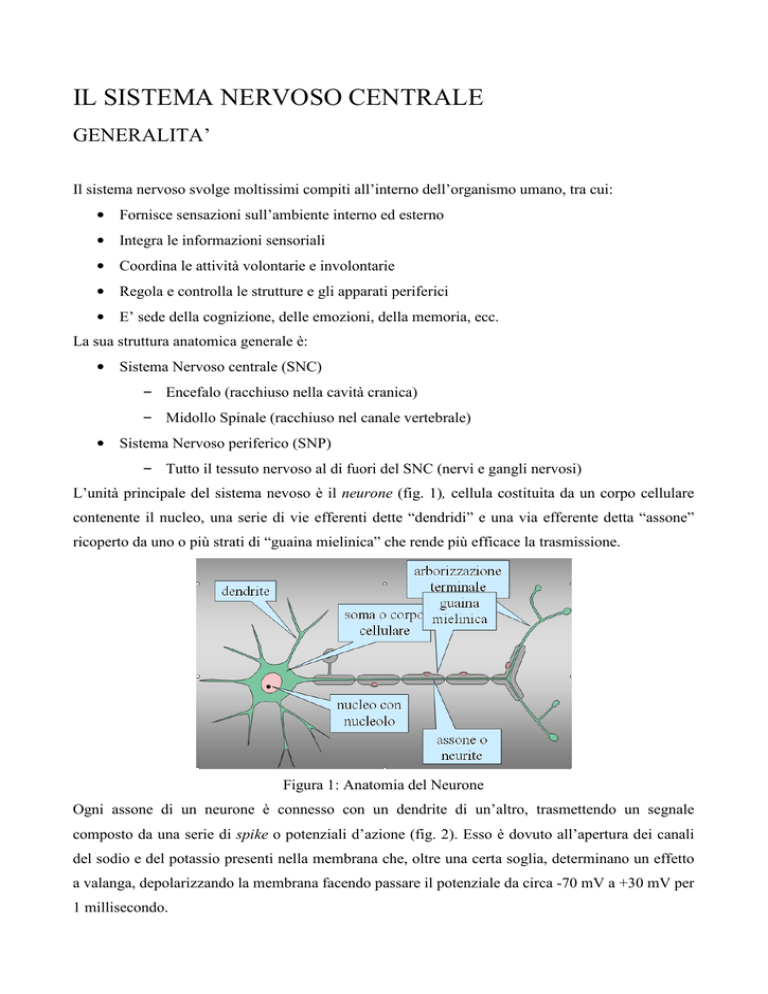

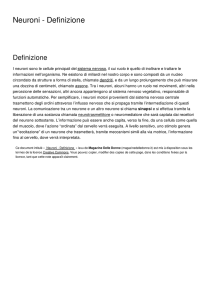

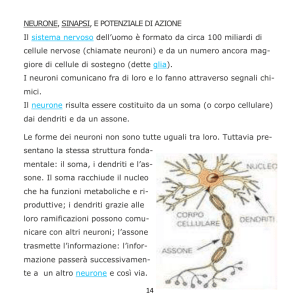

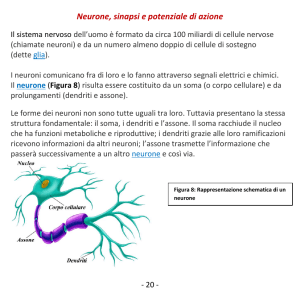

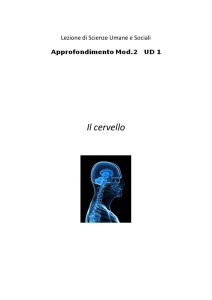

L’unità principale del sistema nevoso è il neurone (fig. 1), cellula costituita da un corpo cellulare

contenente il nucleo, una serie di vie efferenti dette “dendridi” e una via efferente detta “assone”

ricoperto da uno o più strati di “guaina mielinica” che rende più efficace la trasmissione.

Figura 1: Anatomia del Neurone

Ogni assone di un neurone è connesso con un dendrite di un’altro, trasmettendo un segnale

composto da una serie di spike o potenziali d’azione (fig. 2). Esso è dovuto all’apertura dei canali

del sodio e del potassio presenti nella membrana che, oltre una certa soglia, determinano un effetto

a valanga, depolarizzando la membrana facendo passare il potenziale da circa -70 mV a +30 mV per

1 millisecondo.

Figura 2: Generico Potenzile d’azione di un neurone

Se la corrente ionica che depolarizza la membrana si propagasse per ogni singola parte dell’assone,

la trasmissione del segnale sarebbe piuttosto lenta, soprattutto se si considera che nel sistema

nervoso periferico, in particolare per i recettori del tatto, esistono neuroni con assoni lunghi più di

un metro. Lungo l’assone è quindi presente un rivestimento, la guaina mielinica (fig 3), che lascia

liberi soltanto alcuni tratti dell’assone detti Nodi di Ranvier, lungo cui si propaga il potenziale

d’azione. La guaina è posta lungo l’assone dalle cellule di Schwann che si attaccano alla membrana

e ruotano attorno all’assone depositandovi sopra lo strato di mielina.

Figura 3: Rivestimento della guaina mielinica lungo l’assone

2

TEORIA DELLA SELEZIONE DI GRUPPI NEURONALI E REGOLA

STDP

Nelle neuroscienze, particolarmente significativo è il darwinismo neurale di Gerald M. Edelman.

Nato a New York nel 1929, Edelman ha ottenuto nel 1972 il premio Nobel per la fisiologia e la

medicina per le sue ricerche sugli anticorpi. Oggi dirige il Dipartimento di Neurobiologia presso lo

Scripps Research Institute a La Jolla, California. Il fatto che un Nobel in immunologia abbia

elaborato una teoria neuroscientifica non deve stupire più di tanto: c'è un'affinità tra sistema

immunitario e sistema neuronale. E poi i biologi davvero ambiziosi prima o poi si confrontano con

le neuroscienze: il cervello umano infatti è l'oggetto fisico più complesso e difficile che si possa

trovare nell'universo conosciuto. Ed Edelman ha applicato prima allo sviluppo degli anticorpi, poi

allo sviluppo del cervello il principio selezionista, elaborando una Teoria della Selezione dei Gruppi

Neuronali (TSGN). In biologia, si sono confrontati e si confrontano tutt'oggi due tipi di spiegazione

antitetici: istruzionista e selezionista. Storicamente le spiegazioni istruzioniste precedono quelle

selezioniste, ma tendono ad essere soppiantate dalle seconde. Questo è accaduto per l'origine delle

specie, per la specificità degli anticorpi, e ora per il funzionamento del cervello. Per l'origine delle

specie, in un primo tempo ha prevalso, attraverso Linneo e Buffon, la teoria delle specie come

essenze fisse che si autoriproducono; ogni individuo nasce portando lo stampo della propria specie

o eidos (forma essenziale), che resta immutata nelle varie generazioni. Questa teoria istruzionista è

stata soppiantata dal selezionismo di Darwin.La TSGN di Edelman estende alla formazione del

cervello - e quindi della nostra mente - la spiegazione selezionista che Darwin applicò

all'evoluzione delle specie. Egli è convinto che le reti neuronali si sviluppino nel cervello di

ciascuno così come gli animali evolvono nel mondo zoologico: alcuni individui (in questo caso i

gruppi neuronali) sono portatori di una differenza casuale, che l'ambiente poi seleziona favorendone

la riproduzione. Questa teoria si basa su tre concetti fondamentali: selezione dei gruppi neuronici,

rientro e mappa globale. Il gruppo neuronico è l'equivalente neurale dell'individuo (fenotipo) nella

teoria dell'evoluzione: è il neuro-individuo che verrà selezionato o meno, e che quindi più o meno si

riprodurrà. Come gli individui delle specie zoologiche, anche i gruppi neuronali sono impegnati in

un'incessante competizione per sopravvivere e riprodursi. Questo processo di selezione delle cellule

produce reti anatomiche diverse da individuo a individuo. Quindi, non esistono al mondo due menti

umane eguali. Le mappe mettono in relazione i recettori del corpo (come pelle o retina) con i punti

corrispondenti sugli strati del cervello: insomma, determinano l'immagine del mondo che il cervello

si costruisce. Il punto fondamentale è che queste mappe sono rientranti: siccome le mappe sono tra

loro connesse, la selezione che avviene in una mappa comporta selezioni simili in altre mappe. Il

3

rientro permette di collegare fisiologia e psicologia: esso implica in effetti che le nostre esperienze

in un dato settore si ripercuotono a vari livelli mentali, cambiando la nostra categorizzazione del

mondo. In altri termini, la nostra esperienza è anche retroattiva: quel che esperiamo al presente

rimodella il nostro passato. La mappa globale, infine, è una struttura dinamica composta da mappe

locali che interagisce con parti del cervello non organizzate a mappe. Essa varia nel tempo e a

seconda del comportamento, ed è responsabile della categorizzazione percettiva dell'animale.

Ma come è possibile modellizzare i gruppi neuronici?

Va considerata una nuova variabile: il tempo. La sua introduzione, incrementa la difficoltà

implementativa della rete neurae, ma al tempo stesso ne reinterpreta la concezione.

Nei modelli matematici precedenti a questa teoria, infatti, non è considerato il tempo di percorrenza

che impiega lo spike da un neurone all’altro. Questa approssimazione non è per niente valida, se si

considerà che in un mammifero uno spike può impiegare tempi brevissimi, come 0.1 ms, per

raggiungere il neurone post-sinaptico, ma anche tempi molto lunghi fino a 44 ms a seconda della

loro posizione spaziale. Questa considerazione è stata sviluppata da Izhikevich che ha utilizzato i

propri studi sui modelli dinamici di neuroni in associazione con le teorie di Edelman stesso. Egli

infatti, osservò che i gruppi neuronici emergono spontaneamente dalla rete e sono in numero di gran

lunga superiori al numero di neuroni implementati.

Nell’implementare la nuova rete neurale deve essere inserita una corrispondenza tra la modicazione

del peso sinaptico in conseguenza del comportamento del neurone e un sistema che simula i ritardi

assonali, portando ad accoppiamenti spike-tempo che permettono ai neuroni di autorganizzarsi in

gruppi di grandezza variabile. I neuroni possono appartenere a più gruppi contemporaneamente e

questi ultimi coesistono e sono di numero superiore al numero di neuroni nella rete stessa,

generando una capacità di memoria molto maggiore rispetto alle reti neurali esistenti.

La generazione spontanea dei gruppi neuronici con la policronizzazione fornisce il collegamento

con le teorie di Edelman. La rete reagisce a segnali provenienti dall'esterno, con la generazione di

gruppi neuronici rapportati al segnale stesso, cioè essa apprende informazioni con correlazioni di

tipo spazio-tempo. Come detto precedentemente, i neuroni possono generare forme di potenziale

basate sul tempo di spike in ingresso, con precisione che arriva al millisecondo. Tale generazione è

realizzata sia a livello del singolo neurone, sia in base al tempo di spike relativo di neuroni multipli,

che conduce alla formazione del gruppo neuronico. Le connessioni sinaptiche sono modicate in

accordo alla regola STDP in cui la plasticità della rete è dipendente dagli spike e dal tempo di

ritardo di questi ultimi.

L’STDP (Spike Timing Depended Plasticity) è una nuova forma di plasticità sinaptica di tipo

Hebbiano che sta avendo particolare attenzione negli ultimi anni. Se uno spike proveniente da un

4

neurone eccitatorio presinaptico arriva ad un neurone postsinaptico (dando così la possibilità di

generare un altro spike), la sinapsi viene potenziata (rafforzata). Invece se lo spike arriva in

conseguenza ad uno spike del neurone postsinaptico, la sinapsi viene depotenziata (indebolita).

Attraverso il ruolo congiunto dei ritardi assonali e regola STDP si arriva alla spontanea

formazione di gruppi neuronali

Addestramento con Regola STDP

5

RETI NEURALI ARTIFICIALI E MODELLI DI

NEURONI

RETI NEURALI ARTIFICIALI

PANORAMICA GENERALE

Le reti neurali artificiali, come accennato in precedenza, sono algoritmi di calcolo ispirati dal

sistema nervoso umano, per svolgere compiti in cui le tradizionali tecniche non trovano soluzione.

Essi sono principalmente:

-

Sistemi intelligenti basati su ingressi da segnali di origine sensoriale (ad es. visiva,

acustica, olfattiva, tattile);

-

rivelazione, verifica e identificazione di caratteri e oggetti (codici a barre, caratteri

stampati o scritti a mano, impronte digitali, firme, facce, difetti di prodotti, oggetti

meccanici, minerali, etc.);

-

riconoscimento di odori e composti (sistema olfattivo artificiale, lingua elettronica);

-

movimento di oggetti e guida (sicurezza, automazione della fabbrica, sistemi di

navigazione, robot mobili, localizzazione passiva di sorgenti sonore, localizzazione

attiva e guida di oggetti, sistemi di navigazione);

-

elaborazione delle immagini (compressione, eliminazione di difetti di immagini in

tempo reale);

-

riconoscimento della voce (selezione telefonica, elaborazione di parole dettate,

interfaccia intelligente uomocalcolatore, verifica e identificazione di persone per via

vocale, riconoscimento di oggetti dai suoni emessi, sistemi di diagnostica);

-

elaborazione del suono (compressione e miglioramento in tempo reale della voce e

della musica, aiuti audio e protesi); applicazioni basate su ingresso tattile (interfaccia

intelligente uomo-macchina);

-

altri sistemi sensoriali (sensori ad infrarossi, accelerometri, termocoppie, etc. per

misure, controllo e sicurezza);

6

-

sistemi sensoriali misti (dal testo al parlato, dalle immagini al suono, dalle immagini

al tattile, riconoscimento di configurazioni tramite fusioni sensoriale);

-

Sistemi di controllo adattativi: sistemi di integrazione sensoriale-motore; sistemi

intelligenti di controllo dei processi; sistemi intelligenti di controllo di

apparecchiature;

-

Elaborazione adattativa dei segnati: compressione dati in un PC; comunicazione e

archivio (voce, musica, immagini, video); miglioramento e sintesi dati (fax, voce,

TV ad alta risoluzione, grafica, cancellazione di rumore); memorie associative;

-

Sistemi esperti;

-

Robot autonomi.

Gli elementi base delle reti neurali artificiali vengono chiamati anch’essi neuroni, o unità, e ad essi

è associato un valore di attivazione che viene rappresentato come un valore numerico. Tale valore

di attivazione è determinato dai segnali che ciascuna unità riceve in ingresso dalle connessioni

sinaptiche e dalla funzione di attivazione. Il segnale che viene trasmesso dipende dal valore del peso

sinaptico associato alla connessione tra le due unità. Così come per il valore di attivazione delle

unità, anche l’efficacia delle connessioni sinaptiche viene rappresentata da un valore numerico che è

positivo nel caso di sinapsi eccitatorie e negativo nel caso di sinapsi inibitorie.

Una rete neurale riceve un input e produce un output. Sia input che output sono rappresentati dallo

stato di attivazione di alcune unità, rispettivamente le unità di ingresso e le unità di uscita. Questo

significa che gli stimoli sensoriali che una rete neurale artificiale riceve sono rappresentati da un

vettore numerico e, analogamente, le risposte che essa fornisce sono rappresentate dall’insieme dei

valori di attivazione delle unità di output. Il comportamento di una rete neurale, cioè il tipo di

risposte agli stimoli che essa produce, è determinato da una serie di fattori:

-

La regola di attivazione che, come abbiamo visto nel paragrafo precedente,

determina il valore di attivazione di una unità in base al segnale totale che essa

riceve dalle altre unità.

-

I pesi sinaptici, che determinano quanta attivazione o inibizione ciascuna unità è in

grado di trasferire alle altre unità con le quali è connessa.

-

La topologia, o architettura della rete, che specifica il numero di unità e il modo in

cui tali unità sono connesse tra di loro (fig. 10). È raro che le reti neurali siano

totalmente connesse (cioè che ogni unità comunichi e riceva informazione da tutte le

altre unità ed eventualmente anche da se stessa); di solito le unità sono disposte in

modo gerarchico: vi è uno strato di nodi che riceve input dall’ambiente, alcuni strati

di unità che ricevono informazione dallo strato di input e proiettano la propria

7

attivazione a uno strato di nodi di output. Vari tipi di modifiche possono rendere

questo schema più complesso, come ad esempio la connessione tra i nodi di uno

stesso strato, la proiezione diretta da input ad output, il feedback dalle unità di output

a quelle di input, ecc.

-

la dinamica temporale, ossia quando vengono aggiornati i valori di attivazione delle

diverse unità secondo una precisa regola detta “regola di apprendimento”.

Pattern di input

Strato 1

Input

Strato 2

Nascosto

Strato L-1

Nascosto

Strato L

Output

Pattern di output

Figura 10: esempio di architettura di una rete neurale artificiale

APPRENDIMENTO

Affinché una rete neurale si comporti nel modo desiderato è necessario che tali fattori (funzione di

attivazione, pesi sinaptici, architettura della rete e dinamica temporale) vengano specificati nel

modo corretto. Per ottenere ciò si può procedere in due modi distinti: si può decidere il valore ditali

fattori a priori (attraverso una analisi del comportamento che si vuole ottenere o cercando di

emulare le caratteristiche di un sistema nervoso naturale che si vuole simulare) oppure si può

cercare di approssimare dei valori corretti per tali fattori attraverso un processo di apprendimento.

Il modo in cui di norma vengono costruite le reti neurali artificiali è un modo ibrido nel senso che

alcuni fattori (la funzione di attivazione, la dinamica temporale e l’architettura della rete) vengono

stabiliti a priori in base alle conoscenze e agli obiettivi dello sperimentatore, altri fattori (di solito

solo i valori dei pesi sinaptici) vengono approssimati attraverso un processo di apprendimento. Gli

algoritmi di apprendimento più diffusi modificano esclusivamente i pesi sinaptici e prevedono che

8

gli altri fattori vengano definiti a priori dallo sperimentatore ma va detto che esistono degli

algoritmi in grado di selezionare anche l’architettura della rete attraverso un processo di

apprendimento. Le procedure attraverso le quali questi fattori vengono determinati vengono dette

algoritmi di apprendimento e in generale esse operano mutando progressivamente i valori di alcuni

fattori in modo tale che l’output della rete evolva da uno stadio iniziale casuale o indifferenziato a

uno stadio finale in cui approssimi un output richiesto (specificato in modo più o meno generale a

seconda dei casi).È importante osservare che ciascun algoritmo di apprendimento può essere

applicato esclusivamente ad una certa classe di architetture di rete che utilizzino una determinata

funzione di attivazione e una certa dinamica temporale.

E’ ovvio che reti neurali diverse possono assolvere alla stessa funzione. Ma qual’è l’ottimo per una

rete neurale artificiale? La risposta viene fornita dal Principio di Occam:

“date due reti che soddisfano l'insieme di apprendimento, la rete di minore complessità è quella che

si comporta meglio su esempi non visti, cioè ha la migliore capacità di generalizzazione”; per

generalizzazione si intende la capacità della rete di riconocere ingressi leggermente diversi da

quella per cui è stata addestrata.

L’apprendimento può essere essenzialmente di due tipi:

-

Supervisionato (fig. 11); esso prevede la presentazione di un set di esempi costituito

dagli ingressi e dall’uscita dsiderata. L’uscita reale viene confrontata con quella

desiderata e i pesi vengono modificati in modo da minimizzare la loro differenza.

-

Non supervisionato (fig. 12); la rete aggiorna i pesi in modo autonomo identificando

un “neurone vincente” identificato tramite regola Hebbiana descritta in seguito. Al

termine dell’addestramento, segue una fase di labeling, a cui viene associata l’uscita

desiderata al neurone vincente.

Figura 11: Apprendimento supervisionato

9

Figura 12: Apprendimento non supervisionato

Le regole hebbiane

Nel 1949 lo psicologo canadese Donald Hebb affermò che le leggi del condizionamento classico

erano delle proprietà di funzionamento dei singoli neuroni. In sostanza egli sosteneva che se due

neuroni collegati fra di loro fossero stati attivi contemporaneamente, l’efficacia sinaptica della

connessione sarebbe stata automaticamente rinforzata. Questo avrebbe comportato che, ogni volta

che uno dei due neuroni fosse stato attivato, anche l’altro neurone sarebbe stato attivato. La regola

di Hebb può essere facilmente applicata ad una rete neurale artificiale, ove i pesi delle connessioni

sinaptiche abbiano valore iniziale 0, e l’output delle unità sia dato da una funzione «a gradino»

(l’unità è attiva se la somma algebrica dei segnali di ingresso è maggiore di zero e rimane inattiva se

tale somma è minore o uguale a zero). Alcune modifiche a questa regola sono state proposte

successivamente da diversi autori, ma esse vengono tutte tradizionalmente definite regole di Hebb

in quanto la modifica dei valori sinaptici dipende da due variabili:

1) lo stato di attivazione dell’unità presinaptica (l’unità che manda il segnale);

2) lo stato di attivazione dell’unità postsinaptica (l’unità ricevente).

Nella regola postsinaptica, anche detta regola di Stent- Singer (dal nome degli Autori che ne hanno

dimostrato la plausibilità biologica; vedi Stent, 1973 e Singer, 1987), il valore della connessione

viene incrementato ogni volta che l’unità post-sinaptica e l’unità presinaptica sono entrambe attive,

ma viene decrementato ogni volta che l’unità postsinaptica è attiva e quella presinaptica è inattiva.

Nella regola presinaptica, invece, il valore del peso sinaptico viene incrementato quando sia l’unità

presinaptica che quella postsinaptica sono attive, ma viene decrementato quando l’unità presinaptica

è attiva e quella postsinaptica è inattiva. Queste regole possono essere applicate a due tipi di reti

neurali: le reti autoassociative e le reti associative. Le reti autoassociative sono reti che ricevono un

pattern o stimolo in ingresso e sono in grado di conservarlo e riprodurlo in uscita. Le reti associative

associano pattern di input con pattern di output.

10

MODELLI DI NEURONI

Come detto precedentemente, un neurone “tipico” possiede un soma (corpo cellulare), diversi

dendriti e un assone. I potenziali d’azione (spikes) hanno origine nel segmento di assone prossimo

al corpo cellulare (cono di emergenza) e si propagano lungo l’assone.

In diversi neuroni la membrana del soma ha la capacità di generare potenziali d’azione, ma la

tensione (voltaggio) di soglia che deve essere raggiunta è molto più elevata di quella necessaria per

il collo di emergenza, dove è presente all’interno della membrana una concentrazione elevata di

canali Na+ sensibili al voltaggio.

I dendriti non sono tipicamente in grado di generare potenziali d’azione, anche se sono state

osservate alcune eccezioni. Nei motoneuroni e negli interneuroni i segnali in ingresso arrivano in

forma di correnti ioniche iniettate nei dendriti e nel soma attraverso sinapsi in comune con i

terminali assonici di altri neuroni. I neuroni sensoriali ricevono i segnali in ingresso di natura fisica

e/o chimica dall’ambiente (interno o esterno al corpo) che si traducono ancora in flussi ionici.

Diverse porzioni della membrana del soma e dei dendriti ricevono correnti in ingresso che vengono

integrate (attraverso processi spazio-temporali non ancora ben chiariti); il risultato consiste nella

variazione del potenziale di membrana del soma e dell’assone nel tempo. Se la variazione di

potenziale è appropriata sia in termini di polarità che di intensità (e durata) allora viene superata la

soglia per la generazione del potenziale d’azione che è quindi propagato all’interno dell’assone.

Infine il segnale è trasmesso dal terminale assonico alla cellula bersaglio. In conclusione,

avvengono quattro fenomeni di comunicazione (ingresso, integrazione, generazione e conduzione,

secrezione (nel caso di sinapsi chimiche)).

11

Di seguito, sono riportati tre esempi di modelli di neuroni:

-

il percettrone, modello molto semplicistico di neurone che è però fondamenta delle

reti neurali artificiali oggi più diffuse;

-

il modello di Huxley, storicamente più rinomato, è quello che modella meglio le

caratteristiche biologiche della membrana cellulare. Malgrado la sua validità,

presenta una alta complessità computazionale che lo rende inutilizzabile nel caso di

reti neurali artificiali.

-

Il modello di Izhikevich (2003), grande recente risorsa in quanto modella

perfettamente ogni tipo di neurone con una complessità di calcolo molto bassa (13

FLOPS); esso si basa sulla definizione di alcuni parametri dipendenti dalle

caratteristiche del segnale d’uscita, o da parametri più biologicamente inspirati se si

tratta del modello di Izhikevich generalizzato.

-

Il modello di Izhikevich generalizzato, derivante dal precedente modello con

parametri che si collegano più a proprietà biologiche.

12

PERCETTRONE

Il percettrone (Rosenblatt, 1962; Minsky e Papert, 1969), coincidente con il neurone formale

(fig.11) nel caso in cui la funzione di uscita è un gradino, è il tipo più semplice di rete neurale;

presenta due strati di unità, uno di input e uno di output con unità a soglia a gradino ove ciascuna

unità di ingresso è connessa con ciascuna unità di uscita. Questo tipo di rete neurale, che può essere

usata per compiti associativi o eteroassociativi, è stata molto studiata. Si può dimostrare

analiticamente che questo tipo di modello è in grado di trovare la configurazione di pesi sinaptici in

grado di produrre le risposte desiderate per ciascuno stimolo a patto che una tale configurazione di

pesi sinaptici esista e che gli stimoli in ingresso siano linearmente separabili (cioè se è possibile

dividerli tracciando una linea o un piano nello spazio in cui essi sono distribuiti; si veda Minsky e

Papert, 1969). Per ovviare a questo, è possibile usare funzioni di uscita non lineari o insiemi di

percettroni multistrato.

Figura 11: Neurone formale

Il percettrone, può essere addestrato a riconoscere se un pttern in ingresso appertenga o no af una

determinata classe.

Il valore ottimo dei pesi è dato, attraverso un apprendimento supervisionato,dalla seguente legge:

Wk+1= Wk + ∆ Wk

Dove k sono le epoche di apprendimento e ∆ Wk è la variazione di peso imposta.

13

Esistono vari algoritmi di apprendimento che permettono di ricavare una funzione per ∆ Wk; le più

usate sono:

-

Apprendimento Hebbiano: ∆ Wk = η Xk tk dove η è uno scalare (Lerning rate), X

vettore di ingresso e t vettore uscite desiderate.

-

Regola Delta: ∆ Wk = η Xk δk dove δk = (yk - tk); i termini coincidono con quelli

dell’apprendimento hebbiano con l’aggiunta del vettore “y” delle uscite reali;

Il percettrone multistrato o rete multilivello, è costituita da un’insieme di percettroni organizzati in

strati (vedi fig. 10). Tutti i neuroni di uno strato sono connessi con quelli dello strato successivo e

non vi sono connessioni tra neuroni dello stesso strato o strati non adiacenti.

MODELLO DI HUXLEY

Questo modello è quello storicamente più usato per modellare la membrana neuronale, dato che si

basa su parametri elettrici biologicamente inspirati.

Lo schema circuitale (fig.12) si basa infatti su conduttanze variabili legate alla proprietà della

membrana di essere più o meno permeabile agli ioni coinvolti nella genesi del potenziale d’azione.

Figura 12: Modello di Huxley per la membrana assonale

14

La capacità tiene conto dell’accumolo di carica ai lati della membrana, mentre i generatori Vx

tengono conto dei potenziali di riposo dei vari ioni.

Risolvendo il circuito, si ottiene la seguente equazione differenziale:

In questa equazione, le conduttanze dei vari ioni variano con andamenti piuttosto complessi e

soprattutto di alto peso computazionale. Malgrado sia biologicamente inspirato quindi, questo non è

mai usato per la realizazione di grandi reti dato che per 1 ms di simulazione occorono più di 1200

FLOPS.

Più in dettaglio, le equazioni di Hodgkim e Huxley (H-H) seguenti descrivono la generazione:

1.1

con le seguenti relazioni

1.2

dove

15

1.3

La propagazione è descritta da:

1.4

I fenomeni di ingresso e integrazione sono considerati nel termine corrente Iext. Vedremo fra poco

come rappresentare i fenomeni di secrezione.

MODELLO DI IZHIKEVICH

E’ il modello più recente e più efficente dal punto di vista computazionale inquanto riesce a

simulare qualsiasi tipo di neurone in soli 13 FLOPS.

Le equazioni del modello sono le seguenti:

d v/d t= 0.04 v2 + 5 v + 140 - u + I

d u/d t= a (b v - u)

Con le condizioni ausiliarie di reset dopo uno spike:

se v >= 30mV allora v c e u u + d

16

La variabile v è il potenziale di membrana del neurone mentre u è una variabile di recupero che

tiene conto dell’attivazione delle correnti ioniche di K+ e della inattivazione delle correnti di Na+,

realizza inoltre un feedback negativo sulla variabile v. Quando avviene uno spike (ovvero v supera

il valore di soglia di 30mV ) il potenziale di membrana viene riportato al suo valore di reset c

mentre la variabile u viene aumentata di d. La variabile I tiene invece conto delle correnti sinaptiche

e di eventuali input esterni (ad esempio segnali provenienti dal talamo o da altre regioni della

corteccia). Il termine 0.04 v2 +5 v+140 `e stato ottenuto fittando la dinamica dei neuroni della

corteccia in modo che la variabile v vari sulla scala dei mV e i tempi sulla scala dei ms; nel modello

le variabili v e u e i parametri (a, b, c, d) sono introdotti come quantità adimensionali. Come accade

nei neuroni reali, nel modello di Izhikevich non esiste un valore di soglia fisso, esso dipende dalla

storia del potenziale di membrana v prima dello spike e varia tra -55mV e -60mV . Il valore del

potenziale di riposo dipende invece dal valore del parametro b e varia tra -70mV e -60mV . Gli altri

parametri hanno significati diversi:

-

Il parametro a indica il tempo caratteristico della variabile di recupero u, tanto più

piccolo è a tanto più lenta è la variabile u. Un valore tipico per il parametro a è 0.02.

-

Il parametro b descrive la sensibilità della variabile di recupero u alle fluttuazioni

sottosoglia del potenziale di memebrana v. In pratica se b cresce aumenta

l’accoppiamento tre u e v e si abbassa il potenziale di soglia. Un valore tipico per il

parametro b è 0.2

-

Il parametro c indica semplicemente il valore che acquisisce immediatamente dopo

uno spike il potenziale di membrana v è vale tipicamente -65mV .

-

Il parametro d regola il valore post-spike della variabile di recupero. Tipicamente

d = 2.

Tutti i neuroni (eccitatori ed inibitori) della corteccia cerebrale dei mammiferi possono essere divisi

in diverse classi in base ai pattern di spiking e bursting osservati tramite misurazioni intracellulari.

I neuroni eccitatori si dvidono in quattro classi (fig. 13):

-

Neuroni RS (regular spiking). I neuroni RS sono i più comuni nella corteccia

celebrale. Quando vengono eccitati da uno stimolo esterno prolungato (ad esempio

un corrente di input I a gradino, gli RS sparano dapprima alcuni impulsi con un

breve intervallo tra un impulso e l’altro e, successivamente, tale intervallo aumenta.

Tali neuroni mostrano quindi un comportamento del tipo “adattamento in

frequenza”. Aumentando l’intensità della corrente dc iniettata la frequenza di spiking

aumenta, anche se non può superare una certa soglia a causa del valore non nullo del

17

tempo di iperpolarizzazione della membrana. Nel modello di Izhikevich un tale

comportamento si ottiene per c = -65mV (bassi valori del potenziale di reset) e d = 8.

-

Neuroni IB (intrinsically bursting). I neuroni IB eccitati da uno stimolo prolungato

(come esempio prendiamo sempre una corrente a gradino) emettono prima un burst

di impulsi e, successivamente, impulsi isolati. Nel modello in considerazione questo

corrisponde a c = -55mV (alti potenzaili di reset) e d = 4.

-

Neuroni CH (chattering). I neuroni CH emettono invece burst ripetuti con una

frequenza che può arrivare anche fino a 40Hz. Nel modello questo comportamento

corrisponde a c = -50mV e d = 2 .

I neuroni inibitori si dividono principalmente in due classi:

-

Neuroni FS (fast spiking). I neuroni FS emettono tipicamente treni di impulsi con

una frequenza elevata e senza alcun tipo di adattemento. Nel modello questo

comportamento si ottiene per a = 0.2 (recupero veloce).

-

Neuroni LTS (low-threshold spiking). I neuroni LTS possono emettere, così come i

neuroni FS, treni di impulsi ma, diversamente da quest’ultimi, presentano un

notevole adattamento in frequenza. Gli FTS possiedono inoltre un basso potenziale

di soglia, il che si ottiene nel modello prendendo un valore di b pari a circa 0.25.

Il modello di Izhievich può riprodurre inoltre il comportamento dei neuroni talamo-corticali. Questi

neuroni sono i principali artefici degli input che stimolano l’attività dei neuroni della corteccia

celebrale.

-

Neuroni TC (thalamo-cortical );

-

Neuroni RTN (Reticular thalamic nucleus);

-

Neuroni TI (Thalamic interneurons).

18

Figura 13: Modello di Izhikevich e simulazione di alcuni tipi di neuroni

MODELLO DI IZHIKEVICH GENERALIZZATO

E’ possibile adattare il modello di Izhikevich con un modello molto simile, che presenta però un

insieme di parametri più biologicamente inspirati. Esso è noto in letteratura come modello di

Izhikevich generalizzato.

19

Figura 14: Panoramica del modello di Izhikevich generalizzato

DAL MODELLO DI MORRIS-LECAR AL MODELLO INTEGRATEAND-FIRE

In maniera piuttosto sommaria, vista la varietà e complessità delle cellule neuronali, si può

affermare che un singolo potenziale d’azione è di fatto la risposta stereotipa di un neurone a

qualunque stimolo di “forza” sufficiente a superare una soglia critica. In altre parole, un potenziale

d’azione è una soluzione efficace per propagare lungo il tessuto nervoso l’informazione che uno

stimolo, o meglio, l’integrazione di più stimoli al di sopra di una soglia hanno portato al neurone.

Ora la chiave fondamentale dell’informazione consiste nella sua codifica che, per il neurone, risiede

nel quante volte nell’unità di tempo (spikes/sec) questa soglia sia stata superata, piuttosto che nella

forma nell’andamento temporale del potenziale d’azione stesso. Questa affermazione sposta lo

studio del contenuto informativo degli scambi neuronali dalla caratterizzazione dettagliata del

singolo potenziale d’azione allo studio dei meccanismi che governano le sequenze degli spikes di

una rete di neuroni connessi fra loro.

A questo scopo vedremo come si renda necessario considerare modelli di neuroni la cui struttura

matematica risulti semplificata rispetto al modello (H-H).

Molti modelli sono stati sviluppati negli anni in questo senso e ne verrà data una panoramica nel

proseguo. Per ora facciamo riferimento ad uno in particolare, il modello di Morris- Lecar che ci

20

condurrà a quello che è attualmente “il neurone formale” più utilizzato per lo sviluppo di reti neurali

formali, cioè il “neurone integrate and fire”.

Sebbene il modello Morris-Lecar sia stato originariamente concepito per la fibra muscolare gigante

di un crostaceo marino, l’evoluzione temporale del potenziale di membrana da esso derivato

rappresenta piuttosto bene molti altri sistemi eccitabili. Il modello è descritto dalle seguenti

equazioni (si noti che non viene considerato come si fa in H-H lo ione Na+ , ma lo ione Ca++ che

gioca un ruolo fondamentale nell’eccitazione della fibra muscolare):

1.5

1.6

1.7

dove ECl, ECa, Ek sono i potenziali di equilibrio di Nerst per i rispettivi ioni.

I parametri λm, λn, M∞ e N∞ sono dati dalle seguenti equazioni:

1.8 a

18.b

1.9 a

21

1.9 b

Dove V1 =-1mV; V2 = 15 mV; V3 = 10 mV; V4 = 14,5 mV

In Fig. viene riportato l’andamento oscillatorio periodico del potenziale di membrana V causato da

una opportuna corrente di stimolazione

Il modello di Morris –Lecar può essere ulteriormente semplificato assumendo una dinamica

“istantanea” per la variabile m che può essere assunta avere il suo valore di equilibrio M∞,

riducendo l’eq 1.5. a:

1.10

È opportuno riassumere le caratteristiche principali di questo modello: le proprietà di integrazione

della membrana sono descritte dall’eq.1.10 che tiene in conto il termine capacitivo di membrana.

I fenomeni di refrattarietà e di generazione del potenziale di azione sono considerati nell’eq. 1.7.

Non sono possibili ulteriori semplificazioni se si desidera rappresnetare i tre fenomeni detti in

precedenza (integrazione, refrattarietà e forma del potenziale d’azione). È invece possibile

semplificare ulteriormente il modello se non si considera importante avere una rappresentazione

fedele dell’andamento temporale del potenziale d’azione.

22

Si può preservare la struttura dell’eq 1.5, ma fissare il valore del potenziale di membrana al suo

valore di riposo ogni qualvolta viene superato un valore di soglia del potenziale (Vth).

Si ha quindi

1.11

Queste due equazioni descrivono una classe di neuroni formali noti come “neuroni integrate-andfire” (I-F), che costituiscono uno strumento potente nel campo delle reti neurali.

I neuroni I-F sono dispositivi a soglia, quindi non-lineari, che si resettano istantaneamente al loro

potenziale di riposo Vm ogni volta che Iext raggiunge un valore appropriato.

Al fine di una descrizione completa dobbiamo considerare in dettaglio il termine Iext in relazione

alla sua generazione e ai suoi effetti sul potenziale di membrana.

Per fare ciò dobbiamo fornire una descrizione quantitativa delle sinapsi chimiche.

v′ = Ι + a − bv

se v ≥ vthresold

allora v ← c

Il modello è molto semplice, i parametri sono determinati sperimentalmente, quando il potenziale di

membrana raggiunge il valore soglia il neurone fa uno spike e viene resettato al valore c .

Questo modello riesce a mimare solo un comportamento del neurone,

ma è molto usato perché è notevolmente economico: solo 5

quello dello spike singolo,

FLOPS

per mimare 1ms di

comportamento.

MODELLI SINAPTICI

Questo paragrafo si pone l’obiettivo di rispondere separatamente a due domande:

-

come funzionano le sinapsi chimiche e come possono essere modellizzate;

23

-

come le cellule circostanti modificano l’ambiente di uno specifico neurone e, in particolare,

il suo potenziale di membrana.

SINAPSI CHIMICHE

I segnali neuronali sono trasmessi, in via indiretta, da una cellula presinaptica ad una postsinaptica

attraverso strutture specializzate di contatto che vengono chiamate sinapsi. Le due celle sono di

norma separate da una stretta (20-30 nm) regione contenente fluido extracellulare che viene

chiamata “vallo sinaptico”.

Quando un potenziale di azione si propaga lungo l’assone della cellula presinaptica, i canali del

Ca++ consentono agli ioni Ca++ di fluire dal mezzo extracellulare nel terminale della cellula

presinaptica attraverso il vallo sinaptico. Questi ioni attivano meccanismi cellulari che culminano

nel rilascio di molecole messaggere, note come neurotrasmettitori, che erano contenute nelle

vescicole sinaptiche.

I neurotrasmettitori diffondono attraverso il vallo e si legano a canali ionici presenti sulla membrana

prospiciente del neurone postsinaptico. L’intero processo è di breve durata (circa 1 ms).

Successivamente il neurotrasmettitore è rapidamente rimosso per via enzimatica. L’intero evento si

è quindi localizzato nello spazio e nel tempo in una porzione di membrana che può appartenere a un

dendrite, al soma di un neurone o a una cellula muscolare o endocrina.

Come risultato del legame col neurotrasmettitore i canali ionici postsinaptici si aprono e i relativi

flussi ionici causano variazioni del potenziale di membrana le cui intensità variano in funzione della

quantità di neurotrasmettitore rilasciato e della sua persistenza a livello postsinaptico. Se la

variazione è di tipo depolarizzante, si può generare un potenziale d’azione.

Naturalmente le variazioni di potenziale di membrana possono essere depolarizzanti o

iperpolarizzanti a seconda del segno delle correnti ioniche complessivamente attivate. Le sinapsi

che risultano in una depolarizzazione eventuale del neurone postsinaptico sono dette eccitatorie,

mentre quelle producenti iperpolarizzazione sono dette inibitorie. Alcuni neurotrasmettitori, fra i

quali l’acetilcolina che opera a livello di giunzione neuromuscolare, hanno recettori (canali

attivabili) sulla membrana della cella postsinaptica che hanno bassa selettività fra i cationi. Quindi,

contributi relativi dei diversi cationi alla corrente complessiva transmembrana dipendono

principalmente dalla loro concentrazione e dal loro gradiente elettrochimico.

Per esempio, in condizioni fisiologiche, i recettori di acetilcolina alla giunzione neuromuscolare

causano un flusso di vari ioni Na+ (fino a 30.000 ioni per canale al secondo) con conseguente

depolarizzazione della cellula muscolare (postsinaptica).

24

Vediamo ora una possibile modellizzazione matematica di una sinapsi chimica partendo dalla

descrizione cinetica:

1.13

dove R, TR*e T rappresentano rispettivamente la forma non-legata, la forma legata del recettore

postsinaptico e il neurotrasmettitore; α e β sono le costanti cinetiche della reazione nei due versi.

Se si assume che la concentrazione totale del recettore postsinaptico sia costante e valga [ A ] si ha:

1.14

Si può quindi definire la frazione r di recettori legati (che riflette quella di canali aperti) come

1.15

L’evoluzione temporale di r è data da:

1.16

dove [ T ] è la concentrazione del trasmettitore.

Assumiamo ora che [ T ] abbia l’andamento temporale di un impulso rettangolare, cioè:

1.17

dove u (t) è la funzione gradino e Δt = t1-t0 la durata dell’impulso di rilascio.

La soluzione analitica dell’eq. (1.16) è

25

1.18

dove

1.19

e

1.20

Se il legame del trasmettitore al recettore postsinaptico causa direttamente l’apertura di un canale

ionico, allora la conduttanza G(t) di tutti i canali è data da

1.21

dove g- syn è la conduttanza massima della sinapsi.

La corrente sinaptica che origina da questo processo è

1.22

26

dove V è il potenziale di membrana della cellula postsinaptica e Esyn è il potenziale sinaptico di

inversione il cui significato sarà meglio chiarito nel seguito.

1.23

dove α e β sono ancora le costanti cinetiche, Gsat è il valore è il valore di saturazione della

conduttanza G, δ(t- t0) è la funzione Dirac , e Q δ (t-t0) è la quantità di neurotrasmettitore rilasciata

al tempo t. Se ulteriormente assumiamo che il tempo di salita della conduttanza in risposta a uno

spike sia sufficientemente breve, allora possiamo assumere una dinamica lineare del primo ordine,

cioè:

1.24

dove

1.25

E(t) rappresenta lo spike in ingresso che attiva G(t).

Il parametro W (che ha la dimensione di un tempo) è stato introdotto per dar conto dell’efficacia

della sinapsi nel trasformare gli spikes in arrivo in variazioni di conduttanza. La quantità τG è la

costante di tempo del rilassamento esponenziale di G(t) in assenza di input dall’esterno.

Nel caso di un singolo spike presinaptico, l’eq (1.24) diventa:

1.26

27

Considerando ancora la dinamica temporale di G(t) come istantanea, l’eq. (1.26) si riduce a

1.27

L’eq. (1.27) può essere inserita in quella del neurone integrate-and-fire postsinaptico, ottenendo

1.28

dove

Cm = capacità di membrana

Gm = conduttanza di membrana

Vrev = potenziale di inversione (una costante che semplifica drasticamente il termine

(Esyn – V).

Infine, se riduciamo il potenziale di membrana …(t) ad una variabile adimensionale

1.29

l’eq. (1.28) diventa

1.30

dove

28

1.31

L’eq. (1.30) costituisce il modello classico di neurone formale che viene utilizzato nelle reti neurali.

Un ultimo chiarimento riguarda il significato del potenziale di inversione che è stato introdotto in

precedenza. A questo scopo entriamo in un qualche dettaglio sui meccanismi ionici operanti e sulle

conseguenti variazioni di potenziale. Come si è detto i potenziali eccitatori postsinaptici (EPSP)

depolarizzano la membrana fino a un potenziale di circa – 10 mV, dopo di che gli EPSP diventano

iperpolarizzanti. Il potenziale di membrana che corrisponde a questo effetto(da dep. a iper) è noto

come potenziale di inversione (Esyn).

Siccome nessuno degli ioni presenti tipicamente nel neurone ha un potenziale di equilibrio di 10mV, è ragionevole assumere che sia Na+ che K+ contribuiscano a questo tipo di risposta. Quando

il potenziale di membrana ha un valore più negativo di -10 mV (quindi più vicino al potenziale di

equilibrio di K+), più ioni Na+ entrano nella cellula rispetto agli ioni K+ che ne escono con

conseguente depolarizzazione.

Quando il potenziale di membrana è maggiore di -10mV (più vicino al potenziale di equilibrio di

Na+), più ioni K+ lasciano la cellula rispetto agli ioni Na+ che vi entrano, con conseguente

iperpolarizzazione.

Quando il potenziale di membrana è di -10 mV i flussi dei due ioni sono in equilibrio dinamico e

non si hanno variazioni di potenziale. Questo è il potenziale di inversione.

I potenziali inibitori postsinaptici (IPSP) hanno potenziali di inversione dell’ordine di -70 mV o

anche più negativi, il che suggerisce un ruolo determinante degli ioni Cl- e K+.

29

IL DIALOGO TRA NEURONI ED ASTROCITI

2.1 STORIA DI UNA SCOPERTA

Quando nel 1955 fu eseguita l’autopsia sul corpo di Albert Einstein, il suo cervello fu

analizzato alla ricerca delle tracce del suo genio.

Nessuna anomalia fu riscontrata nel numero e nelle dimensioni dei suoi neuroni.

Sorprendentemente però le aree associative, sede delle attività intellettive di ordine

superiore, presentavano un numero di cellule gliali molto superiore alla norma (22).

Da quel momento gli scienziati sospettarono un coinvolgimento della glia

nell’elaborazione dell’informazione, ed iniziarono a cercarne prove sperimentali.

L’esito di tali ricerche fu però infruttuoso, poichè furono inseguite evidenze di una

comunicazione elettrica delle cellule gliali: i ricercatori credevano che, come i neuroni,

la glia generasse potenziali d’azione, determinando il rilascio di neurotrasmettitori a

livello sinaptico.

La strada corretta verso l’identificazione della comunicazione astrocitaria fu imboccata

a metà degli anni ’90, quando i neuroscienziati individuarono la presenza sulle

membrane gliali di numerosi recettori per sostanze chimiche, inclusi alcuni

neurotrasmettitori.

30

Ciò suggerì la natura chimica del linguaggio astrocitario: gli stessi neurotrasmettitori

rilasciati dalle sinapsi neuronali possono evocare una risposta astrocitaria.

I primi studi indicarono come l’ingresso di calcio nelle cellule gliali fosse un segno

della loro avvenuta stimolazione.

Il calcium imaging, tecnica elaborata appositamente per analizzare le variazioni nella

concentrazione citoplasmatica del calcio, confermò la risposta delle cellule di Schwann

della giunzione neuromuscolare al firing neuronale.

Un classico studio del 1990, svolto dal gruppo di Stephen J. Smith, si avvalse del

calcium imaging per mostrare l’improvviso incremento della [Ca++]i (concentrazione

intracellulare di calcio) in un astrocita in seguito alla stimolazione con glutammato. Le

onde Ca++ si diffondevano rapidamente anche a tutti gli altri astrociti presenti in

coltura.

Alcuni neuroscienziati si domandarono se la comunicazione avvenisse tramite ioni

calcio, oppure fosse correlata al passaggio di molecole attraverso canali di

comunicazione tra gli astrociti (gap junctions).

A questo proposito, nel 1996, S. Ben Kater ed i suoi colleghi dimostrarono che la

comunicazione doveva essere mediata da molecole di segnalazione, e non

semplicemente da canali intercellulari: utilizzando un microelettrodo incisero una linea

in uno strato di astrociti in coltura, creando un varco privo di cellule, ma la stimolazione

delle onde calcio da un lato della barriera si diffuse senza difficoltà agli astrociti

dell’altro settore.

Ad oggi è stato dimostrato che risposte calcio mediate possono essere indotte negli

astrociti aggiungendo in coltura neurotrasmettitori, oppure stimolando mediante

elettrodi il rilascio del neurotrasmettitore dalle sinapsi.

2.2 STIMOLAZIONE CHIMICA DI NEURONI ED ASTROCITI

Le scariche neuronali sono tradotte dagli astrociti in onde Ca++ : la frequenza di tali

oscillazioni codifica il livello di attività sinaptica. Negli astrociti l’elevazione della

31

[Ca++]i ha un probabile ruolo di regolazione sulla glicogenolisi e sulla sintesi e/o il

rilascio di acido arachidonico, neurotrasmettitori e neurotropine.

Esperimenti condotti su fette sottili di tessuto cerebrale (regione CA1 dell’ippocampo e

corteccia visiva) mostrano la precisa correlazione esistente tra attività neuronale ed

astrocitaria (10).

Per seguire a livello delle singole cellule le variazioni della [Ca++]i sono stati impiegati

un microscopio confocale a fluorescenza e l’indicatore fluorescente di Ca++ indo-1. Le

diverse concentrazioni di Ca++ sono espresse tramite valori del rapporto di emissione

dell’indo-1 a 405 e 485 nm.

Le fette sottili di tessuto nervoso sono state stimolate, subito dopo l’isolamento, con 5

µM di t-ACPD (1-aminocyclopentane-trans-1,3-dicarboxylic acid), un agonista del

recettore metabotropo del glutammato (mGluR).

2.1 Serie temporale di immagini a pseudocolori dei cambiamenti della [Ca++]i in cellule provenienti dalla

regione CA1 dell’ippocampo, colorate con indo-1, dopo perfusione della fetta con t-ACPD 5 µM. Le

cellule etichettate con i numeri 1 e 2 sono astrociti, mentre quelle indicate come 3 e 4 sono neuroni

piramidali.

32

Piccole cellule identificate come astrociti presentano oscillazioni periodiche, mentre i

neuroni piramidali mostrano un singolo picco di variazione della concentrazione di

Ca++.

Nel campo considerato è stata osservata anche una risposta ritardata in sei altri neuroni.

2.2 Cinetica delle variazioni della [Ca++]i nelle cellule indicate precedentemente con i numeri 1-4 dopo

stimolazione con t-ACPD e KCl.

In esperimenti su tessuti provenienti sia dall’ippocampo che dalla corteccia visiva è

stato testato l’effetto di concentrazioni di t-ACPD superiori a 10 µM.

Per concentrazioni comprese tra 50 e 100 µM diminuisce la probabilità di osservare

oscillazione della [Ca++]i , e la maggior parte delle cellule mostra un’ascesa della

[Ca++]i seguita da un plateau che poi discende lentamente.

Ciò suggerisce una stretta dipendenza delle oscillazioni dalla concentrazione di tACPD.

Per studiare in che modo le oscillazioni astrocitarie siano modulate dall’attività

sinaptica, Pasti et al. hanno analizzato la risposta degli astrociti ad un treno di impulsi,

applicati inizialmente a bassa frequenza (0.1-0.2 Hz) e bassa intensità (50-100 pA),

quindi a frequenze maggiori (0.3-1 Hz) oppure ad intensità più elevata (200-500 pA).

In entrambi i casi è stato osservato un netto aumento della frequenza delle oscillazioni

astrocitarie (10).

33

L’aumento della frequenza dello stimolo elettrico determina un maggiore tasso di firing

delle fibre afferenti, mentre l’incremento di intensità della corrente iniettata può portare

al reclutamento di fibre addizionali, che inizialmente non erano state stimolate.

2.6 Modulazione dipendente dall’attività neuronale della frequenza delle oscillazioni della [Ca++]i negli

astrociti. A Oscillazioni di un astrocita (linea spessa) dopo stimolazione neuronale. La frequenza delle

oscillazioni astrocitarie cresce rapidamente dopo il cambiamento della frequenza di stimolazione da 0.2 a

1 Hz. Il grafico riporta anche la risposta di un neurone adiacente (linea sottile). L’istogramma riporta la

frequenza di oscillazione media, su di una base di 10 astrociti, in entrambe le fasi di stimolazione.

B Oscillazioni della [Ca++]i di un astrocita (linea spessa) dopo stimolazione neuronale ad 1 Hz. La

frequenza delle oscillazioni aumenta velocemente quando l’intensità dello stimolo passa da 100 a 200 pA.

La linea sottile mostra l’incremento della [Ca++]i in un adiacente neurone. L’istogramma riporta la

frequenza media delle oscillazioni registrate su 20 astrociti nella prima e seconda fase di stimolazione.

Tali cambiamenti si traducono probabilmente nell’ aumento della concentrazione di

glutammato nello spazio sinaptico e/o nell’attivazione di un maggior numero di

transienti localizzati della [Ca++]i lungo i processi astrocitari, cui consegue

un’elevazione della frequenza delle oscillazioni registrate.

I meccanismi precedentemente descritti forniscono la possibilità di un controllo delle

oscillazioni Ca++ dinamico ed altamente regolato, che consiste nell’integrazione dei

segnali chimici generati dalla comunicazione sinaptica.

2.5 RISPOSTA NEURONALE ALL’ATTIVITÀ ASTROCITARIA

34

Gli esperimenti descritti in seguito sono volti a dimostrare l’esistenza di una risposta

neuronale alle oscillazioni della concentrazione intracitoplasmatica di calcio negli

astrociti.

E’ stato osservato come, in aggiunta agli effetti registrati negli astrociti, t-ACPD induca

un singolo transiente, oppure oscillazioni della [Ca++]i, in un certo numero di neuroni

piramidali della zona CA1 dell’ippocampo (10).

Queste variazioni possono essere attribuite a diretta stimolazione dei mGluRs presenti

sui neuroni da parte del t-ACPD, oppure sia al rilascio da parte degli astrociti di

glutammato (su induzione del t-ACPD), neurotrasmettitore che attiverebbe i recettori

neuronali ionotropi per Glu (iGluRs), quali gli AMPAR e i NMDAR.

In accordo con questa seconda ipotesi, è stato osservato che astrociti in coltura possono

liberare glutammato ed eccitare neuroni adiacenti.

2.7 A Ripetuti aumenti della [Ca++]i in un neurone piramidale dell’ippocampo dopo tre stimolazioni

consecutive con t-ACPD 10 µM. Tale risposta viene abolita dalla presenza di NQBX/AP5 (perfusione per

10 minuti con NQBX/AP5, entrambi 50 µM). Prima della terza stimolazione con t-ACPD, la fetta è stata

perfusa per 20 minuti con normale soluzione salina. B Oscillazioni Ca++ in un astrocita adiacente al

neurone in A.

La figura precedente mostra le tipiche risposte oscillatorie di un neurone e un adiacente

astrocita in seguito all’applicazione di t-ACPD (10 µM).

Dopo la rimozione dell’agonista t-ACPD, la [Ca++]i ritorna ai livelli basali in entrambi i

tipi cellulari.

35

Una seconda applicazione di t-ACPD (10 µM) è stata condotta in presenza di NQBX e

D-AP5 (entrambi 50 µM), antagonisti specifici rispettivamente di AMPARs e

NMDARs.

In 14 dei 49 neuroni la risposta a t-ACPD è stata abolita completamente, ma è

ricomparsa in seguito al lavaggio degli antagonisti, indicando che l’eccitazione è

totalmente dipendente dall’attivazione dei recettori AMPA e NMDA.

Nei restanti 35 neuroni la reazione alla seconda stimolazione è risulatata notevolmente

ridotta, oppure è rimasta immutata, suggerendo che in questo caso l’elevazione della

[Ca++]i dopo stimolazione con t-ACPD sia da attribuire all’attivazione degli iGluRs

così come alla stimolazione diretta degli mGluRs espressi sulla membrana neuronale.

Complessivamente, l’elevazione della [Ca++]i indotta nei neuroni dalla seconda

stimolazione è risultata notevolmente ridotta. La risposta astrocitaria non ha subito

cambiamenti significativi.

2.8 Riduzione, in un neurone piramidale dell’ippocampo, dell’ampiezza dei picchi della [Ca++]i indotti

da stimolazione con t-ACPD ad opera di NQBX/AP5 (entrambi 50 µM), e ripristino della risposta iniziale

in seguito alla terza stimolazione, effettuata in assenza dei sopra citati bloccanti degli iGluRs dopo un

intervallo di tempo di 20 minuti.

E’ significativa l’assenza di riduzione della risposta dopo la seconda stimolazione di

una popolazione neuronale di controllo, trattata con t-ACPD ma non con gli antagonisti

degli iGluRs.

36

2.9 Variazione relativa nell’ampiezza di picchi della [Ca++]i in ciascun neurone dopo la seconda

stimolazione con t-ACPD, effettuata in assenza (controlli) o presenza di NQBX/AP5, in confronto con la

prima stimolazione. Il cambiamento medio nella risposta dei neuroni trattati con NQBX/AP5 è

significativamente diverso da quello dei neuroni di controllo.

Questi risultati indicano che l’aumento della nei neuroni può essere determinato,

totalmente o in parte, dal glutammato rilasciato in risposta al t-ACPD.

Per chiarire se tale glutammato provenga dalle fibre afferenti, dai neuroni oppure dagli

astrociti, fette sottili di tessuto nervoso sono state incubate con TeNT (100 µg/ml).

TeNT blocca in modo altamente specifico la secrezione di neurotrasmettitore da parte

dei neuroni. La sua azione si esplica sulla proteina della membrana associata alle

vescicole sinaptiche VAMP/sinaptobrevina, uno dei componenti dell’apparato di

neuroesocitosi. Probabilmente l’azione inibitoria è svolta a livello del riciclaggio delle

vescicole sinaptiche.

Sebbene VAMP/sinaptobrevina sia espressa in molti altri tipi cellulari oltre ad i neuroni,

l’assenza di effetti del TeNT sulle altre cellule deriva dall’assenza del recettore per la

neurotossina.

Nelle fette di tessuto nervoso trattato con TeNT gli effetti del t-ACPD non subiscono

variazioni: l’agonista provoca oscillazioni Ca++ negli astrociti e crescita della [Ca++]i

nei neuroni, così come avviene anche nei controlli.

La risposta neuronale al t-ACPD rimane la stessa, indipendentemente dalla presenza di

TeNT, anche in presenza di NQBX/D-AP5 suggerendo che siano gli astrociti a

rilasciare il glutammato che poi eccita i neuroni.

37

LE ONDE CALCIO

4.1

RUOLO DI COORDINAZIONE DELLE ONDE CALCIO

E’ opinione diffusa che le onde calcio intercellulari siano un mezzo di comunicazione a

distanza tra gruppi di cellule, allo scopo della coordinare la risposta multicellulare ad un

evento locale (11).

Le onde Ca++ sono state riscontrate non soltanto negli astrociti del SNC, ma anche in

altri distretti corporei, nonchè in organismi inferiori quali le amebe.

Nelle cellule ciliate dell’epitelio tracheale il movimento delle cilia aumenta al crescere

della concentrazione intracellulare di Ca++. Un’onda intercellulare di Ca++ potrebbe

coordinare il battito delle cilia di cellule adiacenti, con un conseguente aumento di

efficienza nella rimozione del muco.

4.1 Cilia vibratili in una micrografia elettronica a scansione dell’epitelio di trachea equina.

Nello studio della rimarginazione delle ferite, in seguito al danneggiamento meccanico

di un monostrato di cellule epiteliali è stata osservata un’onda Ca++ intercellulare, i cui

gradienti di concentrazione influenzano l’inizio e la direzione della migrazione

cellulare.

Onde Ca++ sono state osservate anche nel fegato: le oscillazioni intracellulari sono

coordinate su vaste aree, formando onde intercellulari coerenti che si propagano lungo i

piani epatici. Una regione pacemaker agisce come centro scatenante che dà inizio alla

propagazione.

38

4.2

ONDE CA++ INTRACELLULARI

Il meccanismo biochimico di formazione delle onde Ca++ ha inizio con il legame di un

agonista al proprio recettore di membrana (11).

Segue quindi una cascata di eventi intracellulari che conducono alla produzione del

mediatore chimico inositolo trifosfato (IP3).

IP3 diffonde nel citoplasma della cellula e si lega al proprio recettore, posto sulla

membrana del reticolo endoplasmatico (ER). Tale recettore è un canale per il Ca++

attivato da ligando: IP3 causa la liberazione di Ca++ dall’ER.

IP3

Ca

++

ER

4.2 IP3 scatena la liberazione di Ca++ dal reticolo endoplasmatico.

L’aumento della concentrazione di Ca++ così determinato scatena il rilascio di ulteriore

Ca++, nel processo autocatalitico chiamato Ca++-induced Ca++ release (CICR). Il

recettore endoplasmatico per IP3 possiede infatti siti di legame per Ca++, che mediano

il feedback positivo.

Ca++

IP3

Ca++

Ca++

4.3 Feedback positivo nel rilascio del Ca++ dall’ER.

Superata una concentrazione soglia, il Ca++ inattiva il recettore per IP3: le pompe per il

Ca++ segregano nuovamente lo ione all’interno del reticolo endoplasmatico, oppure lo

39

spingono all’esterno della cellula, sino al raggiungimento della concentrazione

intracellulare di riposo.

Modello matematico

Matthew Wilkins e James Sneyd, nel loro articolo Intercellular spiral waves of calcium

(1997), propongono un modello matematico per la descrizione delle onde Ca++

intracellulari.

Il modello era stato originariamente proposto da Atri et al. (1993) per rappresentare le

onde spirali di Ca++ osservate negli ovociti di Xenopus.

Il modello è descritto dalle seguenti equazioni:

∂ 2c ∂ 2c

∂c

= Dc 2 + 2 + J flux − J pump

∂t

∂y

∂x

k 22

dh

τh

=

−h

dt k 22 + c 2

dove

J pump =

γc

k γ + c'

(1 − b )c h

J flux = k f µ ( p ) b +

k1 + c

µ( p) =

p

k µ + p'

dove c = [Ca++] e p = [IP3].

La variazione della concentrazione di calcio nel tempo è dovuta alla diffusione (II legge

di Fick) ed ai termini Jpump e Jflux.

Jpump descrive il flusso di Ca++ che dal citoplasma viene pompato di nuovo nell’ER,

oppure all’esterno della membrana plasmatica.

Jflux descrive il flusso di Ca++ attraverso i canali-recettori per IP3.

40

µ ( p ) è la frazione di recettori che portano legato IP3: è una funzione crescente di p.

Il termine b +

(1 − b )c

k1 + c

controlla l’attivazione dei recettori per IP3 da parte del calcio:

Ca++ in un primo tempo attiva i recettori per IP3, ma in un secondo momento li

disattiva. Si assume che i siti di legame per Ca++ e per IP3 siano indipendenti.

h indica la frazione di recettori che non sono stati ancora disattivati dal Ca++. E’ una

funzione decrescente di c.

k f rappresenta il flusso di Ca++ quando tutti i recettori per IP3 sono aperti ed attivati.

Nello stato stazionario h =

k 22

. Si assume che l’inattivazione da parte del Ca++

k 22 + c 2

intervenga in ritardo con una costante temporale τ h .

I valori dei parametri sono stati ottenuti con misure sperimentali su vari tipi cellulari.

Non vi è motivo di ritenere che questi parametri siano validi anche per le cellule gliali,

ma il valore numerico non influenza qualitativamente i risultati del modello.

4.4 Valori dei parametri utilizzati per implementare il modello matematico di propagazione delle onde

Ca++.

Al variare di µ, frazione di recettori legati ad IP3, varia il comportamento del modello:

si osservano oscillazioni per µ ≅ 0.29, mentre si ha formazione di onde per valori di

µ inferiori ma prossimi a 0.29.

41

4.5 [Ca++] in relazione al parametro di biforcazione µ. La linea composta da cerchietti mostra il massimo

ed il minimo della [Ca++] durante le oscillazioni: i cerchietti pieni indicano oscillazioni stabili, quelli

vuoti oscillazioni instabili.

L’ampiezza di un fronte d’onda (10 µm) è tale da essere contenuta in una singola

cellula, la cui larghezza tipica è di 30 µm; l’intera onda coinvolge 2-3 cellule adiacenti.

All’interno di una singola cellula l’onda viaggia alla velocità di circa 7 µm/s.

4.6 Onda Ca++ in una singola cellula mostrata in due istanti successivi.

4.3

ONDE CA++ INTERCELLULARI

Onde intracellulari in sequenza generano onde intercellulari (11).

42

4.7 Onda piana intercellulare che si diffonde tra due cellule adiacenti.

L’onda Ca++, dopo aver viaggiato all’interno di una cellula, raggiunge il confine

intercellulare. Qui si arresta, finchè non sia penetrata nella cellula vicina una quantità di

calcio sufficiente a scatenare la generazione di una nuova onda.

Il flusso ionico attraverso la membrana cellulare viene assunto proporzionale alla

differenza di concentrazione della specie tra i due versanti della membrana.

(

)

(

)

[(

∂c 0 − , t

∂c 0 + , t

Dc

= Dc

= Fc c 0 + , t − c 0 − , t

∂x

∂x

) (

)]

Al diminuire di Fc, occorre un tempo maggiore perchè l’onda Ca++ possa essere

generata nella cellula adiacente; di conseguenza la velocità dell’onda intercellulare

diminuisce. Se Fc scende al di sotto di 0.3 µm/s cessa la propagazione dell’onda.

4.8 Velocità dell’onda Ca++ in funzione di Fc. □ simulazione normale ○ equazioni per tessuto

omogeneizzato.

Esistono due possibili spiegazioni al fatto che, per Fc < 3 µm/s, la [Ca++] non raggiunge

il valore soglia, rendendo impossibile la generazione dell’onda:

43

1.

la velocità con cui gli ioni Ca++ sono pompati fuori dalla cellula è maggiore della

velocità di diffusione;

2.

la parte posteriore dell’onda raggiunge la membrana prima che all’interno della

seconda cellula la [Ca++] abbia raggiunto il valore soglia.

Le equazioni del modello sono risolte in una matrice di 20x20 cellule, ciascuna di 30

µm di lato. Nella simulazione le equazioni sono discretizzate mediante una griglia

regolare, allineata con gli assi coordinati. Le frontiere tra le cellule giacciono sulle

congiungenti i punti di tale griglia.

Un’onda piana intercellulare è simulata ponendo la concentrazione di IP3 inizialmente

costante sull’intero dominio.

Per dare inizio alla propagazione dell’onda viene aggiunto Ca++ nella parte sinistra del

dominio.

Le equazioni precedentemente descritte possono originare anche onde spirali.

Per simulare questa seconda morfologia dell’onda Ca++, viene fatta propagare

attraverso il dominio un’onda piana. Quando questa ha percorso all’incirca metà del

dominio, una certa quantità di Ca++ (in forma di una linea) è aggiunta subito dietro alla

regione refrattaria dell’onda piana: la nuova onda non può propagarsi nella direzione

della prima, quindi si dirige dalla parte opposta. Mentre si muove, la parte terminale

della nuova onda inizia a ruotare su sé stessa, dando origine ad una spirale.

Per Fc = 0.5 µm/s le spirali sono stabili.

Se Fc = 0.4 µm/s un’onda spirale può formarsi ma non è stabile, e scompare in alcuni

minuti.

Se infine Fc = 0.3 µm, non è possibile la comparsa della spirale.

44

4.9 Formazione dell’onda spirale. a) t=40 sec b) t=57.2 sec c) t=65 sec d) t= 88 sec. In questa simulazione

Fc=1.1 µm/s.

Il valore di Fc stimato in esperimenti condotti sul fegato è prossimo a quello necessario

alla propagazione di un’onda intercellulare nel modello sopra descritto.

45

SINAPSI TRIPARTITA

La scoperta di Porter e McCarthy cambia drasticamente il pensiero corrente relativo al ruolo degli

astrociti. È oggi chiaro che gli astrociti sono elementi attivi del sistema di comunicazione

neurogliale e che possono modulare le dinamiche neuronali sia della sinapsi in cui sono coinvolti

che delle sinapsi lontane.

•

Quando avviene la sinapsi, il glutammato, primo messaggero, è rilasciato dal neurone presinaptico all’interno della fessura sinaptica che è limitata in parte dai recettori metabotropici

di glutammato (mGluR) dell’astrocita sinaptico.

•

Il glutammato si lega, in parte, a tali recettori metabotropici di glutammato.

•

L’IP3 agisce come un secondo messaggero ed è la chiave delle segnalazioni intracellulari di

calcio.

•

Una volta che il glutammato si lega all’astrocita, l’IP3 è rilasciato nello spazio intracellulare

dell’astrocita sinaptico.

•

L’IP3 si lega quindi ai recettori di IP3 posti sul reticolo endoplasmatico (RE) e Ca2+ è

rilasciato dal reticolo nel citoplasma.

•

Tale rilascio di Ca2+ si può manifestare nella forma di onde intracellulari di Ca2+.

•

L’onda di calcio si propaga quindi attraverso la membrana cellulare nello spazio

extracellulare agli astrociti adiacenti.

•

Negli astrociti adiacenti aumenta la concentrazione di calcio ed essi rilasciano glutammato

nello spazio extracellulare.

Il glutammato si propaga con l’onda di calcio extracellulare, e può modulare sinapsi vicine e

lontane con meccanismi eccitatori o inibitori.

46

Nella figura sono illustrati i processi sinaptici locali che coinvolgono il neurone pre-sinaptico, il

neurone post-sinaptico e l’astrocita sinaptico. Si parla quindi di sinapsi tripartita.

Sebbene ci siano numerose opinioni ed evidenze conformi relativamente al ruolo dell’IP3 come

messaggero, è ancora argomento attuale e controverso la funzione di messaggeri extracellulari

addizionali. È stato osservato che la propagazione di onde calcio generate da stimoli meccanici, è

sincronizzata con la diffusione extracellulare di un segnale di ATP (adenosina trifosfato); la

propagazione del segnale di ATP è inoltre rigenerativa: cellule che ricevono segnali esterni di ATP,

rispondono con un rilascio extracellulare di ATP.

Successive modellizzazioni matematiche potrebbero tener conto di messaggeri addizionali.

Comunicazioni di calcio intra-cellulari e inter-cellulari rappresentano uno dei metodi fondamentali

per la coordinazione ed il controllo delle cellule. Nell’ippocampo sono state osservate onde

intercellulari di calcio che si diffondono dalle cellule gliali ai neuroni e viceversa.

Le varie fasi del processo sono oggetto di numerose modellizzazioni matematiche.

Quando un neurone “spara” rilascia una quantità di neurotrasmettitore nella fessura sinaptica. Dopo

che il neurotrasmettitore si è legato ai recettori metabotropici di glutammato mGluR posti sulla

membrana astrocitaria, è stimolato il rilascio di IP3 intracellulare,

La produzione di IP3 intracellulare nell’astrocita è data da:

47

d [IP3 ]

1

[IP3 ]* − [IP3 ] + rIP3 Θ(v − 50mV )

=

dt

τ IP3

(

)

dove:

[IP3 ]* è la concentrazione di equilibrio dell’IP

rIP3

Θ

3

determina la produzione di IP3 in risposta ad un potenziale d’azione neuronale

è la funzione di Heaviside

La produzione di IP3 nello spazio intracellulare dell’astrocita sollecita il rilascio di Ca2+ accumulato

sul reticolo endoplasmatico.

Questo processo è stato modellizato accuratamente negli ultimi dieci anni.

La concentrazione di Ca2+ accumulato può cambiare a causa di vari tipi di flusso

[

]

d Ca 2+

= − J channel − J pump − J leak

dt

J channel

è il flusso di calcio dal reticolo endoplasmatico attraverso i canali di IP3

J pump

è il flusso di calcio pompato dallo spazio intracellulare nel reticolo endoplasmatico

J leak

è la perdita di flusso di flusso dal reticolo endoplasmatico nello spazio intracellulare

(

[

][

] [

J channel = J channel [IP3 ], q, Ca 2 + , Ca 2 + − Ca 2 +

48

] )

ER

dq

= α q (1 − q ) − β q q

dt

dove

q è la frazione di recettori attivi di IP3 , α q = α q [IP3 ] e β q = β q [Ca 2+ ] .

([ ] )

J pump = J pump Ca 2+

([

2

] [

J leak = J leak Ca 2 + − Ca 2 +

] )

ER

Per completare il modello, utilizziamo dati sperimentali per relazionare la concentrazione di Ca2+

nell’ambiente astrocitario ad una corrente addizionale nel neurone:

I astro = 2.11Θ(ln y ) ln y

[

Ca ]

y=

− 196.69

2+

nM

Una predizione sul modello dei dressed neurons è svolta utilizzando i seguenti valori osservati:

•

potenziale di membrana del neurone

•

concentrazione di Ca2+ nell’ambiente astrocitario

•

concentrazione di IP3

Nella figura è mostrata l’evoluzione nel tempo della concentrazione di IP3 e di Ca2+ nell’astrocita,

comparate con il potenziale di membrana neuronale.

Stimoliamo il neurone con una dc current data da Iext; la produzione di IP3 in risposta al potenziale

d’azione è rIP3 = 0.2 μM/sec.

49

Mentre il neurone è stimolato, la concentrazione di IP3 cresce ma non abbastanza da indurre

oscillazioni di calcio. Dopo un certo tempo t, la stimolazione cessa (freccia) e come conseguenza le

concentrazioni di IP3 e di Ca2+ decrescono ed il neurone cessa il firing.

Se la produzione di IP3 in risposta al potenziale d’azione rIP3 aumenta: rIP3 > 0.8 μM/sec, allora il

neurone può oscillare spontaneamente senza alcuno stimolo esterno.

Il neurone è stimolato per 10 sec (freccia): quando la concentrazione di IP3 incrementa, la

concentrazione di Ca2+ inizia ad oscillare.

Nel momento in cui cessa la stimolazione esterna del neurone, il feedback astrocitario è abbastanza

forte per mantenere l’oscillazione neuronale indefinitamente.

50

In accordo con le osservazioni, il modello proposto da Nadkarni e Jung, predice un aumento di Ca2+

astrocitario in risposta ad un incremento di rIP3 . Inoltre se il rateo di produzione di IP3 in risposta al

potenziale d’azione neuronale è abbastanza grande, allora il neurone in comunicazione con

l’astrocita può oscillare spontaneamente in assenza di stimolazione.

51