10/07/2012

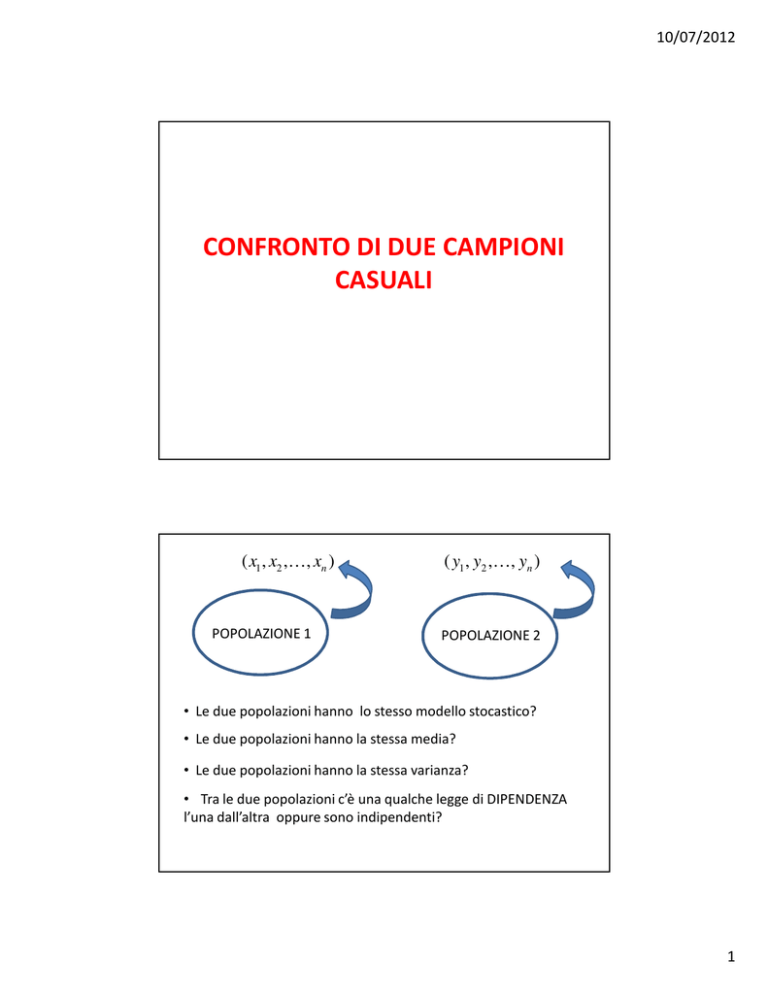

CONFRONTO DI DUE CAMPIONI

CASUALI

( x1 , x2 ,… , xn )

POPOLAZIONE 1

( y1 , y2 ,…, yn )

POPOLAZIONE 2

• Le due popolazioni hanno lo stesso modello stocastico?

• Le due popolazioni hanno la stessa media?

• Le due popolazioni hanno la stessa varianza?

• Tra le due popolazioni c’è una qualche legge di DIPENDENZA

l’una dall’altra oppure sono indipendenti?

1

10/07/2012

Esempio: La tabella riporta la lunghezza e la larghezza della conchiglia

di brachiopoli Composita.

LUNGHEZZA

LARGHEZZA

18.4

15.4

16.9

15.1

13.6

10.9

11.4

9.7

7.8

7.4

6.3

5.3

Scatter diagram (o diagramma di dispersione)

2

10/07/2012

CONSIDERAZIONI SULLO SCATTER DIAGRAM

Le correlazioni, possibilmente positiva o possibilmente, negativa si hanno quando i punti rappresentativi delle coppie di dati, pur disponendosi

attorno ad una delle due diagonali del diagramma, presentano una dispersione piuttosto accentuata tale da far presumere l’esistenza di altre

cause che intervengono a determinare l'effetto studiato.

http://www.taed.unifi.it/qualita/Diagrammi%20di%20correlazione.htm

3

10/07/2012

Come si misura il grado di “correlazione” tra due campioni casuali?

Il coefficiente di correlazione è una misura del grado di linearità della

distribuzione dei punti nel diagramma x-y.

SOMMA CORRETTA DEI PRODOTTI

n

SCP = ∑ ( xi − x )( yi − y )

i =1

Dipende da n

COVARIANZA

COV =

SCP

n −1

Dipende dalle unità di misura

CORRELAZIONE DI PEARSON

rxy =

COV

Sx S y

Misura adimensionale

IN STATVIEW

4

10/07/2012

Il coefficiente di correlazione non è una misura generale della relazione

tra due variabili, ma esprime solo il grado di linearità della correlazione

in un grafico a dispersione.

Gli outliers possono modificare significativamente il valore

del coefficiente di correlazione.

5

10/07/2012

6

10/07/2012

Il coefficiente di correlazione misura solo il grado di relazione lineare

7

10/07/2012

Essendo il valore del coefficiente

di correlazione piuttosto elevato,

ed avendo provato con un test di

ipotesi la bontà dell’ipotesi di re.lazione lineare tra i due campioni,

determiniamo i coefficienti della

retta che descrive tale relazione.

Warning: Trasformazioni sui dati possono indurre correlazioni!

Coefficiente corr. Spearman

n

6∑ [ R ( xi ) − R( yi )]

r = 1−

2

i =1

n(n 2 − 1)

R ( xi ) = posizione nel campione ordinato

Si usa quando una delle due

popolazioni non è gaussiana

Quanto è “appropriato”

scegliere una funzione

monotona per descrivere la dipendenza dei dati

8

10/07/2012

Due parole sulla popolazione

gaussiana bidimensionale e il

concetto di indipendenza…

Coppie di variabili aleatorie

Definizione: Si definisce vettore aleatorio la coppia (X,Y) dove X,Y,

sono definite sullo stesso spazio campione

X : S → ℜ, Y : S → ℜ ⇒ ( X , Y ) : S → ℜ2

Esempio: peso-altezza di

una persona

( X ,Y )

random vector

9

10/07/2012

Variabili discrete

( X = x, Y = y ) = {ω ∈ S / X (ω ) = x, Y (ω ) = y}

= {ω ∈ S / X (ω ) = x} ∩ {ω ∈ S / Y (ω ) = y}

Y (ω ) = y

X (ω ) = x

{ω ∈ S : X (ω ) ≤ x, Y (ω ) ≤ y} = {ω ∈ S : X (ω ) ≤ x} ∩{ω ∈ S : Y (ω ) ≤ y}

Y

Y (ω ) = y

ω∈S

X (ω ) = x

X

P {ω ∈ S : X (ω ) ≤ x, Y (ω ) ≤ y}

= FX ,Y ( x, y )

Funzione di ripartizione

doppia

10

10/07/2012

∫∫ f ( x, y) dx dy

B

f ( x, y ) ∆x∆y ≈ P ( x )

Gaussiana (congiunta) bidimensionale

Esempio : La funzione densità di probabilità di una normale bivariata è :

( x − µ X )2 2 ρ ( x − µ X )( y − µ Y ) ( y − µ Y )2

1

exp −

−

+

2(1 − ρ 2 ) σ X2

σ Xσ Y

σ Y2

2πσ X σ Y 1 − ρ 2

for ( x, y ) ∈ R 2 , ( µ X , µ Y ) ∈ R 2 , con parametri σ X > 0, σ Y > 0 e ρ ∈ (-1,1).

f XY ( x, y ) =

1

µ X = E[X ]

µY = E [Y ]

σ X2 = Var[ X ]

σ Y2 = Var[Y ]

ρ ∈ (−1,1)

11

10/07/2012

Contour plots

σ X = 1, σ Y = 1, µ X = 0, µ Y = 0, ρ = 0

σ X = 1, σ Y = 1, µ X = 0, µ Y = 0, ρ = 0.9

σ X = 1, σ Y = 1, µ X = 0, µ Y = 0, ρ = 0

Gaussiana bidimensionale

2

2

T −1

1 ( x − µ X ) 2 ρ ( x − µ X )( y − µY ) ( y − µY )

−

+

= (x − µ ) Σ (x − µ )

2

2

2

σ Xσ Y

σY

(1 − ρ ) σ X

dove

σ X2

cov (X,Y)

x µ

x = , µ = X Σ =

σ Y2

y

µY

cov (X , Y)

Il coefficiente di correlazione (o la covarianza) è l’unico strumento

che consente di analizzare le relazioni esistenti tra due variabili

aleatorie?

Teorema : Due variabili aleatorie congiuntamente gaussiane sono

indipendenti se e solo se ρ = 0.

IPOTESI FONDAMENTALE IN MOLTI DEI TEST CHE VEDREMO

12

10/07/2012

Effettuare previsioni,

mediante

- INTERPOLAZIONE

- ESTRAPOLAZIONE

Indica la percentuale di

variabilità della Y che è

spiegata dalla X

Coefficiente di

determinazione

Come si calcolano i coefficienti?

IL METODO DEI MINIMI QUADRATI

Minimizzare la distanza tra i punti delle osservazioni e la retta stessa.

13

10/07/2012

residui

Si cerca il minimo della funzione

n

2

rispetto a e b

L ( a, b ) = ∑ ( yi − axi − b )

i =1

Stima della variabilità degli stimatori INTERCETTA E LUNGHEZZA.

Sono i valori dei coefficienti sui dati standardizzati.

Se la retta di regressione è y=α x+β

H0 : β = 0

H1 : β ≠ 0

H0 : α = 0

H1 : α ≠ 0

14

10/07/2012

ANALISI DEI RESIDUI

Perché il modello sia valido è necessario che i residui abbiano legge gaussiana:

1) Normplot

2) Test di Kolmogorov-Smirnov

2

1,5

1

0,5

0

-1,5

-1

-0,5

Serie1

0

0,5

1

1,5

-0,5

-1

-1,5

-2

Il quantile di riferimento è

0.51926

TEST DI KOLMOGOROV-SMIRNOV

15

10/07/2012

Con Statview

Un valore pari a 2 indica che non è presente

alcuna autocorrelazione. Valori piccoli di d indi

cano che i residui successivi sono, in media,

vicini in valore l'uno all'altro, o correlati

positivamente. Valori grandi di d indicano che

i residui successivi sono, in media, molto diffe

renti in valore l'uno dall'altro, o correlati

negativamente.

Altri tipi di funzioni

16

10/07/2012

esponenziale

potenza

logaritmica

growth

Assumiamo che dall’esperimento casuale non si evinca se i due campioni casuali siano correlati o meno, siano indipendenti o meno.

Molti dei test per il confronto di due popolazioni si basano sull’ipotesi

che i due campioni casuali provengano da popolazioni indipendenti.

TEST CHI-QUADRATO PER L’INDIPENDENZA

TAVOLA DI CONTINGENZA

DATI NOMINALI

17

10/07/2012

COSTRUZIONE DI UNA TAVOLA DI CONTINGENZA IN STATVIEW

18

10/07/2012

H 0 : la popolazione età e la popolazione "smoking history"

sono indipendenti

H1 : la popolazione età e la popolazione "smoking history"

non sono indipendenti

STATISTICA TEST

χ (2s −1)×( r −1)

Essendo maggiore di 0.05

l’ipotesi nulla non si rigetta

Variabili continue? Meglio Hoeffding test

Misure di correlazione tra variabili

nominali

• Coeff. di contingenza: quando le modalità sono

maggiori di 2. Tavole quadrate.

• Coeff. di Cramer: quando le

modalità sono maggiori di 2.

Tavole rettangolari.

Grado di associazione

tra 2 variabili

19

10/07/2012

H 0 : la popolazione età e la popolazione "smoking history"

sono indipendenti

H1 : la popolazione età e la popolazione "smoking history"

non sono indipendenti

STATISTICA TEST

• Usa il logaritmo delle frequenze

osservate.

• Non applicabile quando una

cella è vuota.

• Strategia maximum likelihood.

Confronto di due popolazioni gaussiane indipendenti.

Esempio: Misure di porosità(%) di campioni di arenaria

A

13

17

15

23

B

15

10

15

23

27

29

18

18

26

24

27

20

24

18

19

21

20

10/07/2012

Hanno la stessa media?

H 0 : µ1 = µ2

H1 : µ1 ≠ µ2

T -TEST

Per effettuare questo test

è necessario definire una

variabile nominale “etichetta”

che suddivide i dati nei 2 gruppi,

e poi una variabile che contiene

l’unione dei due campioni.

21

10/07/2012

Selezionando “T-test unpaired” in ANALYZED….

22

10/07/2012

Statistica descrittiva dei due

gruppi

La statistica test è una

variabile aleatoria T-student

con gradi di libertà

DF = n1 + n2 − 2

Essendo il p-value = 0.3139 > 0.005, non si rigetta l’ipotesi nulla che

i due campioni provengano da due popolazioni aventi la stessa media.

Hanno la stessa varianza?

H0 : σ1 = σ 2

H1 : σ 1 ≠ σ 2

F -TEST

Omogeneità della varianza

23

10/07/2012

Distribuzione di Fisher

La statistica test è F=

S12

e dipende da 2 gradi di libertà: la taglia

S22

del numeratore n1 e quella del denominatore n2

NB

• Entrambi questi TEST possono essere effettuati solo

se le popolazioni da cui provengono i campioni sono

GAUSSIANE (quindi è necessario verificare questa

ipotesi con un test).

• Abbiamo visto come usare il test di Kolmogorov

Smirnov per una distribuzione QUALSIASI – in Excel.

• Solo per la distribuzione gaussiana, STATVIEW ha a

disposizione una procedura che “simula” il KS test

univariato, usando il KS test per il confronto di due

campioni.

24

10/07/2012

KS TEST PER IL CONFRONTO DELLE DISTRIBUZIONI

DI DUE POPOLAZIONI

L’idea è quella di

costruire le funzioni

di ripartizioni

empiriche per i due

campioni e poi

di valutare la distanza

massima tra queste

ultime

25

10/07/2012

Anche per effettuare questo test

è necessario definire una

variabile nominale “etichetta”

che suddivide i dati nei 2 gruppi,

e poi una variabile che contiene

l’unione dei due campioni.

Essendo il p-value = 0.8131 > 0.005,

non si rigetta l’ipotesi nulla che

i due campioni provengano da

due popolazioni aventi la stessa

distribuzione.

Normality test

26

10/07/2012

?

SIMULIAMO LA MEDESIMA

PROCEDURA

Generiamo un campione casuale da una legge gaussiana standard…

…lo trasformiamo in un campione casuale proveniente da una popolazione gaussiana con media e varianza campionaria….

27

10/07/2012

…doppio click….

28

10/07/2012

TRASFORMAZIONE DEL CAMPIONE GAUSSIANO STANDARD

Si definisce una formula per

la trasformazione del

campione

E infine si confrontano i

due campioni così ottenuti

con un KS normale

29

10/07/2012

PER IL PRIMO

GRUPPO….

PER IL SECONDO

GRUPPO….

30

10/07/2012

T-paired test

Campioni di calcare estratti da una cava sottoposti a un procedimento

di purificazione. Si vuole determinare se il procedimento ha ridotto la

gravità specifica (rapporto tra volumi rispetto a una sostanza presa come riferimento) .

La caratteristica di questo test è che vengono impiegate le STESSE

unità statistiche.

IN STATVIEW

31

10/07/2012

Se una delle due popolazioni non è gaussiana

e i dati sono “unpaired”

MANN – WHITNEY TEST

H 0 : M1 = M 2

Vengono confrontate le mediane

H1 : M 1 ≠ M 2

Esempio: Osservazioni di Cu(Rame) in campioni di creta e pietra verde.

Pietra verde

Creta

791(1)

648(2)

536(3)

118(5)

501(4)

104(6)

72(7)

36(8)

20(9)

Le osservazioni dei due campioni vengono combinate

e ordinate dalla osservazione più piccola a quella più

grande.

Se i due campioni sono stati estratti casualmente

dalla stessa popolazione ci si aspetta che rispetto

alla sequenza dei ranghi, gli elementi di un campione

appaiano distribuiti uniformemente.

La statistica test è min { Rx , Ry } con Rx , y = n1n2 +

n1,2 (n1,2 + 1)

− Wx , y

2

Wx = somma dei ranghi del I campione e Wy = somma dei ranghi del II campione

Pesati rispetto alla legge uniforme

{R

x

← U , Ry ← U prime} ,

Z-value ← min { Rx , Ry } stand.

32

10/07/2012

Se una delle due popolazioni non è gaussiana

e i dati sono “paired”

WILCOXON TEST

Esempio: Contenuto di metallo in 13 cloni di pioppo che crescono in una zona inquinata, miSurato in agosto e novembre.

Obbiettivo

POP. GAUSSIANE

POP. NON GAUSSIANE

Descrivere un campione

Media

Mediana

Confrontare un

campione con un

modello teorico

Test T (un campione)

Test dei segni

Confrontare 2 campioni

paired

Test T (paired)

Wilcoxon test

Confrontare 2 campioni

unpaired

Test T (unpaired)

Mann-Whitney Test

Confrontare 3 o più

campioni unmatched

One-way ANOVA

Kruskal-Wallis test

Confrontare 3 o più

campioni matched

Repeated Measure

ANOVA

Friedman Test

Associazioni tra 2

campioni

Correlazione di Pearson

Correlazione di

Spearman

Predizione dei valori tra

due campioni

Regressione

Regressione non

parametrica

33