Matematica Discreta

Giuseppe Lancia

Dipartimento di Matematica e Informatica

Università di Udine

A.A. 2003/2004

Indice

1 Preliminari matematici

1.1 Introduzione alla Matematica Discreta . . . . . . . .

1.1.1 Permutazioni . . . . . . . . . . . . . . . . . .

1.2 Logica e algebra booleana . . . . . . . . . . . . . . .

1.3 Insiemi e funzioni . . . . . . . . . . . . . . . . . . . .

1.4 Induzione matematica . . . . . . . . . . . . . . . . .

1.5 Somme e loro manipolazioni . . . . . . . . . . . . . .

1.5.1 Somme multiple . . . . . . . . . . . . . . . .

1.6 Alcune somme importanti . . . . . . . . . . . . . . .

P

1.6.1 La somma dei primi n naturali: ni=1 i . . . .

P

1.6.2 La somma dei primi n quadrati: ni=1 i2 . . .

P

1.6.3 La somma delle prime n + 1 potenze: ni=0 ai

1.6.4 Il metodo di perturbazione . . . . . . . . . .

1.7 Sulla crescita delle funzioni . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1

1

2

2

5

7

9

12

14

14

16

18

19

20

2 Piccioni e buche

23

2.1 Il principio della piccionaia, forma semplice . . . . . . . . . . 23

2.2 Il principio della piccionaia, forma forte . . . . . . . . . . . . 25

3 Contiamo!

3.1 Principi fondamentali: somma e prodotto

3.1.1 Il principio della somma . . . . . .

3.1.2 Il principio del prodotto . . . . . .

3.2 Combinazioni (sottoinsiemi) . . . . . . . .

3.2.1 Triangolo di Pascal . . . . . . . . .

3.3 Disposizioni (sottoinsiemi ordinati) . . . .

3.4 Ripetizioni e multi-insiemi . . . . . . . . .

3.4.1 Combinazioni con ripetizioni . . .

3.5 I numeri di Fibonacci . . . . . . . . . . .

i

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

29

29

29

30

32

34

36

37

38

40

ii

INDICE

4 Il principio di inclusione-esclusione

43

4.1 Il principio base . . . . . . . . . . . . . . . . . . . . . . . . . . 43

4.2 Spiazzamenti (derangements) . . . . . . . . . . . . . . . . . . 47

5 Probabilità combinatorie

5.1 Concetti elementari . . . . . . . . . . .

5.1.1 Processi Bernoulliani . . . . . .

5.2 Variabili casuali e valor medio . . . . .

5.2.1 ♥ Ordinamento per inversione

5.3 Generazione di strutture random . . .

5.3.1 Insiemi . . . . . . . . . . . . .

5.3.2 Permutazioni e disposizioni . .

5.4 Enumerazione completa . . . . . . . .

5.4.1 Generare tutti i sottoinsiemi .

5.4.2 Generare tutte le permutazioni

6 Teoria dei grafi

6.1 Grafi Non Orientati . . . .

6.2 Cammini e cicli . . . . . . .

6.3 Grafi bipartiti, hamiltoniani

6.4 Alberi . . . . . . . . . . . .

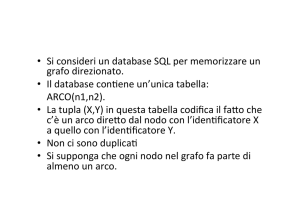

6.5 Grafi orientati . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

51

51

53

54

55

58

58

60

61

62

63

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

65

65

69

70

76

78

7 Ottimizzazione combinatoria

7.1 Il minimo albero di supporto . . . . . . . . .

7.1.1 Strategie di Prim e Kruskal . . . . . .

7.1.2 Casi speciali, facili e difficili . . . . . .

7.2 Accoppiamenti . . . . . . . . . . . . . . . . .

7.2.1 Il caso bipartito . . . . . . . . . . . . .

7.2.2 Matching pesati . . . . . . . . . . . .

7.3 Matrimoni stabili . . . . . . . . . . . . . . . .

7.4 Minima copertura di vertici . . . . . . . . . .

7.4.1 Il caso bipartito . . . . . . . . . . . . .

7.4.2 Soluzioni approssimate . . . . . . . . .

7.5 Clique e insieme indipendente . . . . . . . . .

7.6 Colorazione di grafi . . . . . . . . . . . . . . .

7.6.1 Le guardie del museo . . . . . . . . . .

7.7 Il commesso viaggiatore . . . . . . . . . . . .

7.7.1 TSP euclideo: algoritmi approssimati

7.8 Set covering . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

81

81

82

83

83

84

84

84

85

85

86

86

88

89

89

90

90

.

.

e

.

.

. . . . .

. . . . .

euleriani

. . . . .

. . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

INDICE

8 Tracce di soluzioni

8.1 Capitolo 1 . . . .

8.2 Capitolo 2 . . . .

8.3 Capitolo 3 . . . .

8.4 Capitolo 4 . . . .

8.5 Capitolo 5 . . . .

8.6 Capitolo 6 . . . .

8.7 Capitolo 7 . . . .

iii

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

91

91

91

92

93

94

94

97

Capitolo 1

Preliminari matematici

1.1

Introduzione alla Matematica Discreta

Ad un party si presentano n persone, p uomini e q donne. Ci chiediamo cose

del tipo

• Quante strette di mano si possono dare?

• in quanti modi si possono sedere a tavola?

• quante coppie si possono formare per ballare?

• ecc.

Ragioniamo sul punto 1. Assumiamo ognuno stringa la mano a ogni

altro. Ognuno stringe n − 1 mani per un totale di n(n − 1) strette. Però, in

questo modo, ogni stretta di mano è contata due volte, per cui le strette di

mano sono in tutto n(n − 1)/2.

Ora supponiamo si vogliano sedere a una tavola “rettangolare” (ossia,

dove è chiaro il capotavola). Fissiamo il capotavola e l’ordine (es. orario). Il

capotavola può essere uno degli n. Alla sua sinistra, uno dei restanti n − 1.

Alla sinistra di questo, uno dei restanti n − 2, ecc. In totale si hanno

n(n − 1)(n − 2) . . . 3 · 2 · 1

modi di sedersi. Questo numero è detto n!. Es 3! = 6, 4! = 24, 10! =

3, 628, 800, 15! = 1, 307, 674, 368, 000 e 20! = 2, 432, 902, 008, 176, 640, 000.

Infine il punto 3. Assumiamo p = q. Ognuno dei p uomini può ballare

con una delle p donne. Se il primo uomo balla con x, il secondo può ballare

con una tra p − 1 donne (tutte tranne x). Sia y. Il terzo con p − 2 (tutte

1

2

CAPITOLO 1. PRELIMINARI MATEMATICI

tranne x e y). Alla fine ci sono p(p − 1) . . . 3 · 2 · 1 = p! modi di formare

le coppie per un ballo. Se p > q ci sono p − q uomini che non balleranno.

In questo caso è meglio ragionare sulle donne. La prima ha p scelte. La

seconda p − 1, la terza p − 2, ecc. In totale ci sono

p(p − 1)(p − 2)(p − q + 1) =

p!

.

(p − q)!

(1.1)

Ad es. 15 uomini e 10 donne possono partecipare a un ballo in 15!/5! =

10, 897, 286, 400 modi diversi.

1.1.1

Permutazioni

Avendo n oggetti distinti, in quanti modi li possiamo disporre in un elenco

(in quanti modi li possiamo ordinare)? Ogni modo è detto una permutazione

degli n oggetti. Ci sono n! permutazioni. È importante che gli elementi siano

distinti (ad esempio, se tutti gli n elementi fossero indistinguibili, ci sarebbe

una sola permutazione e non n!.)

Esercizio 1.1. Elencare le 24 permutazioni di {A, B, C, D}.

Esempio. Quanti sono i modi di mescolare 40 carte di briscola: 40! È

circa 1048 . Questo è anche il numero di tutte le possibili partite distinte di

briscola (guardare all’ordine con cui le carte vengono girate sul tavolo). 1.2

Logica e algebra booleana

L’algebra booleana riguarda principalmente lo studio di proposizioni (affermazioni, formule,...) che possono risultare vere o false. Questi due valori sono indicati come VERO e FALSO. Se P è un’affermazione e Q un’altra affermazione, possiamo creare nuove affermazioni tramite tre operazioni

fondamentali: or (∨), and (∧) e not (¬). Le regole sono

• P ∨ Q è VERO se almeno una tra P e Q vale VERO, altrimenti P ∨ Q =

FALSO.

• P ∧ Q è VERO se entrambe P e Q valgono VERO, altrimenti P ∧ Q =

FALSO.

• ¬P è VERO se P è FALSO e ¬P è FALSO se P è VERO.

1.2. LOGICA E ALGEBRA BOOLEANA

3

Si hanno le seguenti tabelle di verità:

P

FALSO

FALSO

VERO

VERO

Q

FALSO

VERO

FALSO

VERO

P ∨Q

FALSO

VERO

VERO

VERO

P ∧Q

FALSO

FALSO

FALSO

VERO

¬P

VERO

VERO

FALSO

FALSO

Un’altra operazione logica è l’implicazione, indicata con →, che va’

interpretata come

• P →Q è VERO se, tutte le volte in cui P è VERO, anche Q è VERO, e

quando P è FALSO Q può essere indifferentemente VERO o FALSO. In

caso contrario (quando accade che P è VERO ma Q è FALSO), allora

P →Q = FALSO.

La tabella della verità è perciò:

P

FALSO

FALSO

VERO

VERO

Q

FALSO

VERO

FALSO

VERO

P →Q

VERO

VERO

FALSO

VERO

Dall’analisi della tabella di verità dell’implicazione, si deduce che P →Q

è la stessa cosa che ¬P ∨ Q. Inoltre, siccome ¬¬X = X sempre, abbiamo

che ¬P ∨ Q = ¬P ∨ ¬¬Q. Per cui invertendo il ruolo di P e di ¬Q si ha che

P →Q è la stessa cosa che ¬Q→¬P .

Si noti che se P = FALSO allora P →Q è sempre VERO! Proviamo a

scegliere una frase Q qualsiasi e dimostrare che 1 = 0 implica Q. Sia allora

Q =“Le mucche sono verdi”; proviamo a dimostrarlo cosı̀. Ad ogni colore

diamo un codice numerico, in modo che i vari possibili colori siano codificati

come 1, 2, . . . , k. Sia v il codice del colore verde. Presa una mucca qualsiasi,

sia c il codice del suo colore. Allora c = c × 1 = c × 0 = 0 = v × 0 = v × 1 = v

sicchè il colore di quella mucca è proprio v: la mucca è verde!

Esercizio 1.2. Dimostrare che, se 1 = 0, allora tutti i numeri naturali sono

primi.

Esercizio 1.3. Dimostrare che, se il mio cane ha 12 zampe, allora il papa

ha le ali.

Un esempio importante riguarda il sillogismo, che possiamo anche chiamare deduzione:

4

CAPITOLO 1. PRELIMINARI MATEMATICI

se P è vero, ed è anche vero che P →Q, allora si può concludere che anche

Q è vero.

Esercizio 1.4. Siano A= “chi ha piu’ di 21 anni può guidare” e B=“Paolo

ha 18 anni”, C=“Gianni ha 24 anni”, D=“chi guida conosce il codice”. Quali

tra queste deduzioni si possono fare?

• Gianni conosce il codice

• Gianni guida

• Paolo non può guidare

• Gianni può guidare

È importante saper calcolare la negazione di una proposizione. Se la proposizione è del tipo “per ogni x vale f (x)”, la sua negazione è: “esiste almeno

un x per cui non vale f (x)”. Se la proposizione è del tipo “esiste un x per

cui vale g(x)”, la sua negazione è: “per ogni x non vale g(x)” ossia “per

nessun x vale g(x)”.

Ad esempio, sapendo che Mario non guida, cosa possiamo dedurre? Qual

è la negazione di A? E di D? La negazione di D implica C?

Per dimostrazione di un’affermazione P (in particolare, ad es. di un teorema) si intende, fondamentalmente, l’utilizzo di una catena di deduzioni

vere D1 →D2 , D2 →D3 , ..., Dk−1 →Dk e Dk →P , dove D1 è un fatto “notoriamente” vero (un postulato, o il risultato di un’altra dimostrazione).

Bisogna fare attenzione a non confondere la conclusione con la premessa.

Ad esempio, se sappiamo che

– Tutti gli udinesi amano il vino

e che

–Silvia ama il vino

non possiamo concludere che Silvia è di Udine. Se però sappiamo che

– Paolo non ama il vino

possiamo concludere che Paolo non è di Udine. La conclusione si ottiene

tramite la “dimostrazione per assurdo”. Ossia, se supponessimo che Paolo

1.3. INSIEMI E FUNZIONI

5

fosse di Udine, arriveremmo a dover negare una cosa vera (ossia che non

ama il vino, perchè, in quanto udinese, deve amare il vino). In generale

una dimostrazione per assurdo di una proposizione P , consiste nel trovare

un’implicazione vera ¬P →A, e nel fare vedere che A è FALSO. Ma allora ¬P

deve essere FALSO, e, quindi, P deve essere VERO.

Dimostrazioni per assurdo Come detto, le dimostrazioni per assurdo

consiste nel dimostrare implicazioni del tipo P →Q in cui Q è falso. In tal

modo, ne consegue che anche P deve essere falso. In particolare, supponiamo

di dimostrare l’implicazione P →¬P . Allora P deve essere falso. Allo stesso

modo, se si dimostra che ¬P →P , P deve essere vero.

Come esempio, consideriamo l’enunciato P =“esistono infiniti numeri

primi” e dimostriamo per assurdo che ¬P →P , da cui P deve essere vero.

Ossia dimostriamo che se i numeri primi fossero in numero finito, allora non

potrebbero essere in numero finito. La dimostrazione è di Euclide. Supponiamo pertanto che tutti i numeri primi siano p 1 , . . . , pn . Creiamo un nuovo

numero a = p1 · p2 · · · pn + 1. Sia p un divisore primo di a. p ∈

/ {p 1 , . . . , pn },

perchè a non è divisibile per alcun p i (a diviso per pi da’ quoziente Πj6=i pj

e resto 1). Quindi p è un nuovo numero primo e p 1 , . . . , pn non erano tutti i

numeri primi.

Esercizio 1.5. Definiamo “numero magico” un numero che è pari alla

somma delle sue cifre. Dimostrare per assurdo che non esistono numeri

magici di 3 o più cifre. Dimostrare che non esistono neppure di 2 cifre.

Esercizio 1.6. Dimostrare per assurdo che non può esistere un numero

intero che sia al contempo pari e dispari

1.3

Insiemi e funzioni

L’insieme è un concetto primitivo, che non può essere definito se non con

un sinonimo (collezione, gruppo...). Si possono elencare gli elementi (se l’insieme è finito e ha bassa cardinalità) o dare una proprieta’ che ne caratterizza

gli elementi.

Tra gli insiemi abbiamo le principali operazioni di unione

A ∪ B = {x | x ∈ A ∨ x ∈ B}

(1.2)

A ∩ B = {x | x ∈ A ∧ x ∈ B}

(1.3)

intersezione

6

CAPITOLO 1. PRELIMINARI MATEMATICI

differenza

A − B = {x | x ∈ A ∧ x ∈

/ B}

(1.4)

A∆B = (A − B) ∪ (B − A).

(1.5)

e differenza simmetrica

Un sottoinsieme B di un insieme S, è tale che x ∈ B→x ∈ S. Il complementare di B (indicato con B, quando il sovrainsieme S è implicito) è

l’insieme B = S − B.

Le leggi di De Morgan mettono in relazione le operazioni di unione e

intersezione con il complementare:

A∪B = A∩B

(1.6)

A∩B = A∪B

(1.7)

Per la cardinalità si hanno le seguenti relazioni (lo si dimostri per esercizio):

0 ≤ |A ∩ B| ≤ max{|A|, |B|}

(1.8)

min{|A|, |B|} ≤ |A ∪ B| ≤ |A| + |B|

(1.9)

|A ∪ B| = |A| + |B| − |A ∩ B|

(1.10)

Esercizio 1.7. Sapendo che |A| = 4 e |B| = 8, quali tra i seguenti valori

possono essere |A ∪ B| : 3, 4, 7, 10, 13? Quali tra i precedenti valori possono

essere |A ∩ B|?

Le funzioni associano agli elementi di un insieme (dominio) elementi di

un altro insieme (codominio). Una funzione può essere iniettiva (x 6= y

implica f (x) 6= f (y)), suriettiva (per ogni y del codominio esiste un x del

dominio con y = f (x)) o biettiva (sia iniettiva che suriettiva). Due insiemi

hanno lo stesso numero di elementi se (e solo se) tra i due insiemi c’è una

funzione biettiva. La composizione di due funzioni f e g è una funzione h

definita da h(x) = f (g(x)).

Esercizio 1.8. Sia f una funzione di A in B e sia C ⊆ B tale che per ogni

c ∈ C esiste almeno un x ∈ A con c = f (x). Che relazione c’è fra |C| e |A|?

1.4. INDUZIONE MATEMATICA

1.4

7

Induzione matematica

Il principio di induzione, consiste nel dimostrare che una certa proprietà P

vale per tutti i numeri naturali dimostrando che

1. P è vera per il numero 0

2. se P è vera per il numero k − 1, allora è vera anche per il numero k

Per evidenziare la dipendenza di P dal numero, si scrive P (n). Per cui,

si può dimostrare che P (n) = VERO per ogni n dimostrando che

1. P (0) = VERO

2. P (k − 1)→P (k) per ogni k > 0

Il caso P (0) si dice caso base dell’induzione, mentre il passaggio da k − 1

a k è detto passo induttivo. In alcuni casi si può sostituire un certo numero

K a 0, e allora si dimostra che la proprietà P vale per tutti gli n ≥ K.

Esempio. Come esempio, dimostriamo che la somma dei primi n numeri

dispari vale n2 .

Indichiamo tale somma con S(n). Si noti che l’n-esimo numero dispari

(per n = 1, 2, . . .) è 2n − 1. Caso base:

S(1) = 1 = 12

Passo induttivo. Sia S(k) = k 2 . Allora

S(k) = S(k − 1) + 2k − 1 = k 2 − 2k + 1 + 2k − 1 = k 2 .

Esempio. Dimostriamo che la somma dei primi n numeri naturali positivi

.

è n(n+1)

2

Indichiamo tale somma con S(n). Caso base:

S(1) = 1 =

Passo induttivo. Sia S(k − 1) =

(k−1)k

.

2

S(k) = S(k − 1) + k =

1·2

2

Allora

(k − 1)k

k

+2 =

2

2

8

CAPITOLO 1. PRELIMINARI MATEMATICI

k(k + 1)

k

(k − 1 + 2) =

2

2

Esempio. Dimostriamo che ni=0 2i = 2n+1 − 1. Indichiamo tale somma

con S(n). Caso base:

S(0) = 1 = 21 − 1.

P

Passo induttivo. Sia S(k − 1) = 2k − 1. Allora

S(k) = S(k − 1) + 2k = 2k − 1 + 2k = 2k+1 − 1.

Sebbene il passo induttivo è di solito presentato come il modo di dimostrare P (k) a partire da P (k − 1), sarebbe perfettamente analogo (e

porterebbe ancora a concludere che P (n) è vera per ogni n) un passo induttivo che dimostrasse che P (k) consegue da P (q) per qualche q < k (ossia

non necessariamente q = k −1). Infatti, in tale modo si potrebbe dimostrare

P (1) da P (0), dopodichè seguirebbe P (2) da P (0) o P (1), e a quel punto

seguirebbe P (3) da P (0) o P (1) o P (2), e cosı̀ via...

I seguenti esempi mostrano come l’induzione possa essere usata in maniera

errata e portare a “dimostrare” proposizioni false. Si trovino gli errori negli

esempi seguenti.

Esempio. Si consideri la dimostrazione per induzione della proposizione

P (n): n linee, a 2 a 2 non parallele, si incontrano tutte in uno stesso punto.

P (2) è chiramente vera. Supponiamo ora di avere k linee e che P (k − 1)

sia vero. Siano a, b, c, d, . . . le linee. Tolta la linea c, le rimanenti si incontrano (per induzione) in un punto, diciamo X. In particolare a e b passano

per X. Ora, rimettiamo c e togliamo d. Sempre per indizione, le k − 1 linee

(comprese a, b e c) si incontrano in un punto, che deve essere X (questo

siccome sappiamo già che a e b si incontrano in X). Si conclude che c passa

per X, e quindi tutte le linee passano per X.

Esempio. Si consideri la dimostrazione per induzione della proposizione

P (n): per ogni n ≥ 0, si ha n = 2n.

P (0) è vero siccome 0 = 2 · 0. Dato k > 0, si supponga vero P (q) per 0 ≤

q < k. Per un 0 < q < k, si spezzi k in (k − q) + q. Per ipotesi di induzione,

k −q = 2(k −q) e q = 2q. Ne consegue k = (k −q)+q = 2(k −q)+2q = 2k. 1.5. SOMME E LORO MANIPOLAZIONI

1.5

9

Somme e loro manipolazioni

La somma(toria) è un’espressione del tipo

n

X

ak

k=1

dove k è detto l’indice e ak il termine generico. Il valore di tale somma

è

a1 + a2 + a3 + · · · + an−1 + an .

Questo secondo tipo di scrittura lascia un po’ troppa libertà, nello scegliere

quanti e quali “· · ·” mettere. Ad esempio, la somma sopra si poteva probabilmente scrivere a1 + a2 + · · · + an . Se però ai = 2i−1 si avrebbe la scrittura

Pn−1

1 + 2 + · · · + 2n−1 che può essere confusa con i=1

i. Sarebbe quindi staP

to meglio scriverla come 20 + 21 + · · · + 2n−1 . Con l’espressione

questo

problema non si pone.

Gli indici di una somma sono numeri interi. La variabilità di un indice

non deve necessariamente essere tra un limite inferiore e uno superiore, ma

l’indice può essere preso su un qualsiasi insieme K di interi. In questo caso

la scrittura migliore è quella che spiega la variabilità dell’indice sotto al

P

simbolo di somma :

X

ak

k∈K

Alcuni esempi:

X

0≤k≤n

ak ,

X

ak ,

k primo,k<20

X

ak

1≤k≤100, k dispari

Ad esempio, la somma dei quadrati dei numeri dispari tra 1 e 100 è

preferibile scritta come

X

k2

1 ≤ k ≤ 100

k dispari

che come

50

X

(2k − 1)2

k=1

per quanto sia la stessa somma. Allo stesso modo “risparmiare” termini non

serve e può rendere più difficile capire una somma. Ad esempio scrivere

n−1

X

k=2

k(k − 1)(n − k)

10

CAPITOLO 1. PRELIMINARI MATEMATICI

è peggio che scrivere

n

X

k=0

k(k − 1)(n − k)

per quanto il valore sia lo stesso. Anche la somma sull’insieme vuoto è

definita, e vale sempre 0:

X

ak = 0.

k∈∅

Le seguenti regole permettono di manipolare le somme, per crearne di

nuove, per aggregazione o disgregazione:

1. Legge distributiva: Da una somma si possono “portare fuori” le

costanti, ossia le espressioni che non dipendono dall’indice:

X

cak = c

k∈K

X

ak

k∈K

2. Legge associativa: permette di spezzare una somma in due o di

riunire due somme in una:

X

(ak + bk ) =

X

ak +

bk

k∈K

k∈K

k∈K

X

3. Legge commutativa: L’ordine con cui si sommano i termini può

essere cambiato e la somma resta la stessa. Sia p una permutazione

definita su tutti i numeri interi (ossia una funzione p di Z in Z tale

che p è sia iniettiva che suriettiva). Allora

X

k∈K

ak =

X

ap(k)

p(k)∈K

Consideriamo il caso semplice K = {1, 2, 3, 4} presa una permutazione

nel senso classico di un ordinamento dei 4 numeri (ad esempio 3, 1,

2, 4) questa può anche essere vista come una funzione permutazione,

ossia, p(1) = 3, p(2) = 1, p(3) = 2, e p(4) = 4. Si può poi estendere p

agli altri interi (che tanto non entrano nella somma) definendo p(i) = i

per i < 1 e i > 4. In pratica stiamo dicendo che a 1 + a2 + a3 + a4 =

a3 + a 1 + a 2 + a 4 .

Consideriamo un caso più interessante (il cambio di indice): per ogni

costante c e numero intero b 6= 0, la funzione

p(i) = bi + c

1.5. SOMME E LORO MANIPOLAZIONI

11

è una permutazione degli interi (per esercizio, lo si dimostri). Per cui

X

X

ak = c

k∈K

abk+c

(bk+c)∈K

Ad esempio, calcoliamo

X

S=

(a + bk)

(1.11)

0≤k≤n

sfruttando solo le 3 leggi qui sopra. Applichiamo la legge commutativa e

rimpiazziamo k con n − k, ottenendo

S=

X

(a + b(n − k)) =

0≤n−k≤n

X

(a + bn − bk)

(1.12)

0≤k≤n

Dalla legge associativa sommiamo (1.11) e (1.12) e otteniamo

2S =

X

0≤k≤n

((a + bk) + (a + bn − bk)) =

X

(2a + bn)

0≤k≤n

Per la legge distributiva (si noti che (2a + bn) non dipende da k) si ha

2S = (2a + bn)

X

1 = (2a + bn)(n + 1)

0≤k≤n

da cui, dividendo per 2

1

S = (a + bn)(n + 1).

2

Una formula generale che permette di fondere e spezzare le somme è la

seguente:

X

X

X

X

ak +

ak =

ak +

ak

(1.13)

k∈K

k∈K 0

k∈K∩K 0

k∈K∪K 0

Esempio.

• fondere le somme: sia 1 ≤ m ≤ n. Allora

m

X

ak +

k=1

n

X

ak = a m +

n

X

ak

k=1

k=m

• spezzare le somme: sia 1 ≤ m ≤ n. Allora

n

X

k=1

ak =

m

X

k=1

ak +

n

X

ak

k=m+1

12

CAPITOLO 1. PRELIMINARI MATEMATICI

1.5.1

Somme multiple

Un vettore di dimensione n è una sequenza di n numeri, detti le componenti

del vettore. Ad esempio, i seguenti a, b e c sono vettori di dimensione 4:

a = (3, 2, 5, −1)

b = (6, π, −3, 0)

c = (0, 0, 0, 0)

Se a è un vettore, le sue componenti si indicano tramite indici, come in

a = (a1 , a2 , . . . , an )

Supponiamo, dati due vettori a e b di voler calcolare la somma dei prodotti fra ogni componente di a e di b. Ad esempio, se n = 3, tale somma

è

a2 b3 + a 1 b2 + a 2 b1 + a 3 b1 + a 2 b2 + a 1 b3 + a 1 b2 + a 3 b2 + a 3 b3

(1.14)

Questa somma può essere scritta come una somma doppia, ossia su due

indici:

X

ai bj

(1.15)

1≤i,j≤3

Riscriviamo la somma (1.14) in un modo più organizzato, mettendo tutti

gli addendi in una tabella:

a1 b1 + a 1 b2 + a 1 b3 +

a2 b1 + a 2 b2 + a 2 b3 +

a3 b1 + a 3 b2 + a 3 b3

(1.16)

Si dice anche che gli addendi sono stati messi in una matrice 3 per 3,

ossia con 3 righe e 3 colonne (in generale, una matrice m × n ha mn numeri

disposti su m righe e n colonne). La somma può essere calcolata facendo

le somme di ogni riga e poi sommando tali valori. Si noti che la riga i ha

termini in cui ai è costante e varia solo bj . Scriviamo

X

X

ai bj

1≤i≤3 1≤j≤3

Si sarebbe però potuto anche calcolare tale somma “per colonne”, ossia

sommando il valore su ogni colonna (in cui b j è costante) e facendo infine la

somma dei totali. Questa somma si sarebbe dovuta scrivere

X

X

1≤j≤3 1≤i≤3

ai bj

1.5. SOMME E LORO MANIPOLAZIONI

13

C’è stato quindi uno scambio di indici. Vediamo ora formalmente perchè

questo è giustificato:

X

X

ai bj =

X

X

(ai

X

bj ) (

1≤j≤3

1≤j≤3

1≤i≤3

1≤i≤3 1≤j≤3

bj ) = (

X

ai )

(1.17)

1≤i≤3

dove il primo passaggio è giustificato dal fatto che nell’espressione 3j=1 ai bj

il valore ai è una costante (non dipende da j) e può quindi (legge distributiva) essere portato fuori dalla somma. Allo stesso modo, il secondo passaggio

P

segue dal fatto che l’intera somma 3j=1 bj è una costante nell’espressione

P3

P3

i=1 (ai

j=1 bj ).

In modo perfettamente analogo, si può dimostrare che anche

P

X

X

X

ai bj = (

1≤j≤3 1≤i≤3

ai ) (

1≤i≤3

X

bj )

(1.18)

1≤j≤3

In particolare, le formule (1.17) e (1.18) ci danno anche un modo immediato per calcolare il valore finale. Basta sommare tutte le componenti di a

e moltiplicare il valore ottenuto con la somma di tutte le componenti di b.

La regola di scambio degli indici in una somma può essere riassunta

cosı̀: quando in una somma doppia il primo indice i varia su un insieme

I e il secondo indice j varia su un insieme J, in maniera indipendente dal

valore di i (ossia, J è sempre lo stesso, per ogni valore di i), allora gli indici

possono essere scambiati:

XX

i∈I j∈J

sij =

XX

sij

(1.19)

j∈J i∈J

dove con sij abbiamo indicato il generico termine della somma (che

dipende da i e j. Nell’esempio precedente, era s ij = ai bj )

Se però la variabilità del secondo indice dipende dal valore del primo

indice, allora bisogna fare attenzione. Si consideri il seguente esempio:

n X

n

X

sij

(1.20)

i=0 j=i

Questa somma non si può riscrivere come

n X

n

X

sij

(1.21)

j=i i=0

in quanto, leggendo da sinistra a destra, la variabilità del primo indice (j)

non è definita chiaramente. Infatti si suppone che j parta da i, ma i è un

14

CAPITOLO 1. PRELIMINARI MATEMATICI

simbolo “indefinito” (o, come si dice, non quantificato) la prima volta che lo

si incontra.

La situazione di indici dipendenti si può descrivere in questo modo: il

primo indice, i, varia su un insieme I, mentre il secondo j, varia su un insieme

J(i) che dipende, di volta in volta, dal valore corrente di i. In questo caso,

per poter scambiare gli indici, dobbiamo vedere, per ogni valore del secondo

indice, j, quali sono i valori di i per i quali j apparteneva a J(i). Sia J

l’unione di tutti i J(i) per i ∈ I (ossia J è l’insieme di tutti i possibili valori

del secondo indice). Definiamo, per ogni j ∈ J,

I(j) := {i ∈ I | j ∈ J(i)}

Allora, possiamo effettuare lo scambio degli indici in questo modo:

X X

sij =

i∈I j∈J(i)

X X

sij

(1.22)

j∈J i∈I(j)

Nel caso dell’esempio (1.20) si ha J = {0, . . . , n} e I(j) = {0, 1, . . . , j}

per ogni j. Pertanto, (1.20) può essere riscritta come

j

n X

X

sij

(1.23)

j=0 i=0

Esercizio 1.9. Siano a = (3, 23 , 5, 13 , −2, −6, 3, 9, −1) e b = (− 31 , 14 , 2, 3, −1, 21 , 12 ).

Si calcoli

9 X

7

X

ai

.

b

i=1 j=1 j

1.6

1.6.1

Alcune somme importanti

La somma dei primi n naturali:

Approccio “geniale”

Pn

i=1

i

Il primo approccio è quello utilizzato da Gauss a 6 anni! Per sommare i

primi 100 numeri, ha ragionato cosı̀. Il primo (1) più l’ultimo (100) danno

101. Il secondo (2) più il penultimo (99) danno ancora 101. E cosı̀ via,

3 + 98 = 101,..., 50 + 51 = 101. In totale si hanno 50 coppie di valore 101 e

P

quindi 100

i=1 i = 5050.

1.6. ALCUNE SOMME IMPORTANTI

15

Il ragionamento si può generalizzare cosı̀. Supponendo n pari, si hanno

n/2 coppie di valore n + 1 e quindi

n

X

i=

i=1

n(n + 1)

2

(1.24)

Se n è dispari, si può aggiungere 0 alla somma, come primo termine. In

questo modo si ottengono n + 1 termini e (n + 1)/2 coppie. Ogni coppia

somma n (0 + n, 1 + (n − 1),...), per cui la somma è ancora n(n + 1)/2.

Approccio “geometrico”

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

Sia B la base e H l’altezza del disegno qui sopra. Vogliamo calcolare

l’area coperta dagli “*”. Si ha

B=n

e

H = n + 1.

L’area totale è H · B = n(n + 1). L’area scura (quella che cerchiamo) è

i=1 i ed è anche uguale all’area chiara. Siccome area chiara + area scura

= area totale, si ha

Pn

2·

per cui

n

X

i = n(n + 1)

(1.25)

n(n + 1)

.

2

(1.26)

i=1

n

X

i=

i=1

Approccio “analitico”

Si intuisce che la somma cresce “come” n 2 (ci sono n addendi dal valore fino

a n). Per cui si ipotizza

C(n) =

n

X

i=1

i = an2 + bn + c

16

CAPITOLO 1. PRELIMINARI MATEMATICI

Si prova per sostituzione.

C(0) = 0 per cui c = 0

C(1) = a + b = 1

C(2) = 4a + 2b = 3

Si ricava un sistema di 2 equazioni in 2 incognite:

(

a + b = 1

4a + 2b = 3

Risolviamo il sistema. Rimpiazziamo la II con (4I − II), ottenendo

(

a +

b = 1

2b = 1

Da cui, b = 1/2 e a = 1/2. Quindi

1 2 1

n + n

2

2

che, raggruppando n al numeratore, diventa

C(n) =

C(n) =

1.6.2

n(n + 1)

2

La somma dei primi n quadrati:

Calcoliamo

Pn

i=1 i

2.

Usiamo 2 approcci diversi.

Pn

i=1

i2

Approccio “geometrico”

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

*

Sia B la base e H l’altezza del disegno qui sopra. Vogliamo calcolare

l’area coperta dagli “*”. Si ha

B=

n

X

i=1

i=

n(n + 1)

2

e

H = n + 1.

1.6. ALCUNE SOMME IMPORTANTI

17

2

. L’area scura (quella che cerchiamo) è

L’area totale è H · B = n(n+1)

Pn 2

Pn P2 i

i=1 i . L’area chiara è

i=1

j=1 j. Si ha:

n X

i

X

i=1 j=1

j=

n

X

i(i + 1)

i=1

2

=

n

n

n

1X

1X

1 n(n + 1)

1X

i2 +

i=

i2 +

(1.27)

2 i=1

2 i=1

2 i=1

2

2

Siccome area chiara + area scura = area totale, si ha

n

n

n(n + 1) X

n(n + 1)2

1X

i2 +

+

i2 =

2 i=1

4

2

i=1

n

n(n + 1)2 n(n + 1)

3X

n(n + 1)

i2 =

−

=

(2(n + 1) − 1)

2 i=1

2

4

4

da cui

n

X

i=1

i2 =

n(n + 1)(2n + 1)

2 n(n + 1)(2n + 1)

=

.

3

4

6

(1.28)

(1.29)

(1.30)

Approccio “analitico”

Si intuisce che la somma cresce “come” n 3 (ci sono n addendi dal valore fino

a n2 ). Per cui si ipotizza

C(n) =

n

X

i2 = an3 + bn2 + cn + d

i=1

Si prova per sostituzione.

C(0) = 0 per cui d = 0

C(1) = a + b + c = 1

C(2) = 8a + 4b + 2c = 1 + 4 = 5

C(3) = 27a + 9b + 3c = 1 + 4 + 9 = 14

Si ricava un sistema di 3 equazioni in 3 incognite:

a + b + c = 1

8a + 4b + 2c = 5

27a + 9b + 3c = 14

Risolviamo il sistema. Rimpiazziamo la II con (8I − II) e la III con

(27I − III). Otteniamo

18

CAPITOLO 1. PRELIMINARI MATEMATICI

a +

b + c = 1

4b + 6c = 3

18b + 24c = 13

Continuando, si rimpiazza la III con (18II − 4III) ottenendo

a +

b +

4b +

c = 1

6c = 3

12c = 2

A questo punto si risolve e si ha c = 1/6, b = 1/2 e a = 1/3. Ossia

1

1

1

C(n) = n3 + n2 + n

3

2

6

che, fissando il denominatore a 6 e raggruppando n al numeratore, diventa

C(n) =

n(n + 1)(2n + 1)

6

Esercizio 1.10. Quanti quadrati contiene una griglia di lato n (ossia con

n + 1 punti su ogni lato)?

1.6.3

La somma delle prime n + 1 potenze:

Calcoliamo S(n) :=

n ≥ 0)

Pn

i=0 a

i,

Pn

i=0

ai

dove a > 1. Abbiamo (induttivamente, per

S(n + 1) = an+1 + S(n).

(1.31)

Inoltre, moltiplicando S(n) per a si ottiene

a(1 + a + a2 + . . . + an ) = a + a2 + . . . + an+1 =

n+1

X

i=0

ai − 1

ossia

aS(n) = S(n + 1) − 1

(1.32)

Da (1.31) e (1.35) si ricava un sistema che possiamo risolvere rispetto a S(n). Sostituendo il valore di S(n + 1) dato dall’equazione (1.31)

nell’equazione (1.35), si ottiene

aS(n) = an+1 + S(n) − 1

(1.33)

1.6. ALCUNE SOMME IMPORTANTI

19

da cui

S(n) =

an+1 − 1

.

a−1

i

Esempio. Calcoliamo 40

i=12 7 . Abbiamo

(741 − 1)/6 − (712 − 1)/6 = 712 (729 − 1)/6.

P

(1.34)

P40

i=12 7

i

=

P40

i=0 7

i

−

P11

i=0

7i =

♥ Esercizio 1.11. Quante sono le possibili sequenze di DNA lunghe al

più 10 nucleotidi?

Esercizio 1.12. Quanto vale

1.6.4

Pn

i=0 a

3i ?

Il metodo di perturbazione

Dagli esempi precedenti (specialmente l’ultimo) possiamo evincere un metoPn

do generale per (tentare di) risolvere le somme del tipo S n =

k=0 ak .

Il metodo si chiama “perturbazione” e consiste nel cercare di creare un’equazione che abbia Sn sia a destra che a sinistra, ma non con lo stesso

coefficiente, in modo che non si cancellino a vicenda. Questa equazione

viene creata passando a Sn+1 e mettendo di volta in volta in evidenza a n+1

e a0 .

Aggiungendo an+1 a Sn , si ha Sn+1 , ossia

Sn + an+1 =

X

ak

0≤k≤n+1

Mettiamo ora in evidenza a0 a destra. Inoltre, siccome (legge commuP

P

tativa) 1≤k≤n+1 ak è lo stesso che 0≤k≤n ak+1 , otteniamo la relazione

fondamentale

Sn + an+1 = a0 +

X

ak+1

0≤k≤n

Il trucco ora sta nel cercare di sviluppare 0≤k≤n ak+1 in modo ricavarne

(se possibile) Sn . In tal modo avremmo Sn sia a sinistra che a destra, e

potremo risolvere rispetto a Sn .

P

Come esempio di questa tecnica calcoliamo il valore di

Sn =

X

0≤k≤n

k2k

20

CAPITOLO 1. PRELIMINARI MATEMATICI

Abbiamo

Sn + (n + 1)2n+1 = 0 +

X

(k + 1)2k+1

(1.35)

0≤k≤n

Studiamo 0≤k≤n (k+1)2k+1 cercando di mettere in evidenza Sn . Spezziamo la somma in due con la legge associativa.

P

X

(k + 1)2k+1 =

0≤k≤n

X

k2k+1 +

0≤k≤n

e, ricordando che

P

0≤k≤n (k

P

X

2k+1 = 2

0≤k≤n

0≤k≤n 2

k

X

k2k + 2

0≤k≤n

X

2k

0≤k≤n

= 2n+1 − 1, si ha

+ 1)2k+1 =

0≤k≤n k2

P

= 2

P

k+1

0≤k≤n k2

k

+

+2

= 2Sn + 2n+2 − 2

0≤k≤n 2

P

P

k+1

0≤k≤n 2

k

Sostituendo questo valore in (1.35) si ottiene

Sn + (n + 1)2n+1 = 2Sn + 2n+2 − 2

da cui

Sn = (n + 1)2n+1 − 2n+2 + 2 = 2n+1 (n − 1) + 2.

Esercizio 1.13. Si usi il metodo di perturbazione per (ri)calcolare

con c > 1.

1.7

Pn

i=0 c

i,

Sulla crescita delle funzioni

Consideriamo funzioni come n, n2 , 2n , n!, log n. Ci chiediamo come variano

al variare di n.

Partiamo dalla funzione esponenziale, del tipo a n . Ad esempio consideriamo il caso a = 2. Prendiamo una scacchiera e mettiamo una moneta da

1 euro sulla prima casella, 2 sulla seconda, 4 sulla terza e cosı̀ via. Quanto

sarà alta la torre di monete sull’ultima casella?

Si tratta di una pila di 263 monete. 263 è il prodotto

2 · 2 · 2···2 · 2

1.7. SULLA CRESCITA DELLE FUNZIONI

21

con 63 fattori. Per farne una stima grossolana, rimpiazziamo ogni 10 fattori

(210 ) con 1000, ossia 103 (in realtà 210 = 1024, per cui stiamo sottostimando

il valore). Ne consegue che 263 > (103 )6 · 23 , ossia

263 > 8 · 1018 .

Ora, assumendo che una pila di 8 euro abbia spessore di 1 cm (in realta’

ne bastano di meno per fare 1 cm, per cui stiamo ancora sottostimando),

abbiamo che la pila è alta almeno 10 18 centimetri. Siccome 105 cm = 1km,

la pila è alta almeno 1013 km. La distanza della Terra dalla Luna è di circa

4 · 105 km. Per cui questa pila va ben oltre la Luna! Quanto oltre? La

distanza della Terra dal Sole è di circa 2 · 10 7 km. Per cui la nostra pila

sarebbe (almeno) 500’000 volte più lunga che la distanza da qui al Sole!

Da questo esempio si è visto che, per avere approssimazioni inferiori al

valore di 2n si possono rimpiazzare i gruppi di dieci “2” con gruppi di tre

“10”. Oppure, siccome 24 = 16 < 10, possiamo rimpiazzare ogni quattro

“2” con un “10”. Per avere approssimazioni superiori, siccome 2 3 = 8 < 10,

possiamo rimpiazzare ogni tre “2” con un “10”. Per cui

8 · 1018 < 263 < 1021

(1.36)

Per ottenere esattamente l’esponente y tale che 10 y = 2x bisognerebbe

dividere x per circa 3.32 (o meglio per il log 2 10).

Il fattoriale cresce almeno come 2n e al massimo come nn . Questi sono

limiti molto lontani l’uno dall’altro. Si può migliorare un po’ il limite inferiore notando che tutti i fattori da 10 in su in n! valgono almeno 10, per cui

n! > 10n−9 . La miglior stima per la crescita di n! è la seguente, che diamo

senza dimostrazione. Per n grande, n! vale circa

n n√

( ) 2πn

e

(1.37)

dove e = 2.718.. è la costante di Nepero. In prima approssimazione, possiamo dire che n! cresce (almeno) come (n/3) n .

Sia dato un gruppo di n persone (sul come si sono trovati i valori che

seguono verrà data spiegazione più avanti. Per ora li si prenda per buoni).

Se fanno un torneo di tennis, definiamo A(n) il numero di partite che il

vincitore dovrà avere giocato alla fine del torneo. A(n) è (almeno) log 2 n.

Esattamente, A(n) è il minimo intero non inferiore a log 2 n (ossia, l’arrotondamento, per eccesso, di log 2 n ad intero, indicato con dlog 2 ne). Vengono

estratti 2 premi fra le persone. Avere vinto il primo premio non impedisce

di partecipare alla seconda estrazione. Sia B(n) il numero di possibili coppie

22

CAPITOLO 1. PRELIMINARI MATEMATICI

(vincitori del primo premio, vinciore del secondo premio). B(n) è n 2 . Successivamente, viene tirata una moneta per n volte, e ogni persona per cui

esce “testa” riceve un premio. Sia C(n) il numero di modi in cui la suddetta

premiazione può avere luogo. Si ha C(n) = 2 n . Infine, le n persone escono

una alla volta da una stanza. Sia D(n) il numero di modi in cui ciò può

avvenire. C(n) = n!. Per esercizio, si completi (anche con valori approssimati) la seguente tabella

n

1

2

3

4

8

10

16

20

30

50

64

100

A(n)

0

1

2

2

3

4

B(n)

1

4

9

16

64

100

C(n)

2

4

8

16

256

1024

D(n)

1

2

6

24

40320

3628800

Capitolo 2

Piccioni e buche

In questo capitolo studiamo un principio elementare ma molto importante, il

principio della piccionaia. In pratica, il principio dice che, se molti piccioni

volano in una piccionaia con poche buche, in almeno una buca finiranno due

o più piccioni.

2.1

Il principio della piccionaia, forma semplice

La forma più semplice del teorema è la seguente:

Teorema 1: Se n + 1 oggetti vengono posti in n contenitori, allora almeno

un contenitore conterrà due o più oggetti.

Dim:

Per assurdo, se ogni contenitore contenesse al più un oggetto, si

avrebbe che il numero totale di oggetti è al più n. Ma noi abbiamo supposto

che tale numero è n + 1.

♣

Esercizio 2.1. Si dimostri il principio della piccionaia per induzione.

Si noti che nè il teorema nè la sua dimostrazione danno indicazioni su

quale contenitore abbia più di un oggetto. L’unica cosa che possiamo affermare con certezza è l’esistenza di un tale contenitore. Si noti inoltre che

il principio vale solo se si hanno almeno n + 1 oggetti. Infatti, si possono

mettere n oggetti in n contenitori senza che due oggetti vadano nello stesso

contenitore.

Esempio. In un gruppo di 367 persone ce ne sono almeno due con lo stesso

compleanno.

23

24

CAPITOLO 2. PICCIONI E BUCHE

Esempio. Una persona possiede n paia di scarpe, ogni paio di un colore

diverso. Quante scarpe deve prendere come minimo, al buio, per essere

sicuro di aver selezionato almeno un paio di scarpe dello stesso colore?

Prendendo n scarpe, non può avere la certezza di un paio completo

(potrebbero essere tutte di colore diverso). Con n + 1 scarpe, ce ne devono

essere due dello stesso colore.

Si supponga ora che tutte le paia di scarpe siano identiche (stesso colore

e forma). Quante scarpe vanno prese al buio per essere sicuri di selezionare

un paio sinistra/destra con cui poter uscire?

Dal principio della piccionaia seguono due altri semplici principii:

1. Se n oggetti vengono posti in n scatole, e nessuna scatola è vuota,

allora ogni scatola contiene esattamente un oggetto.

2. Se n oggetti vengono posti in n scatole, e nessuna scatola contiene più

di un oggetto, allora ogni scatola contiene esattamente un oggetto.

Per esercizio li si dimostri.

Esempio. Un campione di tennis ha 9 settimane per prepararsi a un

grande torneo. Decide allora di giocare almeno una partita di allenamento

al giorno, ma, per non stancarsi troppo, non più di 10 partite alla settimana.

Si dimostri che esiste una successione di giorni durante i quali il campione

gioca esattamente 35 partite.

Sia p1 il numero di partite giocate fino al primo giorno, p 2 il numero di

partite giocate fino al secondo (ossia giocate il primo e il secondo giorno)

e cosı̀ via fino a p63 . Si ha p1 < p2 < . . . < p63 . Inoltre, siccome in ogni

settimana non gioca più di 10 partite, p 63 ≤ 9 × 10 = 90. Quindi

1 ≤ p1 < p2 < . . . < p63 ≤ 90.

Sommando 35 a ogni numero p1 , . . . , p63 abbiamo ancora una sequanza

crescente:

36 ≤ p1 + 35 < p2 + 35 < . . . < p63 + 35 ≤ 125.

Quindi, ciascuno dei 126 numeri

p1 , p2 , . . . , p63 , p1 + 35, p2 + 35, . . . < p63 + 35

è un numero compreso tra 1 e 125. Ne consegue che almeno due numeri sono

uguali. Questi non possono essere del tipo p i , pj nè del tipo pi + 35, pj + 35,

2.2. IL PRINCIPIO DELLA PICCIONAIA, FORMA FORTE

25

quindi esistono i e j tali che pi = pj + 35. Ne consegue che nei giorni

j + 1, j + 2, . . . , i il tennista ha giocato esattamente 35 partite.

Esempio. Si scelgano 101 interi compresi tra 1 e 200. Si dimostri che tra gli

interi scelti, ce ne sono almeno due tali che uno di essi è divisibile per l’altro.

Nella fattorizzazione di ogni intero, possiamo raggruppare tutti i fattori

2, in modo che l’intero risulti una potenza di 2 per un numero dispari, ossia

del tipo 2k × d con d dispari. Siccome i nostri numeri sono compresi tra 1 e

200, d deve essere uno tra 1, 3, 5, . . . , 199. Ci sono 100 tali numeri dispari e

abbiamo preso 101 interi, per cui (almeno) due di questi hanno lo stesso d,

ossia sono del tipo a = 2n × d e b = 2m × d. Per cui, se a ≤ b, a divide b,

altrimenti b divide a.

Esercizio 2.2. * Dimostrare che, scelti 100 numeri compresi tra 1 e 200,

di cui almeno uno sia < 16, allora fra i numeri scelti ci sono due numeri tali

che l’uno divide l’altro.

2.2

Il principio della piccionaia, forma forte

Il seguente teorema generalizza il Teorema 1:

Teorema 2: Siano r1 , r2 , . . . , rn interi positivi. Se

r1 + r 2 + · · · + r n − n + 1

oggetti vengono posti in n scatole, allora, o la prima scatola contiene almeno

r1 oggetti, o la seconda ne contiene almeno r 2 , . . . , o la n-sima ne contiene

almeno rn .

Dim:

Per assurdo. Supponiamo che per ogni 1 ≤ i ≤ n la scatola i

contenga meno di ri oggetti. In particolare, ne contiene al massimo r i − 1.

Allora, il numero totale di oggetti sarebbe al massimo di (r 1 − 1) + (r2 −

1) + · · · + (rn − 1), ossia, al massimo r1 + r2 + · · · + rn − n. Ma noi abbiamo

supposto che fossero r1 + r2 + · · · + rn − n + 1.

♣

Si noti che sarebbe possibile distribuire r1+r2+· · · +r n −n gli oggetti in

n contenitori senza mettere due oggetti nello stesso contenitore (mettendone

r1 − 1 nel primo, r2 − 1 nel secondo, ecc.).

Questo teorema generalizza il precedente, in quanto, se r 1 = r2 = . . . =

rn = 2 si ottiene esattamente il Teorema 1.

26

CAPITOLO 2. PICCIONI E BUCHE

Come importanti conseguenze del Teorema 2 studiamo il caso in cui

r1 = r2 = . . . = rn = q. In questo caso si ha

• Se n(q − 1) + 1 oggetti sono messi in n scatole, allora almeno una delle

scatole contiene q o più oggetti, o, allo stesso modo

• Se la media di n interi non-negativi a 1 , a2 , . . . , an è maggiore di q − 1

a1 + a 2 + · · · + a n

>q−1

n

allora almeno uno dei numeri a1 , . . . an è maggiore o uguale a q.

Quest’ultimo risultato è particolarmente importante e va ricordato, per

cui lo ripetiamo, anche se cambiandolo un po’:

Il massimo di n numeri naturali non può essere più piccolo della loro media

Chiaramente, se prendiamo n numeri tutti più piccoli di q, anche la

media sarà più piccola di q. Per cui, se si sa che la media è almeno pari a q,

anche uno dei numeri deve essere almeno pari a q. In particolare, siccome

la media è almeno pari alla media (in effetti, è proprio pari alla media!),

almeno uno dei numeri (e tantopiù il massimo) deve valere almeno quanto

la media.

Esercizio 2.3. Si vuole comporre un mazzo di fiori che abbia almeno

10 rose, o almeno 5 margherite, o almeno 8 tulipani. Quanti fiori deve

contenere, come minimo, un tale mazzo?

Esercizio 2.4. John, Mary e Paul sono tre attori che appaiono in esattamente 10 film. Nessuno di loro ha però girato tutti i film. In particolare,

John è presente in 8 dei 10 film, Mary in 7 e anche Paul in 7. In quanti dei

10 film, come minimo, appaiono tutti e 3 gli attori insieme? In quanti come

massimo?

Esempio. Un bambino ha 3 album nuovi di figurine, uno da 100 uno da

80 e uno da 60 figurine. In strada trova un venditore che vende bustine di

figurine dei 3 album. Ogni bustina contiene 2 figurine, non necessariamente

dello stesso album. Nessuna bustina contiene due figurine uguali nè una

medesima figurina può trovarsi in due bustine diverse. Quante bustine deve

acquistare come minimo il bambino per essere sicuro di completare almeno

un album?

Ci sono 3 scatole (i 3 album). Per essere sicuro di completare uno dei tre

2.2. IL PRINCIPIO DELLA PICCIONAIA, FORMA FORTE

27

album, il bambino ha bisogno di (100 − 1) + (80 − 1) + (60 − 1) + 1 = 238

figurine. Siccome le figurine vengono in pacchetti da 2, dovrà acquistarne

come minimo 119 pacchetti.

Esempio. Supponiamo di avere due dischi concentrici, entrambi divisi in

200 settori uguali fra loro. Nel disco esterno, si dipingano arbitrariamente

100 settori rossi e gli altri 100 blu. Nel disco interno, si dipingano a piacere

i settori con i colori rosso e blu, ma senza alcun vincolo (ossia non devono

necessariamente esserci 100 settori rossi e 100 blu). Si dimostri che è possibile ruotare il disco interno in modo che ci siano almeno 100 settori sul disco

interno che vengono a combaciare con settori dello stesso colore sul disco

esterno.

Cominciamo con l’osservare che, tenendo fermo il disco esterno, ci sono 200

possibili rotazioni del disco interno rispetto al disco esterno (una per per

ogni possibile settore j del disco interno, che viene allineato al settore 1 del

disco esterno). Contiamo tutte le volte che due settori dello stesso colore

vengono allineati, su tutte le le 200 possibili rotazioni. Siccome il disco esterno ha 100 settori di ognuno dei due colori, ogni settore del disco interno

sarà (al girare del disco interno) allineato con esattamente 100 settori del

disco esterno dello suo colore. Per cui, il numero totale di volte che due settori dello stesso colore sono allineati sarà di 200 (numero dei settori interni)

volte 100 (numero di volte che ogni settore si allinea a un settore dello stesso

colore), ossia 20000. Quindi, il numero medio di coppie di settori dello stesso

colore per ogni possibile rotazione è 20000/200 = 100. Per cui c’è almeno

una rotazione che porta ad avere questo numero medio o più ossia almeno

100 settori che combaciano con settori dello stesso colore.

Quest’ultimo esempio è particolarmente importante, e merita una riflessione.

È un’esempio del metodo probabilistico. Supponiamo che il cerchio interno

sia imperniato (come il tamburo della roulette) in maniera tale da potergli

imprimere una forza che lo fa ruotare, in maniera casuale, fino a fermarsi

in una delle 200 rotazioni possibili. A questo evento casuale (la rotazione

del tamburo) associamo un valore (detto variabile casuale, si veda, nel seguito, la sezione 5.2) pari al numero di coppie allineate dello stesso colore.

Il calcolo che abbiamo svolto sopra ci dice, fondamentalmente, che il valor

medio della variabile in questione (cioè il numero di coppie di colore uguale

che in media l’esperimento determinerà) è pari a 100. E questo ci porta

a concludere che l’esito dell’esperimento deve poter essere di 100 o più in

almeno qualche caso.

28

CAPITOLO 2. PICCIONI E BUCHE

Esercizio 2.5. Ad una festa si presentano 100 persone. Ogni persona è

amico di un numero pari di altre persone (al limite 0). Dimostrare che ci

sono almeno 3 persone con lo stesso numero di amici.

Capitolo 3

Contiamo!

3.1

Principi fondamentali: somma e prodotto

In questa sezione studiamo i seguenti problemi:

• Ci sono elementi di k tipi diversi, dei quali n 1 del primo tipo, n2 del

secondo tipo, ..., nk dell’ultimo tipo. In quanti modi si può scegliere

un elemento del primo tipo o del secondo tipo . . . o dell’ultimo tipo?

• Come prima, ci sono elementi di k tipi diversi, dei quali n 1 del primo

tipo, n2 del secondo tipo, ..., nk dell’ultimo tipo. In quanti modi si può

scegliere un elemento del primo tipo e uno del secondo tipo . . . e uno

dell’ultimo tipo?

3.1.1

Il principio della somma

Dato un insieme S, una partizione di S è una collezione di sottoinsiemi di

S, S1 , . . . , Sk tali che

S = S 1 ∪ S2 ∪ . . . S k

e

Si ∩ S j = ∅

(i 6= j)

Data una tale partizione, il principio della somma afferma che:

|S| = |S1 | + |S2 | + · · · + |Sn |.

(3.1)

Esempio. Per contare il numero di iscritti all’università di Udine, si possono sommare gli iscritti di Ingegneria agli iscritti di Scienze, a quelli di

Lingue, ecc (tutte le facoltà). Oppure, si possono sommare gli iscritti provenienti da Udine, a quelli provenienti da Gorizia, da Trieste, da Padova, da

29

30

CAPITOLO 3. CONTIAMO!

... (tutte le possibili provenienze)

Esempio. Per un ruolo di comparsa si presentano 3 giovani uomini, 2

giovani donne, e 5 anziani. In quanti modi può essere scelta la comparsa?

In 3+2+5 = 10 modi.

Alle volte, per contare la cardinalità di S può convenire non tanto partizionare S in sottoinsiemi, ma considerare un sovrainsieme A di S e il complementare C di S rispetto ad A, a patto che le cardinalità di A e di C siano

facili da calcolare. In tal caso infatti, il principio della somma applicato a

A da’

|A| = |S| + |C|

(3.2)

da cui

|S| = |A| − |C|

(3.3)

Esempio. Quanti sono i numeri di 2 cifre che non contengono la cifra 0

e che hanno cifre diverse fra loro? Possiamo considerare come sovrainsieme

l’insieme A di tutti i numeri di 2 cifre. |A| = 100. Il complementare C di

S in questo esempio è dato dall’insieme dei numeri che hanno almeno una

cifra 0, o hanno entrambe le cifre uguali. Ripartiamo C come C 1 (l’insieme

dei numeri che hanno la prima cifra uguale a 0), C 2 (l’insieme dei numeri

che hanno la seconda, ma non la prima, cifra uguale a 0) e C 3 (l’insieme

dei numeri che hanno entrambe le cifre uguali, ma diverse da 0). Abbiamo C1 = {00, 01, . . . , 09}, e quindi |C1 | = 10; C2 = {10, 20, . . . , 90}, e

quindi |C2 | = 9; C3 = {11, 22, . . . , 99}, e quindi |C3 | = 9. Ne consegue

|S| = |A| − (|C1 | + |C2 | + |C3 |) = 100 − (10 + 9 + 9) = 72.

3.1.2

Il principio del prodotto

Sia S l’insieme di tutte le coppie ordinate del tipo (a, b), dove il primo

elemento può essere scelto in p modi, e, per ogni scelta del primo, si può

scegliere il secondo in q modi. Allora

|S| = p × q.

(3.4)

Possiamo dimostrare questo principio tramite il principio della somma. Siano

{a1 , . . . , ap } le p scelte possibili per a. Ripartiamo S in questo modo: tutte

le coppie che cominciano per a1 (ossia del tipo (a1 , b), con q scelte per b),

3.1. PRINCIPI FONDAMENTALI: SOMMA E PRODOTTO

31

quelle che cominciano per a2 (ossia del tipo (a2 , b)), . . ., quelle che cominciano per ap (ossia del tipo (ap , b)). Ognuno di questi sottoinsiemi ha q

elementi e ci sono p sottoinsiemi, per cui S = p × q.

Esempio. Riconsideriamo l’esempio precedente. Per creare un numero di

2 cifre, in cui nessuna cifra è 0, e le cifre sono diverse, possiamo scegliere

la prima cifra in 9 modi (tutte tranne la 0) e la seconda in 8 modi (tutte

tranne la 0 e la prima). Per cui, ci sono 9 × 8 = 72 possibilità.

Il principio precedente si estende immediatamente al caso più generale

di più di due scelte in sequenza. Ad esempio, supponendo di dover scegliere

una sequenza di n elementi (a1 , . . . , an ) (ossia una n-pla, che generalizza il

concetto di coppia), in cui ci sono p 1 modi di scegliere a1 , p2 modi (indipendentemente da a1 ) di scegliere a2 , p3 modi (indipendentemente da a1 e a2 )

di scegliere a3 , ecc fino a an , il numero totale di possibili n-ple diverse è

p1 × p 2 × · · · × p n .

(3.5)

Esempio. Riconsideriamo l’esempio delle comparse. Supponendo servano esattamente 1 giovane uomo, 1 giovane donna e 1 anziano, ci sono

2 × 3 × 5 = 30 modi di scegliere queste 3 comparse.

♥ Esercizio 3.1. Quante sono le possibili sequenze di DNA diverse di

lunghezza n?

♥ Esercizio 3.2. Una sequenza proteica è una sequenza di amino acidi.

Esistono 20 amino acidi, numerati da 1 a 20. Quante sono le possibili sequenze proteiche di lunghezza n che terminano con l’amino acido 10 e non

contengono l’amino acido 10 in alcuna altra posizione?

♥ Esercizio 3.3. Ogni persona ha 23 coppie di cromosomi. Nel fare un

figlio, ogni genitore contribuisce con un cromosoma di ogni sua coppia, ossia

con 23 cromosomi singoli. La fusione di 23 cromosomi del padre con 23

cromosomi della madre forma di nuovo un individuo completo, ossia con 23

coppie. In quanti modi diversi questa ricombinazione può avvenire?

Esercizio 3.4. In serie A ci sono 20 squadre. Ogni squadra ha una rosa

di 2 portieri, 6 difensori, 5 centrocampisti e 5 attaccanti. Una squadra deve

scendere in campo con 1 portiere, 4 difensori, 4 centrocampisti e 2 attaccanti.

In quanti modi ogni allenatore può scegliere la formazione da mandare in

32

CAPITOLO 3. CONTIAMO!

prendo a1?

SI

NO

prendo a2?

prendo a2?

SI

{a1,a2,a3}

NO

prendo a3?

prendo a3?

prendo a3?

SI

{a1,a2} {a1,a3}

NO

SI

NO

SI

NO

{a1}

SI

{a2,a3}

prendo a3?

NO

SI

NO

{a2}

{a3}

{}

Figura 3.1: Albero binario di tutti i sottoinsiemi

campo? In quanti modi il selezionatore della nazionale può convocare un

gruppo di 3 portieri, 7 difensori, 6 centrocampisti e 6 attaccanti attingendo

da tutte le squadre?

3.2

Combinazioni (sottoinsiemi)

Studiamo il problema di determinare il numero di sottoinsiemi di un insieme.

Siano n gli elementi di un insieme A = {a 1 , . . . , an }. Un sottoinsieme si

può creare rispondendo alle domande: contiene a 1 ? contiene a2 ? ... contiene

an ? Ogni domanda ha due possibili risposte. Ci sono in tutto

2 · 2 · 2 . . . 2 · 2 = 2n

(3.6)

possibili risposte, ossia 2n possibili sottoinsiemi. Il sottoinsieme vuoto

corrisponde a tutte risposte “no”, A stesso corrisponde a tutte risposte “sı̀”.

In Figura 3.1 è descritto un diagramma (detto albero) in cui si può vedere

come, dopo k decisioni ci siano 2k possibilità. In fondo al diagramma (nelle

foglie dell’albero) si trovano tutti i possibili sottoinsiemi.

Un sottoinsieme ha cardinalità k solo se ci sono state k risposte “sı̀”e n−k

risposte “no”. Vediamo in quanti modi questo può avvenire. Per definizione

il numero di modi di scegliere k oggetti da n (ad esempio, scegliere

a quali

n

delle n domande si è risposto “sı̀”), è detto n su k (scritto

)

ed

è

detto

k

n

anche coefficiente binomiale. Per vedere quanto vale k si può ragionare

cosi’. Supponiamo di rendere diversi tra loro i k “sı̀” (ad esempio colorandoli

rosso, blu, verde - con k colori diversi). Allo stesso modo, si rendano diversi

gli n − k “no”. A questo punto, ci sono n! modi diversi di rispondere alle n

3.2. COMBINAZIONI (SOTTOINSIEMI)

33

domande, in cui ci sono i k “sı̀” mescolati con gli n − k “no”. Ora si fissi

uno di questi modi (una tra le n! permutazioni). Scambiando fra loro i vari

“sı̀”in uno qualsiasi dei k! modi, restano identificati gli stessi k elementi. E

anche scambiando fra loro (permutando) gli n − k “no”. Per cui, la stessa

scelta di elementi è identificata da k!(n − k)! permutazioni diverse (quelle in

cui restano fisse le posizioni dei “sı̀” e dei “no”. Ne consegue che il numero

di scelte di elementi è

!

n

n!

=

k!(n − k)!

k

(3.7)

Un modo pratico di ricordare la formula, è di mettere k numeri, in

maniera decrescente a partire da n al numeratore, e a partire da k al

denominatore, e calcolare la frazione. Ad es:

14

5

!

=

14 · 13 · 12 · 11 · 10

= 14 · 13 · 11 = 2002.

5·4·3·2·1

(3.8)

Esempio.

Quante sono le possibili cinquine su una ruota fissa? Sono

90

0 9490 268.

=

43

5

.

Vediamo ora alcune formule importanti sul coefficiente binomiale:

Teorema 3:

n

k

=

n−1

k

+

n−1

k−1

Dim:

Fissato un elemento, ci sono 2 possibilità per fare un sottoinsieme

di k elementi: o l’elemento non è nel sottoinsieme (e quindi ci sono n−1

k

sottoinsiemi possibili di questo tipo), oppure è nel sottoinsieme (e quindi

bisogna scegliere k − 1 altri elementi fra i rimanenti n-1).

♣

Esercizio 3.5. Dimostrare il teorema 3 algebricamente, a partire dalla

formula per il coefficiente binomiale.

Il ragionamento precedente può essere generalizzato in questo modo.

Dovendo scegliere un sottoinsieme di dimensione k, si supponga di fissare p

elementi, con 1 ≤ p ≤ k. Allora, o l’insieme non contiene alcuno di questi p

elementi, o ne contiene uno, o ne contiene due, . . ., o li contiene tutti. In

ognuna di queste situazioni, supponendo che il sottoinsieme ne contenga i

tra i p fissati, i rimanenti k − i vanno scelti dagli n − p non fissati. Inoltre,

gli i possono essere presi in pi modi. Ne consegue:

n

k

!

=

p

X

p

i=0

i

!

!

n−p

.

k−i

(3.9)

34

CAPITOLO 3. CONTIAMO!

Teorema 4:

n

k

=

n n−k

Dim:

Si può dimostrare dalla formula. Oppure, pensando al significato:

scegliere i k elementi da tenere equivale a scegliere gli n − k da scartare. ♣

Altre formule importanti:

n

n

!

=

n

1

n

2

!

!

!

n

=1

0

=n

= n(n − 1)/2 (il numero di coppie distinte di 2 elementi)

n

p

Esercizio 3.6. Quanto vale

!

Pn

= 0, per p > n

i=0

n

i

?

Esempio. Quanti sono i sistemi al totocalcio da10 triple e 3 fisse? Ci sono

13 partite. Le triple possono essere scelte in 13

9 = 715 modi. Per ognuno

di tali modi, si possono completare le rimanenti 4 parite in 3 4 = 729 modi

(ossia ogni fissa può essere scelta tra 1, 2 e X, e se ne devono scegliere 4).

In totale abbiamo 715 × 729 = 521235 possibilità.

Esercizio 3.7. Dati a, b e c tali che a + b + c = 13, quanti sono i sistemi

da a fisse, b doppie e c triple?

Esercizio 3.8. Quattro giocatori fanno una mano di poker, usando un

intero mazzo da 52 carte. In quanti modi diversi possono essere distribuite

le carte, sapendo che a ogni giocatore vengono date 5 carte?

3.2.1

Triangolo di Pascal

Il triangolo di Pascal è ottenuto in questo modo: si creano delle righe (numerate da 0 in poi) e in ogni riga i ci sono i + 1 elementi (numerati da 0 a

i). L’elemento k della riga n vale nk . Disponendoli in triangolo si ottiene

lo schema

3.2. COMBINAZIONI (SOTTOINSIEMI)

35

1

1

1

1

1

1

3

4

5

1

2

1

3

6

10

1

4

10

1

5

1

Si noti che per via del teorema 3 un elemento è ottenuto dalla somma

dei due elementi sopra a lui (a sin e dx).

Supponiamo di volere calcolare lo sviluppo di (a + b) n . Ossia

Π = (a + b)(a + b) · · · (a + b)

Lo sviluppo sarà del tipo

c(i, j)ai bj , dove la somma è estesa a tutte le

coppie di i e j tali che i + j = n. Scegliendo a da i termini in Π e b dai

rimanenti n − i si ottieneun termine

a i bn−i . Questo può essere fatto in ni

n

n

modi (per cui c(i, j) = i = j nell’espressione precedente). Si ottiene

P

n

(a + b) =

n

X

n

i=0

i

!

ai bn−i

(3.10)

Ad es. dalla riga 5 del triangolo di Pascal, si ottiene

(a + b)5 = a5 + 5a4 b + 10a3 b2 + 10a2 b3 + 5ab4 + b5

(3.11)

♥ Esempio. L’allineamento di 2 sequenze di DNA, una di lunghezza n e

l’altra di lunghezza m ≥ n consiste nel disporle una sopra l’altra, inserendo

spazi (detti gap, e indicati con “-”) nelle due in modo che diventino della

stessa lunghezza, ma senza mai mettere due spazi “-” uno sopra l’altro.

Ad esempio, questo è un possibile allineamento delle sequenze ATCCGA e

TCAAAGA:

ATCC---GA

-T-CAAAGA

Mentre il seguente allineamento non risulta valido:

A-TCC---GA

--TCAA-AGA

Quanti sono i possibili diversi allineamenti validi di due sequenze?

36

CAPITOLO 3. CONTIAMO!

Si può ragionare cosı̀: la lunghezza l delle due sequenze allineate va’ da

un minimo di m a un massimo di n + m. Per ognuna di tali lunghezze, si

può piazzare la sequenza più piccola (la prima) in nl modi, occupando n

delle l posizioni con lettere, e le rimanenti l − n con gaps. Siccome a ognuno

dei gap deve corrispondere una lettera vera della seconda sequenza, restano

m − (l − n) lettere da mettere nelle n posizioni corrispondenti a lettere della

prima sequenza. Otteniamo che gli allineamenti sono

n+m

X

l=m

l

n

!

n

m−l+n

!

3.3

Disposizioni (sottoinsiemi ordinati)

Supponiamo di voler selezionare una sequenza di k oggetti da un insieme

di n, e che quindi l’ordine degli oggetti abbia importanza (come insiemi,

{3, 1, 2} = {1, 2, 3}, ma come sequenze, ossia insiemi ordinati, (3, 1, 2) 6=

(1, 2, 3)).

Il numero di sottoinsiemi ordinati di dimensione k si dice anche disposizioni di n oggetti a k a k e si indica con D(n, k). Siccome ogni sottoinsieme

di dimensione k può essere ordinato in k! modi, abbiamo

D(n, k) =

!

n

k!

k

(3.12)

Mnemonicamente, D(n, k) è il prodotto dei primi k numeri decrescenti,

a partire da n:

D(n, k) =

n!

= n(n − 1) · · · (n − k + 1).

(n − k)!

Casi speciali: D(n, 0) = 1, D(n, 1) = n, D(n, n) = n! e D(n, m) = 0 per

m > n.

Esempio. Quante sono le possibili estrazioni al lotto sulla ruota di Venezia?

Sono 90 · 89 · 88 · 87 · 86.

Esercizio 3.9. Quanti codici di 4 lettere diverse si possono formare scegliendo le lettere dall’insieme {A, B, K, L, M, P}?

3.4. RIPETIZIONI E MULTI-INSIEMI

37

Esercizio 3.10. In quanti modi p ragazzi possono essere assegnati a q

famiglie disposte a ospitarli, al più uno per famiglia, per una vacanza all’estero, con p ≤ q?

3.4

Ripetizioni e multi-insiemi

Un multi-insieme è costituito da un insieme S = {a 1 , . . . , ak } in cui gli

elementi possono essere ripetuti più volte. Il numero di volte che a i è presente

in S si indica con ni ed è detto numero di ripetizioni. La scrittura concisa

di un multi-insieme è

{n1 · a1 , n2 · a2 , . . . , nk · ak }

(3.13)

Ad esempio, un multi-insieme con tre A, quattro B e due C si indica

come

{3 · A, 4 · B, 2 · C}

Una possibile permutazione di questi elementi è AABCABBCB. Un’altra

è BBACCABAB. Vogliamo contare quente sono le permutazioni di un multiinsieme.

Esempio. Quanti sono gli anagrammi della parola MISSISSIPPI?

Si può guardare alla parola come al multi-insieme {1 · M, 4 · I, 4 · S, 2 · P }.

Supponiamo di considerare tutte le 11! permutazioni delle lettere (anagrammi). Per ognuna di tali permutazioni, possiamo scambiare fra di loro le I (o

le S, o le P,...) e l’anagramma rimane lo stesso. Le 4 I si possono riordinare

11!

in 4! modi, e similmente per le altre lettere. Si ottiene un totale di 1!·4!·4!·2!

possibilità.

Generalizziamo il risultato dell’esercizio precedente:

Teorema 5: Sia S un multi-insieme con oggetti di k tipi e numeri di

ripetizione n1 , n2 , . . . , nk . Sia n la dimensione di S, dove n = n1 + n2 + · · · +

nk . Allora il numero di permutazioni di S è pari a

n!

n1 !n2 ! · · · nk !

Dim:

Siano a1 , a2 , . . . , ak gli elementi di S, con ai ripetuto ni volte, per

i = 1, . . . , k. Possiamo costruire una permutazione di S in questo modo.

Dobbiamo riempire n posizioni con i nostri oggetti. Prima piazziamo gli n 1

elementi di tipo a1 . Questo può essere fatto in nn1 modi. Tra le rimanenti

38

CAPITOLO 3. CONTIAMO!

n − n1 posizioni, piazziamo gli n2 elementi di tipo a2 . Questo si può fare in

n−n1

modi. Proseguiamo in questo modo fino alla fine, ossia fino a piazzare

n2

gli nk oggetti di tipo ak nelle n − n1 − n2 − · · · − nk−1 posizioni rimaste (si

noti che nk = n − n1 − n2 − · · · − nk−1 e quindi questo può essere fatto in

un unico modo). Si ottiene che il numero di permutazioni è

n

n1

!

n − n1

n2

!

!

n − n 1 − n2

n − n1 − n2 − · · · nk−1

···

n3

nk

!

Dalla definizione di coefficiente binomiale, si ottiene che il numero è

uguale a

(n − n1 )!

(n − n1 − n2 )!

n!

·

·

···

n1 !(n − n1)! n2 !(n − n1 − n2 )! n3 !(n − n1 − n2 − n3 )!

Semplificando numeratori e denominatori, si ottiene

n!

n1 !n2 ! · · · nk !

♣

3.4.1

Combinazioni con ripetizioni

Supponiamo dato un multi-insieme S = {n 1 · a1 , n2 · a2 , . . . , nk · ak }. Supponiamo di voler prendere r elementi di S. Ogni sottoinsieme di r elementi

di S si chiama una r-combinazione di S.

Esempio. Sia S = {2 · a, 1 · b, 3 · c}. Allora le 3-combinazioni di S sono:

{2 · a, 1 · b}, {2 · a, 1 · c}, {1 · a, 1 · b, 1 · c}, {1 · a, 2 · c}, {1 · b, 2 · c} e {3 · c}.

Supponiamo ni ≥ r per ogni i (in modo tale che ci sia una quantità

sufficiente di elementi di tipo ai per poter, al limite, prendere gli r elementi

tutti dello stesso tipo). Per calcolare quante sono le r permutazioni di S,

dobbiamo scegliere quanti prenderne per ognuno dei k tipi, in modo da

prenderne esattamente r in totale.

Questo problema corrisponde al problema di ripartire r elementi in k

gruppi, che a sua volta corrisponde a risolvere l’equazione

x1 + x 2 + . . . + x k = r

(3.14)

dove ogni xi è un numero intero, 0 ≤ xi ≤ r. Ci chiediamo quante sono