ANNO ACCADEMICO 2008-2009

Facoltà di Scienze Matematiche, Fisiche e Naturali

Corso di Laurea in Fisica

Tesi di Laurea

Dinamica di reti neurali diluite

con accoppiamento impulsivo

Candidata:

Simona Olmi

Relatore:

Correlatore:

prof. Roberto Livi

dott. Alessandro Torcini

25 giugno 2009

Indice

Introduzione

1

1 Elementi di neurofisiologia

5

1.1 I neuroni . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6

1.2 I segnali neuronali ed il potenziale di azione . . . . . . . . . . . . . .

7

1.3 Le sinapsi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9

1.4 Introduzione alla dinamica neuronale . . . . . . . . . . . . . . . . . . 11

1.5 La membrana cellulare del neurone . . . . . . . . . . . . . . . . . . . 13

1.6 Canali ionici e correnti ioniche . . . . . . . . . . . . . . . . . . . . . . 15

1.7 Origine del potenziale di riposo . . . . . . . . . . . . . . . . . . . . . 17

1.7.1

Un modello cellulare semplificato . . . . . . . . . . . . . . . . 17

1.7.2

L’equazione di Nerst . . . . . . . . . . . . . . . . . . . . . . . 19

1.7.3

Effetto del sodio e pompe ioniche . . . . . . . . . . . . . . . . 20

1.7.4

Effetto della permeabilità ionica e dei meccanismi di trasporto 21

1.8 Proprietà elettriche passive della membrana . . . . . . . . . . . . . . 23

2 Modelli semplificati di neuroni

26

2.1 Dal modello di Hodgkin-Huxley al modello leaky integrate-and-fire . . 28

2.2 Neuroni leaky integrate-and-fire . . . . . . . . . . . . . . . . . . . . . 33

2.2.1

Correnti sinaptiche . . . . . . . . . . . . . . . . . . . . . . . . 36

I

2.2.2

Adattamento della frequenza di emissione degli impulsi e refrattarietà . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

3 Modelli di reti neurali ad accoppiamento impulsivo

3.1 Reti neurali con accoppiamento impulsivo

41

. . . . . . . . . . . . . . . 42

3.1.1

Modello di rete di neuroni LIF globalmente accoppiati . . . . 44

3.1.2

Mappa guidata dall’evento . . . . . . . . . . . . . . . . . . . . 47

3.1.3

Analisi di stabilità lineare . . . . . . . . . . . . . . . . . . . . 49

3.2 Impulsi di durata finita . . . . . . . . . . . . . . . . . . . . . . . . . . 51

3.2.1

Lunghezze d’onda grandi . . . . . . . . . . . . . . . . . . . . . 53

3.2.2

Lunghezze d’onda brevi

3.2.3

Diagramma di fase e correzioni di taglia finita . . . . . . . . . 54

3.2.4

Altri stati collettivi della rete . . . . . . . . . . . . . . . . . . 57

. . . . . . . . . . . . . . . . . . . . . 54

3.3 Desincronizzazione in reti neurali diluite . . . . . . . . . . . . . . . . 60

4 Dinamica di una rete neurale eccitatoria diluita

66

4.1 Modello della rete in tempo continuo . . . . . . . . . . . . . . . . . . 68

4.1.1

Mappa ad evento guidato . . . . . . . . . . . . . . . . . . . . 69

4.1.2

Algoritmo numerico . . . . . . . . . . . . . . . . . . . . . . . . 71

4.1.3

Scelta aleatoria delle connessioni

. . . . . . . . . . . . . . . . 72

4.2 Analisi di stabilità lineare . . . . . . . . . . . . . . . . . . . . . . . . 74

4.2.1

Reti globalmente accoppiate . . . . . . . . . . . . . . . . . . . 76

4.2.2

Reti diluite . . . . . . . . . . . . . . . . . . . . . . . . . . . . 79

4.3 Diagramma di biforcazione . . . . . . . . . . . . . . . . . . . . . . . . 82

4.4 Disordine quenched . . . . . . . . . . . . . . . . . . . . . . . . . . . . 89

4.5 Disordine annealed . . . . . . . . . . . . . . . . . . . . . . . . . . . . 94

4.6 Confronto con il sistema globalmente accoppiato . . . . . . . . . . . . 100

4.7 Neuroni disaccoppiati guidati dalla rete . . . . . . . . . . . . . . . . . 102

Conclusioni

106

A Fenomenologia delle biforcazioni

109

A.1 Biforcazioni sovra-critiche di punti fissi . . . . . . . . . . . . . . . . . 110

A.2 Biforcazioni sotto-critiche . . . . . . . . . . . . . . . . . . . . . . . . 112

B Metodo della sezione di Poincaré

114

B.1 Mappa di Poincaré . . . . . . . . . . . . . . . . . . . . . . . . . . . . 114

B.2 Sezioni di Poincaré per differenti attrattori . . . . . . . . . . . . . . . 116

C Stabilità lineare

120

C.1 Stabilità lineare di orbite periodiche: moltiplicatori di Floquet . . . . 120

C.2 Esponenti di Lyapunov . . . . . . . . . . . . . . . . . . . . . . . . . . 122

C.2.1 Tecnica di calcolo numerico degli esponenti di Lyapunov . . . 126

C.2.2 Dimensione dell’attrattore . . . . . . . . . . . . . . . . . . . . 128

Introduzione

Il presente lavoro di tesi rientra nell’ambito di un’ampia attività di ricerca che ha

visto, negli ultimi anni, un numero crescente di fisici orientarsi verso problematiche

che un tempo erano dominio di biologi, biochimici o fisiologi. In particolare, a

partire dagli studi pionieristici di A.L. Hodgkin e A.F. Huxley sulla fisiologia del

neurone, per i quali ottennero il premio Nobel nel 1963, si è avuto un trasferimento

continuo ed una sempre più vasta applicazione di metodologie propriamente fisiche

al campo delle neuroscienze. Questo ha portato alla realizzazione di analisi sempre

più accurate delle proprietà strutturali e dinamiche sia dei singoli neuroni che di

circuiti neurali presenti in varie aree del cervello.

Scopo di questa tesi di laurea è lo studio dei comportamenti dinamici collettivi

che emergono in reti neurali diluite, in cui i neuroni sono schematizzati con modelli

semplici, ma tali da riprodurre gli aspetti salienti della dinamica neuronale e da

consentire accurate analisi dinamiche e statistiche di reti molto estese. In particolare, intendiamo caratterizzare tali dinamiche collettive identificando gli attratori

corrispondenti e quantificando il loro grado di caoticità.

Prima di riassumere gli aspetti salienti e i risultati contenuti in questa tesi, ci

preme cercare di inquadrarla in una prospettiva più generale, che fa riferimento ad

aspetti di carattere fondamentale. Negli ultimi tre decenni gli studi di reti neurali

si sono intrecciati profondamente a quelli di meccanica statistica sui ferromagneti

aleatori (o vetri di spin) [1], a partire dal modello per memorie associative introdotto

da J.J. Hopfield nel 1982 [2, 3]. Questo modello di rete neurale, oltre ad aver avuto

applicazioni negli ambiti più vari, dalle neuroscienze alla finanza, è stato molto

rilevante anche per gli studi sulla transizione vetrosa, dato che rappresenta uno dei

pochi modelli di vetri di spin risolubili esattamente nel limite termodinamico.

Negli anni più recenti si è passati, anche grazie allo sviluppo di calcolatori più

potenti che ne hanno consentino analisi statisticamente rilevanti, da reti quali quelle

di Hopfield, ove i neuroni sono schematizzati con variabili binarie, a reti in cui la

dinamica del potenziale di membrana di ogni neurone è descritta da variabili di

stato continue, che evolvono secondo una o più equazioni differenziali. Inoltre, stimolati da osservazioni di fisiologia, si è iniziato a considerare reti con accoppiamenti

maggiormente realistici, che vengono realizzati tramite la trasmissione di impulsi.

Queste reti con accoppiamento impulsivo sono state utilizzate ampiamente sia per

studi di neuroscienze computazionali, che per il processamento di immagini e recentemente si è arrivati ad implementare la dinamica di queste reti anche in modo

“hardware”, grazie all’uso di circuiti integrati programmabili [4].

Nello specifico, in questo lavoro di tesi, si sono considerate reti con accoppiamenti eccitatori in cui l’interazione avviene tramite la trasmissione di impulsi di durata

finita. L’interesse per questi modelli è giustificato non solo da analisi teoriche, ma

anche da evidenze sperimentali. In particolare, studi analitici e numerici, svolti

in precedenza per reti globalmente accoppiate, mostrano come in questi sistemi

emergano spontaneamente stati collettivi stabili caratterizzati da dinamiche assolutamente non banali [5, 6]. D’altra parte sono state evidenziate oscillazioni collettive

anche analizzando “in vitro” l’attività elettrica della corteccia cerebrale di topi appena nati, per i quali è noto che le sinapsi sono solo di tipo eccitatorio, dato che le

interazioni inibitorie appaiono solo dopo qualche giorno dalla nascita [7]. Inoltre è

essenziale indagare la robustezza e la stabilità di queste soluzioni collettive rispetto

alla diluizione delle connessioni presenti, visto che nella corteccia cerebrale i neuroni connessi fra loro sono solo una percentuale del totale [8]. Quindi, in questa tesi

indagheremo gli effetti sulla dinamica di stati collettivi oscillatori dovuti al passaggio

da una rete in cui tutti i neuroni sono connessi con tutti, ad una in cui sia presente

una diluizione stocastica nel numero di connessioni afferenti ed efferenti da un determinato neurone. Ci avvarremo quindi di metodologie proprie della meccanica

statistica e dei sistemi dinamici per investigare le proprietà di sincronizzazione e di

auto-organizzazione di un modello non lineare di rete neurale contenente del disordine nella distribuzione delle connessioni, sia congelato (“quenched”) che generato

dinamicamente (“annealed”).

Il primo capitolo della tesi sarà dedicato ad una breve introduzione di semplici

concetti di neurofisiologia, in particolare si riporteranno una schematica descrizione

del neurone, delle sinapsi e della struttura della membrana cellulare. Si descriverà

poi la fenomenologia della dinamica neuronale, con particolare enfasi sulla generazione del potenziale d’azione in termini della dinamica delle correnti ioniche che

attraversano la membrana neuronale.

Nel secondo capitolo saranno introdotti alcuni modelli usati in letteratura per

riprodurre la dinamica dei neuroni, a partire dal modello fisiologicamente rilevante

di Hodgkin-Huxley, per arrivare ad un modello schematico, ma che riproduce gli

elementi fondamentali della dinamica neuronale, quale il modello leaky integrateand-fire [9]. Quest’ultimo modello è assai usato sia nello studio della risposta di

neuroni singoli a stimoli di varia natura, per le possibilità di trattazione analitica

che consente, sia nelle simulazioni di reti complesse con un gran numero di neuroni,

per la semplicità della sua implementazione da un punto di vista numerico.

Il terzo capitolo sarà dedicato ad una rassegna dei risultati più importanti riguardanti le soluzioni collettive osservate in reti con accoppiamenti impulsivi, sia eccitatori

che inibitori. In particolare, per reti globalmente accoppiate eccitatorie si riporterà

un’analisi di stabilità lineare recentemente sviluppata per stati coerenti in reti ove

gli impulsi scambiati hanno durata finita [10]. Per quanto riguarda le reti con accoppiamento inibitorio ricorderemo i risultati di Jin [11] che mostrano come la dinamica

di reti globalmente accoppiate converga sempre su orbite periodiche stabili; inoltre

menzioneremo i risultati di Zillmer et al. [12], che indicano come la diluizione porti

alla nascita di stati transitori stazionari la cui durata cresce esponenzialmente con

il numero di neuroni.

I contributi originali, riportati nel capitolo quarto, riguarderanno lo studio della

dinamica di una rete neurale eccitatoria con accoppiamento impulsivo. Innanzitutto caratterizzeremo in termini di esponenti di Lyapunov le soluzioni collettive

osservate in reti globalmente accoppiate. Questa analisi evidenzierà come, sia lo

stato asincrono che lo stato parzialmente sincronizzato, siano marginalmente stabili

nel limite termodinamico. Descriveremo inoltre come l’introduzione di disordine in

reti finite destabilizzi queste soluzioni rendendole caotiche. Mostreremo poi, come

al crescere del numero di neuroni della rete, la dinamica del campo medio autoconsistente associato a stati parzialmente sincronizzati converga a quella del caso

globalmente accoppiato, sia in presenza di disordine “quenched” che “annealed”.

Nel limite termodinamico mostreremo che il grado di caoticità del sistema dipende

in modo peculiare dal tipo di disordine introdotto nella rete. Infine riporteremo

indicazioni sull’origine del comportamento caotico osservato.

Nelle conclusioni riassumeremo i principali risultati ottenuti in questa tesi ed

esporremo le possibili prospettive e applicazioni future di questi studi. Infine brevi cenni alla teoria delle biforcazioni saranno riportati nell’Appendice A, mentre

l’Appendice B sarà dedicata ad una introduzione della tecnica della sezione di Poincaré. Infine l’Appendice C sarà dedicata ad una sintetica introduzione dell’analisi

di Floquet e degli esponenti di Lyapunov.

Capitolo 1

Elementi di neurofisiologia

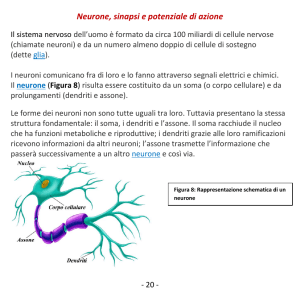

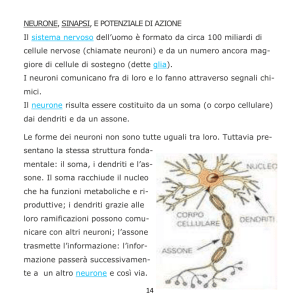

I neuroni sono cellule altamente specializzate e si distinguono dalle altre cellule grazie alla loro abilità nel far propagare rapidamente segnali elettrici su lunghe distanze.

Gli impulsi generati dai neuroni, che viaggiano lungo fibre nervose (dette assoni ),

consentono la codifica e la trasmissione di informazione e sono emessi, in seguito a

stimoli esterni, verso altri neuroni. In questo capitolo introdurremo dunque alcuni concetti basilari relativi alla neurofisiologia del neurone, a cominciare dalla sua

morfologia. Caratteristiche morfologiche salienti del neurone sono i dendriti, che

ricevono gli impulsi in ingresso, provenienti da altri neuroni e l’assone, che porta il

segnale in uscita dal neurone verso le altre cellule. Mentre la struttura ramificata del

dendrite permette al neurone di ricevere segnali in ingresso da molti altri neuroni

attraverso le connessioni sinaptiche, l’assone può attraversare lunghe porzioni del

cervello o, in alcuni casi, trasmettere il segnale del singolo neurone attraversando

l’intera spina dorsale. Nei paragrafi successivi daremo una descrizione schematica

del neurone e delle sinapsi; inoltre descriveremo in dettaglio le caratteristiche della

membrana cellulare, sia a riposo che stimolata, con particolare attenzione alle sue

proprietà elettriche. Oltre agli aspetti morfologici analizzeremo anche gli aspetti

fisiologici del neurone ed in particolare tratteremo i meccanismi che sovraintendono

al suo funzionamento e alla generazione dei potenziali di azione in termini della dinamica delle correnti ioniche che attraversano la membrana neuronale. Il potenziale

d’azione è un segnale elettrico in grado di propagarsi per grandi distanze senza attenuazione grazie alle giunzioni mieliniche degli assoni e rappresenta l’unità elementare

di informazione scambiabile tra i neuroni.

1.1

I neuroni

I neuroni sono cellule del sistema nervoso altamente specializzate e dedicate al

trasferimento, immagazzinamento ed elaborazione delle informazioni. Tale elaborazione avviene attraverso segnali elettrici dovuti a differenze di potenziale associate

a correnti elettriche di natura ionica (essenzialmente sono rilevanti solo gli ioni sodio, potassio, calcio e cloro) che attraversano la membrana cellulare del neurone. I

neuroni sono in numero molto elevato e sono connessi fra di loro con topologie assai complesse (vedi figura 1.1): ad esempio nella corteccia cerebrale dei mammiferi

si ha una densità superiore a 104 neuroni/mm3 . Tipicamente, pur nella varietà di

tipi di cellule neuronali (neuroni della corteccia cerebrale, motoneuroni del midollo spinale, ecc.), possiamo riconoscere tre parti morfologicamente e funzionalmente

distinte: il corpo cellulare o soma; i dendriti e gli assoni. Il soma ha una struttura

compatta che risulta approssimativamente sferica (di circa 70 µm di diametro) ed è

sostanzialmente l’unità deputata all’elaborazione dell’informazione. I dendriti sono

estensioni del soma con una struttura molto ramificata che si estendono per distanze

che possono raggiungere il millimetro ed hanno la funzione di raccogliere i segnali

provenienti dagli altri neuroni e trasmetterli al soma. Gli assoni sono lunghe protuberanze (anche oltre un metro nei neuroni motori degli organismi animali superiori)

che si proiettano dal soma e la loro funzione consiste nella trasmissione del segnale

generato dal soma verso i dendriti di un’altro neurone. Usando la terminologia dei

circuiti elettronici si può quindi dire che i dendriti rappresentano il dispositivo di

ingresso (“input”), gli assoni il dispositivo di uscita (“output”) e il soma l’unità

di elaborazione delle informazioni. La morfologia di un particolare tipo di neurone

nonché la sua posizione nella rete neurale forniscono indizi sulla funzione espletata:

ad esempio il livello di arborizzazione fornisce un’idea del numero di connessioni che

può ricevere e verso quante altre cellule neuronali invii i propri segnali (vedi figura

1.2).

Figura 1.1. Neuroni della corteccia dei mammiferi osservati al microscopio. Possiamo distinguere neuroni con corpi cellulari triangolari e circolari: la cellula b è

un classico esempio di cellula piramidale con corpo triangolare [13].

1.2

I segnali neuronali ed il potenziale di azione

Si definisce potenziale di membrana la differenza di potenziale misurata ai capi di

due elettrodi, uno posto all’interno della cellula neuronale ed uno posto nel liquido

extracellulare circostante. Quando si parla di segnale neuronale ci si riferisce alla

variazione temporale e spaziale del potenziale di membrana. Quando il neurone è

a riposo, ossia non è in qualche modo eccitato dall’esterno (e chiariremo nel seguito

cosa si intende), il potenziale di membrana assume un valore caratteristico denominato potenziale di riposo, tipicamente dell’ordine di -65mV, ossia l’interno della

Figura 1.2.

Forme e dimensioni dei neuroni [14].

cellula si trova ad un potenziale inferiore rispetto all’esterno.

I potenziali di azione sono impulsi di tensione tipici, generati durante la dinamica

neuronale; essi hanno una forma pressoché stereotipata e non sono soggetti ad attenuazione o distorsione durante la propagazione lungo l’assone. In figura (1.3) è

riportata la forma tipica di un potenziale di azione. Si notino le seguenti caratteristiche:

• l’impulso di tensione ha una durata di circa 1-2 ms ed una ampiezza misurata

fra il minimo ed il massimo di circa 100-120 mV;

• nella prima fase dell’impulso si assiste ad una crescita veloce del potenziale di

membrana fino ad arrivare ad una fase denominata di depolarizzazione dove

il potenziale di membrana diventa positivo, cioè l’interno della cellula si trova

ad un potenziale superiore rispetto all’esterno;

• nella fase di discesa l’impulso prima di ritornare al valore di riposo passa

attraverso una fase denominata di iperpolarizzazione, tipicamente della durata

di circa 10 ms (e quindi molto più lenta della depolarizzazione), in cui la cellula

presenta un potenziale di membrana inferiore rispetto a quello di riposo.

Il potenziale di azione, che una volta generato nella cellula neuronale, viaggia lungo

l’assone ed è trasmesso agli altri neuroni, costituisce l’unità elementare associata

alla trasmissione dei segnali neuronali. Tipicamente quindi quando ci si riferisce al

segnale emesso da un neurone si intende la sequenza temporale di questi potenziali

di azione, detta anche treno di impulsi (in inglese spike train).

Figura 1.3.

1.3

Forma tipica di un potenziale di azione (o impulso) [15].

Le sinapsi

La sinapsi costituisce essenzialmente la giunzione tra due neuroni ossia la struttura

attraverso la quale le informazioni sono trasferite da una cellula nervosa all’altra. In

tale contesto si definisce neurone presinaptico il neurone “trasmettente” i potenziali

di azione, a monte della sinapsi, e neurone postsinaptico il neurone ’“ricevente” i

potenziali di azione, a valle della sinapsi. Con questa terminologia la sinapsi è quindi la regione in cui l’assone del neurone presinaptico “interagisce” con il dendrite

del neurone postsinaptico. Si definisce inoltre potenziale postsinaptico (che ha come

acronimo PPS ) la risposta in tensione del neurone postsinaptico conseguente all’arrivo del potenziale di azione proveniente dal neurone presinaptico.

Si distinguono essenzialmente due tipi di sinapsi: la sinapsi chimica e la sinapsi

elettrica (altrimenti detta gap-junction). La sinapsi chimica, della quale è riportato lo schema in figura (1.4), risulta la più comune nel cervello dei vertebrati e

si basa sul meccanismo che andiamo a descrivere. Il potenziale di azione generato dal neurone presinaptico, giunto all’estremità dell’assone depolarizza localmente

la membrana cellulare causando il rilascio all’interno della fessura sinaptica (ossia

il piccolo spazio tra le due membrane cellulari presinaptiche e postsinaptiche), da

parte di strutture poste sull’assone denominate vescicole sinaptiche, di particolari

sostanze chimiche denominate neurotrasmettitori. Il neurotrasmettitore, non appena raggiunto il versante postsinaptico della sinapsi, è rivelato da speciali molecole

(chemorecettori ) poste sulla membrana postsinaptica che provocano l’apertura (o

direttamente o tramite una catena di segnali biochimici) di specifici canali attraverso i quali una corrente ionica fluisce dal liquido extracellulare alla cellula. L’ingresso

di questi ioni porta a sua volta ad una variazione del valore del potenziale di membrana postsinaptico. Dunque in una sinapsi chimica si ha prima la trasformazione

di un segnale elettrico in un segnale chimico sulla membrana presinaptica e poi la

successiva trasformazione sulla membrana postsinaptica di un segnale chimico in un

segnale elettrico. La sinapsi elettrica realizza invece un accoppiamento elettrico tra

due neuroni attraverso canali ionici altamente specializzati (detti gap-junctions) che

collegano la membrana presinaptica e postsinaptica. La sinapsi elettrica permette

perciò un flusso di corrente diretto tra neuroni adiacenti ed è quindi più veloce per

la trasmissione del segnale.

Figura 1.4. Esempio di sinapsi chimica: la terminazione presinaptica libera una

sostanza chimica, il neurotrasmettitore, in risposta ad una depolarizzazione [14].

1.4

Introduzione alla dinamica neuronale

Abbiamo già accennato che l’arrivo di un potenziale di azione dal neurone presinaptico provoca una risposta in tensione (il potenziale postsinaptico) nel potenziale di

membrana del neurone ricevente. A tal proposito si distingue tra potenziale postsinaptico eccitatorio (che ha come acronimo PPSE ) e potenziale postsinaptico inibitorio (che ha come acronimo PPSI ) a seconda che l’effetto sia quello di aumentare o di

diminuire il valore del potenziale di membrana. Analogo significato ha la distinzione

tra sinapsi eccitatoria e sinapsi inibitoria ovvero tra stimolo depolarizzante e stimolo iperpolarizzante. Il numero di contatti sinaptici dipende dal tipo di neurone: ad

esempio i neuroni della corteccia cerebrale (neuroni corticali ) possiedono migliaia

di contatti sinaptici (da 3 · 103 a 104 ) con gli altri neuroni della corteccia dei quali

Figura 1.5. Registrazione di 479 PPSE sul soma di cellule piramidali della corteccia visuale del ratto, in presenza di attività neuronale spontanea (fig.A). Istogramma delle altezze di picco dei PPSE (fig.B) [17].

circa l’85% sono eccitatori ed il resto inibitori. In realtà solo una frazione dell’ordine

del 5-10% risultano sinapsi realmente attive [8, 16]. Per avere un’idea dell’ampiezza

di un PPSE si veda la figura (1.5) in cui sono riportati i PPSE registrati su una

cellula neuronale ed il relativo istogramma delle altezze di picco: come si vede il

valor medio è dell’ordine di 0.5 mV. In figura (1.6) è riportata una rappresentazione

schematica della dinamica neuronale che si instaura in risposta all’arrivo di impulsi

da neuroni presinaptici:

fig.A: un neurone postsinaptico i riceve impulsi da due neuroni presinaptici j = 1,2;

ui (t) e urest rappresentano rispettivamente il potenziale di membrana e il valore

(f )

del potenziale di riposo del neurone i; la quantità ǫi1 (t − t1 ) rappresenta il

(f )

potenziale postsinaptico generato dall’arrivo all’istante t1

di un impulso dal

neurone j = 1;

(f )

fig.B: un impulso che arriva dall’altro neurone presinaptico j = 2 ad un istante t2 ,

entro un intervallo di tempo sufficientemente breve, causa un secondo potenziale postsinaptico che si somma al precedente; in questo regime la risposta

del neurone postsinaptico risulta approssimativamente lineare nel senso che la

risposta è circa proporzionale agli input che riceve;

fig.C: quando ui (t) raggiunge un valore tipico, θ, denominato soglia di attivazione,

il comportamento del neurone diviene altamente non lineare: è generato un

potenziale di azione (il picco dell’impulso rappresentato da una freccia è fuori

dalla scala della figura) che ha una forma stereotipata e quindi senza legame

con gli stimoli che lo hanno prodotto; inoltre il neurone, per tutta la durata

del potenziale di azione, diviene per cosı̀ dire “insensibile”, ovvero refrattario,

agli stimoli che gli arrivano dagli altri neuroni.

La refrattarietà neuronale si distingue in genere in refrattarietà assoluta e refrattarietà relativa. La refrattarietà assoluta è quell’arco temporale (di circa 2ms) corrispondente alla durata del potenziale di azione in cui è impossibile che venga generato

un altro potenziale di azione. La refrattarietà relativa, che segue temporalmente la

refrattarietà assoluta, coincide con la fase di iperpolarizzazione del neurone in cui è

“difficile” ma non impossibile che il neurone venga eccitato fino ad emettere un altro

potenziale di azione. Conseguentemente il periodo di refrattarietà fornisce un limite

inferiore al minimo intervallo temporale tra due potenziali di azione consecutivi.

1.5

La membrana cellulare del neurone

La membrana cellulare del neurone (vedi figura 1.7) è composta da molecole di lipidi

e proteine. Le molecole lipidiche sono disposte in un doppio strato con uno spessore

di circa 6 nm. In questa matrice lipidica si trovano alcune molecole proteiche che

attraversano tutto lo spessore della membrana cellulare entrando quindi in contatto

sia con l’interno della cellula che con il liquido extracellulare. Tali particolari proteine prendono il nome di canali proteici, ovvero canali di membrana, canali acquosi

o canali ionici (la ragione di tali denominazioni sarà chiara a breve). La membrana

cellulare può essere attraversata dalle sostanze dall’esterno all’interno o viceversa

attraverso vari meccanismi. Vi sono ad esempio alcuni tipi di molecole (alcoli o

glicerolo) che attraversano la membrana sciogliendosi nel doppio strato lipidico e

riemergendo dall’altro lato; in tal caso la facilità di penetrazione dipende dal grado

Figura 1.6.

Rappresentazione della dinamica neuronale [15].

di solubilità nei lipidi. Gli ioni inorganici (sodio, potassio, calcio e cloro) che, come

abbiamo già detto, costituiscono le correnti ioniche alla base dell’attività elettrica

neuronale, si muovono attraverso la membrana o legandosi a particolare molecole

dette molecole di trasporto, che li veicolano, ovvero attraverso i canali proteici sopra

citati. Si noti comunque che il meccanismo di trasporto adottato durante la generazione di un potenziale di azione risulta quello dei canali proteici, in quanto i flussi

di ioni coinvolti (dell’ordine di 106 ioni/s) risultano ben oltre le possibilità di azione

delle molecole di trasporto. Nella struttura dei canali proteici (vedi figura 1.7) si

possono riconoscere i seguenti elementi:

• un poro centrale pieno d’acqua;

• una regione del poro che agisce da filtro di selettività regolando il transito degli

Figura 1.7.

a) Struttura della membrana cellulare del neurone; b) struttura di un

canale ionico [14].

ioni in base alle dimensioni ed alle caratteristiche chimico-fisiche;

• un sistema di porte (in inglese gates) che si aprono e si chiudono in modo

stocastico facendo oscillare il canale tra uno stato di apertura ed uno stato

di chiusura; di norma lo stato di chiusura predomina quando il potenziale di

membrana si trova al valore di riposo. 1 .

1.6

Canali ionici e correnti ioniche

Quando il canale ionico si trova in uno stato di apertura il canale è detto attivato,

altrimenti quando si trova in uno stato di chiusura è detto inattivato. È opportuno

sottolineare che essendo l’apertura e chiusura dei canali un processo di natura stocastica l’attivazione o disattivazione di un canale sta a significare solo un’aumentata

o diminuita probabilità di apertura del canale e non uno stato di apertura o chiusura

continua (vedi figura 1.8). Esistono varie modalità di attivazione, ossia di apertura,

di un canale. In particolare se l’apertura del canale può essere regolata dal valore

del potenziale di membrana i canali si dicono voltaggio-attivati. A titolo di esempio citiamo in questa categoria di canali, il canale voltaggio-dipendente del sodio

1

Esiste peraltro l’eccezione costituita da alcuni canali per i quali lo stato di apertura è predominante nella membrana a riposo: si tratta per lo più, come vedremo nel seguito, di quei canali del

cloro e del potassio che risultano responsabili proprio del valore del potenziale di riposo.

Figura 1.8. Esempio di corrente di canale. Come si vede tale corrente risulta di

impulsi di forma quasi rettangolare che possono essere posti in relazione con lo

stato di apertura e chiusura dei canali stessi [19].

che è quello responsabile della depolarizzazione della membrana che provoca la fase

di salita del potenziale di azione. Riguardo alla selettività alla specificità ionica, i

canali si possono distinguere in cationici e anionici a seconda che risultino rispettivamente permeabili agli ioni positivi o negativi. La permeabilità di una membrana

ad una specie ionica, indicata con p, è una proprietà intrinseca della membrana che

misura la “facilità” con cui gli ioni attraversano la membrana stessa; essa è definita

in modo empirico dalla relazione [8, 18]:

J = −p∆[C]

(1.1)

dove J è il flusso molare (misurato in mol/(cm2 ·s)) e ∆[C] rappresenta la differenza

di concentrazione ionica ai due lati della membrana (misurata in mol/cm3 ). P ha

le dimensioni di una velocità ed è solitamente misurata in cm/s. La permeabilità

dipende solo dal tipo e dal numero di canali ionici presenti sulla membrana. In

particolare i canali cationici possono essere specifici o non specifici qualora risultino

o meno specializzati per una particolare specie ionica (ad esempio si hanno canali

specifici del Na+ , K+ , Ca2+ ). I canali anionici risultano essenzialmente costituiti

dai canali del cloro (Cl− ), che è di gran lunga il maggior permeante anionico nelle

soluzioni biologiche.

La conduttanza è invece una misura dell’abilità della membrana di trasportare corrente elettrica ed è misurata solitamente in Siemens, con simbolo S, dove 1S = 1Ω −1 .

Poiché la corrente è trasportata dagli ioni, la conduttanza di una membrana non

dipenderà solo dalle proprietà della membrana (cioè dalla permeabilità) ma anche

dalla concentrazione ionica all’interno ed all’esterno della cellula (ovvero il numero

dei portatori liberi di carica). Non è tuttavia possibile ricavare una relazione matematica generale tra permeabilità e conduttanza perché tale relazione dipende strettamente dalle modalità con cui gli ioni attraversano il canale (semplice diffusione

attraverso i pori pieni d’acqua ovvero modelli più complicati che analizzano l’interazione canale-ione permeante). In generale quindi la corrente che attraversa un

canale ionico dipenderà [14, 20, 18]):

• dalla conduttanza del canale;

• dal gradiente di concentrazione tra l’interno e l’esterno della cellula che tende

a produrre un flusso dalla zona a maggior concentrazione a quella a minor

concentrazione secondo la legge empirica enunciata da Fick [18]:

Jdif f = −D

d[C]

dx

(1.2)

dove Jdif f rappresenta il flusso dovuto alla diffusione (misurato in numero di

ioni/(cm2 ·s)), D è il coefficiente di diffusione (misurato in cm2 /s) e [C] è la

concentrazione ionica (qui espressa in numero di ioni/cm3 );

• dalla differenza di potenziale applicata alla membrana.

1.7

1.7.1

Origine del potenziale di riposo

Un modello cellulare semplificato

In figura (1.9) è presentato un modello cellulare semplificato [14] ma che coglie

l’essenza dell’origine del potenziale di riposo della cellula neuronale. La cellula contiene ioni potassio (K + ), sodio (Na+ ), cloro (Cl− ) ed altri anioni (A− ) di grandi

dimensioni ed è a sua volta immersa in una soluzione di sodio, potassio e cloro. Le

Figura 1.9. Un modello semplificato per le distribuzioni ioniche all’interno ed

all’esterno della cellula. Le frecce rappresentano le direzioni dei gradienti di concentrazione ed elettrici per il potassio (K + ) e per il cloro (Cl− ). Le concentrazioni

sono espresse in millimoli per litro [14].

concentrazioni ioniche mostrate in figura sono espresse in millimoli per litro (che ha

per simbolo mM dove 1mM = 10−3 mol/l). Nelle cellule neuronali sono presenti

altri ioni, come il calcio e il magnesio, ma il loro contributo al potenziale di riposo

è trascurabile. In questo modello la membrana cellulare è completamente impermeabile al sodio ed all’anione interno (A− ) e risulta invece permeabile al potassio

ed al cloro. Il potassio risulta più concentrato dentro la cellula che fuori e tende

quindi a muoversi verso l’esterno secondo il proprio gradiente di concentrazione.

D’altro canto, come abbiamo precedentemente illustrato, la superficie interna della

membrana è negativa rispetto a quella esterna, e quindi il gradiente di potenziale

tende ad attrarre il potassio dentro la cellula. In una cellula a riposo il gradiente di

concentrazione ed il gradiente elettrico sono in equilibrio. Si definisce potenziale di

equilibrio di una specie ionica il valore del potenziale di membrana al quale non si ha

alcun flusso netto di quella specie ionica. Per il cloro il gradiente di concentrazione

ed il gradiente elettrico hanno direzione opposta rispetto al potassio.

1.7.2

L’equazione di Nerst

Il potenziale di equilibrio di ogni specie ionica è legato alle concentrazioni intracellulari ed extracellulari attraverso la cosiddetta equazione di Nerst:

Eione =

kB T [n]e

ln

q

[n]i

(1.3)

dove: Eione è il potenziale di equilibrio dello ione; [n]e , [n]i sono rispettivamente le

concentrazioni extracellulari ed intracellulari; kB ≃ 1.38 · 10−23 J/K è la costante

di Boltzmann; T è la temperatura assoluta in Kelvin; q è la carica elettrica (in

Coulomb) della specie ionica. È possibile capire l’origine dell’equazione di Nerst

attraverso il seguente ragionamento (vedi anche figura 1.10). Dalla meccanica sta′

tistica di Boltzmann per sistemi in equilibrio termico si ha che la probabilità p(U <

′

′

′

U < U + dU) che una molecola si trovi in uno stato di energia U < U < U + dU

′

′

risulta: p(U < U < U + dU) ∝ exp(−U/kB T ) [21]. Consideriamo adesso degli

ioni con carica positiva q in un campo elettrico statico. La loro energia nel punto

x risulta U(x) = qV (x) dove V (x) è il potenziale nel punto x. La probabilità di

trovare uno ione in una regione nell’intorno del punto x è perciò proporzionale alla

quantità exp(−qV (x)/kB T ). Reinterpretando la densità di probabilità come una

quantità proporzionale ad una densità ionica [n(x)], ovvero ad una concentrazione,

si ha:

p(U(x1 ))

[n(x1 )]

=

= exp(−q(V (x1 ) − V (x2 ))/kB T )

p(U(x2 ))

[n(x2 )]

(1.4)

e dunque all’equilibrio termodinamico si ha che un gradiente di potenziale elettrostatico ∆V = (V (x1 ) − V (x2 )) genera un gradiente di densità ionica . Ma poiché

questo è un assunto su uno stato di equilibrio la relazione deve valere anche nell’altro senso: ossia un gradiente di concentrazione genera un gradiente di potenziale

elettrostatico. Risolvendo la (1.4) rispetto al gradiente di potenziale si ha che all’equilibrio termodinamico vale ∆V =

kB T

q

2

ln [n]

che è appunto l’equazione di Nerst.

[n]1

La quantità kB T /q ha le dimensioni di una differenza di potenziale elettrico e per

Figura 1.10.

Origine del potenziale di Nerst [15].

una specie ionica monovalente (per la quale q = e, dove e ≃ 1.6 · 10−19 C è il valore

assoluto della carica dell’elettrone) è uguale a circa 25 mV a temperatura ambiente

(T ≃ 300 K). Per il modello cellulare mostrato in figura (1.9) nel quale il rapporto delle concentrazioni del cloro e del potassio è uguale e pari a 1:30 si avrà a

T ≃ 300 K: Ek ≃ −85 mV , ECl ≃ −85 mV . Nel modello cellulare semplificato,

essendo gli ioni potassio e cloro gli unici in grado di muoversi attraverso la membrana ed essendo entrambi in equilibrio a -85mV, la cellula non manifesta alcun

guadagno o perdita netta di ioni: il potenziale di riposo della cellula semplificata

coincide quindi con il potenziale di equilibrio del potassio e del cloro.

1.7.3

Effetto del sodio e pompe ioniche

Lo ione sodio (Na+ ) è molto più concentrato all’esterno che all’interno della cellula (vedi figura 1.9), dunque per opporsi all’ingresso del sodio dovuto al gradiente

di concentrazione la membrana deve avere una differenza di potenziale tra l’interno e l’esterno positiva: infatti usando le concentrazioni di figura (1.9) si ha che a

T ≃ 300 K il potenziale di equilibrio del sodio risulta EN a ≃ +34 mV . Dunque in

una cellula neuronale, dove il potenziale di riposo della membrana è negativo, sia

il gradiente di concentrazione, sia il potenziale di membrana favoriscono l’ingresso

del sodio. La membrana cellulare è scarsamente permeabile al sodio ma il sia pur

Figura 1.11.

Flussi ionici passivi e pompe ioniche in una cellula in stato

stazionario [14].

limitato ingresso di questo ione depolarizza leggermente la membrana rispetto al

potenziale di equilibrio del potassio, con la conseguenza che il potassio, fuori dall’equilibrio, fluisce verso l’esterno. Per mantenere lo stato di equilibrio (ovvero le

concentrazioni ioniche costanti) a fronte di queste perdite continue esistono delle

cosiddette pompe ioniche che trasportano il sodio fuori dalla cellula ed il potassio

dentro la cellula in modo da mantenere uno stato stazionario, ovvero una situazione

di equilibrio dinamico. Il più importante sistema di trasporto è costituito dalla pompa Na-K che trasporta tre ioni sodio fuori dalla cellula per ogni due ioni potassio

portati invece all’interno: in tal caso si dice che il rapporto di accoppiamento Na:K

della pompa è di 3:2. Tale situazione è rappresentata in figura (1.11) dove le frecce

tratteggiate indicano i movimenti ionici passivi (ovvero guidati solo dal bilancio tra

i gradienti elettrici e di concentrazione) mentre le frecce continue e i circoli indicano

le pompe ioniche. La lunghezza delle frecce indica l’entità dei movimenti netti ionici:

per ciascuno ione il flusso totale è nullo all’equilibrio.

1.7.4

Effetto della permeabilità ionica e dei meccanismi di

trasporto

Abbiamo visto nel paragrafo 1.7.2 che il potenziale di riposo della membrana è

determinato principalmente dal rapporto delle concentrazioni transmembranali del

potassio. Esiste tuttavia una dipendenza non solo dalle concentrazioni ioniche ma

anche dalla permeabilità alle specie ioniche. L’equazione di campo costante, detta

anche equazione GHK dagli autori D.E. Goldman [22], A.L. Hodgkin e B. Katz [23],

esprime tale dipendenza:

Eriposo =

kB T pk [K + ]e + pN a [Na+ ]e + pCl [Cl− ]i

;

ln

e

pk [K + ]i + pN a [Na+ ]i + pCl [Cl− ]e

(1.5)

dove Eriposo è il potenziale di riposo della membrana; e (valore assoluto della carica dell‘elettrone) indica la carica degli ioni monovalenti; il simbolo [I]j , dove I =

K + ,Na+ ,Cl− e j = i,e, indica la concentrazione interna ed esterna delle specie

ioniche; pk , pN a , pCl rappresentano le permeabilità ioniche di ogni ione.

Tale

equazione è basata sul presupposto che, a potenziale costante, non deve cambiare

la carica sulla membrana anche se gli ioni la attraversano in piccole quantità. Di

conseguenza le correnti trasportate dalle perdite di sodio verso l’interno, di potassio

verso l’esterno e dalle altre perdite del cloro devono dare come somma zero. Altrimenti si determinerebbe un accumulo, o una perdita, costante di carica e quindi una

deriva costante del potenziale di membrana. Il nome equazione di campo costante

è legato al fatto che una delle ipotesi alla base di essa è che il campo elettrico all’interno della membrana sia uniforme. Come si vede l’equazione ricorda quella di

Nerst ma considera tutte le specie ioniche presenti “pesate” con la loro permeabilità

e corrisponde pertanto a quello che intuitivamente era possibile aspettarsi: ovvero

che il potenziale di membrana tende tanto più al valore del potenziale di equilibrio

di una specie ionica quanto più la sua permeabilità è maggiore di quella delle altre

specie ioniche. È possibile dimostrare [14] che non vi è una grossa dipendenza del

potenziale di riposo dal cloro e pertanto il suo contributo è spesso trascurato; in tal

caso l’equazione di campo costante viene cosı̀ riscritta:

Eriposo =

kB T [K + ]e + b[Na+ ]e

;

ln

e

[K + ]i + b[Na+ ]i

(1.6)

dove b = pN a /pk . Una descrizione ancora più accurata è fornita dall’equazione di

stato stazionario [24] che considera anche gli effetti dei processi di trasporto attivo

della pompa ionica Na − K:

Eriposo =

kB T r[K + ]e + b[Na+ ]e

;

ln

e

r[K + ]i + b[Na+ ]i

(1.7)

dove r è il rapporto di accoppiamento del sistema di trasporto (nel caso della pompa Na − K si ha r = 3/2). Si capisce facilmente come gli effetti della pompa

si ripercuotano sul potenziale di membrana: infatti il diverso flusso di ioni Na+

e K + (tre ioni sodio fuori dalla cellula per ogni due ioni potassio portati invece

all’interno) causato dalla pompa genera una corrente ionica netta verso l’esterno;

questo flusso di cariche positive verso l’esterno tende a iperpolarizzare la membrana

ad un valore leggermente più negativo (ossia avvicina il potenziale di membrana

un po’ di più al potenziale di equilibrio del potassio) di quello che ci si aspetterebbe solo in base a meccanismi passivi. Per avere un’idea dell’entità del contributo delle pompe ioniche si confronti il valore del potenziale di riposo predetto

dall’equazione di campo costante e dall’equazione di stato stazionario relativamente

ad assoni di calamaro in acqua di mare alla temperatura di T ≃ 300 K: usando l’equazione di campo costante si trova Eriposo ≃ −67 mV , mentre usando l’equazione

di stato stazionario si trova Eriposo ≃ −73mV (abbiamo usato i seguenti valori realistici: [K + ]i = 400mM, [K + ]e = 10mM, [Na+ ]i = 50mM, [Na+ ]e = 460mM,

b = pN a /pk = 0.04, r = 1.5).

1.8

Proprietà elettriche passive della membrana

Da un punto di vista elettrico la più semplice schematizzazione di una porzione di

membrana cellulare a riposo fa ricorso a tre elementi circuitali: una resistenza (Rm ),

una capacità (Cm ), ed un generatore di tensione V uguale al potenziale di riposo

(vedi figura 1.12 e figura 1.13). La presenza della resistenza si spiega con l’esisten-

Figura 1.12.

Schematizzazione elettrica di una porzione di membrana cellulare

del neurone. Eriposo indica il potenziale di riposo [8].

Figura 1.13. Equivalente circuitale dell’intera membrana cellulare. I simboli Rm e

Cm in questo caso rappresentano il parallelo rispettivamente di tutte le resistenze

e le capacità delle singole porzioni di membrana; Eriposo indica il potenziale di

riposo; Iin rappresenta una corrente iniettata dentro la cellula [8].

za dei canali ionici che realizzano un contatto tra l’interno e l’esterno della cellula.

La resistenza di membrana è di solito riportata come una resistenza di membrana

specifica, rm , definita come una resistenza per unità di superficie (in unità Ω · cm2 ).

rm è quindi ottenuta dividendo Rm per l’area della membrana considerata. rm è determinata principalmente dalle permeabilità a riposo del potassio e del cloro. Valori

tipici di rm variano da circa 103 Ω · cm2 per membrane con molti canali ionici a

circa 5 x 104 Ω · cm2 per membrane con pochi canali ionici. Ma oltre a permettere il

passaggio di correnti ioniche, la membrana accumula cariche sulla superficie interna

ed esterna, ed è proprio questa separazione che detemina il potenziale di membrana.

La realizzazione di questa separazione di cariche conferisce alla membrana le proprietà di un condensatore. La capacità di membrana è di solito specificata in termini

di una capacità di membrana specifica, cm , definita come una capacità per unità

di superficie (in unità F/cm2 ). Cm è quindi ottenuta moltiplicando cm per l’area

della membrana considerata. cm è tipicamente dell’ordine di 1 µF/cm2 . Tramite

la relazione qm = cm V , dove qm è la quantità di carica per unità di superficie, ed

assumendo V ≃ -65mV si ha che qm ≃ (1µ F/cm2 ) x (65mV) ≃ 6.5 x 10−8 C/cm2

che equivale, dividendo per il valore assoluto della carica dell’elettrone, a circa 4

x 1011 ioni monovalenti per cm2 . Ci preme sottolineare che tale schematizzazione

descrive solo il comportamento passivo della membrana e non prende in considerazione eventuali componenti non lineari o attivi come ad esempio conduttanze

voltaggio-dipendenti.

Capitolo 2

Modelli semplificati di neuroni

Nella prima parte di questo capitolo introduciamo il primo modello realistico di

neurone, sviluppato nel 1952 da Hodgkin e Huxley per l’assone gigante del calamaro, che valse loro il premio Nobel per la medicina nel 1963. Hodgkin e Huxley

derivarono il loro modello in maniera fenomenologica, in modo da poter riprodurre

la fisiologia dell’assone gigante del calamaro e gli andamenti sperimentali non lineari

delle conduttanze associate alle correnti ioniche di membrana. Alcuni dei primi studi

sui potenziali di equilibrio per le varie specie ioniche furono fatti sull’assone gigante

del calamaro perché questo ha un diametro dell’ordine di 1 mm ed è dunque molto

grande rispetto al soma del neurone di un mammifero, che è dell’ordine di 70 µm,

quindi si presta meglio a studi di elettrofisiologia. Il modello di Hodgkin-Huxley

riproduce la dinamica del potenziale di membrana e il meccanismo di generazione

dei potenziali di azione, nonché l’andamento delle principali correnti ioniche di membrana. Tale modello è considerato il modello quantitativo che ha avuto il maggior

successo nelle neuroscienze: le schematizzazioni sviluppate da Hodgkin e Huxley per

l’assone gigante del calamaro hanno trovato negli anni passati e trovano anche oggi,

applicazione in centinaia di modelli per neuroni delle più diverse tipologie.

In questo capitolo inoltre spieghiamo come combinare tutti gli elementi costitutivi di un neurone (dendriti, sinapsi, conduttanze dipendenti dal potenziale, assoni)

al fine di ottenere un semplice modello funzionale della singola cellula. Questa operazione di semplificazione trascura la struttura dei dendriti e sostituisce la descrizione

dei processi di emissione dei potenziali di azione fondata sulle conduttanze (ovvero

la descrizione fornita dalle equazioni realistiche di Hodgkin-Huxley per le correnti di

membrana), con una descrizione basata sull’utilizzo di modelli formali, come il modello leaky integrate-and-fire 1, che tratteremo in dettaglio. Questo modello descrive

in modo estremamente semplificato la dinamica sottosoglia, cioè la dinamica prima

dell’emissione di un potenziale di azione, mentre il potenziale di azione è descritto sinteticamente come un evento stereotipato. In questo modo possiamo ridurre

notevolmente la complessità del problema e cosı̀ caratterizzare il comportamento dinamico dei neuroni attraverso una singola equazione differenziale ordinaria piuttosto

che tramite un sistema di più equazioni non lineari accoppiate. Tali semplificazioni

ci permettono di effettuare simulazioni numeriche di reti contenenti molti neuroni

del tipo leaky integrate-and-fire, data la rapidità di evoluzione del modello. Nei

prossimi capitoli tratteremo cosı̀ reti formate da un gran numero di neuroni interconnessi, al fine di simularne la dinamica e di analizzare la nascita e la stabilità di

soluzioni collettive non banali. La comprensione di un qualsiasi sistema complesso

passa per la scelta di un livello di descrizione che afferri le proprietà fondamentali

del sistema e trascuri quelle non essenziali allo scopo proposto.

1

Nel proseguo della tesi useremo questi anglicismi invece dei corrispondenti termini italiani

perché, ormai, sono invalsi nel linguaggio comune.

2.1

Dal modello di Hodgkin-Huxley al modello

leaky integrate-and-fire

Il modello di Hodgkin-Huxley è un modello realistico a quattro dimensioni (in cui

cioè la dinamica del neurone è descritta da quattro variabili), pensato per riprodurre

i dati sperimentali relativi ad una particolare fibra nervosa: l’assone gigante del

calamaro [25, 26]. Il modello matematico che L. Hodgkin e A. F. Huxley formularono

valse loro il premio Nobel per la medicina nel 1963 e rappresenta ancora un modello

attuale per lo studio della dinamica del singolo neurone. In particolare, questo

modello è costituito da un sistema di quattro equazioni differenziali del primo ordine

che descrivono la dinamica del potenziale di membrana e delle tre correnti ioniche

fondamentali: la corrente del sodio (IN a ), la corrente del potassio (IK ) e la corrente

di perdita, o di dispersione, (IL dall’inglese leakage current), dovuta principalmente

al cloro (Cl− ), ma che riassume anche l’effetto di altre specie ioniche minoritarie,

che non vengono descritte esplicitamente. Il meccanismo alla base di queste correnti

ioniche risiede nel fatto che le conduttanze della membrana cellulare per il sodio

(gN a ) e per il potassio (gK ) sono dipendenti dalla differenza di potenziale applicata

alla membrana, in particolare la probabilità che i canali si aprano aumenta con

la depolarizzazione della membrana. L’apertura dei canali per i vari ioni avviene

tuttavia con tempi e modalità diverse: la depolarizzazione della membrana attiva

inizialmente un aumento della conduttanza del sodio (seguita da una sua successiva

inattivazione) e solo con un certo ritardo temporale viene attivata la conduttanza

del potassio. Inoltre l’effetto sul potenziale di membrana dovuto all’aumento della

conduttanza è diverso per il sodio e per il potassio:

• per quanto riguarda il sodio si ha un processo di retroazione positiva; infatti

una piccola depolarizzazione aumenta il numero di canali aperti e questo, a

sua volta, dà luogo ad un ulteriore ingresso del sodio secondo il gradiente

Figura 2.1. Fase di salita del potenziale di azione. I segni + di colore nero indicano gli ioni N a+ che entrano nella cellula. Il gradino di tensione depolarizza la

membrana e fa aprire i canali sodio (li attiva); questo causa l’entrata del N a+ nella

cellula e ciò aumenta la depolarizzazione inducendo l’aumento della differenza di

potenziale fra l’interno e l’esterno della cellula.

elettrochimico e ad una depolarizzazione ancor più grande;

• per quanto riguarda il potassio, si ha invece che il flusso in uscita secondo

il gradiente elettrochimico, dovuto alla depolarizzazione, porta alla ripolarizzazione della membrana e quindi alla conseguente riduzione della conduttanza

fino al suo valore di riposo (retroazione negativa).

Il profilo tipico di un potenziale di azione è quindi spiegabile, per quanto riguarda

la fase di salita, con un improvviso grande aumento della permeabilità di membrana

al sodio (vedi figura 2.1); la conseguente corrente del sodio porta rapidamente il

potenziale di membrana a spostarsi verso il potenziale di equilibrio del sodio stesso

(EN a = 55 mV ).

La fase di caduta del potenziale di azione, ovvero la ripolar-

izzazione della membrana, è dovuta invece ad un successivo aumento della permeabilità al potassio (vedi figura 2.2): a causa della corrente ionica del potassio, il

potenziale di membrana si sposta questa volta, verso il potenziale di equilibrio del

potassio (Ek = −75 mV ). Si ha infine una fase di rilassamento del potenziale verso

il suo valore di riposo (Eriposo = −70 mV ).

Figura 2.2. Fase di caduta del potenziale di azione. I segni + di colore nero

indicano gli ioni N a+ , mentre i segni + di colore verde indicano gli ioni K + che

lasciano la cellula. Alla depolarizzazione segue infatti una inattivazione dei canali

N a; i canali K sono attivati con un certo ritardo e questo causa la fuoriuscita degli

ioni K + e la ripolarizzazione della membrana.

Figura 2.3. Ricostruzione teorica dell’andamento del potenziale d’azione e delle

relative variazioni della conduttanza del sodio gN a e del potassio gK in funzione

del tempo [14].

Il modello di Hodgkin-Huxley spiega inoltre l’esistenza di un livello di soglia

del potenziale di membrana al di sopra del quale viene emesso l’impulso, senza

richiedere alcuna discontinuità nella conduttanza del sodio (gN a ) o in quella del

potassio (gK ). Il fenomeno può essere compreso se immaginiamo di far passare una

corrente attraverso la membrana depolarizzandola solo sino alla soglia (Esoglia =

−55 mV ) e poi di interrompere la corrente. Essendo il potenziale di membrana

lontano dal potenziale di equilibrio del potassio, vi sarà un aumento della corrente

di potassio in uscita, ma verranno attivati anche alcuni canali di sodio, aumentando

la corrente di sodio in ingresso. Alla soglia questi aumenti di corrente sono uguali e

opposti (si ha un equilibrio dinamico), ma la conduttanza del sodio ora è instabile.

Infatti se nella cellula entra un solo ione di sodio in più, la depolarizzazione aumenta,

gN a aumenta, entra altro sodio e si innesca la retroazione positiva. Se d’altra parte

uno ione in più di potassio lascia la cellula, la depolarizzazione diminuisce, gN a

diminuisce, la corrente di sodio diminuisce e la prevalenza della corrente di potassio

determina la ripolarizzazione. Man mano che il potenziale di membrana si avvicina

al proprio livello di riposo, la corrente di potassio diminuisce poi fino ad eguagliare

nuovamente la corrente a riposo del sodio diretta verso l’interno. Riassumendo, la

depolarizzazione oltre la soglia determina un aumento di gN a sufficiente a innescare il

processo che porta all’emissione di un potenziale di azione, mentre depolarizzazioni

appena più deboli portano il potenziale di membrana a rilassarsi verso il suo valore

di riposo.

Un ultimo aspetto spiegabile con questo modello è il tempo di refrattarietà; come

già detto nel paragrafo (1.4), dopo l’emissione di un potenziale di azione abbiamo a

che fare con due periodi diversi di retrattarietà: il periodo di refrattarietà assoluto

e quello relativo. Il periodo refrattario assoluto coincide essenzialmente con l’intera

durata del potenziale di azione ed è causato dall’inattivazione dei canali Na+ che in

precedenza si erano aperti per depolarizzare la membrana; questi canali rimangono

inattivi finché la membrana non si ripolarizza, dopodiché si chiudono e si riattivano

riacquistando cosı̀ la loro capacità di aprirsi in risposta ad uno stimolo. Il periodo

refrattario relativo è successivo a quello assoluto; i canali potassio si aprono per terminare il potenziale di azione ripolarizzando la membrana, dunque la conduttanza

di membrana del potassio cresce drasticamente. Gli ioni K + che fluiscono in gran

numero fuori dalla cellula fanno sı̀ che il potenziale di membrana si avvicini molto al

potenziale di equilibrio del potassio; questo determina una breve iperpolarizzazione

della membrana, cosicché il potenziale di membrana diventa più negativo dell’usuale

potenziale di riposo (Eriposo = −70 mV ). Quindi, finché la conduttanza del potassio non ritorna di nuovo al suo valore di riposo, è necessario uno stimolo maggiore

per raggiungere il valore di soglia e dar vita ad una seconda depolarizzazione. Il

raggiungimento del potenziale di equilibrio di riposo determina la fine del periodo

di refrattarietà relativo.

Un neurone dunque genererà un potenziale di azione quando il suo potenziale di

membrana raggiungerà un valore di soglia compreso tra −55 e −50 mV . Durante

l’emissione del potenziale di azione, il potenziale di membrana descresce rapidamente e assume un valore che è iperpolarizzato rispetto al potenziale di soglia. Il

meccanismo per cui le conduttanze dipendenti dal potenziale K + e Na+ producono

dei potenziali di azione è ben compreso e modellizzabile accuratamente per il neurone del calamaro gigante.

D’altra parte, come vedremo nel paragrafo successivo, i modelli dei neuroni possono

essere semplificati se non vengono esplicitamente inclusi i meccanismi biofisici responsabili dei potenziali di azione. I modelli integrate-and-fire nascono da questa

semplificazione supponendo che il potenziale di azione sia generato ogni volta che il

potenziale di membrana del neurone modello raggiunge un valore di soglia Θ; dopo

l’emissione del potenziale di azione, al potenziale viene riassegnato un valore R inferiore al potenziale di soglia, R < Θ. Tali modelli formali partono dal presupposto

che un potenziale di azione costituisca un evento stereotipato, per cui viene descritta solo la dinamica sottosoglia da un’unica variabile che rappresenta il potenziale

di membrana (modello unidimensionale). Inoltre questi modelli non riproducono in

modo dettagliato i potenziali di azione né includono l’effetto di adattamento o il

tempo di refrattarietà. L’insorgenza del potenziale di azione è cosı̀ caratterizzata

solo dal tempo di sparo (o in inglese firing time).

2.2

Neuroni leaky integrate-and-fire

Il modello integrate-and-fire è stato proposto da Lapicque nel 1907 [27], molto prima

che fosse compreso il meccanismo di generazione dei potenziali di azione; nonostante

la sua semplicità, questo modello rappresenta tuttora una descrizione estremamente

utile dell’attività neuronale. Non volendo fornire una descrizione biofisica del potenziale di azione, a questi modelli rimane il compito, più semplice, di modellizzare la dinamica del potenziale di membrana sottosoglia. Questo compito può esser svolto con

vari livelli di rigore; nella versione più semplice, sono ignorate tutte le conduttanze di

membrana attive, compresi gli input sinaptici, e l’intera conduttanza di membrana

è schematizzata con un singolo termine di perdita, passivo, im = ḡL(V − EL ), con

im corrente di membrana, V potenziale di membrana, EL potenziale di riposo e ḡL

che rappresenta una conduttanza efficace di membrana a riposo. Questa versione è

denominata passiva o modello leaky integrate-and-fire (al quale ci riferiremo anche

come LIF). Sperimentalmente è noto che le conduttanze neuronali sono approssimativamente costanti per piccole fluttuazioni attorno al potenziale di membrana di

riposo; il modello LIF assume che questa costanza si mantenga nell’intero intervallo

di variazione del potenziale sottosoglia. Per alcuni neuroni, questa si rivela un’approssimazione ragionevole, mentre per altri meno.

Con queste approssimazioni il neurone si comporta come un circuito elettrico costituito da una resistenza ed una capacità in parallelo (figura 2.4) ed il potenziale di

membrana si determina cosı̀ attraverso l’equazione

cm

dV

Ie

= −im +

dt

A

(2.1)

dove cm è la capacità per unità di superficie della membrana, A è la superficie della

membrana, im è la corrente di membrana per unità di superficie ed Ie è la corrente

esterna iniettata nel neurone. Con im = ḡL (V − EL ) si ha infine

cm

dV

Ie

= −ḡL (V − EL ) + .

dt

A

(2.2)

È conveniente moltiplicare l’equazione (2.2) per la resistenza specifica di membrana

Figura 2.4.

Circuito equivalente per il modello di neurone. [15].

rm , data in questo caso da rm = 1/ḡL ; questo cancella il fattore ḡL nel membro a

destra dell’equazione e lascia un fattore cm rm = τm nel membro di sinistra, dove τm

è la costante di tempo di membrana del neurone. L’ultimo termine del membro di

destra diviene rm /A = Rm , dove Rm è la resistenza di membrana totale. Si arriva

cosı̀ all’equazione fondamentale per i modelli leaky integrate-and-fire:

τm

dV

= EL − V + Rm Ie .

dt

(2.3)

Per completare la dinamica del modello LIF occorre aggiungere una regola “ad

hoc”: riassegnare al potenziale il valore R ogniqualvolta il potenziale V raggiunga

il valore di soglia e venga emesso un potenziale di azione. L’equazione (2.3) mostra

che, quando Ie = 0, il potenziale di membrana si rilassa esponenzialmente con una

costante di tempo τm a V = EL ; EL è dunque il potenziale di riposo della cellula

modello.

Il potenziale di membrana per il modello passivo integrate-and-fire è determinato

integrando l’equazione (2.3) e applicando la regola aggiuntiva riguardo alla soglia

ed alla riassegnazione del valore del potenziale per la generazione del potenziale di

azione. In figura (2.5) è mostrata la risposta di un neurone LIF ad una corrente

esterna che varia nel tempo.

Figura 2.5. Modello leaky integrate-and-fire guidato da una corrente esterna che

varia temporalmente. Il grafico superiore indica il potenziale di membrana, mentre

quello inferiore la corrente applicata. I potenziali d’azione sono semplicemente

sovrapposti alla traiettoria del potenziale di membrana ogniqualvolta il potenziale

raggiunga il valore di soglia. [9].

La frequenza d’emissione dei potenziali d’azione di un modello LIF in risposta

ad una corrente iniettata costante può essere calcolata analiticamente. Quando Ie è

indipendente dal tempo, il potenziale sottosoglia V (t) può essere facilmente calcolato

risolvendo l’equazione (2.3):

V (t) = EL + Rm Ie + (V (0) − EL − Rm Ie )exp(−t/τm ),

(2.4)

dove V (0) è il valore di V al tempo t = 0. Questa equazione è valida per il modello

passivo solo finché V rimane sottosoglia. Supponiamo che a t = 0 il neurone abbia

appena emesso un potenziale di azione e si abbia quindi V (0+ ) = R; il potenziale

di azione successivo verrà emesso quando il potenziale di membrana raggiungerà il

valore di soglia Θ, cioè, ad un tempo t = tisi dove

V (tisi ) = Θ = EL + Rm Ie + (R − EL − Rm Ie )exp(−tisi /τm ).

(2.5)

Risolvendo per tisi , ovvero per il tempo a cui si ha il potenziale di azione successivo,

possiamo determinare l’intervallo tra uno sparo e l’altro (in inglese interspike interval

o ISI) per una corrente Ie costante, o, equivalentemente, il suo inverso, che possiamo

chiamare frequenza d’emissione dei potenziali d’azione del neurone,

risi

1

Rm Ie + El − R

=

= τm ln(

)

tisi

Rm Ie + EL − Θ

−1

.

(2.6)

Questa espressione è valida se Rm Ie > Θ − EL , altrimenti risi = 0. Per valori

sufficientemente grandi di Ie , possiamo espandere al primo ordine l’equazione (2.6)

ed ottenere

risi

"

#

Rm Ie + El − Θ

≈

,

τm (Θ − R)

(2.7)

che mostra come la frequenza di emissione cresca linearmente con Ie per grandi

valori di Ie .

La figura (2.6A) mostra che la frequenza di emissione dei potenziali di azione,

determinata come l’inverso dell’intervallo temporale tra i primi due impulsi emessi

da un neurone corticale in vivo in risposta ad una corrente iniettata (cerchi pieni), è

in accordo con i risultati ricavati dal modello LIF, anche se il neurone reale esibisce

una caratteristica di adattamento della frequenza di emissione prima di raggiungere

uno stato stazionario (figura 2.6B), che non è inclusa in questa semplice versione del

modello.

2.2.1

Correnti sinaptiche

Nel caso in cui il neurone riceva degli impulsi da altri neuroni, la cosa si può schematizzare nell’ambito dei modelli LIF sostituendo alla corrente esterna Ie , che compare

Figura 2.6. (A) Confronto delle frequenze di emissione dei potenziali d’azione in

funzione della corrente iniettata, calcolate l’una con il modello integrate-and-fire,

l’altra attraverso le misure su un neurone corticale in vivo. I punti derivano da

una cellula piramidale nella corteccia visiva primaria di un gatto. I cerchi pieni

mostrano l’inverso dell’ISI per i primi due impulsi emessi, mentre i cerchi vuoti

mostrano la frequenza di emissione degli impulsi nello stato quasi stazionario, dopo

l’adattamento della frequenza stessa. (B) Registrazione dell’attività di un neurone

corticale, soggetto ad una corrente iniettata costante, in cui è visibile l’adattamento della frequenza di emissione. (C) Traiettoria del potenziale di membrana e

potenziali di azione per un modello integrate-and-fire con una corrente aggiuntiva

Ia (vedi paragrafo 2.2.2). [9].

nell’equazione (2.3), la corrente sinaptica Isin . In particolare l’effetto prodotto da

un solo impulso ricevuto dal neurone al tempo t corrisponde ad una corrente postsinaptica che si può scrivere nel seguente modo:

Isin = −Gm [V + W ]τm δ(t)

(2.8)

per una sinapsi che risponda in modo infinitamente rapido [28]. In questa equazione

Gm = 1/Rm è la conduttanza di membrana, mentre W è il potenziale di inversione

della sinapsi il cui segno determina se l’effetto dell’impulso è eccitatorio o inibitorio.

Dato che il potenziale di membrana V ha segno negativo, la sinapsi è detta eccitatoria

(rispettivamente inibitoria) se W < 0 (W > 0); il segno di V è all’origine anche del

segno negativo nell’equazione (2.8). Nel caso in cui il neurone sia connesso ad altri

N neuroni pre-sinaptici il modello LIF si può riscrivere come

τm V̇ = EL − V − τm (V + W )

(k)

dove il tempo tj

N X

X

j=1 k

(k)

δ(t − tj ) ,

(2.9)

rappresenta l’istante di ricezione dell’impulso k-esimo emesso dal

j-esimo neurone pre-sinaptico.

-50

Θ

-52

-54

V

-56

-58

R

-60

150

175

tempo

200

Figura 2.7. Andamento temporale del potenziale di membrana per un neurone

LIF soprasoglia in assenza di stimoli presinaptici. Le frecce indicano l’istante in

cui avviene l’emissione di un potenziale di azione.

Un modello ancora più semplificato, ma largamente usato in letteratura e che

mette in connessione la dinamica del modello LIF con quella di oscillatori di fase è

il seguente [6]

v̇ = a − v −

N X

X

j=1 k

(k)

δ(t − tj ) ,

(2.10)

dove si è assunto che EL = 0, che il tempo unitario sia τm e che il potenziale di

membrana sia stato riscalato come v = (V − R)/(Θ − R), in modo che il valore di

soglia sia 1, mentre il valore di riazzeramento sia 0, quindi v ∈ [0,1]. Nell’equazione

(2.10) il termine a rappresenta una corrente esterna adimensionale. In assenza di

stimoli esterni, la soluzione dell’equazione (2.10) è semplicemente v(t) = a(1 −

exp(−t)), quindi se a < 1 il suo valore asintotico resta sempre sottosoglia (essendo

la soglia posta ad 1), altrimenti se a > 1 il potenziale di membrana raggiunge soglia

e viene riazzerato in modo ripetitivo con periodo tisi = ln[(a − 1)/a]. In questo

ultimo caso il neurone è detto soprasoglia e la sua dinamica ricorda quella di un

semplice oscillatore armonico sovrasmorzato. Tale dinamica è riportata in figura

(2.7). Questo modello sarà oggetto degli studi sviluppati nel cap.4.

2.2.2

Adattamento della frequenza di emissione degli impulsi e refrattarietà

L’adattamento della frequenza di emissione dei potenziali d’azione è una caratteristica comune dei neuroni piramidali della corteccia celebrale dei mammiferi e consiste

nell’allungamento degli ISI col passare del tempo in presenza di una corrente costante

iniettata nella cellula, sino a giungere ad una frequenza di emissione stazionaria (vedi figura 2.6). La considerazione di questo fenomeno ci permette di mostrare come

un modello LIF possa essere modificato per incorporare una dinamica più complessa. Il modello LIF che abbiamo descritto nel paragrafo precedente è basato su

due approssimazioni distinte: una descrizione altamente semplificata del potenziale

di azione e l’assunzione di una dipendenza lineare dal potenziale di membrana per

la corrente ionica complessiva. Il processo di adattamento della frequenza di emissione degli impulsi può essere incluso nel modello LIF aggiungendo all’equazione

fondamentale un’ulteriore termine di corrente Ia = −rm gsra(V − EK ),

τm

dV

= EL − V − rm gsra (V − EK ) + Rm Ie .

dt

(2.11)

La conduttanza associata all’adattamento della frequenza di emissione degli impulsi

gsra è stata schematizzata come una conduttanza K + , cosicché, quando viene attivata, iperpolarizza il neurone, rallentando qualsiasi impulso che può sopraggiungere.

EK è il potenziale di inversione del potassio. Assumiamo che questa conduttanza si rilassi esponenzialmente a 0 con una costante temporale τsra soddisfacendo

l’equazione

τsra

dgsra

= −gsra .

dt

(2.12)

Ogniqualvolta un neurone genera un impulso, gsra è accresciuto di un fattore ∆gsra ,

cioè gsra → gsra + ∆gsra ; durante una sequenza di potenziali d’azione emessi, la

corrente si modifica attraverso una sequenza di passi successivi che causano una

diminuzione della frequenza di emissione (come mostrato in figura 2.6).

La probabilità che un neurone spari è significativamente ridotta nel breve lasso temporale successivo alla generazione di un potenziale di azione; tale effetto di

refrattarietà non è incluso nel modello base LIF. Il modo più semplice per introdurre nel modello un periodo di refrattarietà assoluto è quello di aggiungere una

condizione alla regola base di superamento della soglia tale che proibisca l’emissione

di un altro potenziale di azione per un periodo di tempo immediatamente successivo

all’emissione dell’impulso. La refrattarietà può essere incorporata in un modo più

realistico aggiungendo una conduttanza simile a quella introdotta per l’adattamento in frequenza di emissione dei potenziali di azione; stavolta però la conduttanza

dovrà avere un tempo di recupero più veloce ed un incremento più grande in seguito all’emissione di un potenziale di azione. Grazie ad un consistente incremento,

dovuto all’emissione di un potenziale di azione, il valore del potenziale del neurone

si avvicina al potenziale di equilibrio del potassio EK , prevenendo in maniera temporanea un ulteriore sparo e producendo un periodo di refrattarietà assoluto. Nel

momento in cui questa conduttanza si avvicina a zero, l’emissione del potenziale

di azione sarà nuovamente possibile anche se inizialmente poco probabile. Questo

meccanismo produce cosı̀ anche un periodo di refrattarietà relativo.

Capitolo 3

Modelli di reti neurali ad

accoppiamento impulsivo

I singoli neuroni, di svariate tipologie e morfologie, sono connessi in reti assai complesse tramite sinapsi chimiche ed elettriche nelle varie aree del cervello, presenti in

tutti i vertebrati e in molti invertebrati. Ad esempio, il cervello umano contiene circa

100 miliardi di neuroni ed ogni neurone può essere connesso ad un gran numero di

altri neuroni, sino a 10 mila. La complessità della rete cerebrale è tale da non poter

essere studiata in modo numerico (o teorico) con un approccio diretto, cioè realizzando una riproduzione il più fedele possibile del cervello o di porzioni di esso, questo sia

perché entrare in dettagli estremi di descrizione della rete neurale rischia, a causa

della presenza di un numero elevatissimo di parametri da calibrare, di rendere lo

stato della rete sensibilissimo a piccole variazioni dei parametri stessi, sia perché da

un punto di vista numerico, la simulazione di questa rete diverrebbe assai onerosa

in termini di calcolo, rendendo possibili solo simulazioni per brevissimi intervalli

temporali. Per lo studio della dinamica di reti neurali è allora necessario ricorrere a

modelli mesoscopici, che si possono ottenere con vari livelli di approssimazione. In

questo e nel prossimo capitolo ci occuperemo di reti di neuroni leaky integrate-andfire ad accoppiamento impulsivo, sia globalmente connesse, che con diluizione nella

connettività. Nonostante l’estrema semplicità dei modelli di rete considerate, queste

danno luogo a dinamiche collettive assolutamente non banali. Nel primo paragrafo

introdurremo un modello di rete leaky integrate-and-fire globalmente accoppiata;

ridurremo le equazioni differenziali che ne descrivono la dinamica ad una mappa a

tempo discreto ed introdurremo l’analisi di stabilità lineare relativa ai modelli in

questione. Nel secondo paragrafo effettueremo l’analisi di stabilità di stati collettivi

della rete, distinguendo tra i modi di lunghezze d’onda grandi e quelli di lunghezze

d’onda brevi. Infine nell’ultimo paragrafo considereremo una rete diluita ed analizzeremo gli effetti che tale diluizione comporta, come l’osservazione, in regime di

caos stabile, di transitori che divergono esponenzialmente con il numero di neuroni

della rete. .

3.1

Reti neurali con accoppiamento impulsivo

Una rete neurale è, formalmente, un grafo i cui nodi sono costituiti dai neuroni e

le cui connessioni rappresentano le sinapsi; in particolare, ciascuna connessione è

pesata con la corrispondente efficienza sinaptica [8]. Le sinapsi costituiscono cosı̀ un

grafo con connessioni unidirezionali ed orientate. Ciascun nodo è caratterizzato da

un’equazione di evoluzione in cui lo stato del neurone dipende dai neuroni connessi

ad esso, ovvero dai neuroni presinaptici; i pesi sinaptici possono essere fissati oppure

possono anche evolvere nel tempo (plasticità sinaptica), in accordo con la storia dei

due nodi connessi dalla sinapsi [9, 20]. Se consideriamo le reti neurali come sistemi

dinamici, possiamo dare una formulazione canonica della dinamica neurale; ciascun

neurone i è caratterizzato dal suo stato, xi , che appartiene ad un certo insieme

compatto Ξ ∈ Rq , dove q è il numero di variabili che caratterizzano lo stato di un

neurone. Assumiamo inoltre che tutti i neuroni siano descritti dallo stesso numero di

variabili. Il LIF corrisponde al caso in cui q = 1, xi = Vi è il potenziale di membrana

del neuroni i e Ξ = [R,Θ], come mostrato nel paragrafo (2.2). L’evoluzione di N

neuroni è data cosı̀ da un sistema dinamico deterministico del tipo:

dx

= Fγ (x,t),

dt

tempo continuo,

(3.1)

o,

x(t + 1) = fγ [x(t),t],

tempo discreto.

(3.2)

La variabile x = {xi }N

i=1 rappresenta lo stato dinamico di una rete con N neuroni

al tempo t; tipicamente x ∈ M = Ξ N , dove M è lo spazio delle fasi dell’equazione

(3.2) ed Fγ (M) ⊂ M. La funzione Fγ : M → M dipende da un insieme di

parametri γ ∈ Rp ; il caso tipicamente considerato in seguito sarà γ = (Gc , I(ext) ),

dove Gc è la matrice N × N dei pesi sinaptici, mentre I(ext) rappresenta il vettore

N-dimensionale delle correnti o stimoli esterni ricevuti dai singoli neuroni. Cosı̀ γ

è un punto nello spazio dei parametri di controllo di dimensione p = N 2 + N.

Un neurone i emette un potenziale d’azione ogni qual volta il suo stato xi appartiene ad una certa regione connessa P1 del suo spazio delle fasi, altrimenti è quiescente se x ∈ P0 = Ξ\P1 . Per N neuroni identici questo porta ad una “partizione

naturale” P dello spazio delle fasi M. Chiamiamo Γ = {0,1}N , ω = [ωi ]N

i=1 ∈ Γ ,

allora P = {Pω }ω∈Γ , dove Pω = Pω1 ×Pω2 × · · · × PωN . Equivalentemente, se

x ∈ Pω , si ha che tutti i neuroni con ωi = 1 stanno emettendo impulsi, mentre

quelli con ωk = 0 sono quiescenti.