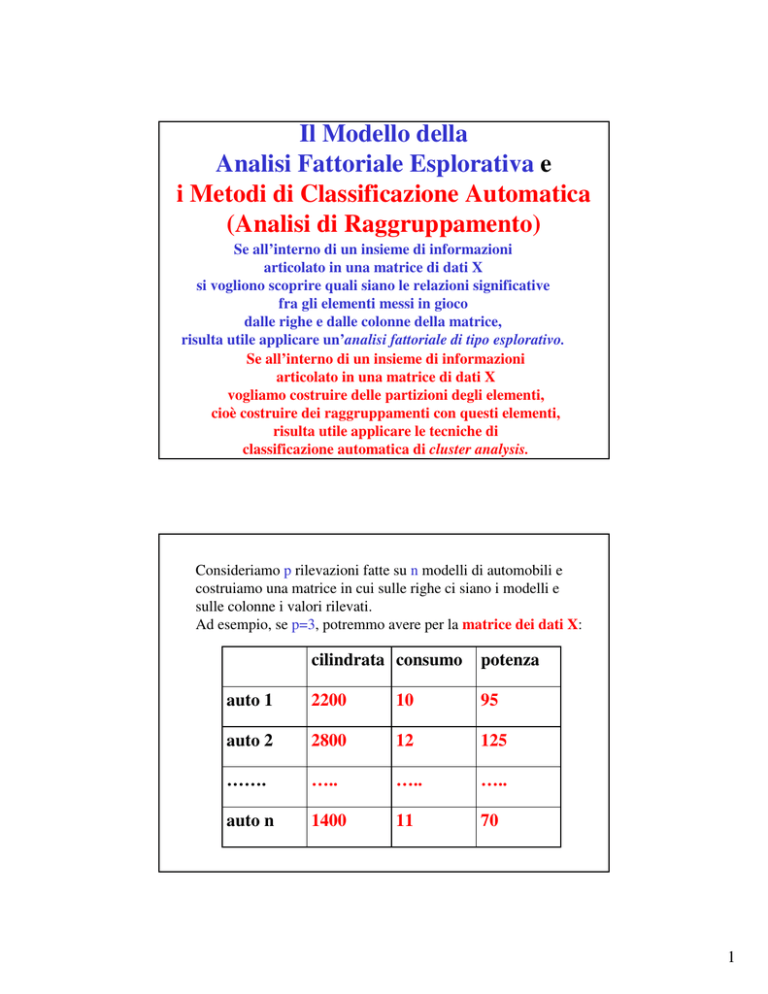

Il Modello della

Analisi Fattoriale Esplorativa e

i Metodi di Classificazione Automatica

(Analisi di Raggruppamento)

Se all’interno di un insieme di informazioni

articolato in una matrice di dati X

si vogliono scoprire quali siano le relazioni significative

fra gli elementi messi in gioco

dalle righe e dalle colonne della matrice,

risulta utile applicare un’analisi fattoriale di tipo esplorativo.

Se all’interno di un insieme di informazioni

articolato in una matrice di dati X

vogliamo costruire delle partizioni degli elementi,

cioè costruire dei raggruppamenti con questi elementi,

risulta utile applicare le tecniche di

classificazione automatica di cluster analysis.

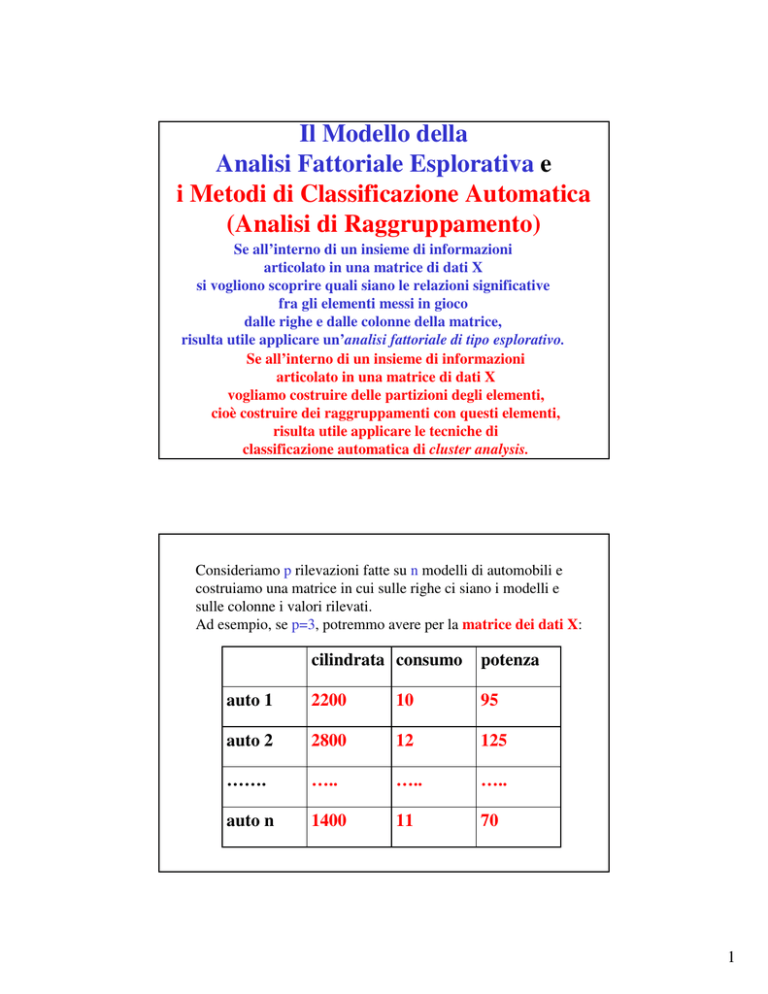

Consideriamo p rilevazioni fatte su n modelli di automobili e

costruiamo una matrice in cui sulle righe ci siano i modelli e

sulle colonne i valori rilevati.

Ad esempio, se p=3, potremmo avere per la matrice dei dati X:

cilindrata consumo

potenza

auto 1

2200

10

95

auto 2

2800

12

125

…….

…..

…..

…..

auto n

1400

11

70

1

Visualizziamo adesso le n auto con n punti in uno spazio R³:

Ma se le variabili da misurare per ciascuna delle n auto sono p > 3

come possiamo vedere gli n punti?

• L’idea potrebbe essere quella di proiettare in uno spazio di

dimensione l ≤ 3, così da poter vedere gli aggregati di punti.

• Tuttavia, proiettare deforma e semplifica l’insieme iniziale.

• Allora, come ridurre la dimensione dello spazio senza perdere in modo

significativo l’informazione iniziale, cioè le relazioni tra i dati contenute

nella matrice X?

Analisi fattoriale

Tuttavia, prima di provare a studiare le relazioni tra le variabili,

oppure, eventualmente, dopo averlo fatto, può essere utile

• ridurre i dati in forma grafica semplice

• tentare una classificazione delle unità.

Cluster analysis

2

X ≡ X n , p ≡ ( xij )

matrice unità-variabili

In generale, uno studio

multidimensionale

sarà definito da una matrice

dei dati X,

da un vettore di pesi (o

masse) delle unità D

e da un criterio di

riponderazione delle variabili

espresso con una matrice M.

xi

xj

3

4

5

con :

∞

d

hk

= lim λ d

λ →∞

hk

= max i xhi − xki

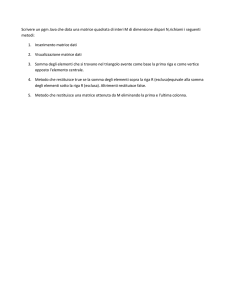

Esempio di cluster analysis

In una ricerca condotta in Thailandia (Chapman & Hall 1986) sono

stati esaminati reperti ossei di canidi preistorici e di canidi attuali.

Lo scopo era di vedere se il cane di epoca preistorica (circa 3500

anni A.C.) è da considerarsi vicino al cane attuale tipico di quella

regione o, eventualmente, più vicino ad altri canidi.

Sono state misurate 6 variabili:

X 1 =larghezza della mandibola

X 2 =altezza della mandibola, sotto il primo molare

X 3 =lunghezza del primo molare

X 4 =larghezza del primo molare

X 5 =distanza fra il primo ed il terzo molare (inclusi)

X 6 =distanza fra il primo ed il quarto premolare (inclusi)

6

variabili

X1

X2

X3

X4

X5

X6

unità

cane moderno

9.7

21.10

19.4

7.7

32.0

36.5

sciacallo dorato

8.1

16.7

18.3

7.0

30.3

32.9

lupo cinese

13.5

27.3

26.8

10.6

41.9

48.1

lupo indiano

11.5

24.3

24.5

9.3

40.0

44.6

cuone

10.7

23.5

21.4

8.5

28.8

37.6

dingo

cane preistorico

9.6

10.3

22.6

22.1

21.1

19.1

8.3

8.1

34.4

32.3

43.1

35.0

Elaborazione in Matlab con il Toolbox Statistics (la matrice X dei dati

è nel file canide.mat, X1, X2, ecc. sono vettori riga uguali alle colonne)

utilizzando le tecniche della cluster analysis.

Analisi in componenti principali (ACP)

Fra le analisi fattoriali di tipo esplorativo ci sono due

tecniche fondamentali:

•l’analisi in componenti principali (variabili quantitative)

•l’analisi delle corrispondenze (variabili qualitative)

Qui studieremo l’analisi in componenti principali (in inglese

Principal Component Analysis, PCA; Pearson 1901, Wishart 1928,

Hotelling 1933), il cui obbiettivo principale è:

sostituire alle p variabili di partenza un numero l < p di nuove

variabili (dette componenti - o fattori- principali), combinazioni

lineari delle variabili originali, che siano fra loro incorrelate (od

ortogonali o indipendenti), in modo che queste l variabili

rappresentino il più fedelmente e semplicemente possibile

l’agglomerato delle osservazioni iniziali contenuto nella matrice

X dei dati.

7

In sostanza, con queste nuove variabili, che sono combinazioni lineari

delle variabili osservate originali, fatte in modo da mantenerne il

massimo possibile di variabilità:

•riduciamo la multidimensionalità della matrice dei dati X, in quanto

operiamo con un numero minore di nuove variabili (componenti

principali), che, però, contengono (quasi) tutte le informazioni utili,

•costruiamo delle dimensioni sintetiche ed inosservabili (assi

fattoriali), che ci forniscono un nuovo modello teorico per

interpretare il fenomeno, che ci può condurre ad attribuire a

variabili meno evidenti, ma più profonde, la causa da cui derivano le

variabili che sono direttamente oggetto di misura,

•proiettiamo i dati su sottospazi (in genere, di R², al massimo di R³)

formati da queste dimensioni latenti, ottenendo delle nuvole di punti

che possiamo vedere e da cui ricaviamo informazioni sulle relazioni

sia fra le unità, sia fra le variabili.

Prima di procedere con la trattazione matematica dell’ACP, cerchiamo

di visualizzare il concetto di buona proiezione di un oggetto.

Una buona proiezione 2-D può mantenere tutte le informazioni

essenziali di un oggetto 3-D, come, ad esempio, una golden eagle:

Oppure, pensiamo alla proiezione delle

ombre di una ciambellina su un muro:

possono essere più o meno

rappresentative dell’oggetto e si

ottengono o ruotando la

ciambellina, o ruotando le torce.

Nel caso della ACP i dati rimangono

fermi e muoviamo gli assi, vale a dire è come se

muovessimo le torce in questo esempio.

8

In questo esempio reale vediamo le infinite proiezioni di un

insieme 3-D di dati antropometrici, presi su un campione di

uomini (punti neri) e donne (punti rossi):

Quale proiezione dei dati

scegliereste?

Ecco la soluzione che

ci propone l’ACP:

9

OH i = x u =

'

i

p

j =1

xij u j

10

11

Spazio delle unità: proiezioni

dei punti unità

sull’α

α-esimo asse fattoriale

12

Dalle precedenti formule si ricava che:

Ad esempio, dalla prima si ha

che le coordinate (cα )i dei punti

cα = λα vα

cα ∈ R n

cα* = λα uα

cα* ∈ R p

unità su un asse fattoriale in R p

sono proporzionali alle componenti

(vα )i dell'

asse fattoriale vα ∈ R n ,

corrispondenti allo stesso

autovalore λα

cα collineare a vα

13

Si noti che per gli autovalori (non negativi) l’indice sarà dato da:

α = 1, 2, …, min(n,p)

14

migliore approssimazione di rango 1

della matrice X

migliore approssimazione di rango α della matrice X

ricostruzione della matrice X con gli autovalori λα e gli autovettori associati uα e vα

15