FISICA/MENTE

FISICA/MENTE

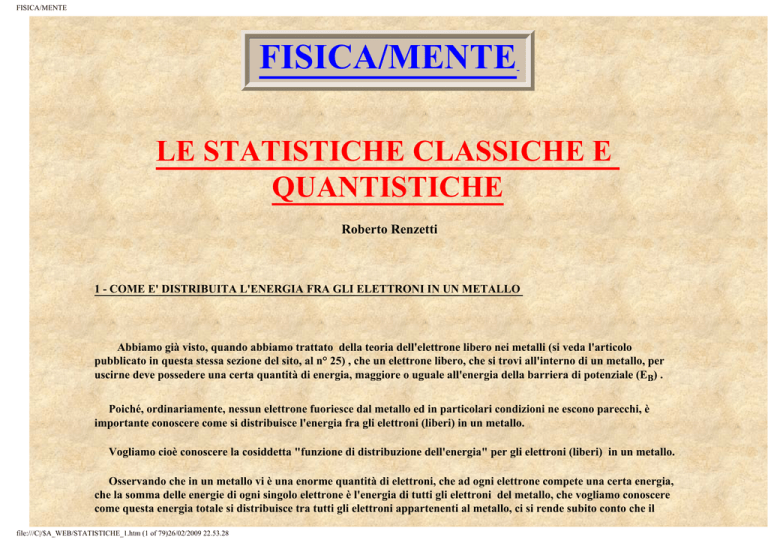

LE STATISTICHE CLASSICHE E

QUANTISTICHE

Roberto Renzetti

1 - COME E' DISTRIBUITA L'ENERGIA FRA GLI ELETTRONI IN UN METALLO

Abbiamo già visto, quando abbiamo trattato della teoria dell'elettrone libero nei metalli (si veda l'articolo

pubblicato in questa stessa sezione del sito, al n° 25) , che un elettrone libero, che si trovi all'interno di un metallo, per

uscirne deve possedere una certa quantità di energia, maggiore o uguale all'energia della barriera di potenziale (EB) .

Poiché, ordinariamente, nessun elettrone fuoriesce dal metallo ed in particolari condizioni ne escono parecchi, è

importante conoscere come si distribuisce l'energia fra gli elettroni (liberi) in un metallo.

Vogliamo cioè conoscere la cosiddetta "funzione di distribuzione dell'energia" per gli elettroni (liberi) in un metallo.

Osservando che in un metallo vi è una enorme quantità di elettroni, che ad ogni elettrone compete una certa energia,

che la somma delle energie di ogni singolo elettrone è l'energia di tutti gli elettroni del metallo, che vogliamo conoscere

come questa energia totale si distribuisce tra tutti gli elettroni appartenenti al metallo, ci si rende subito conto che il

file:///C|/$A_WEB/STATISTICHE_1.htm (1 of 79)26/02/2009 22.53.28

FISICA/MENTE

problema è di tipo statistico.

Per risolverlo occorre introdurre dapprima il concetto di probabilità e quindi le varie statistiche classiche e

quantistiche che sono state sviluppate allo scopo.

2 - LA PROBABILITÀ

Supponiamo di voler conoscere, prima di lanciare una moneta (non truccata) la probabilità di avere testa.

Gli eventi possibili sono due: testa (T) o croce (C). L'evento favorevole è uno solo; testa (T).

Possiamo quindi dire che, lanciando la moneta scegliamo tra i due eventi possibili il solo evento favorevole.

Questo evento favorevole T ha 1 probabilità su 2 di presentarsi (c'è 1 probabilità su 2 di ottenere T) . Si usa dire, in

questo caso, che la probabilità di ave re testa è 1/2, ossia 0,5. Se ci chiediamo ora qual è la probabilità che, lanciando un

dado (non truccato), si ottenga il quattro, possiamo procedere nel modo seguente .

Gli eventi possibili sono sei: 1, 2, 3, 4, 5, 6. L'evento favorevole è uno solo: 4. L'evento favorevole ha 1 probabilità su

6 di presentarsi, quindi la probabilità di avere 4 è 1/6.

Supponiamo ora di avere un sacchetto con tre biglie [una bianca (B) e due nere (N)] e di voler cono scere la

probabilità di estrarre dal sacchetto una biglia nera. Gli eventi possibili sono tre: B, N, N. Gli eventi favorevoli sono 2:

N, N.

L'evento favorevole (N) ha 2 probabilità su 3 di verificarsi, quindi la probabilità di avere N è 2/3. Si potrebbe

continuare all'infinito facendo esempi di questo tipo essendo noi ormai in grado d- dare la probabilità a priori che un

evento (semplice) si verifichi. Questa probabilità sarà sempre rappresentata da un numero che può andare da zero ad

uno (compresi).

Probabilità zero significa che l'evento sicuramente non si verificherà; probabilità 1 significa che l'evento si

verificherà sicuramente (certezza dell'evento).

file:///C|/$A_WEB/STATISTICHE_1.htm (2 of 79)26/02/2009 22.53.28

FISICA/MENTE

Possiamo a questo punto esprimere con una formula la probabilità P che un evento E si verifichi:

P(E) = (numero dei casi favorevoli)/( numero dei casi possibili)

(questo se i casi possibili sono tutti egualmente probabili) .

Quindi, nel caso del dado, la probabilità che si ottenga 4 è:

P (4) = 1/6

(4 è il solo caso favorevole su sei casi possibili).

Nel caso della moneta, la probabilità che si ottenga testa (T) è:

P (T) = 1/2

(T è il solo caso favorevole su due casi possibili).

Nel caso delle biglie, la probabilità che se ne estragga una nera (N) è:

P (N) = 2/3

(ci sono due casi favorevoli su tre casi possibili, essendoci due biglie nere su un totale di tre biglie).

Da quanto abbiamo detto sembrerebbe che, lanciando ad esempio un dado 6 volte, almeno una volta esca

un prefissato numero. Questa affermazione è inesatta e per convincercene basta provare: il nostro numero può

uscire tutte le volte, può uscire due o tre volte (sempre su sei lanci),

Se però effettueremo 600 lanci, il nostro numero potrà uscire 96, 97, 103 volte (più o meno), invece delle 100 volte

che sono previste dalla nostra relazione (P = 100/600 = 1/6). Se effettueremo 6000 lanci, il nostro numero potrà uscire

985, 992, 1012 volte (più o me no), invece delle 1000 previste dalla nostra relazione (P = 1000/6000 = 1/6) ed i numeri

985, 992, 1012 su 6000 lanci sono percentualmente migliori (cioè si avvicinano di più ad 1/6) dei numeri 96, 97, 103 su

600 lanci.

file:///C|/$A_WEB/STATISTICHE_1.htm (3 of 79)26/02/2009 22.53.28

FISICA/MENTE

Aumentando il numero dei lanci, il numero degli eventi favorevoli diviso per il numero degli eventi possibili tenderà

sempre più ad 1/6.

In generale, se chiamiamo "frequenza" di un evento casuale il rapporto tra il numero di volte che un determinato

evento si presenta ed il numero totale di prove fatte, si vede che, aumentando il numero delle prove, la frequenza

dell'evento tende a stabilizzarsi in torno a valori vicini alla probabilità a priori.

Se si aumentano indefinitamente il numero delle prove che si fanno si può verificare che la frequenza dell'evento

tende alla probabilità "a priori" che l'evento si verifichi.

Possiamo così enunciare la legge dei grandi numeri, la quale dice che il valore di probabilità pre visto teoricamente

per un evento (probabilità "a priori") si avvicina alla realtà tanto più quanto maggiore è il numero delle prove che si

effettuano.

Questa legge è fondamentale in quanto ci dice il significato da attribuire alla probabilità che un even to si verifichi:

di media, su molti eventi.

Questa che abbiamo discusso è la probabilità matematica. In fisica si considera di solito un'altra probabilità: quella

termodinamica.

Pensiamo per un momento alle molecole (molecole termodinamiche: indivisibile, minuta, sferica, elastica) di un gas.

Queste avranno velocità diverse, posizioni diverse e si muoveranno in diverse direzioni.

Certo noi non andiamo a misurare le velocità, le direzioni di spostamento e le posizioni istantanee di ogni singola

molecola ( sono miliardi di miliardi!), piuttosto ci preoccupiamo di misurare la pressione (P) esercitata dal gas, il

volume (V) da esso occupato, la sua temperatura (T)(1).

Fissata una terna di valori P, V e T, questo stato macroscopico del gas può essere originato da un gran numero di

stati microscopici delle singole molecole costituenti il gas stesso.

Si può infatti vedere ciò con un esempio molto semplice. Supponiamo un gas di tre molecole (a, b, c) in un volume V.

Supponiamo poi che le tre molecole abbiano la stessa velocità nella stessa direzione (verso la parete destra del

contenitore di volume V). Si vede subito che una fissata configurazione P, V, T per l'intero sistema si può ottenere in sei

diversi modi (scambiando in tutti i modi possibili le posizioni delle tre molecole tra di loro):

file:///C|/$A_WEB/STATISTICHE_1.htm (4 of 79)26/02/2009 22.53.28

FISICA/MENTE

Si può quindi definire la probabilità termodinamica come il numero di stati possibili delle molecole di un gas che

danno allo stesso gas la medesima configurazione macroscopica.

La nostra probabilità termodinamica, pur essendo concettualmente la medesima cosa della probabilità matematica,

differisce da quest'ultima perché si prendono, per essa, in considerazione solo i casi favorevoli (configurazioni

favorevoli) ad un certo stato macroscopico (non divisi per il numero di casi possibili come nella probabilità matematica).

La probabilità termodinamica è quindi espressa generalmente da un numero grande e non da un numero compreso

tra zero ed uno come nel caso della probabilità matematica.

3 - LA MECCANICA STATISTICA

Come abbiamo detto un certo stato macroscopico del la materia (gassosa, liquida o solida che sia) è caratterizzato da

una terna P, V, T che noi misuriamo. Questo stato può essere realizzato microscopicamente in un grande numero di

modi diversi a seconda delle posizioni e delle velocità e quindi delle energie che possiedono le singole molecole. Si può

cioè misurare, in uno stesso volume occupato da un gas, una determinata pressione ed una determinata temperatura e

queste grandezze, pressione e temperatura, si possono ottenere con le molecole del gas distribuite in modi diversi con

file:///C|/$A_WEB/STATISTICHE_1.htm (5 of 79)26/02/2009 22.53.28

FISICA/MENTE

energie diverse.

A diversi valori della terna P, V, T si hanno diversi stati macroscopici, ad esempio, dei gas, ciascuno dei quali si può

realizzare microscopicamente in vari modi. In condizioni normali il gas occuperà uno stato ben determinato a cui

compete una fissata terna P, V, T.

La domanda che ora ci poniamo è: quale probabilità deve essere attribuita ad un determinato stato macroscopico

(una determinata terna P, V, T) della materia (solida, liquida o gassosa che sia)?

Tenendo presente che uno stato macroscopico, ad esempio, di un gas si realizza generalmente quando ad esso

compete la massima probabilità, il problema è quel lo di legare la probabilità di realizzazione di uno sta to

macroscopico con le possibili distribuzioni microscopiche delle molecole che costituiscono il gas stesso.

Diciamo subito che lo stato macroscopico di un sistema a cui compete la massima probabilità, cioè lo sta to

macroscopico che più probabilmente ricaviamo facendo delle misure P, V, T, è quello che microscopicamente può essere

realizzato in un numero maggiore di modi diversi (aumento dell'entropia --> 2° principio della termodinamica).

La meccanica statistica studia proprio questo problema di probabilità.

4 - LA STATISTICA DI MAXWELL - BOLTZMANN : LA STATISTICA CLASSICA

Supponiamo di avere un gas di molecole. Sia N il numero totale di molecole ed E la loro energia totale. Supponiamo

inoltre che le N molecole costituenti il gas interagiscono solo molto debolmente tra di loro in modo da poter trascurare

l'energia d'interazione e poter quindi parlare di energia "propria" (la somma dell'energia propria di ciascuna molecola

componente il gas è uguale ad E) di ciascuna molecola. Osserviamo infine che le N molecole da noi considerate sono

identiche ma classicamente distinguibili; ognuna ha cioè una sua propria individualità.

Il problema della.statistica fisica è di distribuire la quantità assegnata E di energia fra le N mole cole. Posto che un

certo numero di molecole avrà energia E0, un certo numero E1, un certo numero E2, ..., un certo numero En (con E1 + E2

+ ... + En = E), il problema è di calcolare la funzione di distribuzione, cioè, come E va distribuita fra le N particelle.

Si vuole in definitiva determinare tutte le possibili distribuzioni dell'energia fra le N molecole (in modo che l'energia

totale sia sempre E) .

file:///C|/$A_WEB/STATISTICHE_1.htm (6 of 79)26/02/2009 22.53.28

FISICA/MENTE

Poiché distribuzioni (microscopicamente) diverse non necessariamente corrispondono a stati macroscopici

distinguibili, il problema della statistica è determinare qual è lo stato macroscopico che può essere realizzato con il

massimo numero di stati microscopici.

Chiameremo tale stato macroscopico stato di equilibrio del sistema.

Per facilitare i ragionamenti che svolgeremo, immaginiamo che il volume occupato dal gas sia diviso in tante cellette

che chiameremo Z1 , Z2 , ... , ZM (queste cellette le supponiamo di ugual volume e in numero finito M), che possono

essere pensate come tante piccole scatolette entro le quali si possano disporre delle palline (le nostre molecole). Queste

cellette debbono essere pensate tanto piccole da confondersi con un punto. Aggiungiamo poi che in ogni punto del nostro

volume potremo avere più di una celletta [è uno strano spazio quello che stiamo considerando (spazio delle fasi) in cui

nello stesso punto coesistono diverse entità (è uno spazio a più dimensioni)] secondo il criterio seguente: in ogni punto

del nostro volume si avranno tante cellette quante sono le possibili velocità delle molecole (naturalmente a velocità

diverse corrispondono energie diverse) del gas (infatti in ogni punto è possibile che si trovino molecole con differenti

velocità) [ anche se in un punto vi fosse una sola molecola di energia 1/2 mv2, in uno spazio tridimensionale

sorgerebbero egualmente complicazioni dovendosi tenere in conto che una data energia 1/2 mv2 può essere ottenuta da

molte combinazioni delle componenti vx , vy e vz di v. Si dovrebbe allora avere l'elasticità mentale di pensare il nostro

punto (in cui si trova la molecola di energia 1/2 mv2) occupato o da una molecola con energia 1/2 mv2 originata da una

particolare combinazione di vx , vy e vz , o da una molecola con la stessa energia ma originata da una diversa

combinazione di vx , vy e vz, o da ... ecc. Quindi, a parità di energia per la molecola, moltissimi valori diversi possono

assumere le componenti della sua velocità. E' chiaro che più è grande l'energia della molecola, in più modi si può

ottenere da differenti combinazioni di vx , vy e vz].

Il seguente schema può far intendere meglio quanto abbiamo detto:

file:///C|/$A_WEB/STATISTICHE_1.htm (7 of 79)26/02/2009 22.53.28

FISICA/MENTE

Come si può vedere dallo schema ogni stato (1, 2, . . . , M) è individuato dal suo valore dell'energia (E1 , E2, ... EM ), e le energie E1 ,

E2, ... EM saranno per noi le energie possedute dalle nostre celle (Z1, Z2, ...ZM). Nello schema si potrebbe sostituire a "...nello stato

1..." l'espressione "...nella cella Z1..." (e così per ogni riga dello schema). Inoltre anziché dire "stato" si può parlare di "livello" come

del resto qualche volta sarà fatto in seguito.

La situazione può essere "letta" così: in un particolare stato macroscopico del gas in considerazione (una particolare

terna P, V, T) , composto da N molecole identiche ma distinguibili (e quindi numerabili: 1, 2, ..., N), n1 molecole si

trovano nello stato 1 di energia E1, n2 molecole si trovano nello stato 2 di energia E2, ... , nM molecole si trovano nello

stato M di energia EM originando così il primo possibile stato del sistema.

A questo punto entra in gioco il fatto che le molecole sono distinguibili classicamente, per cui si ottengono tutti gli

stati microscopici che ci danno una stessa configurazione macroscopica del nostro gas disponendo in tutti i modi

possibili le molecole tra le diverse energie

file:///C|/$A_WEB/STATISTICHE_1.htm (8 of 79)26/02/2009 22.53.28

FISICA/MENTE

Occorre allora osservare che numericamente risulta:

n1(1) = n1(2) = ...... = n1(P)

n2(1) = n2(2) = ...... = n2(P)

..............................................................

nM(1) = nM(2) = ...... = nM(P)

la differenza fra i vari n è dovuta al fatto che le particelle, pur essendo in egual numero sono diverse; ad esempio, date

tre particelle (a, b, c), n1 = 2 si può ottenere in tre modi diversi:

ab

ac

bc

(Si vedano in proposito gli esempi che seguono).

Al variare quindi della individualità delle molecole che occupano un determinato stato microscopico otteniamo tutti i

possibili stati microscopici che ci danno lo stesso stato macroscopico.

Se si vuole uno stato macroscopico diverso (una diversa terna P, V, T) si debbono cambiare i numeri nj(1) di

occupazione [osserviamo a parte che la pressione e la temperatura di un gas sono grandezze statistiche medie

(relativamente ai miliardi di molecole componenti il gas stesso) che noi usiamo per caratterizzare lo stato

macroscopico del gas].

In ogni caso le condizioni che devono rimanere sempre valide sono:

a) il numero totale di molecole è costante ed uguale ad N, cioè, nello schema che abbiamo fatto, si deve avere:

n1(i) + n2(i) + ...... + nM(i) = N

cioè:

file:///C|/$A_WEB/STATISTICHE_1.htm (9 of 79)26/02/2009 22.53.28

FISICA/MENTE

Σj nj(i) = N;

b) l'energia totale delle molecole è costante ed uguale ad E, cioè, nello schema che abbiamo fatto si de ve avere:

n1(i) E1 + n2(i) E2 + ...... + nM(i) E = E

cioè:

Σj nj(i) Ej = E;

Per comprendere meglio facciamo qualche esempio (ricordando quanto già detto: le molecole sono identiche ma

classicamente distinguibili e quindi numerabili).

ESEMPIO 1

Siano date tre molecole (a, b, c) da distribuire nei due diversi livelli in cui ciascuna delle tre mole cole può trovarsi.

Si può procedere nel modo seguente:

file:///C|/$A_WEB/STATISTICHE_1.htm (10 of 79)26/02/2009 22.53.28

FISICA/MENTE

Per il sistema si hanno quindi 8 possibili distribuzioni nei due stati (8 possibili stati microscopicamente diversi). Si

può osservare che il numero totale P di stati che si può realizzare è:

P = P 1 + P 2 + P3 + P4 = 8

poiché risulta:

P1 =1 ; P2 = 1 ; P3 = 3 ; P4 = 3.

Si vede quindi che hanno maggiore probabilità le ultime due classi di stati poiché per esse si ha una probabilità di

file:///C|/$A_WEB/STATISTICHE_1.htm (11 of 79)26/02/2009 22.53.28

FISICA/MENTE

realizzazione pari a:

P3/P = P4/P = 3/8

mentre la probabilità di realizzazione dei primi due stati è:

P1/P = P2/P = 1/8

ESEMPIO 2

Facciamo un altro esempio. Siano date sempre tre molecole (a, b, c) da distribuire in tre diversi stati possibili in cui il

sistema delle tre molecole può trovarsi (essendo sempre l'energia totale una costante).

Si procede allo stesso modo di prima:

file:///C|/$A_WEB/STATISTICHE_1.htm (12 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (13 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (14 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (15 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (16 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (17 of 79)26/02/2009 22.53.28

FISICA/MENTE

Per il sistema si hanno quindi 27 possibili distribuzioni nei tre stati.

Si può anche qui osservare che la probabilità totale P che si realizzi una distribuzione è data da:

P = P1 + P2 + P3 + P4 + P5 + P6 + P7 + P8 + P9 + P10 = 27

poiché risulta:

P1 =1 ; P2 = 1 ; P3 = 1 ; P4 = 3 ; P5 = 3 ; P6 = 3 ; P7 = 3 ; P8 = 3 ; P9 = 3 ; P10 = 6

Si vede quindi che ha maggiore probabilità l'ultima classe di stati poiché per essa si ha una probabili tà di

realizzazione pari a:

P10/P = 6/27

mentre la probabilità di realizzazione dei primi tre stati è

P1/P = P2/P = P3/P = 1/27

e quella dei rimanenti è:

file:///C|/$A_WEB/STATISTICHE_1.htm (18 of 79)26/02/2009 22.53.28

FISICA/MENTE

P4/P = P5/P = P6/P = P7/P = P8/P = P9/P = 3/27

ESEMPIO 3

Vediamo infine un altro esempio. Siano date sempre tre molecole (a, b, c) da distribuire, ora in quattro diversi stati

possibili in cui il sistema delle tre molecole può trovarsi (essendo sempre l'energia totale una costante).

Procedendo ancora allo stesso modo si trova (E1 + E2 + E3 + E4 = E):

file:///C|/$A_WEB/STATISTICHE_1.htm (19 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (20 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (21 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (22 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (23 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (24 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (25 of 79)26/02/2009 22.53.28

FISICA/MENTE

Per il sistema si hanno quindi 64 possibili distribuzioni nei quattro stati.

Si può anche qui osservare che la probabilità totale P che si realizzi una distribuzione è data da:

P = P1 + P2 + P3 + P4 + P5 + P6 + P7 + P8 + P9 + P10 + P11 + P12 + P13 + P14 + P15 + P16 + P77 + P18 + P19 + P20

poiché risulta:

P1 = P2 = P3 = P4 = 1;

P5 = P6 = P7 = P8 = P9 = P10 = P11 = P12 = P13 = P14 = P15 = P16 = 3

P17 = P18 = P19 = P20 = 6

file:///C|/$A_WEB/STATISTICHE_1.htm (26 of 79)26/02/2009 22.53.28

FISICA/MENTE

Anche qui si vede che hanno maggiore probabilità le ul time quattro classi di stati poiché per esse si ha una probabilità

di realizzazione pari a:

P17/P = P18/P = P19/P = P20/P = 6/64

mentre la probabilità di realizzazione dei primi quattro stati è:

P1/P = P2/P = P3/P = P4/P = 1/64

e quella dei rimanenti è:

P5/P = P6/P = P7/P = P8/P = P9/P = P10/P = P11/P = P12/P = P13/P = P14/P = P15/P = P16/P = 3/64

Di esempi come questi se ne possono fare tantissimi variando successivamente il numero, degli stati possibili a

disposizione per le molecole (2, 3 e 4 nei nostri esempi). Si può inoltre variare il numero delle molecole che noi abbiamo

sempre fissato a tre.

Come si può ben capire in un gas vi sono moltissimi stati e un numero grandissimo di molecole (miliardi di miliardi).

E' allora impensabile procedere come nei nostri esempi non essendo bastante una vita per sistemare queste molecole

negli stati possibili. Ecco allora che ci vengono in aiuto i metodi statistici, i quali, oltre a darci il numero di tutte le

possibili distribuzioni delle molecole nelle cellette, ci informano anche su quale distribuzione debba ritenersi la più

probabile. Relativamente a quest'ultima affermazione, possiamo trarre qualche aiuto dagli esempi fatti. Si può infatti

ammettere, senza eccessiva difficoltà, che un sistema (un gas) tenderà a trovarsi prevalentemente in quella classe di stati

del sistema stesso corrispon dente al più grande dei valori dei Pi (nel 1° esempio nelle classi di stati a cui corrispondeva

una probabilità termodinamica P3 = P4 ; nel 2° esempio nella classe di stati a cui corrispondeva una probabilità

termodinamica P10; nel 3° esempio nelle classi di stati a cui corrispondeva una probabilità termodinamica P17 = P18

= P19 = P20).

Quindi per noi Pi rappresenta il numero di stati del sistema; allora tanto più è grande Pi, cioè tanto più è grande il

numero di stati microscopici del sistema che ci danno uno stesso stato termodinamico macroscopico, quanto più è

probabile che, se noi andassimo ad osservare il sistema in un determinato istante, troveremmo quello stato (si osservi

che affermare quanto abbiamo ora detto, equivale a dire che gli eventi si svolgono nella direzione verso cui è più

probabile si svolgano - teorema ergodico -).

file:///C|/$A_WEB/STATISTICHE_1.htm (27 of 79)26/02/2009 22.53.28

FISICA/MENTE

5 - FORMALIZZIAMO

Ciò che si può ricavare da quanto detto è che se si ha un sistema (isolato) in esso avvengono solo quelle

trasformazioni che lo portano verso lo stato a cui compete la massima probabilità (stato più stabile del sistema) e ciò è

sempre vero ogniqualvolta il numero N dei componenti del sistema è grandissimo e nel nostro caso (molecole di un gas)

la cosa è sempre verificata.

Prima di andare avanti, cerchiamo di ricavare dagli esempi fatti qualche informazione relativa al nume ro delle

distribuzioni di un certo numero di oggetti in un certo numero di posti. Dati Z posti ed N oggetti, in quanti modi diversi

gli N oggetti si possono distribuire nei Z posti?

Nel primo esempio avevamo a disposizione N = 3 mole cole e Z = 2 celle e avevamo trovato che si poteva ottenere un

totale di P = 8 distribuzioni.

Nel secondo esempio avevamo a disposizione N = 3 molecole e Z = 3 celle e avevamo trovato che si poteva ottenere un

totale di P = 27 distribuzioni.

Nel terzo esempio avevamo a disposizione N = 3 mole cole e Z = 4 celle e avevamo trovato che si poteva ottenere un

totale di P = 64 distribuzioni.

Cominciamo col dire che il numero di permutazioni di N molecole è N! (un numero seguito da un punto esclamativo

che vuol semplicemente dire il prodotto di tutti i numeri interi che precedono quel numero fino al numero stesso).

Vediamo un esempio. Se N = 3 (a, b, c), N! sarà uguale a 6 ed infatti si hanno le seguenti permutazioni:

abc

acb

bac

file:///C|/$A_WEB/STATISTICHE_1.htm (28 of 79)26/02/2009 22.53.28

FISICA/MENTE

bca

cab

cba

che sono proprio in numero di 6, cioè 3! = 1 . 2 . 3 = 6.

Così facendo, però, si includono anche i casi in cui vengono permutate le molecole di una stessa celletta; poiché

queste permutazioni non rappresentano nuove possibilità di realizzazione della distribuzione considerata si deve

dividere N! per il numero n1! di permutazioni nella prima cella, per il numero n2! di permutazioni nella seconda

cella, e così via, ottenendo allora per il numero di possibilità di realizzazione di una certa distribuzione (probabilità

termodinamica):

Se si fanno poi variare i numeri n1, n2 , ..., nM questa espressione ci dà il numero di possibilità di realizzazione di

altre distribuzioni.

Vediamo un esempio di quanto detto.

Rifacendoci all'esempio 2, precedentemente visto, ricordiamo che si avevano N = 3 molecole da distribuire in Z =3

stati possibili.

Abbiamo visto nell'esempio che si avevano varie distribuzioni microscopiche (27) a cui corrispondevano un certo

numero di stati macroscopici (10).

Ora abbiamo già visto che 3 molecole si possono permutare in 3! = 6 modi diversi.

Nel caso della distribuzione P1 si ha allora (N = 3 molecole in totale; n1 = 3 molecole in Z1; n2 = 0 molecole in Z2; n3 =

0 molecole in Z3):

file:///C|/$A_WEB/STATISTICHE_1.htm (29 of 79)26/02/2009 22.53.28

FISICA/MENTE

il che corrisponde alla unica possibilità di realizzazione di questo stato microscopico.

Altrettanto si può dire per P2 e P3:

Nel caso della distribuzione P4 si ha allora (N = 3; n1 = 2; n2 = 1; n3 = 0):

il che corrisponde alle tre possibilità di realizzazione di questo stato microscopico.

Altrettanto si può dire per P5, P6, P7, P8, P9:

file:///C|/$A_WEB/STATISTICHE_1.htm (30 of 79)26/02/2009 22.53.28

FISICA/MENTE

Nel caso della distribuzione P10 si ha (N=3; n1 = 1; n2 = 1; n3 = 1):

il che corrisponde alle 6 possibilità di realizzazione di questo stato microscopico.

Tenendo ora conto che il volume totale del nostro gas è stato diviso in tre celle (Z1, Z2, Z3) che, implicitamente,

abbiamo supposto di ugual volume segue che ogni cella avrà un volume 1/3, cioè: Z1 =1/3, Z2 = 1/3, Z3 =1/3.

Per avere ora la probabilità di una certa distribuzione

si deve moltiplicare ancora questo numero per la probabilità a priori della distribuzione (quella che nei nostri esempi

era data dall'inverso 1/P del nume ro totale P di distribuzioni possibili); questa probabilità a priori è data dal prodotto:

Riferendoci sempre al secondo degli esempi fatti (N =3; Z = 3) si aveva che il numero totale delle distribuzioni era

P=27; quindi la probabilità a priori per ciascuna distribuzione doveva essere 1/P = 1/27.

Facendo i conti con qualche possibile distribuzione delle 27 complessive, tenendo conto che Z1 = Z2 = Z3 = 1/3, si

trova:

- nel caso in cui n1 = 3, n2 = 0, n3 =0:

file:///C|/$A_WEB/STATISTICHE_1.htm (31 of 79)26/02/2009 22.53.28

FISICA/MENTE

- nel caso in cui n1 = 2, n2 = 1, n3 = 0:

- nel caso in cui n1 = 1, n2 = 1, n3 = 1 :

e, continuando così, si trova che ogni possibile distribuzione ha una probabilità a priori uguale proprio a 1/27.

In definitiva la probabilità matematica di una certa distribuzione è data da:

Ancora riferendoci al secondo esempio vediamo qual è la probabilità di avere una molecola per ogni cella. Si ha (N

= 3, Z = 3, Zi = 1/3, n1 = n2 = n3 = 1):

che è proprio il numero P10/P che avevamo trovato.

file:///C|/$A_WEB/STATISTICHE_1.htm (32 of 79)26/02/2009 22.53.28

FISICA/MENTE

In definitiva, per legare questo simbolismo a quello usato negli esempi, si ha:

A questo punto è utile introdurre la formula di Stirling che rende più semplici i calcoli da svolgere.

Per a molto grande vale la relazione:

a!=aa

Per cui la relazione che ci dà W diventa:

Passando ora ai logaritmi dei due membri si ha:

log W = N log N - n1 log n1 - n2 log n2 - ... - nM log nM + n1 log Z1+ n2 log Z2 + . . . + nM log ZM =>

log W = N log N + n1 (log Z1 - log n1) + n2 (log Z2 - log n2 ) + ... + nM(log ZM - log nM)

=>

log W = N log N +n1 log Z1/n1 +n2 log Z2/n2 + ... + nM log ZM/nM .

Poiché sappiamo che lo stato in cui si troverà il gas sarà quello a cui compete la massima probabilità, dobbiamo

calcolare il valore massimo di log W.

E' un problema di massimo assoluto (sotto le con dizioni di costanza del numero totale di particelle e dell'energia)

Σi ni = N

file:///C|/$A_WEB/STATISTICHE_1.htm (33 of 79)26/02/2009 22.53.28

con

(N = n1 + n2 + ... + nM)

FISICA/MENTE

Σi n i E i = E

con

(E = n1E1+ n2E2 + ... + nMEM)

di una funzione a più variabili (ni) che si risolve normalmente con il metodo dei moltiplicatori di Lagrange.

Per il calcolo si tenga conto che n e Z sono grandezze costanti e che, per quanto abbiamo detto prima:

Σi dni = 0

Σi Ei dni = 0.

Cominciamo con il trasformare l'ultima espressione trovata per log W nel modo seguente:

log W = N log N + π>i ni log Zi/ni.

Tenendo anche conto che

N log N = costante

si può scrivere

log W = costante + Σi ni log Zi/ni.

Usando quindi il metodo dei moltiplicatori di Lagrange sotto le condizioni date si ha:

d (log W) = 0

d (log W) - α Σi dni - β Σi Ei dni = 0

(*)

dove i coefficienti - α e - β sono da determinarsi in base alle condizioni di costanza di N ed E.

E differenziando rispetto ad ni l'espressione che ci dà log W troviamo:

file:///C|/$A_WEB/STATISTICHE_1.htm (34 of 79)26/02/2009 22.53.28

FISICA/MENTE

Inserendo quest'ultima espressione nella (*) si ha :

Fino a questo punto era implicito in quanto dicevamo che le operazioni su N, Z ed E erano valide all'interno di ogni

intervallo di energia. Ma noi dobbiamo arrivare ad una espressione che abbia valore indipendentemente per ciascuno

degli intervalli di energia dati. Ciò vuol dire che nell'espressione che dobbiamo trovare possiamo eliminare la

sommatoria e riferirci ad una generica espressione i:

avendo chiamato con C la quantità costante tra parentesi tonda. Con ovvio simbolismo, la precedente

espressione si può anche scrivere:

n (Ei) = Z (Ei) . C . e-βEi

dove C e β sono le costanti che si possono determinare con le due condizioni ausiliarie di costanza di N e di E. A

questo punto si potrebbe dimostrare che β vale 1/ kT, ma i conti sono complessi e noi ci accontentiamo del risultato. In

definitiva, la relazione scritta è l'espressione di Maxwell-Boltzmann, la quale, ricordiamolo, ci fornisce le possibili

distribuzioni di una energia (totale) E fra un insieme di N molecole:

file:///C|/$A_WEB/STATISTICHE_1.htm (35 of 79)26/02/2009 22.53.28

FISICA/MENTE

(**)

dove: il primo termine sta per il numero di molecole che possiedono energia Ei (la barra sopra ad n sta per "numero

medio"); Z (Ei) = numero di stati (cellette) del sistema a cui compete energia Ei , o meglio, densità degli stati per unità

di energia e di volume; C = costante che si può determinare imponendo che la somma di tutte le molecole è costante ed

uguale ad N; k = costante di Boltzmann = 1,38 . 10-16 erg/grado; T = temperatura assoluta a cui si trova il sistema.

La relazione scritta ci dice che il numero numero medio di molecole che ha energia Ei , dipende dal numero di stati a

cui compete energia Ei e decresce esponenzialmente all'aumentare dell'energia Ei; in altre parole: fra celle di uguali

dimensioni quelle con energia maggiore sono meno popolate di quelle con energia minore; in altre parole ancora: in un

gas ad una data tempera tura T, una data molecola passerà una parte maggiore del suo tempo in stati di energia

inferiore che in sta ti di energia superiore.

Per eliminare il parametro C occorrono dei conti che, al nostro livello, non è possibile fare. Imponendo comunque la

condizione secondo cui la somma di tutte le molecole è costante ed uguale ad N si trova:

C = e E0/kT

dove E0 è un valore costante per l'energia (energia di riferimento). Per cui la relazione (**) diventa

=>

(1)

avendo eliminato, per semplicità, gli indici i.

La (1) sta ad indicare che il numero di molecole che hanno energia E ≠ E0 (energia di riferimento) è proporzionale al

numero degli stati Z (E) che abbiamo a disposizione e aventi energia E secondo il fattore e - (E - E0)/kT. La grandezza che

file:///C|/$A_WEB/STATISTICHE_1.htm (36 of 79)26/02/2009 22.53.28

FISICA/MENTE

ci fornisce il numero medio di molecole, n (E), per semplicità trascritta senza barra sopra, può essere interpretata

anche come il numero degli stati, ad energia E, occupati; mentre la grandezza Z (E) può essere interpretata come il

numero degli stati che abbiamo a disposizione aventi energia E. Per cui, con quanto abbiamo o ra detto, il nostro

problema diventa quello di ricercare tra tutti i possibili stati Z (E) quelli n (E) che sono effettivamente occupati [gli n(E)

sono per noi i casi favorevoli mentre le Z (E) sono per noi i casi possibili].

Ricordando che la probabilità matematica è definita come il numero dei casi favorevoli sul numero dei casi possibili,

possiamo dire che il rapporto n(E)/z(E) rappresenta la probabilità di avere un numero n(E) di molecole con energia E,

di avere, cioè, molecole con energia E diversa da E0 (che era la nostra energia di riferimento). Possiamo indicare questa

probabilità con il simbolo fB(E) e chiamarla funzione di distribuzione di Boltzmann:

Per il numero medio di molecole a cui compete energia E ≠ E0 [poiché ogni molecola è in realtà u no stato energetico,

si potrebbe dire che il numero n(E) medio è il numero degli stati occupati] si ha allora:

(3)

con: primo membro uguale al numero degli stati occupati; Z (E) = numero di stati a disposizione o, meglio, densità degli

stati (per unità di energia e di volume); si può dimostrate che Z (E) = α .E½ , essendo α una costante; fB(E) = probabilità

che uno stato sia occupato. La (3) dice che il numero di molecole con energia E ≠ E0 dipende dal numero degli stati

che hanno energia E (dalla densità degli stati con energia E) e decresce esponenzialmente all'aumentare dell'energia

E; oppure, in altre parole, il numero degli stati occupati è dato dal prodotto della densità degli stati per la probabilità

che uno stato sia occupato (ricordo che, classicamente, se E = 0 tutte le molecole sono al livello energetico più basso).

file:///C|/$A_WEB/STATISTICHE_1.htm (37 of 79)26/02/2009 22.53.28

FISICA/MENTE

Per comprendere meglio il significato delle relazioni scritte vediamo il grafico (abbastanza qualitativo) della (2):

Tenendo conto che fB (E) è una probabilità matematica essa può assumere 1 come suo massimo valore.

Imponiamo quindi che fB (E) sia uguale ad 1 e cerchiamoci le condizioni per l'energia E. Si ha:

Quindi per E = E0 la fB (E) ha un massimo che vale 1. Si vede poi che per E che diventa molto grande (E -> ∞)

segue che fB (E) diventa molto piccola [l'esponenziale della (2) tende a zero].

Il grafico della (2) diventa allora:

(Si osservi che sotto E0 non si può andare) .

6 - LA PRIMA STATISTICA QUANTISTICA: LA STATISTICA DI BOSE-EINSTEIN.

file:///C|/$A_WEB/STATISTICHE_1.htm (38 of 79)26/02/2009 22.53.28

FISICA/MENTE

Peculiarità del metodo di Boltzmann, che abbiamo ora visto, è l'individualità delle singole molecole.

In realtà, due molecole, se possiedono la medesima energia, sono assolutamente indistinguibili.

Quest'ultimo concetto, che può ora sembrare banale, è alla base dell'evoluzione della statistica classica di Boltzmann

nelle statistiche quantistiche.

Nel 1924 Einstein, già premio Nobel (1921) per la sua teoria sull'effetto fotoelettrico e membro dell'Accademia di

Prussia di Berlino, ricevette un articolo del giovane fisico indiano S. N. Bose da tradurre. In questo articolo Bose

dimostrava come la formula che dava la radiazione del corpo nero, ricavata da Planck con metodi classici e con

l'introduzione dei quanti hν come artificio di calcolo, poteva essere ricavata con metodi statistici [si possono andare a

rivedere i conti di Planck nell'articolo n° 18 pubblicato in questa stessa sezione). Era una statistica nuova quella che

Einstein intravide nella nota di Bose ed egli stesso contribuì al suo sviluppo con due successivi articoli. Nasceva così la

statistica quantistica: la statistica di Bose-Einstein.

Vediamo brevemente questa nuova statistica ricordando che venne elaborata nel 1924, tre anni prima, cioè, del

principio di indeterminazione di Heisenberg.

Secondo la meccanica quantistica due molecole debbono essere ritenute indistinguibili se ad esse compete la

medesima energia. E' questo il punto di partenza della statistica quantistica.

Inoltre la statistica quantistica introduce un nuovo concetto molto importante relativo alle dimensioni delle celle

entro cui sistemavamo le molecole classiche.

Abbiamo visto che nel metodo classico usato da Boltzmann le celle erano utili per farci intendere bene le cose, per

renderci tangibile la distribuzione di un certo numero di molecole in certi stati energetici; queste celle erano insomma

un intelligente, ma mero, artificio di calcolo.

Inoltre le dimensioni delle celle non erano determinanti in alcun modo: esse potevano essere prese piccole a piacere

tanto che le confondevamo con un punto.

Ora la meccanica quantistica pone un limite ben preciso all'estensione delle celle: il principio di indeterminazione.

Non avendo noi possibilità di misurare simultaneamente posizione e velocità di una particella (si riveda il principio di

indeterminazione al n° 38 di questa stessa sezione), ci sarà un certo volume minimo entro cui si potrà trovare questa

particella, e questo volume minimo è dato dalla costante di Planck elevata al cubo (h3).

file:///C|/$A_WEB/STATISTICHE_1.htm (39 of 79)26/02/2009 22.53.28

FISICA/MENTE

A questo punto è necessaria una digressione. Il volume di cui si parla non è un ordinario volume (una lunghezza

elevata al cubo), ma un ipervolume. Un volume cioè di uno spazio (spazio delle fasi) a più di tre dimensioni.

Ricordando che il principio di indeterminazione in una dimensione (una dimensione per la posizione ed una per la

velocità) era:

(con h barrato o tagliato che vale h/2 π)si vede che h tagliato era la limitazione all'osservazione in una dimensione.

In tre dimensioni (tre dimensioni per la posizione e tre dimensioni per la velocità: in un volume cioè a sei dimensioni)

il principio di indeterminazione nell'osservazione di una particella diventa:

cioè la limitazione all'osservazione di una particella in tre dimensioni è h tagliato al cubo. Questo fatto vuol dire che non

si può osservare con quanta precisione si vuole una particella in un certo volume ( ∆x . ∆y . ∆z, volume ordinario

adesso) senza alterare considerevolmente il volume delle sue velocità (meglio: delle sue quantità di moto p). Possiamo

allora dire qualcosa di più, a questo punto, sullo spazio delle fasi per una particella: è uno spazio a sei dimensioni, tre

ordinarie e tre componenti la velocità della particella.

Ritornando al volume delle celle, esse hanno quindi dimensioni.determinate dal volume h tagliato al cubo che

corrisponde al volume minimo entro cui si possono, in teoria, individuare due particelle come distinte.

A questo punto, possiamo porci il problema che ci eravamo posti prima di introdurre Boltzmann: dato un certo

numero di particelle (specificheremo, di volta in volta, di che particelle si tratta), come si distribuiscono l'energia a

disposizione? O meglio: quante celle contengono una sola particella, quante due o più, quante nessuna?

Ricominciamo con il primo esempio visto allora.

ESEMPIO 1

file:///C|/$A_WEB/STATISTICHE_1.htm (40 of 79)26/02/2009 22.53.28

FISICA/MENTE

Avevamo tre particelle da distribuire in due celle, la distinguibilità delle particelle ci aveva fatto trovare otto

distribuzioni differenti. Vediamo ora, attesa 1'indistinguibilità delle nuove particelle, quante distribuzioni otteniamo

(ogni particella sarà ora indicata con una x).

Le distribuzioni sono ora in numero di quattro.

Proseguiamo ora con il secondo esempio visto allora.

ESEMPIO 2

Avevamo tre particelle da distribuire in tre celle, la distinguibilità delle particelle ci aveva fatto trovare 27

distribuzioni differenti.

Calcoliamoci ora, nell'ipotesi dell'indistinguibilità delle particelle, quante distribuzioni otteniamo.

file:///C|/$A_WEB/STATISTICHE_1.htm (41 of 79)26/02/2009 22.53.28

FISICA/MENTE

file:///C|/$A_WEB/STATISTICHE_1.htm (42 of 79)26/02/2009 22.53.28

FISICA/MENTE

Le distribuzioni sono ora in numero di dieci.

Terminiamo con .il terzo esempio visto allora.

ESEMPIO 3

Avevamo tre particelle da distribuire in quattro celle, la distinguibilità delle particelle ci aveva fatto trovare 64

distribuzioni differenti. Andiamo o ra a vedere, tenendo conto dell'indistinguibilità del le particelle, quante distribuzioni

otteniamo:

file:///C|/$A_WEB/STATISTICHE_1.htm (43 of 79)26/02/2009 22.53.28

FISICA/MENTE

Le distribuzioni sono ora in numero di 20. Vediamo, anche ora, di ricavare dagli esempi fatti una formula che ci dica

in quanti modi N molecole si possono distribuire in Z celle, tenendo conto che in alcune celle vi possono essere anche più

molecole mentre in altre può non esservene nessuna. La formula è quella delle combinazioni con ripetizione (ripetizione

vuol dire che in ciascuna cella si possono collocare più molecole) CR:

Se abbiamo allora, ad esempio, N = 3 particelle da distribuire in Z = 4 celle, il numero di modi in cui ciò si può fare è

dato da:

Come appunto avevamo trovato nel terzo esempio fatto.

Supponiamo ora di avere N = 3 particelle da distribuire in Z = 3 celle; il numero di modi in cui ciò si può fare è dato

da:

file:///C|/$A_WEB/STATISTICHE_1.htm (44 of 79)26/02/2009 22.53.28

FISICA/MENTE

come avevamo trovato nel secondo esempio fatto.

Supponiamo infine di avere N=3 particelle da da distribuire in Z = 2 celle; il numero di modi in cui ciò si può fare è

dato da:

come avevamo trovato nel primo esempio fatto.

Non ci resta che dare la relazione finale trovata da Bose-Einstein ricordando che, in questo caso, il numero totale di

particelle è N = n1 + n2 + ... (vedi in proposito quanto abbiamo detto trattando Boltzmann) mentre l'energia totale E è

data da E = E1n1+ E2n2 +..., cioè dall'energia E1 tante volte quante sono le particelle a cui compete energia E1,

dall'energia E2 tante volte quante sono le particelle a cui compete energia E2, ecc.

Tenendo conto che i numeri N e Z con cui abbiamo a che fare sono grandissimi, la relazione precedente che ci dava

CR può essere semplificata nella

potendo ovviamente trascurare l'unità.

Applicandosi le combinazioni a qualsiasi valore dell'energia del gas, per la probabilità W avremo:

Applicando anche qui la formula di Stirling, si ha:

file:///C|/$A_WEB/STATISTICHE_1.htm (45 of 79)26/02/2009 22.53.28

FISICA/MENTE

Poiché, come nel caso di Boltzmann, questa relazione è valida per qualsiasi valore dell'energia, sem plifichiamola

riferendoci subito ad una espressione con un indice generico i:

Passando ai logaritmi si ha:

log W = (ni + zi) log (ni + zi) - ni log ni - zi log zi

Dobbiamo ora massimizzare questa espressione sotto le condizioni di conservazione del numero totale di particelle e

dell'energia totale:

Σi ni = N

Σi Ei ni = E

Si ha allora:

d (log W) = 0

d (log W) - α Σi dni - β Σi Ei dni = 0

(**)

Differenziando log W rispetto ad ni si ottiene:

d (log W) = [log (ni + zi) + 1 - log ni - 1] dni = 0

file:///C|/$A_WEB/STATISTICHE_1.htm (46 of 79)26/02/2009 22.53.28

=>

d (log W) = log [(ni + zi)/ni] dni.

FISICA/MENTE

Inserendo questa espressione nella (**) e facendo una considerazione analoga a quella fatta qualche riga più su a

proposito delle sommatorie che compaiono nella (**) si ha:

α

avendo posto e -

= C.

In definitiva la relazione di Bose-Einstein, che ci fornisce le possibili distribuzioni di una energia (totale) E fra un

insieme di N particelle identiche e debolmente interagenti, è:

con: il primo membro = numero di particelle che possiedono energia Ei (la barra sopra ad n sta per "numero medio");

z(Ei) = numero di stati (cellette) del sistema a cui compete energia Ei , o, meglio, densità degli stati per unità di energia

e di volume;

C = parametro da determinarsi imponendo che la somma di tutte le particelle sia co stante ed uguale ad N;

K = costante di Boltzmann;

T =

temperatura (assoluta) a cui si trova il sistema.

La relazione scritta non è così facilmente interpretabile come quella di Maxwell-Boltzmann; essa ci dice comunque

file:///C|/$A_WEB/STATISTICHE_1.htm (47 of 79)26/02/2009 22.53.28

FISICA/MENTE

che il numero medio n(Ei) di particelle che hanno energia Ei, dipende dal numero z(Ei) di stati a cui compete energia Ei

secondo il termine moltiplicativo scritto in forma di frazione al secondo membro.

In altre parole, potendosi interpretare n(Ei) come il numero degli stati (ad energia Ei) che possono essere occupati e z

(Ei) come la probabilità che uno stato (ad energia Ei) sia occupato [e quindi come pe so statistico da dare ad ognuna

delle possibili distribuzioni che ci sono date dalla (4')], la (4') ci dice che il numero di stati (ad energia Ei) che possono

essere occupati è proporzionale al peso statistico dello stato (ad energia Ei) moltiplicato per il fattore scritto sotto forma

di frazione.

Anche l'eliminazione del parametro C richiede , in questo caso, un calcolo che non siamo in grado di affrontare.

Fissata comunque, anche qui, una energia E0 di riferimento, per il parametro C si trova:

C = eE0/kT

=> 1/C = e-.E0/kT ,

mentre la (4') si può scrivere (avendo eliminato per comodità gli indici i) ;

Ricordando di nuovo che la probabilità è definita come il numero dei casi favorevoli diviso per il numero dei casi

possibili, possiamo anche qui dire che il rapporto n(E)/z(E) rappresenta la probabilità di avere particelle con energia E

≠ E0 . Possiamo indicare questa probabilità con il simbolo fE(E) e chiamarla funzione di distribuzione di Einstein:

Per il numero medio n(E) di particelle indistinguibili (che si possono intendere anche come il numero degli stati

occupati) a cui compete energia E ≠ E0 , si ha allora:

file:///C|/$A_WEB/STATISTICHE_1.htm (48 of 79)26/02/2009 22.53.28

FISICA/MENTE

con: il primo membro = numero degli stati occupati; z(E) = numero degli stati a disposizione o, meglio, densità degli

stati (per unità di energia e di volume) ; si può dimostrare che z(E) = β E½ essendo β una costante; fE (E)=

probabilità che uno stato sia occupato. La (6) dice che il numero n(E) di particelle con energia E ≠ E0 dipende dal

numero di stati che hanno energia E (dalla densità degli stati con energia E), decresce esponenzialmente all'aumentare

dell'energia E e tende verso un numero grandissimo, quando E si avvicina sempre più ad E0 (E -> E0 ); oppure, in altre

pa role, il numero degli stati occupati è dato dal prodotto della densità degli stati per la probabilità che uno stato sia

occupato.

Cerchiamo di comprendere meglio il significato delle relazioni scritte servendoci del grafico della (5).

Tenendo conto che fE(E) è una probabilità matematica, essa può assumere 1 come suo massimo valore.

Imponiamo quindi che fE(E) sia uguale ad 1 e cerchiamoci le condizioni per l'energia E. Si ha:

Quindi, per E = E0 + KT log 2, la fE(E) ha un massimo che vale 1.

Si vede poi che quando E è molto grande, e diventa grandissimo e quindi l'uno al denominatore si può trascurare;

rimane, perciò, solo un numero molto grande al denominatore e questo fatto ci dice che la fE(E) diventa molto piccola

(fE(E) -> 0).

Il grafico diventa allora:

file:///C|/$A_WEB/STATISTICHE_1.htm (49 of 79)26/02/2009 22.53.28

FISICA/MENTE

(dove E' = E0 + kTlog2).

Si osservi che per T -> 0 la fE(E) assume il suo massimo valore ad E = E0 e che, anche qui, non si può andare sotto

E0 .

Prima di concludere con la statistica di Bose-Einstein facciamo una importante osservazione: se non ci fosse il -1 al

denominatore della relazione (4'), che ci dà la statistica di Bose-Einstein, essa sarebbe uguale alla relazione trovata da

Maxwell-Boltzmann (**). Infatti:

Possiamo allora dire che quando il -1 al denominato re della (4') si può trascurare rispetto a (1/C).e-Ei/kT , le

statistiche di Bose-Einstein e di Maxwell-Boltzmann coincidono.

7 - LA STATISTICA DI FERMI-DIRAC

file:///C|/$A_WEB/STATISTICHE_1.htm (50 of 79)26/02/2009 22.53.28

FISICA/MENTE

Arrivati a questo punto siamo in grado di dire come si distribuisce l'energia fra le molecole costituenti un gas

classico e quantistico. Rimane però in sospeso la nostra questione iniziale: come si distribuisce l'energia fra gli elettroni

in un metallo.Per vedere in che punti differiscono le due questioni, ricapitoliamo brevemente cos' è una molecola in un

gas secondo il punto di vista classico di Boltzmann, cosa è una particella di Bose secondo il punto di vista quantistico

affermatosi successivamente e cos' è un elettrone in un metallo alla luce del principio di Pauli.

Quando Boltzmann, intorno al 1880, ricavò la sua statistica (estendendo un metodo precedentemente -1860 - usato da

Maxwell) ancora non era stato scoperto l'elettrone (J. J. Thomson, 1897), ancora la teoria atomistica si dibatteva tra

grosse difficoltà e decisi oppositori (la seconda metà dell'800 vide la progressiva affermazione della teoria del campo

come supporto alla teoria dell'azione a contatto ed in op posizione alla teoria corpuscolare che era il supporto,

consapevole od inconsapevole, della teoria dell'azione a distanza) i quanti non erano ancora nati (Planck 1901), tanto

meno si era sviluppato il principio di indeterminazione (Heisenberg, 1927) e la meccanica ondulatoria e quantistica

(diversissimi contributi :tra il 1901 ed .il 1927).

La statistica di Boltzmann poteva dunque nascere solo legata ai corpuscoli costituenti un gas, corpuscoli i quali, non

essendosi mai manifestati, erano soltanto delle piccolissime sfere rigide, indivisibili e perfettamente elastiche chiamate

"molecole".

Boltzmann, d'altra parte, era un fisico classico, e per lui, fissata la posizione e la velocità di una molecola ad un certo

istante era possibile saper tutto su di essa relativamente ad ogni altro istante precedente e successivo solo applicandovi

le leggi newtoniane del moto. Questa molecola poteva dunque essere seguita nel suo movimento: manteneva cioè una

sua individualità.

Il fisico indiano Bose si forma alla scuola della fisica quantistica. Egli, prima del principio di indeterminazione,

intuisce l'indistinguibilità delle particelle ed elabora, con il determinante contributo di Einstein, una statistica che si

differenzia da quella di Boltzmann in due punti importantissimi: le particelle sono indistinguibili ed il volume della cella

non è più piccolo a piacere, ma ben determinato. Le particelle costituenti il gas di Bose sono dunque indistinguibili, esse,

analogamente alle molecole di Boitzmann, interagiscono debolmente e possono trovarsi in una fissata cella (anche come

dimensioni) in qualsivoglia numero.

Intanto (1897) nasceva l'elettrone e questa nascita porta un poco di scompiglio nella fisica. L'esistenza di un

corpuscolo di carica negativa solleva di versi problemi soprattutto sulla costituzione atomica: se l'elettrone negativo

appartiene ad un atomo neutro, deve esservi nell'atomo una carica positiva. Ben presto (1911) Rutherford dà

un'identità a questa carica positiva e la pone al centro dell'atomo.Nasco no però dei problemi di stabilità per l'edificio

atomico per sistemare i quali Bohr (1911) lo puntella con i quanti introdotti da Planck. Il resto è storia nota.

file:///C|/$A_WEB/STATISTICHE_1.htm (51 of 79)26/02/2009 22.53.28

FISICA/MENTE

E' la storia che porta alle formulazioni complete delle meccaniche ondulatoria e quantistica.

L'elettrone paga un certo prezzo per aver contribuito a scombussolare tutto: perde la sua consistenza diventando,

nell'atomo, nuvola di probabilità.

Inoltre Pauli lo costringe a stare su di un livello energetico in compagnia di un solo altro elettrone, a patto che

quest'ultimo abbia spin opposto.

In definitiva gli elettroni non hanno una loro individualità: se possiedono la medesima energia sono assolutamente

indistinguibili tra di loro (nessuno si accorgerebbe dello scambio di posto di due elettroni con la stessa energia).

Di questi elettroni infine ve ne possono essere al massimo due su ogni livello energetico (se hanno spin antiparalleli)

ovvero, che è lo stesso, vi può essere un solo elettrone in ogni stato: fissata una celletta (uno stato) su questa o c'è un

elettrone o non c'è. E queste sono le premesse che hanno portato Enrico Fermi a formulare nel 1926 la famosa statistica

che prende il nome di statistica di Fermi-Dirac.

Appunto nel 1926 Fermi, ancora in Italia, e stese il principio di Pauli dall'ambito di un solo a tomo ad un sistema

fisico più complesso qual'è un gas.

Nel suo fondamentale articolo Fermi prese le mosse dai lavori di Nerst del 1906 [ la famosa legge da lui ricavata e

conosciuta anche come il terzo principio della termodinamica, afferma l'impossibilità di raggiungere lo zero assoluto]

sull'entropia e dal principio di Pauli enunciato appena un anno prima per introdurre una nuova trattazione statistica.

Qualche mese più tardi, ed indipendentemente, anche Dirac arrivò agli stessi risultati; per questo la statistica che ora

studieremo prende il nome di statistica di Fermi-Dirac.

Le considerazioni fatte si possono riassumere così: gli elettroni non sono distinguibili ed al massimo ce n'è uno solo in

ogni celletta (stato).

La domanda che ci poniamo è la seguente: dato un certo numero di elettroni, come si distribuiscono l'energia a

disposizione?

Riprendiamo allora in considerazione i tre esempi fatti sia nel caso di Maxwell-Boltzmann sia nel caso di BoseEinstein.

ESEMPIO 1

file:///C|/$A_WEB/STATISTICHE_1.htm (52 of 79)26/02/2009 22.53.28

FISICA/MENTE

Avevamo tre particelle da distribuire in due celle: nel caso di Maxwell-Boltzmann avevamo trovato otto

distribuzioni, nel caso di Bose-Einstein ne avevamo trovate quattro.

In questo caso, l'esempio non è proponibile in quanto per sistemare tre elettroni in due stati dobbiamo

necessariamente metterne due in uno stato solo e la cosa è in contrasto con il principio di Pauli.

ESEMPIO 2

Avevamo tre particelle da distribuire in tre celle: con la trattazione di Maxwell-Boltzmann avevamo trovato 27

distribuzioni, con quella di Bose-Einstein ne avevamo trovate 10. Vediamo quante se ne possono trovare con la statistica

di Fermi-Dirac (indichiamo, come nel caso di Bose-Einstein, ogni elettro ne con una x); si ha:

Evidentemente si ha una sola distribuzione possibile.

ESEMPIO 3

Avevamo tre particelle da distribuire in quattro celle: con il metodo di Maxwell-Boltzmann avevamo trovato 64

distribuzioni, con quello di Bose-Einstein ne avevamo trovate 20. Cerchiamo ora le possibili distribuzioni secondo le

nuove ipotesi di Fermi-Dirac, si ha:

Ora le distribuzioni sono in numero di quattro.

Anche ora cerchiamoci, in base agli esempi fatti, una semplice formula che ci informi sul numero dei modi in cui N

elettroni si possono distribuire in Z celle, tenendo conto che in una cella o c'è un solo elettrone o non ce n'è nessuno.

La formula è analoga a quella vista in Bose-Einstein; è anch'essa una formula che ci dà il numero di combinazioni,

file:///C|/$A_WEB/STATISTICHE_1.htm (53 of 79)26/02/2009 22.53.28

FISICA/MENTE

però, questa volta, senza ripetizioni (nel senso che in ogni cella vi può essere al massimo un elettrone). La formula delle

combinazioni senza ripetizione (CSR) è:

Riapplichiamola ai nostri esempi e confrontiamo i risultati.

Se abbiamo N = 3 elettroni da distribuire in Z = 2 celle si ha:

e la relazione non ha significato perché, come si vede, al denominatore compare (-1) ed il fattoriale è definito solo per

numeri naturali, per i numeri cioè interi e positivi (oltre al numero zero, avendo definito 0!=1).

Se abbiamo N = 3 elettroni da distribuire in Z = 3 celle si ha:

come abbiamo ottenuto nel secondo esempio.

Se abbiamo N = 3 elettroni da distribuire in Z = 4 celle si ha:

come abbiamo trovato nel terzo esempio.

Applicandosi le combinazioni CSR a qualsiasi valore dell'energia del gas, per la probabilità matematica W avremo:

file:///C|/$A_WEB/STATISTICHE_1.htm (54 of 79)26/02/2009 22.53.28

FISICA/MENTE

Applicando anche qui la formula di Stirling si ha:

Valgono anche qui le stesse considerazioni (fatte per Maxwell-Boltzmann e per Bose-Einstein) sulle sommatorie, per cui

possiamo scrivere:

Passando ai logaritmi si ha:

log W = zi log zi - ni log ni - ( zi - ni) log ( zi - ni )

Massimizzando, sotto le condizioni Σi ni = N

e Σi Ei ni = E, si trova:

d (log W) = 0

d (log W) - α Σi dn. - βΣi Ei dni =0

(**)

Differenziando log W rispetto ad ni si ottiene:

d (log W) = [ - log ni - 1 + log (zi - ni) + 1] dni

file:///C|/$A_WEB/STATISTICHE_1.htm (55 of 79)26/02/2009 22.53.28

=>

d (log W) = log [(zi - ni)/zi] . dni

FISICA/MENTE

Inserendo questa espressione nella (**) e facendo una considerazione analoga a quella fatta qualche riga più su a

proposito delle sommatorie che compaiono nella (**) si ha:

avendo posto e-α = C.

Possiamo allora dare la relazione di Fermi-Dirac che ci fornisce le possibili distribuzioni di una energia (totale) E fra

un insieme di N elettroni (identici e soggetti al principio di Pauli); essa è:

con: il primo membro = numero di elettroni che possiedono energia Ei ( la barra sopra ad n, che ometteremo

discorsivamente, sta per "numero medio"); z(Ei) = numero di stati (cellette) del sistema a cui compete energia Ei , o

meglio, densità degli stati per unità di energia e di volume; C = parametro da determinarsi imponendo che la somma di

tutte le particelle sia costante ed uguale ad N; K = costante di Boltzmann; T = temperatura (assoluta) a cui si trova il

sistema.

La relazione scritta ci dice che il numero n(Ei) di elettroni, che ha energia Ei , dipende dal numero z (Ei) di stati a

cui compete energia Ei secondo il termine moltiplicativo di z(Ei) al secondo membro.

In altre parole, potendosi interpretare n(Ei) come il numero degli stati (ad energia Ei) che posso no essere occupati e

z(Ei) come la probabilità che uno stato (ad energia Ei) sia occupato [e quindi: co me peso statistico da dare ad ognuna

delle possibili distribuzioni che ci sono date dalla (7')], la (7') ci dice che il numero di stati (ad energia Ei) che possono

file:///C|/$A_WEB/STATISTICHE_1.htm (56 of 79)26/02/2009 22.53.28

FISICA/MENTE

essere occupati è proporzionale al peso statistico dello stato (ad energia Ei) moltiplicato per il fattore moltiplicativo di z

(Ei).

Facciamo subito delle considerazioni: se non ci fosse il +1 al denominatore la (7') sarebbe identica alla distribuzione

di Maxwell-Boltzmann. Infatti:

Possiamo allora dire che, quando il +1 al denominatore della (7') si può trascurare rispetto all'altro termine che vi

compare , anche la statistica di Fermi-Dirac (oltre a quella di Bose-Einstein nel caso si poteva trascurare il -1 al

denominatore) coincide con quella di Maxwell-Boltzmann.

Un'altra osservazione relativa al confronto tra le formule che ci forniscono le statistiche di Bose- Einstein e di FermiDirac: le due statistiche differiscono apparentemente solo per un'inezia, solo per il fatto che al denominatore dell'una

(Bose-Einstein) c'è -1 mentre al denominatore dell'altra (Fermi-Dirac) c'è +1. Questo fatto è invece estremamente

importante e differenzia profondamente le due statistiche come vedremo nel seguito.

Occorrerebbe a questo punto eliminare il parametro C ma, come nel caso di Bose-Einstein, non siamo in grado di

fare questo conto. Fissiamo allora, anche qui, una energia di riferimento e chiamiamola EF (energia di Fermi).

Per il parametro C si trova:

C = e EF/kT

=> 1/C = e - EF/kT

mentre la (7') si può scrivere (avendo eliminato per comodità gli indici i)

file:///C|/$A_WEB/STATISTICHE_1.htm (57 of 79)26/02/2009 22.53.28

FISICA/MENTE

Ricordando, ancora una volta, che la probabilità è definita come il numero dei casi favorevoli diviso per il numero dei

casi possibili, possiamo dire che il rapporto n(E)/z(E) rappresenta la probabilità di avere elettroni con energia E ≠ EF.

Possiamo indicare questa probabilità con il simbolo fF(E) e chiamarla funzione di distribuzione di Fermi:

Per il numero di elettroni (indistinguibili e soggetti al principio di Pauli) con energia E ≠ EF (con EF = energia di

riferimento) si ha allora:

con: n(E) = numero degli stati occupati; z(E) = numero degli stati a disposizione o, meglio, densità degli stati (per

unità di energia e di volume); si può dimostrare che z(E) = γ.E1/2 essendo γ una costante; fF(E) = probabilità che uno

stato sia occupato. La (9) dice che il numero n(E) di elettroni con energia E ≠ EF dipende dal numero di stati che hanno

energia E (dalla densità degli stati con energia E), decresce esponenzialmente all'aumentare dell'energia E e tende a

ridursi alla metà quando E assume valori sempre più vicini ad EF (E -> EF ) ; oppure, in altre parole, il numero degli

stati occupati è dato dal prodotto della densità degli stati per la probabilità che uno stato sia occupato.

Vediamo anche ora, come abbiamo fatto per Maxwell-BoItzmann e per Bose-Einstein, i grafici delle relazioni scritte.

Cominciamo con lo studiare il grafico della (8). Poiché la temperatura risulta, in questo caso, un pa rametro molto

importante, cominciamo con il distinguere due casi:

1) T = 0

2) T ≠ 0

file:///C|/$A_WEB/STATISTICHE_1.htm (58 of 79)26/02/2009 22.53.28

FISICA/MENTE

e studiamo la (8) prima nel caso in cui risulti T=0 e quindi nel caso risulti T ≠ 0.

Sia poi, che risulti T=0 o T ≠ 0, si possono avere diverse eventualità per i valori assunti dall' energia, cioè:

1) può risultare T = 0 e

o

a) E < EF;

2) può risultare T ≠ 0 e

o

a) E < EF;

o

b) E > EF;

o

b) E = EF;

o

c) E > EF.

Studiamo allora i vari casi che si possono presentare. Si ha:

1 a)

T = 0;

E < EF; =>

E - EF < 0

Si ha:

e questo vuol dire che a energie E < EF la fF(E) si mantiene sempre uguale ad 1.

1 b)

T = 0;

E > EF

=>

Si ha:

file:///C|/$A_WEB/STATISTICHE_1.htm (59 of 79)26/02/2009 22.53.28

E - EF > 0

FISICA/MENTE

e questo vuol dire che a energia E > EF la fB(E) si mantiene sempre uguale a 0.

Il grafico della funzione di distribuzione di Fermi fF (E), nell'eventualità che risulti T=0, è allora fatto:

Che significa un grafico come quello ora disegnato? Ricordiamo che fF(E) rappresenta la probabilità che uno stato sia

occupato e che avere una probabilità 1 vuol dire avere certezza dell'evento mentre avere probabilità 0 vuol dire

impossibilità dell'evento; allora il grafico rappresenta la situazione descritta nel seguito.

Allo zero assoluto (T = 0) tutti i possibili stati al di sotto dell'energia di Fermi (EF) sono occupati, mentre tutti i

possibili stati al di sopra di EF sono vuoti (tra parentesi diamo una prima definizione dell'energia EF di Fermi: è

l'energia che compete al più alto livello energetico occupato quando ci troviamo allo zero assoluto; e poiché il più alto

livello occupato dipende dal numero di elettroni che si hanno per unità di volume, possiamo dire che la posizione del

livello di Fermi dipende dal numero di elettroni per unità di volume che si hanno).

Si osservi che per E=EF la fF(E) presenta una dis continuità passando dal valore 0 al valore 1.

file:///C|/$A_WEB/STATISTICHE_1.htm (60 of 79)26/02/2009 22.53.28

FISICA/MENTE

Continuiamo allora a studiare i casi che abbiamo elencato qualche pagina indietro.

2 a) T ≠ 0;

kT << EF

=>

E << EF

=>

E - EF << 0

Si ha che in base alle posizioni iniziali, e -.(E - EF)/kT risulta piccolissimo potendosi quindi trascurare rispetto all'uno del

denominatore:

e questo vuol dire che ad energia E << EF la fF(E) ha lo stesso andamento della fF(E) a T = 0.

2 b) T ≠ 0;

kT qualunque,

E = EF

=>

E - EF = 0

Si ha:

e questo vuoi dire che per E = EF la fF(E) si è ridotta alla metà rispetto al valore che aveva a T=0.

2 c) T ≠ 0;

kT >> EF =>

E > EF

=>

E - EF > 0

Si ha che, in base alle posizioni iniziali, si può trascurare l'uno al denominatore rispetto ad e -.(E - EF)/kT che risulta

grande:

file:///C|/$A_WEB/STATISTICHE_1.htm (61 of 79)26/02/2009 22.53.28

FISICA/MENTE

e questo vuoi dire che la fF(E) assume un'espressione uguale a quella della fB(E) di Boltzmann quando E > EF.

Il grafico che ne risulta è il seguente:

Si può vedere che quando E << EF il grafico è praticamente lo stesso che si otteneva a T = 0. Quindi all'aumentare

della temperatura T (o dell'energia E) solo gli elettroni che hanno una energia pari alla EF di Fermi meno alcuni kT

acquistano energia e vanno a occupare stati liberi ad energia più alta. Dal livello EF di Fermi in poi (al crescere di E)

sono pochi gli elettroni e tanti gli stati, quindi la situazione statistica è analoga a quella di un gas, analoga cioè a quella

trattata da Maxwell-Boltzmann (ricordiamo che questo fatto era stato osservato già in precedenza quando avevamo

affermato che nel caso il +1 al denominatore della fF(E) si poteva trascurare ritornavamo nel caso della funzione di

distribuzione fB(E) di Boltzmann); si parla allora (quando cioè E >EF) di una coda di Boltzmann. Ancora qualcosa c'è

da dire a proposito del livello EF di Fermi. Con i no stri conti abbiamo visto che per E = EF si ha fF(E) = 1/2 .

file:///C|/$A_WEB/STATISTICHE_1.htm (62 of 79)26/02/2009 22.53.28

FISICA/MENTE

Ricordando allora il significato di fF(E) possiamo dare quest'altra definizione del livello EF di Fermi: è il livello che a

T = 0 ha una probabilità del 50% di essere occupato.

Dopo aver visto l'andamento della fF(E) sia a T = 0 sia a T ≠ 0 , vediamo qual è l'andamento della z(E) densità degli

stati; si ha:

z(E) = γ . E½

ricordando quanto sappiamo di geometria analitica, l'espressione scritta rappresenta un arco di parabola con vertice

l'origine degli assi e con asse la direzione positiva dell'asse delle ascisse (nel nostro caso E):

Rimane ora da studiare solo l'andamento della relazione (9) che è il prodotto tra la fF(E) e la z(E):

Anche qui occorrerà distinguere nei vari casi che abbiamo già elencato quando abbiamo discusso la fF(E):

1 a)

T = 0;

E < EF

=>

file:///C|/$A_WEB/STATISTICHE_1.htm (63 of 79)26/02/2009 22.53.28

E - EF < 0

FISICA/MENTE

Si ha:

e questo vuol dire che a energia E < EF la n(E) ha lo stesso andamento visto per la z(E).

1 b)

T = 0;

E > EF

=>

E - EF > 0

Si ha:

e questo vuol dire che a energie E >EF , la n(E) ha lo stesso andamento visto per la fF(E) quando, appunto, si aveva E >

EF.

II grafico del numero degli stati occupati n(E), in funzione dell'energia E, nell'eventualità che risulti T = 0, è allora

fatto:

file:///C|/$A_WEB/STATISTICHE_1.htm (64 of 79)26/02/2009 22.53.28

FISICA/MENTE

Cerchiamo di capire il significato di un grafico come quello ora fatto.

Innanzitutto il grafico rappresenta il numero relativo di elettroni nello stato più stabile (T = 0) in funzione

dell'energia.

Per ogni unità di energia (asse delle ascisse) si ha un minor numero di elettroni (asse delle ordinate) quando l'energia

è piccola (E ≈ 0) del numero di elettroni che si ha quando l'energia è grande (E ≈ EF) . Quando poi l'energia supera EF

allora non si ha più nessun elettrone negli stati liberi ad energia superiore, appunto, ad EF. Questo fatto si verifica

perché a basse energie gli intervalli tra livelli energetici sono più grandi degli intervalli tra livelli a basse energie:

file:///C|/$A_WEB/STATISTICHE_1.htm (65 of 79)26/02/2009 22.53.28

FISICA/MENTE

Quindi i livelli energetici sono più distanziati a basse energie di quanto lo siano ad alte energie; questo fatto

comporta che più elettroni per unità di energia si possono sistemare ad energia più al ta.

Tutti i livelli energetici sono così occupati da tutti gli elettroni che si hanno a disposizione, fino al livello EF di Fermi.

Tutti i livelli fino ad EF sono occupati e gli elettroni risultano ben impacchettati: nessun elettrone ha una energia,

neppure di poco, superiore a quanto gli è necessaria per occupa re i successivi livelli energetici (in accordo con il

principio di Pauli e con l'indistinguibilità degli elettroni).

Continuiamo allora a studiare i possibili casi che si possono verificare.

2 a)

T ≠ 0;

kT << EF

=>

E << EF

=>

E - EF << 0

Si ha che, in base alle posizioni iniziali, e (E-EF)/kT risulta piccolissimo potendosi quindi trascurare rispetto all'uno al

denominatore:

file:///C|/$A_WEB/STATISTICHE_1.htm (66 of 79)26/02/2009 22.53.28

FISICA/MENTE

e questo vuol dire che ad energia E << EF la n(E) ha lo stesso andamento della n(E) a T = 0.

2 b)

T ≠ 0;

kT qualunque;

E = EF

=>

E - EF = 0

Si ha:

e questo vuol dire che, quando E = EF , la n(E) si è ridotta alla metà rispetto al valore che aveva a T = 0.

2 c)

T ≠ 0;

kT >> EF

=>

E >> EF

=>

E - EF >> 0

Si ha che, in base alle posizioni iniziali, si può trascurare l'uno al denominatore rispetto ad e -.(E-EF)/kT che risulta

grande:

e questo vuol dire che, quando E >> EF, la n(E) assume una espressione uguale a quella che avevamo trova to per la n

(E) di Boltzmann.

file:///C|/$A_WEB/STATISTICHE_1.htm (67 of 79)26/02/2009 22.53.28

FISICA/MENTE

Il grafico che ne risulta è il seguente:

Si può subito osservare che quando E << EF il grafico è praticamente lo stesso che si otteneva a T = 0.

All'aumentare della temperatura T (o dell'energia E) solo gli elettroni che hanno una energia pari alla EF di Fermi

meno alcuni kT acquistano energia e vanno ad occupare stati liberi ad energia più alta.

Dal livello di Fermi (EF) per valori dell'energia (E) crescenti sono pochi gli elettroni, mentre gli stati sono

praticamente infiniti; la situazione statistica è allora la stessa di un gas di molecole, analoga cioè a quella trattata da

Maxwell-Boltzmann; conseguenza di ciò è che la parte di grafico che si sviluppa da EF verso le E crescenti è chiamata

coda di Boltzmann.

Un'ultima cosa, estremamente importante, da evidenziare è che allo zero assoluto (T = 0) l'energia posseduta da un

insieme qualsivoglia di elettroni non si annulla (non potendovi essere più di un elettrone per cella è evidente che la cella

a cui compete energia E = 0 potrà essere occupata da un solo elettrone; tutti gli altri elettroni si sistemeranno in celle ad

energia superiore).

file:///C|/$A_WEB/STATISTICHE_1.htm (68 of 79)26/02/2009 22.53.28

FISICA/MENTE

8 - CONFRONTO FRA LE TRE STATISTICHE

E' importante cercare di capire perché sono sta te sviluppate le tre statistiche che abbiamo studiato confrontandole

tra loro.

La statistica di Maxwell-Boltzmann, sviluppata nell'ultima metà del secolo scorso, forniva delle buone previsioni

teoriche, verificate poi sperimentalmente, sul comportamento di un gas in condizioni normali (pressione atmosferica: P

= 1 atmosfera; temperatura ordinaria ambiente: T = 300 °K).

In quegli stessi anni si lavorava (') intensamente nel campo della fisica delle basse temperature (soprattutto ad opera

di Dewar a Cambridge e di Kamerlingh-Onnes a Leida). Si stavano liquefacendo tutti i gas, solo l'elio resiste va fino a

temperature bassissime (l'elio fu poi liquefatto per la prima volta a Leida nel 1908 ad opera di Kamerlingh-Onnes).

Il susseguirsi di una notevole mole di dati sperimentali, di fatti e dati allora incomprensibili, dette un notevole

impulso alla ricerca teorica, alla ricerca di spiegazioni sempre più corrispondenti ai fatti osservati. Molti fenomeni

osservati nella fisi ca delle basse temperature risultavano comunque del tutto incomprensibili dal punto di vista della

fisica classica: Vale la pena aprire una breve parentesi proprio sull'elio.

L'elio, che liquefa a circa 5 °K= - 268 °C non solidifica neanche alla temperatura di 0,000016 °K ≈ - 273 °C

(raggiunta da Simon a Oxford nel 1956) e non solidificherebbe neanche allo zero assoluto (T = 0 °K = - 273°C): questo

fatto è in contrasto con la fisica classica che prevede la solidificazione di tutte le sostanze a temperature così basse.

Inoltre, secondo la fisica classica, il calore specifico di un gas ideale (elio, ad esempio) deve rimanere finito anche allo

zero as soluto (e deve valere c = 3/2 R con R = kN =1,99 calo rie/grado, con k = costante di Boltzmann e N = numero di

Avogadro) . Questo fatto è però in contrasto con l'esperienza: infatti il calore specifico decresce man mano che ci si

avvicina allo zero assoluto (la cosa fu predetta da Nerst nel 1916 ed il processo, allora ancora ignoto, secondo cui il

calore specifico decresce lo chiamò degenerazione del gas, mentre un gas a temperature vicine allo zero assoluto venne

chiamato degenere).

A tutta questa messe di dati sperimentali e a queste incongruenze (oltre a quelle relative alla ra diazione emessa da

un corpo nero) la statistica di Maxwell-Boltzmann non dava alcuna risposta che fosse in accordo con l'esperienza. Ed

era logico. Occorreva che si introducessero i quanti per spiegare la gran parte dei fatti sperimentali che si

accumulavano; e i quanti furono introdotti nel 1900 da Planck. Da allora si cominciò a lavorare assiduamente per

trovare delle spiegazioni teoriche alle deviazioni cui accennavamo.

file:///C|/$A_WEB/STATISTICHE_1.htm (69 of 79)26/02/2009 22.53.28

FISICA/MENTE

Le cose importanti, per quanto ci riguarda ora, introdotte dalla meccanica quantistica sono: l'indistinguibilità delle

particelle e la quantizzazione della loro energia, il principio di indeterminazione ed il principio di Pauli.

Come abbiamo già detto qualche pagina indietro Bose-Einstein svilupparono (1924) la loro statistica introducendo

l'indistinguibilità delle particelle e la quantizzazione della loro energia ed anche (in qualche modo) il principio di

indeterminazione (pur non essendo quest'ultimo ancora stato enunciato - 1927) quando si fissava h3 come volume delle

cellette a disposizione delle particelle. Con la statistica di Bose-Einstein si riuscirono a spiegare compiutamente due

importanti fenomeni: la radiazione del corpo nero e l'annullarsi del calore specifico allo zero assoluto (poiché nella

statistica quantistica di un gas ideale si hanno stati energetici separati, anche il calore specifico di un tale gas deve essere

quantizzato ed annullarsi allo zero assoluto).

Fermi e Dirac introdussero nella trattazione statistica di un gas di elettroni (1926) il principio di esclusione di Pauli

(1925) e con la loro statistica resero conto di moltissimi altri fatti sperimentali.

Comunque da quanto abbiamo ora detto è chiaro che il problema nasceva perché il gas degenerava, infatti in

condizioni di non degenerazione vale la statistica di Maxwell-Boltzmann.

Nelle formule che abbiamo incontrate, sia in quella di Maxwell-BoItzmann (1) sia in quella di Bose-Einstein (4) sia

in quella di Fermi-Dirac (7):

si può individuare in -E0/kT [per la (1) e la (4)] e in -EF/kT [per la (7)] un parametro, cosiddetto, di degenerazione.

Infatti, quando -E0/KT (ovvero -EF/KT) è molto minore di 1 si è in condizioni di degenerazione e, non potendosi