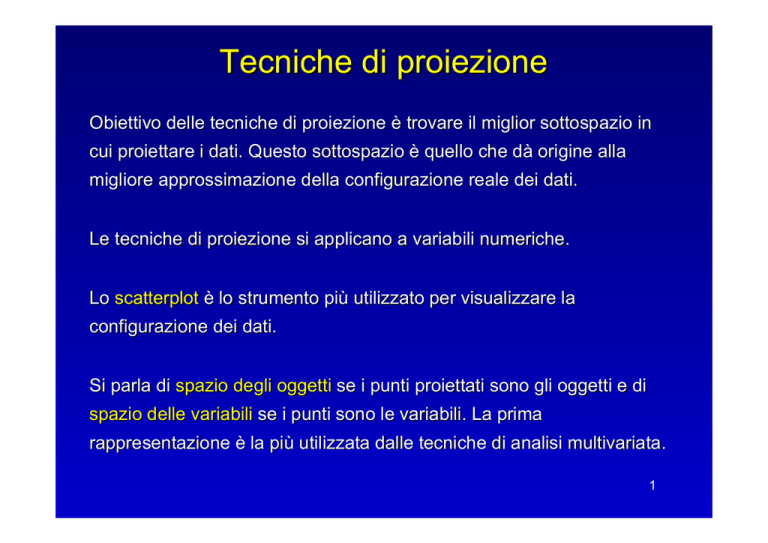

Tecniche di proiezione

Obiettivo delle tecniche di proiezione è trovare il miglior sottospazio in

cui proiettare i dati. Questo sottospazio è quello che dà origine alla

migliore approssimazione della configurazione reale dei dati.

Le tecniche di proiezione si applicano a variabili numeriche.

Lo scatterplot è lo strumento più utilizzato per visualizzare la

configurazione dei dati.

Si parla di spazio degli oggetti se i punti proiettati sono gli oggetti e di

spazio delle variabili se i punti sono le variabili. La prima

rappresentazione è la più utilizzata dalle tecniche di analisi multivariata.

1

Definizione dello spazio degli oggetti

x2

x2

Centratura

x′ij = x ij − x j

x3

C

x1

x3

Standardizzazione

o autoscaling

x′ij =

x1

x ij − x j

sj

Se x1 ha una distribuzione normale, allora

la distanza tra i due iperpiani è circa 6

volte la sua deviazione standard.

La correlazione tra variabili influenza la forma dell’iperellissoide.

Con variabili ortogonali si ottiene una ipersfera.

2

Analisi delle componenti principali (PCA)

X2

X1= altezza

X2= peso

Dati centrati

T1

T2

α

T1= dimensione individui

X1

T2= forma individui

t 1 = x1 cos α + x 2 sin α = a11x1 + a12 x 2

combinazione lineare (a11 e a12

hanno lo stesso segno)

t 2 = − x1 sin α + x 2 cos α = a21x1 + a22 x 2

contrasto lineare (a21 e a22

hanno segno opposto)

3

Analisi delle componenti principali

X2

Riduzione della dimensionalità dello spazio:

poichè la dispersione dei punti su T1 è molto

più grande di quella su T2, proiettando i punti

T1

T2

Pi

su T1 si ottiene una buona approssimazione

1-dimensionale della configurazione reale 2-

α

dimensionale dei punti.

Pi’

O

X1

Problema: diversi valori di α generano

diverse variabili T1, quale α scegliere?

Il migliore asse T1 è quello che

determina il minor spostamento dei punti

dalla loro posizione originale (Pearson

1901).

minimizzare:

n

1

2

⋅ ∑ Pi Pi ′

n − 1 i =1

b g

varianza delle proiezioni lungo T1

n

1

⋅ ∑ ti − 0

n − 1 i =1

b

g

2

n

1

=

⋅ ∑ t i2

n − 1 i =1

massimizzare:

n

1

2

⋅ ∑ 4OPi ′

n − 1 i =1

b g

Analisi delle componenti principali

Se lo spazio originale è definito da p variabili...

1. si cerca il primo asse T1 caratterizzato dalla massima dispersione delle

proiezioni dei punti,

2. quindi, tra tutti gli assi ortogonali a T1, si cerca l’asse T2 tale che i punti

proiettati abbiano massima dispersione.

3. Il terzo asse T3, tra tutti gli assi ortogonali a T1 e T2, è quello a massima

varianza delle proiezioni, e così di seguito.

Il processo continua fino a determinare p assi mutualmente ortogonali.

5

Analisi delle componenti principali

L’analisi delle componenti principali (PCA) è il processo che consente di

determinare p assi mutualmente ortogonali.

Ciascun asse definisce una nuova variabile:

t m = am1x1 + am 2 x 2 + L + amp x p

I coefficienti amj sono determinati in modo tale che:

1. la varianza di tm sia massima

2. le variabili tm siano mutualmente ortogonali

p

3.

∑ amj2 = 1

j =1

Le variabili tm così ottenute prendono il nome di componenti principali

(fattori, variabili latenti).

I coefficienti amj delle componenti principali prendono il nome di loadings

(standardizzati) e vengono comunemente definiti con il simbolo lmj.

6

Analisi delle componenti principali

Se si proiettano i punti nello spazio definito dalle p componenti principali

si ottiene la configurazione reale dei punti. Se si desidera ottenere la

migliore rappresentazione di questa configurazione in uno spazio a M

dimensioni (M < p), occorre semplicemente proiettare i punti nello spazio

definito dalle prime M componenti principali.

Le coordinate dei punti rispetto alle prime M componenti principali sono:

t i1 = l11x i1 + l 21x i2 + K + l p1x ip

t i2 = l12 x i1 + l 22 x i2 + K + l p2 x ip

L

t iM = l1M x i1 + l 2M x i2 + K + l pM x ip

(n, M)

(n, p) (p, M)

T = X⋅L

Le coordinate degli oggetti rispetto alle componenti principali prendono il

nome di scores.

7

Analisi delle componenti principali

ATTENZIONE ...

Nonostante la configurazione dei punti nello spazio delle prime M

componenti principali sia la migliore approssimazione della configurazione

reale, occorre ricordare che si tratta comunque di un’approssimazione!

Il grado di approssimazione dipende dal grado di riduzione della

dimensionalità dello spazio.

Se la riduzione di dimensionalità è grande, è alta la probabilità di

distorsione della configurazione dei punti. Ciò significa che alcune

relazioni tra gli oggetti osservate nello spazio a M componenti principali

potrebbero differire da quelle nello spazio originale.

8

Analisi delle componenti principali

La procedura matematica per il calcolo delle componenti principali

consiste nel calcolo degli autovalori e autovettori associati della matrice di

covarianza S, ottenuta dalla matrice dei dati X.

Gli autovalori λm della matrice di covarianza vengono ordinati in senso

decrescente e rappresentano la varianza delle proiezioni lungo le

componenti principali.

b g

n

2

λ m = Var t m = ∑ t im

i =1

Gli autovettori lm della matrice di covarianza sono vettori a lunghezza

unitaria che definiscono le direzioni delle componenti principali. Gli

elementi degli autovettori sono i coefficienti ljm (loadings) delle

combinazioni lineari (componenti principali).

− 1 ≤ l jm ≤ +1

∑ j l 2jm = 1

9

Analisi delle componenti principali

variabili xj

dati

n,p

S

pc tm

diag

varianze

covarianze

p,p

pc tm

variabili xj

X

scores

n,p

autovalori

pc tm

T = X ⋅L

variabili x j

T

Λ

p,p

pc tm

oggetti

oggetti

variabili xj

L

loadings

p,p

10

Analisi delle componenti principali

Matrice degli autovalori Λ

λ1

0 K 0

0 λ2 K 0

Λ≡

K K K K

0

0

K λp

b g

λ m = Var t m

λ1 ≥ λ 2 ≥ K ≥ λ p ≥ 0

∑ j λ j = tracebSg

∏ j λ j = detbSg

La matrice degli autovalori è la matrice di covarianza

delle componenti principali.

11

Analisi delle componenti principali

L’analisi delle componenti principali è usata per:

- visualizzare i dati (configurazione degli oggetti) e osservare le

relazioni interne (individuazione di outliers e gruppi, ...);

- ridurre la dimensionalità dello spazio dei dati;

- sintetizzare la descrizione dei dati (eliminazione del rumore, ...);

- valutare le correlazioni tra le variabili e il ruolo che hanno nel

determinare la configurazione dei dati;

- ricercare proprietà principali;

- definire uno spazio ortogonale in cui cercare modelli per i dati.

12

Analisi delle componenti principali

Scalatura delle variabili?

I risultati dell’analisi delle componenti principali sono fortemente

influenzati dall’aver o meno effettuato la scalatura delle variabili.

Quando le variabili

-

rappresentano entità diverse (ex. peso e altezza)

-

sono espresse con unità di misura differenti

-

hanno varianze non confrontabili (ordini di grandezza diversi)

è sempre consigliabile effettuare l’autoscaling (standardizzazione)

delle variabili prima della PCA.

In alternativa all’autoscaling si possono calcolare gli autovalori e gli

autovettori della matrice di correlazione C.

13

Analisi delle componenti principali

Come determinare il numero di componenti principali significative?

Effettuata l’analisi delle componenti principali, occorre decidere quante

componenti principali servono per ottenere una “buona” approssimazione

della configurazione reale dei dati.

La misura della bontà di tale approssimazione è una qualche funzione

della varianza degli oggetti proiettati nello spazio delle componenti, cioè

degli autovalori associati alle componenti.

14

Analisi delle componenti principali

Varianza totale:

bg

b g

trace S = trace Λ =

M

p

m =1

m = M +1

∑ λm + ∑ λm

La quantità totale di informazione è costante.

La trasformazione operata dalle PC è solo una rotazione del sistema di riferimento.

M

Explained Variance % :

Cum. E.V .% =

∑ λm

m =1

p

∑ λm

⋅ 100

m =1

Valori di riferimento per E.V% sono 75 - 80%.

p

Residual Variance % :

RV % =

∑ λm

m = M +1

p

∑ λm

m =1

⋅ 100

15

Analisi delle componenti principali

Explained Variance % di PC1 :

EV1 % =

λ1

p

∑ λm

⋅ 100

m =1

Explained Variance % di PC1 + PC2 :

EVb1+ 2 g % =

λ1 + λ 2

p

∑ λm

⋅ 100

m =1

16

Analisi delle componenti principali

Scree Plot

λm

4

3

2

1

0

1 2 3 4 5 6 7 8

m

17

Analisi delle componenti principali

Criterio dell’autovalore medio

p

λ=

∑ λm

m =1

p

La componente principale tm è significativa se:

λm ≥ λ

Se le componenti principali sono estratte dalla matrice di

correlazione C, allora l’autovalore medio è uguale a 1.

18

Analisi delle componenti principali

Interpretazione delle componenti principali

Poichè le componenti principali sono combinazioni lineari delle

variabili originali, il loro significato dipende dai loadings delle

variabili originali.

Tuttavia, poichè non esiste un metodo matematico per dare un

significato fisico alle combinazioni lineari, l’interpretazione tende ad

essere soggettiva e non sempre può essere realizzata.

Il grafico dei loadings è lo strumento utile per interpretare le

componenti principali.

19

Analisi delle componenti principali

Esempio 1: WINES

38 campioni di vino descritti dal contenuto di 17 metalli

20

Analisi delle componenti principali

Esempio 1: WINES

ID

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

Cd

.005

.055

.056

.063

.011

.05

.025

.024

.009

.033

.039

.045

.06

.067

.077

.064

.025

.02

.034

.013

.043

.061

.047

.048

.049

.042

.058

.065

.065

.068

.067

.084

.069

.087

.074

.084

.106

.102

Mo

.044

.16

.146

.191

.363

.106

.479

.234

.058

.074

.071

.147

.116

.166

.261

.191

.009

.027

.05

.03

.268

.245

.161

.146

.155

.126

.184

.211

.129

.166

.199

.266

.183

.208

.142

.171

.307

.342

Mn

1.51

1.16

1.1

.959

1.38

1.25

1.07

.906

1.84

1.28

1.19

2.76

1.15

1.53

1.65

1.78

1.57

1.74

1.15

2.82

2.32

1.61

1.47

1.85

1.73

1.7

1.28

1.65

1.56

3.14

1.65

1.28

1.94

1.76

2.44

1.85

1.15

4.08

Ni

.122

.149

.088

.38

.16

.114

.168

.466

.042

.098

.043

.071

.055

.041

.073

.067

.041

.046

.058

.058

.066

.07

.154

.092

.051

.112

.095

.102

.166

.104

.119

.087

.07

.061

.051

.088

.063

.065

Cu

.83

.066

.643

.133

.051

.055

.753

.102

.17

.053

.163

.074

.18

.043

.285

.552

.081

.153

.058

.05

.314

.172

.082

.09

.158

.21

.058

.055

.151

.053

.163

.071

.095

.099

.052

.038

.051

.077

Al

.982

1.02

1.29

1.05

1.32

1.27

.715

.811

1.8

1.35

.971

.483

.912

.512

.596

.633

.655

1.15

1.35

.623

.627

2.07

.546

.889

.653

.508

1.3

.308

.373

.368

.447

1.14

.465

.683

.737

1.21

.643

.752

Ba

.387

.312

.308

.165

.38

.275

.164

.271

.225

.329

.105

.301

.166

.132

.078

.085

.072

.094

.294

.349

.099

.071

.181

.328

.081

.299

.346

.206

.281

.292

.292

.158

.225

.087

.408

.263

.29

.366

Cr

.029

.038

.035

.036

.059

.019

.062

.044

.022

.03

.028

.087

.041

.026

.063

.063

.021

.021

.006

.082

.045

.053

.06

.1

.037

.054

.037

.028

.034

.039

.058

.049

.037

.042

.022

.072

.031

.048

Sr

1.23

.975

1.14

.927

1.13

1.05

.823

.963

1.13

1.07

.491

2.14

.578

.229

.156

.192

.172

.358

1.12

2.91

.36

.186

.898

1.32

.164

.995

1.17

.72

.889

1.11

.927

.794

1.19

.168

1.16

1.35

.885

1.08

Pb

.561

.697

.73

.796

1.73

.491

2.06

1.09

.048

.552

.31

.546

.518

.699

1.02

.777

.232

.025

.206

.171

1.28

1.19

.747

.604

.767

.686

1.28

1.02

.638

.831

1.02

1.3

.915

1.33

.745

.899

1.61

1.77

ID

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

B

2.63

6.21

3.05

2.57

3.07

6.56

4.57

3.18

6.13

3.3

6.56

3.5

6.43

7.27

5.04

5.56

3.79

4.24

2.71

3.54

5.68

4.42

8.11

6.42

4.91

6.94

3.29

6.12

7.28

4.71

6.97

3.77

2

5.04

3.94

2.38

4.4

3.37

Mg

128

193

127

112

138

172

179

145

113

140

103

199

111

107

94.6

110

75.9

80.9

120

208

98.4

87.6

160

134

86.5

129

145

99.3

139

125

131

143

123

92.9

143

130

151

145

Si

17.3

19.7

15.8

13.4

16.7

18.7

17.8

14.3

13

16.3

9.47

9.18

11.1

6

6.34

6.96

6.4

7.92

14.7

9.32

9.11

7.62

19.3

19.3

6.46

43.6

16.7

27.1

22.2

17.6

38.3

19.7

4.57

6.96

6.75

6.18

17.4

5.33

Na

66.8

53.3

35.4

27.5

76.6

15.7

98.5

10.5

54.4

70.5

45.3

80.4

59.7

55.2

10.4

13.6

11.6

38.9

68.1

79.2

19.5

11.6

12.5

125

11.5

45

65.8

20.5

13.3

13.9

42.9

39.1

7.51

12

36.8

101

7.25

33.1

Ca

80.5

75

91

93.6

84.6

112

122

91.9

70.2

74.7

67.9

66.3

83.8

44.9

54.9

64.1

48.1

57.6

64.8

66.4

64.3

70.6

82.1

83.2

53.9

85.9

72.8

95.2

84.2

59.5

85.9

128

69.4

56.3

67.6

64.4

103

58.3

P

150

118

161

120

164

137

184

187

158

159

133

212

139

148

132

167

132

136

133

266

176

156

218

173

172

165

175

194

164

141

164

146

123

157

81.9

98.6

177

117

K

1130

1010

1160

924

1090

1290

1170

1020

1240

1100

1090

1470

1120

854

899

976

995

876

1050

1430

945

820

1220

1810

1020

1330

1140

1260

1200

1030

1390

1230

943

949

1170

1070

1100

1010

Aroma

3.3

4.4

3.9

3.9

5.6

4.6

4.8

5.3

4.3

4.3

5.1

3.3

5.9

7.7

7.1

5.5

6.3

5

4.6

3.4

6.4

5.5

4.7

4.1

6

4.3

3.9

5.1

3.9

4.5

5.2

4.2

3.3

6.8

5

3.5

4.3

5.2

21

Analisi delle componenti principali

Esempio 1: WINES

ID

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

autovalore

4.1785

2.7468

2.2098

1.9349

1.4355

1.0813

0.8527

0.6082

0.5129

0.4287

0.3711

0.2542

0.1682

0.1151

0.0495

0.0333

0.0193

E.V.%

24.6

16.2

13.0

11.4

8.4

6.4

5.0

3.6

3.0

2.5

2.2

1.5

1.0

0.7

0.3

0.2

0.1

C.E.V.% AEC

24.6

*

40.7

*

53.7

*

65.1

*

73.6

*

79.9

*

84.9

88.5

91.5

94.1

96.2

97.7

98.7

99.4

99.7

99.9

100.0

KL

*

*

*

*

*

*

*

*

*

KP

*

*

*

*

BS

20.233

14.350

11.409

9.448

7.978

6.801

5.821

4.981

4.245

3.592

3.003

2.469

1.978

1.526

1.106

0.714

0.346

MIF

0.00908

0.00886

0.00868

0.00843

0.00827

0.00821

0.00821

0.00839

0.00860

0.00881

0.00883

0.00901

0.00945

0.00998

0.01315

0.02254

22

Analisi delle componenti principali

Esempio 1: WINES

23

Analisi delle componenti principali

Esempio 1: WINES

Matrice dei loadings

ID

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

Var.

Cd

Mo

Mn

Ni

Cu

Al

Ba

Cr

Sr

Pb

B

Mg

Si

Na

Ca

P

K

PC1

0.125

-0.034

-0.056

-0.109

-0.004

0.039

-0.353

-0.271

-0.415

-0.030

0.020

-0.405

-0.239

-0.303

-0.233

-0.256

-0.403

PC2

-0.285

-0.546

0.118

-0.247

-0.122

0.130

0.080

-0.118

0.187

-0.537

-0.034

-0.048

-0.142

0.161

-0.333

-0.024

0.097

PC3

0.351

0.150

0.571

-0.268

-0.219

-0.278

0.061

0.266

0.134

0.168

-0.091

0.075

-0.282

-0.019

-0.339

-0.015

-0.011

PC4

0.055

-0.125

0.021

-0.140

-0.065

-0.420

-0.229

0.101

-0.166

-0.161

0.618

-0.084

0.308

-0.194

-0.022

0.289

0.243

PC5

-0.369

0.132

0.011

-0.107

0.496

0.047

-0.348

0.394

-0.085

0.064

-0.052

-0.111

-0.276

0.228

-0.140

0.368

-0.029

PC6

-0.233

-0.096

0.072

0.552

-0.061

-0.352

-0.013

-0.087

0.168

-0.091

-0.224

0.115

-0.123

-0.438

-0.116

0.342

-0.231 24

Analisi delle componenti principali

Esempio 1: WINES

25

Analisi delle componenti principali

Esempio 1: WINES

26

Analisi delle componenti principali

Esempio 2 : ALIMENTI

Oggetti: 109

Variabili: 17

Il data set è composto da alcuni campioni di frutta e verdura, fresca e

conservata, per i quali sono state definite e misurate 17 variabili.

27

Analisi delle componenti principali

Esempio 2: ALIMENTI

ID

Etichetta

Definizione

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

P. Ed. (%)

H2O

Prot.

Lip.

Glu-ava

Glu-ami

Glu-sol

Glu-fib

Kcal

Fe

Ca

P

Tia.

Rib.

Niam.

Vit-A

Vit-C

Parte edibile

Acqua

Proteine

Lipidi

Glucidi disponibili

Glucidi amido

Glucidi solubili

Glucidi fibra

Kilocalorie

Ferro

Calcio

Fosforo

Tiamina

Riboflavina

Niamicina

Vitamina A

Vitamina C

28

Analisi delle componenti principali

Esempio 2: ALIMENTI

Name

ID P.Ed. H2O Prot. Lip. Glu-ava Glu-ami Glu-sol Glu-fib Kcal Fe

Albicocche

Amarene

Ananas

Arachidi crude

Arance

Arance succo

Banane

Castagne

Ciliegie

Cocomero

Fichi

Fichi d'India

Fragole

Lamponi

Limoni

Limoni succo

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

Ca

P

Tia. Rib. Niam. Vit-A Vit-C

94

85

57

79

80

100

65

69

86

52

75

64

94

100

64

100

86.3

84.2

86.4

7.1

87.2

89.3

76.8

41.0

86.2

95.3

81.9

83.2

90.5

84.6

89.5

92.1

0.4

0.8

0.5

26.0

0.7

0.5

1.2

3.5

0.8

0.4

0.9

0.8

0.9

1.0

0.6

0.2

0.1

0.0

0.0

47.2

0.2

0.0

0.3

1.8

0.1

0.0

0.2

0.0

0.4

0.6

0.0

0.0

6.8

10.2

10.0

11.2

7.8

8.2

15.5

42.4

9.0

3.7

11.2

13.0

5.3

6.5

2.3

1.4

0.0

0.0

0.0

6.7

0.0

0.0

2.4

34.3

0.0

0.0

0.0

1.6

0.0

0.0

0.0

0.0

6.8

10.2

10.0

4.5

7.8

8.2

12.8

8.1

9.0

3.7

11.2

13.0

5.3

6.5

2.3

1.4

0.6

1.0

0.4

2.3

0.6

0.0

0.5

1.0

1.0

0.0

0.7

0.3

0.6

3.0

0.6

0.0

28

41

40

571

34

33

66

189

38

15

47

53

27

34

11

6

0.5

0.4

0.5

3.2

0.2

0.2

0.8

1.2

0.6

0.2

0.5

0.4

0.8

1.0

0.1

0.2

16.0

15.0

17.0

60.0

49.0

15.0

7.0

38.0

30.0

7.0

43.0

30.0

35.0

49.0

14.0

14.0

16.0

17.0

8.0

239.0

22.0

17.0

28.0

89.0

18.0

2.0

25.0

25.0

28.0

52.0

11.0

10.0

0.0

0.0

0.1

1.5

0.1

0.1

0.1

0.2

0.0

0.0

0.0

0.0

0.0

0.1

0.0

0.0

0.0

0.1

0.0

0.1

0.1

0.0

0.1

0.4

0.0

0.0

0.0

0.0

0.0

0.0

0.0

0.0

0.5

0.4

0.2

0.4

0.2

0.4

0.7

1.4

0.5

0.0

0.4

0.4

0.5

0.5

0.3

0.2

360.0

24.0

7.0

0.0

71.0

38.0

45.0

0.0

19.0

37.0

15.0

10.0

0.0

13.0

0.0

0.0

13.0

7.0

17.0

2.0

50.0

44.0

16.0

18.2

11.0

8.0

7.0

2.0

54.0

25.0

50.0

43.0

………………. …..

…

…

…

…

…

…

…

…

…

…

…

…

…

…

…

…

…

Sedano

Sedano rapa

Spinaci

Tartufo nero

Zucca gialla

Zucchine

Ceci

Fagioli

Fave sgusciate

Lenticchie

Lupini

Lupini secchi

Piselli

80

72

83

79

81

88

100

100

100

100

76

100

100

88.3

88.0

90.1

76.3

94.6

93.6

13.0

10.7

13.3

11.6

69.0

10.7

13.0

2.3

1.9

3.4

6.0

1.1

1.3

21.8

23.6

27.2

25.0

16.4

37.2

21.7

0.2

0.1

0.7

0.5

0.1

0.1

4.9

2.5

3.0

2.5

2.4

13.2

2.0

2.4

3.8

3.0

0.7

3.5

2.1

54.3

51.7

55.3

54.0

7.2

36.0

53.6

0.2

0.0

2.4

1.2

1.0

1.2

46.0

43.2

45.4

46.5

6.0

38.8

45.7

2.2

3.8

0.4

0.7

2.5

2.1

3.7

4.0

4.9

2.4

0.5

3.1

2.9

0.8

1.8

0.5

9.4

1.3

0.9

5.2

5.0

1.5

3.9

3.6

1.1

5.0

20

23

31

31

18

14

334

311

342

325

114

402

306

0.5

0.5

2.9

3.5

0.9

0.5

6.1

6.7

5.0

5.1

5.5

5.5

4.5

31.0

52.0

78.0

24.0

20.0

21.0

117.0

137.0

90.0

127.0

45.0

94.0

48.0

45.0

90.0

62.0

62.0

40.0

65.0

299.0

437.0

420.0

347.0

100.0

320.5

320.0

0.1

0.1

0.1

0.1

0.0

0.1

0.4

0.4

0.5

0.6

0.1

0.4

0.6

0.2

0.1

0.4

0.1

0.0

0.1

0.1

0.2

0.3

0.2

0.0

0.2

0.2

0.2

0.5

0.4

2.0

0.5

0.7

1.7

2.3

2.6

1.8

0.2

1.8

2.2

207.0

0.0

485.0

0.0

599.0

6.0

30.0

3.0

10.0

10.0

12.6

12.6

10.0

32.0

6.0

54.0

1.0

9.0

11.0

5.0

3.0

4.0

3.0

3.8

29

3.8

4.0

97

98

99

100

101

102

103

104

105

106

107

108

109

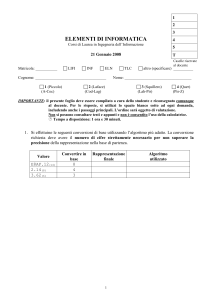

Analisi delle componenti principali

Esempio 2: ALIMENTI

PC

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

autovalore

6.9010

2.2290

2.0180

1.3320

0.9168

0.8030

0.6984

0.5680

0.4098

0.3694

0.2792

0.2440

0.1623

0.0603

0.0071

0.0016

0.0001

E.V.%

40.59

13.11

11.87

7.84

5.39

4.72

4.11

3.34

2.41

2.17

1.64

1.44

0.95

0.35

0.04

0.01

0.00

C.E.V.%

40.59

53.71

65.58

73.41

78.80

83.53

87.64

90.98

93.39

95.56

97.20

98.64

99.59

99.95

99.99

100

100

AEC

*

*

*

*

CAEC

*

*

*

*

*

*

30

Analisi delle componenti principali

Esempio 2: ALIMENTI

31

Analisi delle componenti principali

Esempio 2: ALIMENTI

Loading Plot of axes 1 and 2 (54% )

1

0.8

Glu-ava

Glu-sol

axis 2 (13% )

0.6

P.Ed.

0.4

Glu-ami

0.2

0

Kcal Fe

Tia.

P Prot.

-0.2

-0.4

Glu-fib

Niam.

Ca

Lip.

H2O

Vit-A

Vit-C

Rib.

-0.6

-0.8

-1

-1

-0.8

-0.6

-0.4

-0.2

0

0.2

axis 1 (41% )

0.4

0.6

0.8

32

1

Analisi delle componenti principali

Esempio 2: ALIMENTI

Interpretazione delle componenti principali

PC1 (E.V.% 40.59): contiene essenzialmente informazione sul contenuto d'acqua

degli alimenti; infatti, nel loading plot PC2 vs. PC1, si può osservare che la variabile

H2O ha un loading in valore assoluto molto alto. Altre variabili importanti nella prima

componente principale ma inversamente correlate alla variabile H2O (influenza

opposta nel determinare la componente) sono: KCAL (kilocalorie), P (contenuto di

fosforo), PROT (contenuto di proteine), FE (contenuto di ferro) e TIA (contenuto di

tiamina).

33

Analisi delle componenti principali

Esempio 2: ALIMENTI

Interpretazione delle componenti principali

PC2 (E.V.% 13.11): contiene essenzialmente informazione sul contenuto di glucidi

(solubili, GLU_SOL, e disponibili, GLU_AVA) e la parte edibile (EDIB) degli alimenti.

Altre variabili influenti ma inversamente correlate ai glucidi e alla parte edibile sono:

LIP (contenuto di lipidi), VIT_A e VIT_C (contenuto di vitamine) e RIB (contenuto di

riboflavina).

Quindi, la seconda componente principale sembra spiegare la separazione tra

alimenti molto dolci, grande contenuto di zuccheri, ed alimenti a maggior contenuto

di lipidi e vitamine.

34

Analisi delle componenti principali

Esempio 2: ALIMENTI

Analisi delle correlazioni tra le variabili

Analizzando i grafici dei loadings relativi alle componenti principali significative, è

possibile studiare le correlazioni tra le variabili originali relativamente

all'informazione spiegata dalle componenti considerate.

Gruppi di variabili che compaiono vicine nello spazio delle componenti principali

considerate indicano che, limitatamente all'informazione portata da queste

componenti, esse portano un'informazione simile e sono quindi correlate.

35

Analisi delle componenti principali

Esempio 2: ALIMENTI

Analisi delle correlazioni tra le variabili

Considerando le prime sei componenti principali, le correlazioni più

significative riscontrate riguardano i seguenti gruppi di variabili:

Correlazione diretta:

-

vitamina A e vitamina C

-

proteine, tiamina e fosforo

-

lipidi e Kcal

Correlazione inversa:

-

acqua e Kca

36

Analisi delle componenti principali

Esempio 2: ALIMENTI

Analisi delle similarità/diversità dei campioni

I grafici degli scores (score plots) consentono di analizzare il comportamento dei

campioni e in particolare le loro similarità/diversità e anche l'eventuale presenza di

campioni anomali.

Il grafico degli scores, relativo a due componenti principali, è un grafico in cui sono

visualizzate le proiezioni dei campioni nello spazio definito dalle due componenti

considerate.

37

Analisi delle componenti principali

Esempio 2: ALIMENTI

Score Plot of axes 1 and 2 (54% )

6

Alimenti conservati

4

axis 2 (13% )

33

2

109

103

104106

105

108

0

4

-2

43

39

-4

45

34 35

36

44

31

21

17

27

30

8

2

19

28

70

84

9

72

14

688

18

85

20

12

11

9016

50 7 22

89

71

83

96

55

29

1

3

13

25

67

100

102

91

107

47

5

65

66

93

784098 81

10

24

95

60

15

73

101

46

80

4177 76 53 62

23

69

97

82

56686187

74

49 42 54

51

64

58

59

48

79

63

5299

57

94

75

86

92

32

38 26

37

Alimenti freschi

-6

-8

-6

-4

-2

axis 1 (41% )

0

2

38

4

Analisi delle componenti principali

Esempio 2: ALIMENTI

Analisi delle similarità/diversità dei campioni

Spazio PC1 – PC2 (C.V.% 53.71)

Si evidenzia una separazione tra gli alimenti freschi e gli alimenti conservati, i primi

caratterizzati soprattutto da un elevato contenuto d'acqua e vitamine e i secondi da un

basso contenuto d'acqua.

Il gruppo di alimenti conservati mostra una evidente separazione in sottogruppi al suo

interno, in particolare si evidenziano i seguenti sottogruppi:

- campioni n. 103, 104, 105, 106, 108, 109 (legumi): basso contenuto di acqua, molto

calorici, alto contenuto di proteine, fosforo, ferro, tiamina;

- campioni n. 33, 34, 35, 36, 44, 45 (frutta secca dolce): alto contenuto di glucidi (solubili

e disponibili), grande parte edibile, basso contenuto di lipidi e vitamine;

- campioni n. 4, 26, 32, 37, 38, 39, 43 (frutta secca): basso contenuto di acqua, molto

calorici, alto contenuto di lipidi, vitamine, riboflavina, calcio, basso contenuto di glucidi e

39

piccola parte edibile.

Analisi delle componenti principali

Esempio 2: ALIMENTI

Biplot on axes 1 and 2 (54% )

6

45

4

axis 2 (13% )

33

34 35

36

Glu-ava

44 Glu-sol

P.Ed.

109

103

31

104106

Glu-ami

21

105

17

27

30

8

2

19

28

84

70

72

9

688

14

85

20

18

12

11

108

9016

89

50 7 22

71

Glu-fib

83

96

55

29

1

3

13

25

Fe

67

102

100

91

Kcal

107

47

5

65

66

9324

784098 60

10

95

15

Prot.

Niam.

73

81

101

46 4177 76 53 6980

23

97

82

Tia. Ca

56686187

P

74

49 42 5462

51

64

58

59

48

32

6379 Vit-C

4

5299

Rib.

Lip.

57Vit-A

94

26

75

38

43

86

39

92

37

2

0

-2

-4

H2O

-6

-8

-6

-4

-2

0

axis 1 (41% )

2

4

6

40

8

Altre tecniche di proiezione

L’analisi delle componenti principali è la tecnica più popolare perchè:

-

le pc sono facilmente calcolabili (esiste soluzione analitica);

-

le pc sono intuitive;

-

le pc hanno proprietà interessanti.

Lo spazio definito dalle componenti principali minimizza la seguente

quantità:

e

V = ∑s ∑t d st2 − d$st2

j

d st2 è la distanza al quadrato tra i punti Ps e Pt nello spazio originale

d$st2 è la distanza al quadrato tra i punti P’s e P’t nello spazio delle pc

… tuttavia, sotto il vincolo dell’ortogonalità delle componenti.

41

Altre tecniche di proiezione

Rinunciando all’ortogonalità, si può cercare la rappresentazione dei dati

che riproduce al meglio le distanze reali tra tutte le coppie di oggetti, cioè

che minimizza:

e

L* = ∑s ∑t w st ⋅ d st − d$st

j

2

NON - LINEAR MAPPING

E’ una tecnica di ottimizzazione che trova le coordinate degli oggetti nel

nuovo spazio mediante algoritmi numerici iterativi partendo da una

configurazione iniziale dei punti.

Le nuove variabili non hanno alcun significato, servono solo per la

visualizzazione grafica degli oggetti in uno spazio a poche dimensioni.

42

Altre tecniche di proiezione

Poichè la PCA e il non-linear mapping possono essere applicati a variabili

numeriche …..

…. cosa fare quando si hanno variabili categoriche?

1. Se la variabile categorica è ordinale, può essere trasformata in

variabile numerica attribuendo dei punteggi alle categorie.

2. Ciascuna categoria della variabile può essere sostituita con una

variabile binaria con valori 0 e 1.

3. Si calcola la dissimilarità tra tutte le coppie di oggetti e si cerca di

costruire una configurazione di punti minimizzando le funzioni V o L*

dove la distanza Euclidea tra punti è sostituita dalla misura di

dissimilarità tra i corrispondenti oggetti.

43

Altre tecniche di proiezione

MATRICE DI DISSIMILARITA’

matrice quadrata simmetrica (n, n)

0 d12 K d1n

0 K d2n

K K

0

1. Può essere calcolata dalla matrice dei dati (n, p)

2. o essere essa stessa la matrice dei dati.

44

Altre tecniche di proiezione

Principal coordinate analysis (scaling metrico)

Tecnica utilizzata per cercare una rappresentazione geometrica degli

oggetti a partire dalla matrice di dissimilarità.

Gli oggetti vengono rappresentati con dei punti e le distanze tra punti

misurano la dissimilarità tra gli oggetti corrispondenti.

Si calcolano gli autovalori e autovettori di una matrice F ricavata dalla

matrice di dissimilarità. Le coordinate degli oggetti rispetto all’asse j

sono date da:

x$ j = λ j ⋅ a j

dove aj sono gli elementi del j-esimo autovettore e λj il corrispondente

autovalore.

45

Altre tecniche di proiezione

Principal coordinate analysis (scaling metrico)

Gli assi che definiscono il sistema di riferimento non hanno alcun

significato.

Le posizioni degli oggetti nello spazio sono strettamente dipendenti

dai dati utilizzati.

Se la matrice di dissimilarità è calcolata usando la distanza Euclidea,

allora il risultato della principal coordinate analysis è identico a quello

della principal component analysis applicata alla matrice dei dati (n, p).

46

Altre tecniche di proiezione

Multidimensional Scaling (non-metric)

Tecnica basata sugli stessi principi della principal coordinate analysis,

però finalizzata alla ricerca di una configurazione dei punti in cui le

distanze tra punti siano monotonicamente relazionate alle dissimilarità

tra gli oggetti corrispondenti.

Il punto di partenza è sempre la matrice di dissimilarità.

Si utilizzano algoritmi numerici iterativi a partire da una configurazione

iniziale arbitraria di punti.

47

Altre tecniche di proiezione

MATRICE DI INCIDENZA

Gli elementi di questa matrice sono dati dal numero di occorrenze

congiunte di alcune variabili discrete.

Tabella di contingenza (k, q) relativa a 2 variabili discrete K con k

categorie e Q con q categorie. Il singolo elemento nij rappresenta il

numero di volte che la categoria i-esima della variabile K e la categoria

j-esima della variabile Q sono osservate contemporaneamente in un

campione di n oggetti.

48

Altre tecniche di proiezione

Analisi delle corrispondenze

Tecnica utilizzata per ottenere una rappresentazione grafica del

contenuto di una matrice di incidenza.

E’ una tecnica di ottimizzazione.

L’idea è quella di definire un’opportuna scala di valori per le variabili

categoriche in modo che possano essere proiettate. Viene assegnato

uno score a ciascuna categoria di ogni variabile, tale score viene quindi

utilizzato come coordinata della categoria nella rappresentazione

grafica.

49

Tecniche di proiezione per analisi esplorativa

Matrice di dati con struttura di gruppo

Supponiamo che sia data una matrice di dati (n, p)

in cui gli oggetti sono suddivisi in G gruppi diversi.

ng = numero di oggetti appartenenti al g-esimo gruppo

G

n = ∑ ng

g =1

50

Tecniche di proiezione per analisi esplorativa

Matrice di dati con struttura di gruppo

In una rappresentazione geometrica dei dati:

-

gli oggetti sono rappresentati con dei punti;

-

i gruppi di oggetti sono rappresentati con insiemi di punti;

-

le distanze tra gli insiemi di punti rappresentano le diversità

tra i corrispondenti gruppi di oggetti.

Se p > 3, allora occorre trovare una rappresentazione dei dati a

poche dimensioni che approssimi al meglio le differenze tra gli

insiemi di punti nella configurazione reale.

51

Tecniche di proiezione per analisi esplorativa

Analisi delle componenti principali

150 iris

Iris data

-1

- lunghezza sepali

-2

- ampiezza sepali

-3

- lunghezza petali

-4

- ampiezza petali

PC2

4 variabili:

-5

-6

3 gruppi:

setosa

versicolor

virginica

-7

-8

-9

-10

3.8

4.2

4.6

5.0

5.4

PC1

5.8

6.2

6.6

7.0

52

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

setosa

Iris data

versicolor

virginica

3

2

1

CV2

0

-1

-2

-3

-10

-5

0

CV1

5

10

53

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

Obiettivo dell’analisi canonica è trovare la migliore rappresentazione

dei dati per osservare le differenze tra i gruppi.

Alcuni principi dell’analisi

Supponiamo di voler trovare la migliore rappresentazione a 1 dimensione,

combinazione lineare delle variabili originali.

tig è la coordinata dell’i-esimo oggetto appartenente al g-esimo gruppo lungo

il nuovo asse.

54

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

ng

1

⋅ ∑ t ig

n g i =1

Media di gruppo :

tg =

Media generalizzata :

1 G

1 G g

1 n

t = ⋅ ∑ n g ⋅ t g = ⋅ ∑ ∑ t ig = ⋅ ∑ t i

n g =1

n g =1 i = 1

n i =1

n

55

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

Between-group Sum of Squares :

Within-group Sum of Squares :

bg

G

i

2

d

SSW a = ∑ ∑ t ig − t g

i

SSB a = ∑ n g ⋅ t g − t

bg

g =1

G ng

g =1 i =1

d

56

2

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

La migliore scelta di a è quella che massimizza il rapporto :

G − 1g

b

g

b

F=

SSW ba g bn − G g

SSB a

a definisce la direzione lungo la quale la varianza tra i gruppi

relativamente alla varianza all’interno dei gruppi è massima.

57

Tecniche di proiezione per analisi esplorativa

Analisi delle variabili canoniche

Le combinazioni lineari delle variabili originali trovate dall’analisi

canonica si chiamano variabili canoniche (CV).

A differenza delle componenti principali, le variabili canoniche non

sono ortogonali. Quindi, l’analisi canonica introduce una

deformazione del sistema di riferimento originale.

Assunzione fondamentale dell’analisi canonica :

le matrici di covarianza dei singoli gruppi devono essere uguali.

58

Tecniche di proiezione per analisi esplorativa

matrice dei dati con

struttura di classe

Canonical Analysis

Principal Component Analysis

Variabili numeriche

matrice dei dati

(n, p)

Non-linear mapping

Variabili categoriche

matrice di similarità

(n, n)

Principal Coordinate

Analysis

Multidimensional Scaling

matrice di incidenza

Correspondence

(k, q)

Analysis

59