IL PC PROSSIMO VENTURO:

COME CAMBIERÀ IL PERSONAL

COMPUTER NEI PROSSIMI QUINDICI

ANNI

di Marco Pancotti

In collaborazione con

Tavola dei contenuti

Premessa ......................................................................................................................... 3

1.

2.

Le previsioni a medio periodo ................................................................................... 4

1.1.

Il ciclo di vita di una tecnologia ....................................................................... 5

1.2.

Torniamo indietro di una decina di anni.......................................................... 8

1.3.

La fantastica corsa della capacità di calcolo di un Personal Computer ......... 9

Come cambierà la fisionomia del Personal Computer............................................ 12

2.1.

La differenziazione e specializzazione dei device ........................................ 13

2.2.

Le innovazioni sui dispositivi di visualizzazione dell'immagine .................... 15

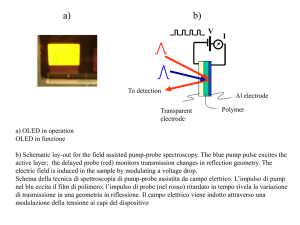

La tecnologia OLED...........................................................................................16

L’Augmented Reality..........................................................................................17

2.3.

La miniaturizzazione ..................................................................................... 20

3.

Conclusioni.............................................................................................................. 22

4.

Glossario ................................................................................................................. 24

Tavola delle figure

Figura 1 – Le curve a S dello sviluppo della tecnologia................................................... 7

Figura 2 – L’evoluzione della potenza di calcolo a parità di costo di apparato.............. 12

Figura 3 – Nuovi device specializzati............................................................................. 14

Figura 4 – Esempio di un dispositivo di lettura basato su schermo OLED.................... 17

Figura 5 – Impiego dell’Augmented Reality nell’ambito dell’industria............................ 18

Figura 6 – L’impiego dell’Augmented Reality in ambito chirurgico ................................ 19

Pagina 2 di 26

Figura 7 – Un’ipotesi industriale di miniaturizzazione di un PC ..................................... 21

Figura 8 – Una tastiera virtuale già disponibile in commercio ....................................... 21

Premessa

Questo dossier è il primo di una terna finalizzata a valutare quali evoluzioni ci attendono

nell’ambito di tre tecnologie che caratterizzano l’attuale mercato dell’Information

Technology. I tre dossier avranno come traguardo l’anno 2020, con tappe intermedie nel

2010 e nel 2015. Una previsione che cerchi di andare oltre i 15 anni, come verrà meglio

spiegato in seguito, ha infatti pochissime possibilità di trovare riscontri e finisce

inevitabilmente con l’essere, allo stesso tempo, eccessivamente pessimistica su alcuni e

ottimistica su altri aspetti.

Questo dossier cercherà di valutare lo sviluppo previsto nell’ambito del Personal

Computing, cioè degli strumenti di produttività e comunicazione personale che oggi si

manifestano sotto forma d PC desktop, notebook, palmari e telefonini intelligenti. Il

secondo dossier cercherà di scrutare nel futuro dell’interconnettività, sia essa basata sulla

connessione via cavo, sia essa fornita tramite dispositivi radio. Il terzo dossier esaminerà

le prospettive dell’Intelligenza Artificiale e della Robotica, termini che ebbero una loro

notorietà negli anni ‘80 e che, a causa di alcune delusioni, sembrano da tempo

accantonati. Come invece dimostrerò, vi sono diversi motivi per credere che si tratti di

tecnologie destinata a rientrare prepotentemente in campo e ad essere tra gli attori

principali dello sviluppo economico del secolo in corso.

La piccola e media impresa dovrebbe prestare grande attenzione a questi temi, in quanto

l’impatto sul suo quotidiano è ben superiore a quanto normalmente si creda.

Una parte degli imprenditori ha a che fare con lo sviluppo delle tecnologie informatiche in

quanto queste entrano nei suoi prodotti o in quelli dei suoi concorrenti, cambiandone la

fisionomie e introducendo dei gap funzionali in grado di cambiare il contesto competitivo.

La parte restante comunque utilizza la tecnologia nel suo lavoro quotidiano, investe parte

dei suoi ricavi in infrastrutture tecnologiche e può vedere la produttività propria e dei

Pagina 3 di 26

propri collaboratori potenziata o mortificata come conseguenza del buon o del cattivo uso

della tecnologia.

Obiettivo de questa serie di dossier è fornire al lettore una serie di importanti chiavi di

lettura sulla evoluzione tecnologica, rilevanti tanto a fini culturali quanto a fini pratici e

operativi e in particolare che:

•

la tecnologia è come un’onda che va cavalcata come il surfista cavalca l’onda

dell’oceano. Standoci davanti si viene spazzati via, ma standoci dietro si rimane fermi

a guardare gli altri correre sorretti da un’inesauribile energia.

•

per cavalcare la tecnologia occorre seguirne lo sviluppo e coglierne le tendenze,

cercando di investire sull’emergente, accettando come inevitabili alcuni sprechi, e

imparando ad accettare come fisiologico che qualunque investimento si sia fatto in

innovazione, questo apparirà obsoleto dopo pochi anni. Ma ricordandosi che se non lo

si fosse fatto ad essere obsoleta sarebbe l’intera propria azienda

•

le tecnologie, al giorno d’oggi, tendono a compenetrarsi e ad aiutarsi l’una con l’altra

molto più di un tempo.

Tutti i settori saranno colpiti violentemente dallo sviluppo

della genetica, delle nanotecnologie e della robotica, e l’effetto sui mercati sarà di

gran lunga superiore a quello che ha comportato l’arrivo dell’offerta Cinese. Nessun

imprenditore, per quanto piccolo sia, si deve sentire esentato dal capire questi trend,

così come colpevoli sono stati quegli imprenditori che quindici anni fa non hanno

osservato con attenzione l’esplosività dello sviluppo cinese e compreso in tempo le

conseguenze che questo avrebbe avuto sui mercati internazionali

•

cavalcare la tecnologia può anche voler dire, nel quotidiano, seguire lo sviluppo di

beni ormai familiari come un banale PC o la connettività Internet, per cogliere come

meglio orientare i propri investimenti e come predisporre un contesto aziendale in

grado di accogliere le novità senza traumi.

1. Le previsioni a medio periodo

Come già accennato, vi è sempre una certa preoccupazione, da parte di un analista di

mercato, nell’accingersi a fare previsioni di tendenza che superino i due/tre anni. I più

prudenti, infatti, si limitano a raccogliere i dati sui fenomeni in corso e ad elaborarli in

Pagina 4 di 26

sofisticate statistiche, emettendo indiscutibili giudizi su ciò che è appena successo e

sbilanciandosi a fare previsioni solo per l’immediato futuro.

Alcuni coraggiosi provano ad estrapolare tendenze che arrivino al massimo al successivo

quinquennio applicando semplici analisi di trend e sperando che, nel frattempo, non

vengano introdotti nel mercato mutamenti tali da cambiare il contesto competitivo.

I più temerari provano a spingersi più avanti, ben consci che, così facendo, le innovazioni

capaci di rivoluzionare il contesto competitivo vi saranno sicuramente, e che per alcune di

esse è impossibile essere preveggenti perché nascono e si diffondono in modo

imprevedibile ed esplosivo. Vi sono però tecnologie rivoluzionarie che hanno avuto un

lungo periodo di incubazione (Internet è una di esse), per le quali un attento analista

avrebbe potuto immaginare la diffusione applicando dei semplici ragionamenti.

L’errore che si fa, normalmente, nello spingere l’analisi nel tempo, può essere duplice.

Spesso, infatti, si tende a sovrastimare l'evoluzione possibile nel breve periodo (3-5 anni)

e a sottostimare l'evoluzione che sarà possibile nell'arco di 10/15 anni.

Nel mondo dei computer, poi, vi sono innumerevoli aneddoti sulla scarsa visione delle

possibilità offerte da questa tecnologia. A Thomas J. Watson, fondatore dell'IBM,

è

attribuita una previsione, risalente al 1943, secondo la quale, nel mondo, ci sarebbe stato

spazio, al massimo, per ... 5 computer!

A Bill Gates si attribuiscono frasi come “640 K di memoria sono sufficienti per chiunque”,

oppure “ 2GBytes di spazio su disco sono più che adeguati per le esigenze di qualunque

utente di PC”. Frasi, al dire il vero, che Bill Gates ha smentito di aver mai detto e di cui

non vi è traccia documentale, ma che sono entrate a far parte di quelle leggende

metropolitane che circondano da tempo questo personaggio.

Proveremo quindi, con cautela ed equilibrio, a spingere il nostro sguardo nei prossimi

quindici anni, basando la nostra analisi sui trend in corso e sulle tecnologie in via di

sviluppo, consapevoli che qualcosa sicuramente ci sfuggirà ma sicuri di poter comunque

dare indicazioni utili a chi ha interesse in questo mercato.

1.1. Il ciclo di vita di una tecnologia

Prima di entrare nel vivo del tema, occorre comprendere in che modo si evolve una

qualunque tecnologia. Riassumendo quanto espresso dallo scienziato americano Ray

Pagina 5 di 26

Kurzweil nel suo “The Law of Time and Chaos”, si possono, in generale, identificare sette

fasi attraversate da qualunque tecnologia che abbia raggiunto una qualche maturità:

1. Il primo stadio di sviluppo è quello della visione. La ricerca scientifica rende plausibile

un certo scenario e i visionari, spesso nel dileggio generale, indicano potenzialità

astratte a fronte delle quali non c'è nulla di inventato e, tanto meno, di funzionante.

In questa fase era Leonardo, quando disegnava elicotteri e automobili, o Giulio

Verne, quando immaginava di andare sulla Luna o di viaggiare in sottomarino.

2. Il secondo stadio è quello dell'invenzione, che spesso è considerato l'atto di nascita

di una tecnologia. E come tutti i neonati, la nuova tecnologia, in questo stadio,

spesso si limita a vagire, ingurgitare risorse e richiedere infinite attenzioni. Ad

ammirarla sono solo i genitori e chi, tra gli osservatori, riesce a vedere le potenzialità

dell'adulto nel corpo del bambino.

3. Il terzo stadio è quello dello sviluppo, durante il quale la tecnologia è supportata e

protetta da entusiasti sostenitori, oltre che dagli inventori stessi. Spesso durante

questa fase vengono introdotti miglioramenti vitali per il successo dell'invenzione. Si

pensi, ad esempio, all'organizzazione introdotta da Henry Ford nella produzione

dell'automobile. Prima c'erano centinaia di officine artigianali, dopo un'industria.

4. Il quarto stadio, quello della maturità, è quello in cui una tecnologia è ormai parte del

mondo e del pensiero comune. Talvolta, come nel caso della televisione o del

telefono, sembra quasi impossibile di aver potuto fare a meno di quello che, in fondo,

fino a poche decine di anni prima non esisteva proprio. In questa fase la maggior

parte della gente crede che la nuova tecnologia sia destinata a vivere per sempre, e

guarda con scetticismo al sorgere di novità che promettono di incrinarne il dominio.

5. Il quinto stadio è quello dei falsi pretendenti. Una nuova tecnologia minaccia di

eclissare quella ormai matura, ma, specie all'inizio, non è in grado di sostituirla

veramente, per mancanza di funzionalità o qualità. I primi fallimenti consolidano

l'opinione dei conservatori, che vedono in essi la dimostrazione dell'insostituibilità

della tecnologia matura.

6. Nel sesto stadio una nuova minaccia, superate le difficoltà che hanno minato i falsi

pretendenti, comincia ad evidenziare i difetti e l'obsolescenza della tecnologia

matura. Comincia il declino della vecchia tecnologia, mentre la novità conquista

gradualmente il gradimento dei consumatori, prima di quelli con atteggiamento più

innovatore e poi, strada facendo, quelli più conservatori.

Pagina 6 di 26

7. Nel settimo stadio la vecchia tecnologia sopravvive solo o in particolari nicchie, o

nell'interesse di amatori, o per utilizzi particolari. È il caso delle carrozze a cavallo,

dei dischi in vinile, dell'arpicordo e delle macchine da scrivere meccaniche.

Tutto questo deve essere ben compreso prima di usare gli avverbi “mai” e “sempre”

quando si parla del futuro di prodotti e tecnologie. Ricordiamoci che quasi tutto quello

che ci circonda, andando abbastanza indietro nel tempo, non esisteva, e che tutto prima

o poi verrà sostituito da qualcos'altro, anche se al momento facciamo fatica ad

immaginare da che cosa.

Figura 1 – Le curve a S dello sviluppo della tecnologia

Inoltre dobbiamo imparare a capire che l'evoluzione di una qualunque tecnologia non è

mai lineare, anche se talvolta noi la percepiamo come tale. Piuttosto avanza come una

serie di onde a forma di S. Ogni onda eleva il livello di performance, per poi appiattirsi, in

attesa dell'onda successiva. Nelle fasi iniziali e finali dell'onda il miglioramento della

tecnologia è lento, mentre nelle fasi centrali è rapido e impetuoso. Pensiamo ad

esperienze recenti, che tutti noi abbiamo vissuto, come i CD-ROM, i telefoni cellulari o i

video a cristalli liquidi.

Pagina 7 di 26

1.2. Torniamo indietro di una decina di anni

Prima di addentrarci nelle previsioni per i prossimi quindici anni, vediamo l’esito di una

previsione fatta dieci anni fa da un personaggio sulla cui autorevolezza non vi sono

dubbi. Nel Settembre del 1995, in occasione del lancio di Windows 95, la Rai intervistò

Bill Gates sul futuro del PC. L'intervista, per chi fosse curioso, è visualizzabile per intero

all'indirizzo http://www.mediamente.rai.it/home/bibliote/intervis/g/gates.htm. Mi limiterò, in questo testo, a coglierne alcuni passaggi essenziali.

Gates, innanzitutto, forte dei 50 milioni di PC appena venduti nel 1994, vedeva la

possibilità che, nel mondo, fossero venduti più di 100 milioni di PC nei cinque anni a

seguire. In effetti la previsione fu pessimista. Nell'Aprile del 2006 Gartner Dataquest ha

stimato che, nel mondo, siano operativi 1 miliardo di PC, numero destinato a raddoppiare

entro la fine del 2008. Viene da sorridere pensando a quando, nel 1983, la rivista

americana Time proclamò il PC come “uomo dell'anno” solo perché ne erano stati venduti

un milione di unità.

Al tempo dell'intervista a Gates, il 60% dei PC venduti erano dei Pentium a 100 Mhz. Il

clock, uno degli elementi determinanti le performance di un PC, era quindi 30 volte più

lento di quello che viene fornito oggi spendendo circa 500 Euro. Considerando che, nel

frattempo, tutto ciò che sta attorno al processore è decisamente più veloce, non si

sbaglia a valutare il PC di un odierno utente medio di potenza almeno 100 volte superiore

a quello in circolazione allora. Gates, consapevole della rapidità dello sviluppo della

tecnologia hardware, non ebbe quindi difficoltà ad immaginare l'utilizzo del PC per la

riproduzione di video, per videoconferenze e per grafica tridimensionale, cosa poi

effettivamente avvenuta.

Anche sulla disponibilità della banda larga Gates fu un poco pessimista. Mentre, in quel

momento, auspicava lo sviluppo della tecnologia ISDN a 28.200 bps, con cui sarebbe

stato possibile visualizzare le immagini da Internet, Gates immaginava una vasta

disponibilità di banda larga che, a suo parere, sarebbe stata disponibile in una decina

d'anni. In realtà nel mondo occidentale l'offerta casalinga di ADSL iniziò solo 5/6 anni

dopo, e dall'inizio di questo decennio in una città come Milano, grazie alla fibra ottica, è

possibile accedere a costi accettabili a quella connettività a 10Mbs allora vagheggiata

come un sogno quasi impossibile.

Anche sull'impatto che Internet avrebbe avuto sullo sviluppo del PC, Bill Gates azzeccò,

nella sostanza, le previsioni. Ecco un passaggio dell'immagine che diede dell'utilizzo della

posta elettronica, strumento allora utilizzato da pochissime aziende.

Pagina 8 di 26

“ Una volta introdotta la posta elettronica, si utilizzerà inizialmente soltanto per lo

scambio di messaggi, ma dopo poco si inizierà ad inviare fogli elettronici. Invece di

stampare i risultati aziendali, questi si spediranno elettronicamente. Si trasferirà la

modulistica cartacea in equivalenti elettronici, semplificando la compilazione dei moduli

interni dell'azienda. Esattamente lo stesso succederà tra le aziende e i loro clienti,

quando questi disporranno sempre più di personal computer. I clienti pretenderanno di

ottenere informazioni sui prodotti e il loro stato di produzione, di riempire moduli oppure

di ottenere un collegamento voce o video con qualcuno che li possa aiutare,

semplicemente facendo clic su un pulsante “.

Sorprendentemente esatto, anzi, si può dire che, pensando ad alcune applicazioni di webcasting o di trading online, la realtà ha abbondantemente superato le previsioni, anche

quelle fatte da una persona naturalmente portato ad avere una visione positiva.

Per sapere cosa pensa Bill Gates oggi circa il futuro del PC in azienda si può leggere la

sua risposta ad un articolo del noto analista Nicholas G. Carr dal funereo titolo “Requiem

per il PC aziendale” . In questo articolo Gates evidenzia come, al giorno d'oggi, il PC sia

diventato un elemento di un ricco ecosistema fatto, oltre che dai desktop, da datacenter,

da notebook, da palmari e da telefoni intelligenti. Accedere alle informazioni è oggi

possibile quasi dappertutto, anche per strada o quando si vola in aereo (anche se, per il

momento, su ben poche tratte). Le applicazioni destinate alla produttività individuale si

sono evolute in applicazioni a supporto del lavoro di gruppo, ma la capacità di un PC di

lavorare in modo autonomo e, allo stesso tempo, connesso col resto della rete di

collaborazione di cui l'utente del PC fa parte, lo rende uno strumento insostituibile.

Questa volta Gates non entra nel dettaglio di quali tecnologie vede come trainanti, ma

indica nell'ecosistema stesso, e nel suo sfruttamento, la chiave di lettura di cosa

succederà del PC nel futuro.

1.3. La fantastica corsa della capacità di calcolo di un

Personal Computer

Il mondo del computer è soggetto da ormai trent'anni alla legge di Moore1. Il raddoppio

a cadenze fisse ha innescato un andamento di tipo esponenziale, che è stato il fattore

1

Gordon Moore, presidente dell'Intel e uno dei padri del microprocessore, osservò che

l'industria da lui guidata era in grado di incrementare del doppio, ogni 24 mesi, il numero dei

Pagina 9 di 26

trainante dell'impetuoso sviluppo dell'Information Technology negli ultimi trent'anni.

Poiché la legge di Moore, sia pure con tempi di raddoppio delle capacità varianti da

settore a settore, ha interessato praticamente tutta l'elettronica a stato solido,

traguardando

il

2020,

come

ha

fatto

l'International

Technology

Roadmap

for

Semiconductors, noi possiamo calcolare che:

•

la quantità di RAM per Dollaro passerà dagli attuali 10 MB (una Ram da 1GB

costa, oggi, all'incirca 100 Dollari) a 50 MB nel 2010, a 100 MB poco prima del

2015 e 1000 MB nel 2020. Per quella data un normale PC potrà quindi essere

tranquillamente equipaggiato da 100 GB di memoria che sarà, nel frattempo,

almeno 20 volte più veloce di quella attuale.

•

La velocità dei processori, oggi attorno ai 3 Ghz, passerà a 10 Ghz nel 2010, a 50

Ghz nel 2015 e a 100 Ghz nel 2020. Ciò sarà ottenuto anche grazie all'uso

industriale di nuove tecnologie produttive, oggi allo stadio di sviluppo, su cui i

grandi produttori stanno investendo.

•

Le performance generali di un processore attuale di fascia alta, diciamo un Intel

Xeon, utilizzato in computer dal costo di poche migliaia di Euro, è attorno ai

10.000 MIPS (Milioni di operazioni per secondo). All'attuale trend, che vede un

raddoppio ogni 18,5 mesi, avremo 60.000 MIPS nel 2010, 640.000 MIPS nel 2015

e 1 milione di MIPS nel 2020. Un PC da 3.000 Euro potrà quindi essere 100 volte

più potente del suo equivalente odierno, a parità di prezzo. Abbastanza potente,

quindi,

da

poter

ospitare

applicazioni

di

Intelligenza

Artificiale

come

il

riconoscimento del parlato e dell’immagine.

•

Il raddoppio della capacità dello storage ogni 18 mesi è il trend anche per la

memoria disponibile su disco fisso. Se con 100 Euro è oggi possibile acquistare

circa 100 GB di memoria, nel 2010 si potrà acquistare, con gli stessi 100 Euro, 1

Terabyte, nel 2015 6 Terabyte e nel 2020 1.000 Terabyte. Più o meno

l'equivalente, in forma digitalizzata, dell'intera produzione umana di pittura,

scrittura, musica, cinema, teatro e televisione. In realtà, in questo campo, le

prospettive sono ancora più interessanti perché le ricerche in corso nell'ambito

della memorizzazione delle informazioni sono prossime ad introdurre innovazioni

in grado di accelerare il trend. Ad esempio, è atteso per fine anno un nuovo DVD

con velocità di scrittura di 20MB/s basato su tecnologia olografica, in grado di

transistor presenti in un circuito integrato, il che, grossolanamente, significava raddoppiarne la

potenza.

Pagina 10 di 26

ospitare 300 GB su un formato equivalente ad un odierno DVD. Entro 5 anni la

società produttrice ritiene di poter introdurre sul mercato supporti DVD da 1,6

Terabyte.

•

Interessante è osservare il trend preso da una tecnologia molto recente, quella

delle flash memory, in grado di affiancare, se non di sostituire, i dischi fissi. A

parità di costo (all'incirca 50 Euro) le Flash memory stanno raddoppiando la

capacità ogni anno. Attualmente per 50 Euro si compra 1 Gbyte di memoria, nel

2010 si compreranno 10 Gbyte, nel 2015 300 Gbyte e nel 2020 10 Terabyte. Non

è escluso, quindi, che in futuro l'industria smetta di montare dischi a tecnologia

meccanica sui PC portatili, in quanto, già a partire dal 2015, le capacità di

memoria garantite dalla tecnologia Flash saranno più che sufficienti, con grande

vantaggio per l'autonomia e per la robustezza dei computer.

In termini di potenza di calcolo e di memorizzazione dei dati, il computer sta evolvendo a

velocità tale da rendere possibile traguardare all'interno del secolo in corso, e

precisamente attorno al 2020, il momento in cui verrà raggiunta la capacità transazionale

del cervello umano, stimata in circa un milione di MIPS (un MIPS è pari a un milione di

transazioni per secondo).

Qualunque scienziato sarà pronto ad obiettare che il modo di lavorare del cervello non

può essere tradotto in un indicatore così rudimentale come il MIPS. Eppure il raggiungere

la capacità transazionale è comunque un traguardo importante. Il resto, per poter

avvicinare o simulare le modalità di comportamento umano, sarà dato dalla nuova

generazione di software, di cui parleremo nell'articolo dedicato alle prospettive delle

ricerche nell'ambito dell'Intelligenza Artificiale e della Robotica. Come vedremo, vi sono

buone probabilità che il test di Turino venga superato attorno al 2040. Per quella data, in

altre parole, vi saranno computer che adeguatamente programmati potranno interagire

con un uomo tramite voce o scritto senza che questi possa riconoscere il fatto che ad

interagire con lui sia una macchina o un uomo.

Pagina 11 di 26

Figura 2 – L’evoluzione della potenza di calcolo a parità di costo di apparato

Per ora, giusto per il gusto della provocazione, mi limito ad osservare che proiettando

l'evoluzione della capacità di calcolo dopo il 2020 possiamo calcolare che, all'incirca nel

2060, un computer da 1.000 Dollari avrà la capacità transazionale dell'intero genere

umano, e nel 2100 una capacità transazionale superiore di svariati milioni di miliardi di

volte a quella dell'intero genere umano (per la precisione 10 seguito da 35 zeri volte

superiore). Ma di questo, ripeto, ne parleremo un'altra volta.

2. Come cambierà la fisionomia del Personal Computer

La capacità di calcolo e di memorizzazione dei prossimi PC è un elemento interessante,

ma non può bastare per comprendere e ipotizzare le innovazioni che stanno per entrare

in questo segmento dell'Information Technology.

Pagina 12 di 26

Quando parliamo di un PC, alla nostra mente va normalmente l’immagine di uno

scatolotto con attaccato un video, una tastiera e una stampante, come quello che

abbiamo a casa o in ufficio. O al più, considerato che in termini di valore oggi le vendite

mondiali di PC sono divise equamente tra desktop e notebook, l’immagine di un portatile.

Come ben ha osservato Bill Gates, la domanda di informatica individuale a cui il PC ha

risposto sino ad oggi verrà soddisfatta nel futuro da un complesso ecosistema di

dispositivi specializzati, che condivideranno una capacità di connettersi tra loro e di

scambiarsi i dati, ma che saranno fisicamente diversi e destinati ad assolvere molto bene

un insieme limitato di compiti.

2.1. La differenziazione e specializzazione dei device

La sostituzione del PC con un ecosistema destinato a diverse funzioni specializzate è già

iniziata. La domanda di mobilità è stata già parzialmente soddisfatta dalla nascita dei

notebook e, più recentemente, degli ultraleggeri (portatili sotto i due chili). A questi si

sono aggiunti, da quasi dieci anni, i palmtop, computer dalle capacità molto limitate ma

dalle dimensioni, peso e consumo ridottissimi.

Da pochi anni sono disponibili palmtop più potenti, dalle capacità paragonabili a quelle di

un PC di 10 anni fa. Alcuni di essi hanno mantenuto una funzionalità generica, mentre

altri, tra cui il Blackberry, si sono specializzati nelle applicazioni di connettività Internet e,

in particolare, sull’eMail.

I telefoni cellulari, nel frattempo, hanno acquisito abbastanza potenza di calcolo da

essere dotati di un sistema operativo, di uno schermo, di un impianto fotografico e di una

connettività verso Internet. E a loro fianco sono nati altri dispositivi specializzati, come il

famoso IPod, per la gestione di musica, foto e filmati.

Gli IPod più recenti, privi di dischi e schermi, sono leggerissimi e molto piccoli, e

delineano la probabile differenziazione di questo dispositivo tra una linea destinata al solo

ascolto di musica, dall’estrema portabilità e autonomia, e una linea di IPod più versatili

ma, allo stesso tempo, più ingombranti e dai consumi più elevati.

Nel frattempo la Sony ha annunciato, con disponibilità commerciale nella prossima

estate un Reader, cioè un dispositivo piccolo e leggero, dallo schermo dotato delle qualità

di leggibilità simili a quelle della carta stampate, destinato esclusivamente a facilitare la

diffusione dell’editoria elettronica.

Pagina 13 di 26

Figura 3 – Nuovi device specializzati

L’IPod Shuffle, grande come un

pacchetto di chewingum e pesante

pochi grammi

Il Reader della Sony, formato

paperback e 250 grammi per

contenere migliaia di libri

L’Ultra-Mobile PC di Microsoft. Un Pc in

700 g di peso.

Microsoft, invece, ha lanciato un Ultra-Mobile PC, dispositivo da 7 pollici e dal peso di

poco più di 900 grammi, con connettività Wi-fi e Bluetooth, touch-screen e risoluzione

800x480. Secondo i piani della società di Redmond questo nuovo formato dovrebbe

permettere una fruibilità molto più vasta del PC, che sarebbe così utilizzabile in molte più

circostanze in quanto trasportabile e impugnabile senza le difficoltà di un PC dalla forma

e dal peso tradizionale.

Questa tendenza alla differenziazione e alla specializzazione non è destinata a esaurirsi.

Già a suo tempo Donald Norman, nel suo libro “Il Computer Invisibile”, ipotizzava la

trasformazione del PC da un oggetto multi-funzione ingombrante, scomodo, che richiede

addestramento e che si dimostra fondamentalmente inaffidabile, in un insieme di

dispositivi

invisibili,

al

servizio

dell’uomo,

dall’utilizzo

istintivo,

naturale

e

prevalentemente automatico, come sono l’ABS di un’automobile o l’elettronica che sta

sotto un cellulare.

Pagina 14 di 26

È probabile, quindi, che la tendenza in corso veda un’ulteriore accelerazione e che nei

prossimi quindici anni le funzioni oggi comprese in un PC si frantumino in una miriade di

dispositivi dalle dimensioni minuscole, talvolta indossabili o calzabili come un berretto o

un paio di occhiali, interconnessi tra di loro e con Internet in modo da cooperare nel

rendere il miglior servizio possibile all’uomo.

Su quest’ultimo punto si giocherà buona parte dell’innovatività dei dispositivi che

verranno immessi sul mercato nei prossimi anni. Entro il 2015 tutti i dispositivi che ci

circonderanno potranno riconoscersi tra loro e condividere dati e funzionalità, come già in

parte avviene tra palmtop, notebook e cellulari, che condividono agende e rubriche. Nel

2020 sarà probabilmente difficile riconoscere con chiarezza quali saranno i componenti

con cui interagiremo nell’ambito del Personal Computing. Così come oggi, quando

guidiamo un’automobile di ultima generazione, non siamo consapevoli dell’intervento di

iniezione elettronica, servosterzo, EPS, ABS, e delle decine di altre diavolerie che ci

assistono quando siamo al volante, così un giorno telefoneremo, vedremo filmati, faremo

calcoli, scriveremo testi e ascolteremo musica senza sapere quale, esattamente, dei

dispositivi che avremo con noi sta rispondendo alla nostra richiesta.

2.2. Le innovazioni sui dispositivi di visualizzazione

dell'immagine

La visualizzazione dei dati e, più recentemente, dell'immagine, è stato, allo stesso tempo,

uno dei fattori più importanti nel determinare il successo del PC e il motivo per cui il suo

impiego è sostanzialmente limitato.

Negli anni 80, quando apparvero i primi PC, lo schermo riportava 24 righe da 80 caratteri

ciascuno. In mancanza di specifiche schede grafiche, apparse come prodotti a se stanti e

inizialmente non comprese nei PC in configurazione base, si potevano visualizzare solo

dei testi.

Dopo pochi anni le capacità grafiche furono fornite anche nelle configurazioni base, ma i

video erano piccoli (14 pollici), a bassa risoluzione (640x480) e basati esclusivamente su

tecnologia CRT, cioè simile a quella utilizzata dalla televisione. A partire dalla fine degli

anni ‘90 è cominciata la diffusione degli schermi LCD sia sui portatili, sia sui fissi, dove il

mercato è ormai dominato dai formati a 17 e 19 pollici con risoluzioni che prevedono

circa un milione di pixel divisi più o meno equamente tra altezza e larghezza.

Pagina 15 di 26

Il

cristallo

liquido

ha

migliorato

enormemente

l’ergonomia

dei

dispositivi

di

visualizzazione, ma lascia aperto i problemi legati al contrasto ed alla densità di

risoluzione. Un libro ben stampato ha un contrasto tra inchiostro e carta pari a 120/1,

mentre un video di alta qualità a stento raggiunge la metà di questo valore. Allo stesso

tempo in un libro i dpi (dot per inch, cioè numero di punti neri presenti in un’unità di

superficie) hanno un valore che va da 600 a 1000, mentre in un LCD sono circa un

decimo. In altre parole la carta è ancora decisamente più leggibile e riposante di un

qualunque video.

La marcia, lenta ma inesorabile, verso una visualizzazione sempre più ergonomica ha

quindi necessità di un ulteriore salto tecnologico. Questo salto sarà possibile grazie

all’impiego, anche in video di grande dimensione, di tecnologie della famiglia OLED.

Una rappresentazione di come potrà apparire un PC avente un video basato su tecnologia

OLED e riportata nell’immagine sottostante.

La tecnologia OLED

L’acronimo OLED sta per Organic Light-Emitting Diode. Gli OLED sono dei film organici

elettroluminescenti dello spessore di qualche decina di nanometri che sostituiranno i

cristalli liquidi nei display di prossima generazione per apparecchi portatili. Essi sono

sottili, brillanti, ad ampio angolo visivo e a basso consumo. Potranno essere incorporati in

oggetti flessibili quali tessuti, giocattoli, elementi di arredamento. Il fenomeno fisico su

cui sono basati i dispositivi OLED consiste nell'emissione di radiazione elettromagnetica

provocata da un campo elettrico applicato ad un solido (elettroluminescenza).

Una delle caratteristiche più interessanti della tecnologia OLED è il fatto che è possibile

costruire degli schermi OLED piegabili e arrotolabili. Inoltre potranno essere trasparenti,

e quindi applicabili come strato superiore di altri oggetti, permettendo applicazioni oggi

inimmaginabili.

Schermi OLED a matrice passiva sono oggi già impiegati nell’ambito dei telefoni cellulari

e dei lettori MP3. Entro il 2010 saranno parte dell’offerta anche per schermi da PC

portatile, e finiranno col sostituire completamente l’attuale LCD entro il 2020.

Pagina 16 di 26

Figura 4 – Esempio di un dispositivo di lettura basato su schermo OLED

È probabile che lo sviluppo della tecnologia OLED faccia nascere una famiglia di reader ad

altissima qualità, costantemente connessi ad Internet, in grado di fare il download di libri

e giornali e di permetterne la lettura con la stessa comodità con cui oggi si sfoglia la

carta. L’editoria elettronica, che per ora è stata una promessa mancata, potrà così

svilupparsi

rivoluzionando

il

mercato

e

creando

nuove

prospettive

di

fruibilità

dell’informazione e della cultura.

L’Augmented Reality

Sul fronte della visualizzazione vi è un’altra tecnologia che è da anni in attesa del suo

momento e che, per ora, è utilizzata solo nell’ambito di applicazioni di nicchia. Si tratta

dell’AR, acronimo per Augmented Reality o Realtà Aumentata.

La

realtà

aumentata

consiste

nell'aggiungere

alla

normale

visione

informazioni

contestualizzate generate dal computer. La maggior parte della ricerca sull'AR si sta

adesso concentrando sulla messa a punto di leggeri e confortevoli visori "see-through"

Pagina 17 di 26

(guarda-attraverso), capaci di sovraimporre grafici, scritte e immagini di sintesi alla

normale visione dell'utente arricchendola di utili informazioni.

I sistemi di AR tracciano la posizione e l'orientamento della testa dell'utente in modo da

poter allineare correttamente le immagini di sintesi al punto di vista dell'utente. Con

queste informazioni, il sistema grafico può sovraimporre un'immagine tridimensionale di

una tazzina da tè, per esempio, in cima a un piattino reale e mantenere la tazza virtuale

perfettamente allineata al piattino indipendentemente dalla posizione dell'utente nella

stanza e dalla posizione del piattino stesso.

I sistemi di AR impiegano alcune delle tecnologie usate nei sistemi di realtà virtuale, ma

con una differenza cruciale: che la realtà virtuale mira a sostituire il mondo reale, la

realtà aumentata mira ad arricchire la realtà di informazioni utili per l'espletamento di

compiti complessi.

In ambito militare questa tecnologia è già abbondantemente utilizzata nei sistemi di

puntamento a disposizione dei piloti di elicottero, che mirano l’obiettivo con semplici

spostamenti del capo. Ma vi sono possibilità di impiego in ambito civile ben più

interessanti.

Figura 5 – Impiego dell’Augmented Reality nell’ambito dell’industria

Ad esempio, una persona addetta alla manutenzione potrebbe avere un sistema AR che

mette in evidenza i passi da espletare per il controllo di una apparecchiatura e che

evidenzia le componenti da sostituire o controllare. Un operaio in un grosso cantiere

potrebbe vedere direttamente sul campo i compiti da svolgere in sincronia con altre

Pagina 18 di 26

centinaia di colleghi. Un chirurgo potrebbe avere impresso sopra il paziente la visione a

raggi X o una tomografia assiale o una ecografia, tutte informazioni utilissime per il

trattamento di fratture multiple, operazioni in laparoscopia, operazioni ortopediche, etc.

Figura 6 – L’impiego dell’Augmented Reality in ambito chirurgico

I pompieri potrebbero vedere la disposizione delle stanze di un edificio in fiamme e

conoscere in anticipo le vie di fuga. E ancora altre applicazioni potrebbero essere

sviluppate nell'ambito dei beni culturali, del turismo, della navigazione aerea.

Anche se la realtà aumentata può sembrare roba da fantascienza, i ricercatori hanno

lavorato sullo sviluppo di questi sistemi per più di tre decenni. Il primo prototipo è stato

sviluppato negli anni '60 dai collaboratori del pionieristico Ivan Sutherland all'università di

Harvard e di Utah. Negli anni '70 e negli anni '80 un piccolo numero di ricercatori ha

studiato AR presso il laboratorio Armstrong dell'USAF, il centro di ricerca della NASA

Ames e l'università della Carolina del Nord. All'inizio degli anni '90 è stato coniato il

termine "realtà aumentata" dagli scienziati della Boeing che stavano sviluppando un

sistema sperimentale di AR per aiutare gli operai a montare i cablaggi dei collegamenti

nei grossi aerei di linea. Il decennio passato ha visto una fioritura della ricerca sull'AR che

ha coinciso con una forte riduzione dei costi di sviluppo e un aumento della potenza e

della miniaturizzazione dell'hardware.

Fino a oggi la potenza di calcolo necessaria per gestire le applicazioni di AR hanno

relegato questa tecnologia ad ambiti sperimentali o estremamente di nicchia. A partire

dal prossimo decennio è invece plausibile che l’AR sia parte integrante dei dispositivi

Pagina 19 di 26

hardware forniti a supporto dei PC per applicazioni professionali o per il gioco. In

Australia, ad esempio, è stato adattato il famoso gioco di ruolo Doom in ambito AR. I

giocatori, dotati di apparecchiature sperimentali, camminano in spazi reali, ma vedono

comparire “mostri” virtuali contro cui, sempre virtualmente, combattono.

L’OLED e l’AR sono quindi due tecnologie ormai uscite dalla fase dell’invenzione, il cui

sviluppo porterà presto a una rivoluzione nelle modalità in cui i PC gestiranno la

rappresentazione dell’immagine. Mentre l’OLED entrerà nell’offerta dei dispositivi portatili

da qui alla fine del decennio (cosa già avvenuta nell’ambito dei lettori MP3) fino ad essere

la tecnologia dominante dei display dal 2010 al 2015, l’Augmented Reality diventerà

parte dell’offerta a partire dall’inizio del prossimo decennio, per esprimere a pieno le sue

potenzialità verso il 2020.

2.3. La miniaturizzazione

Per capire cosa è successo, in termini di miniaturizzazione negli ultimi vent’anni, basta

pensare che la potenza di calcolo e lo spazio per la memorizzazione dati dell’IPod Shuffle,

il più piccolo sul mercato, quello che si appendono al collo le persone che fanno jogging,

è circa 50 volte superiore a quelli del PC AT che l’IBM presentò in pompa magna nel

1985. Le dimensioni assunte dai PC odierni, sostanzialmente simili a quelle dei PC di

allora, sono condizionati da necessità ergonomiche. Le dita dell’uomo sono troppo grandi

per permettere una rapida digitazione di testi su piccole tastiere e l’occhio gradisce

schermi di grande dimensione, che non stanchino la lettura.

L’industria sta però trovando soluzioni originali alla necessità di un compromesso tra

dimensione e utilizzabilità. A titolo di esempio, ecco una recente proposta che certo non

pecca di mancanza di originalità.

La possibilità di proiettare tastiera e video permette di ridurre le dimensioni del computer

vero e proprio a quelle di una penna infilabile nel taschino. Al momento questa proposta

ha più il sapore di una provocazione che di una vera e propria proposta commerciale.

Pagina 20 di 26

Figura 7 – Un’ipotesi industriale di miniaturizzazione di un PC

Figura 8 – Una tastiera virtuale già disponibile in commercio

,

Anche se esistono già in vendita dispositivi che proiettano tastiere virtuali per palmtop, le

limitazioni in termini di ergonomia rendono improbabile l’uso di questo tipo di interfacce

al di fuori delle condizioni di emergenza. L’uomo, infatti, quando comunica, ha

costantemente bisogno di feedback. Quando parla deve avere segni di ascolto e quando

digita a una tastiera deve avere la sensazione fisica di aver effettivamente premuto il

tasto desiderato. È per questo motivo che le tastiere di alta qualità sono fatte in modo

che il meccanismo sottostante un tasto sia prima cedevole, poi più duro, e infine ancora

cedevole. Il superamento da parte del dito del punto di massima resistenza conferisce il

Pagina 21 di 26

feedback tattile che conferma al cervello l’esecuzione della pressione. Tastiere come

quelle sopra rappresentate non possono dare feedback, e quindi non saranno mai

utilizzate per lunghe sessioni di scrittura.

Ciò non impedirà comunque che per impieghi molto specializzati la miniaturizzazione

permetta, nei prossimi quindici anni, la nascita di dispositivi indossabili o, addirittura,

inseribili nel corpo umano e interconnessi col resto dell’ecosistema di personal

computing.

Ciò avrà prima di tutto applicazioni mediche, in quanto alcuni problemi di sordità e cecità

potranno essere superati più rapidamente tramite ausili elettronici che tramite

applicazioni di biogenetica. Ma col tempo l’idea di inserire dei “potenziatori” di capacità

all’interno del proprio corpo non troverà più le resistenze culturali e psicologiche di oggi.

Si tratta comunque di applicazioni che, a mio parere, si diffonderanno solo dopo il 2020.

Fino a quella data avremo a che fare essenzialmente con dispositivi indossabili (e quindi

non invasivi) o con protesi mediche assimilabili a un pacemaker.

3. Conclusioni

In conclusione, nei prossimi quindici anni assisteremo, nell’ambito del personal computer,

alle seguenti trasformazioni:

1. Il PC così come lo conosciamo oggi diventerà solo uno di tanti modi con cui verrà

soddisfatta la più vasta domanda di personal computing. I già numerosi device

contenenti intelligenza che sono presenti oggi si moltiplicheranno ulteriormente e

ognuno

di loro

andrà

a

occupare

una posizione

specifica

nell’ambito

della

soddisfazione dei bisogni che richiedono supporto computerizzato.

2. Questo

ecosistema

di

device

intelligenti

sarà

al

suo

interno

interconnesso

costantemente in modo automatico e naturale, e a sua volta sarà connesso a

Internet in modo continuativo e trasparente.

3. Le modalità di interfaccia con l’ecosistema di personal computing si semplificheranno

sempre più, fino ad arrivare al punto in cui il computer diventerà sostanzialmente

invisibile, e sarà percepibile solo tramite i servizi offerti.

Pagina 22 di 26

4. La miniaturizzazione raggiungerà limiti tali da permettere l’indossabilità di chip in

oggetti come guanti, occhiali, cinture e scarpe, in modo tale che il device sia

direttamente interfacciato con il corpo umano e che il software possa comprendere

direttamente dal gesto qual è il bisogno da soddisfare (così come l’ABS capisce di

dover entrare in funzione valutando la pressione esercitata sul freno confrontata con

la velocità dell’auto).

5. I dispositivi di visualizzazione saranno di qualità equivalente, se non superiore, alla

carta stampata e permetteranno lo sviluppo di un’editoria elettronica che affiancherà,

se non sostituirà, quella tradizionale. I video scompariranno dai dispositivi portatili, e

saranno sostituiti da “papiri” arrotolabili o piegabili, comodi e leggeri come un foglio

di carta.

6. Alcuni device saranno dotati dell’hardware e del software necessari per applicazione

di Augmented Reality anche per il pubblico generico, e non solo per applicazioni

specialistiche. La dimensione della realtà virtuale diventerà familiare ai bambini del

2020 come quella del videogioco lo è ai bambini di oggi.

Tutto questo può sembrare azzardato, anche ammettendo l’enormità dei progressi

avvenuti negli ultimi quindici anni. Ma può essere addirittura pessimistico, in quanto la

rapidità di sviluppo della tecnologia dei prossimi quindici anni sarà ben diversa da quella

dei quindici anni passati. La geometricità della progressione, infatti, è tale per cui i

progressi realizzabili saranno circa dieci volte maggiori dei progressi riscontrati negli

ultimi quindici anni.

Inoltre lo sviluppo di Cina e India porteranno ad avere circa tre miliardi di potenziali

clienti in più per le applicazioni di personal computing. Ciò metterà in circolazione una

enormità di denaro che permetterà investimenti nello sviluppo di tecnologie alternative di

ordini di grandezza superiori a quelli finora messi in gioco.

Pagina 23 di 26

4.

Glossario

Bluetooth

Bluetooth fornisce un metodo standard, economico e sicuro per scambiare informazioni

tra dispositivi diversi utilizzando onde radio. Questi dispositivi possono essere personal

digital assistant (PDA), telefoni cellulari, portatili, Computer, stampanti, macchine

fotografiche, ecc.

Flash Memory

È una forma di EEPROM (Electrically Erasable Programmable Read-Only Memory) che

permette a multiple locazioni di memoria di essere cancellate e scritte in un’unica

operazione. Assomiglia alla RAM (Random Access Memory) usata per la memoria dei

PC, ma ha la caratteristica di mantenere il suo stato senza bisogno di alimentazione. In

altre parole è, come un disco, non volatile. Occupa meno spazio di un disco e non ha

parti mobili, ma costa troppo per poterne sostituire completamente le funzioni. Allo

stesso tempo è troppo lenta per sostituire la RAM. È però utile laddove servono capacità

limitate di memoria e invece spazio e peso contano, come nell’ambito della fotografia

digitale o dei dispositivi di salvataggio rapido dei dati.

Legge di Moore

La legge di Moore, più che una legge vera e propria, è una osservazione empirica.

Gordon Moore, cofondatore di Intel con Robert Noyce, è lo studioso che ha dato il via alla

corsa all’evoluzione dei processori, grazie alle sue supposizioni, poi diventate leggi,

conosciute proprio come prima e seconda legge di Moore.

Nel 1965 Gordon Moore, che all'epoca era a capo del settore R&D della Fairchild

Semiconductor e tre anni dopo fondò la Intel, scrisse un articolo su una rivista

specializzata nel quale spiegava come nel periodo 1959-1965 il numero di componenti

elettronici (transistor) che formano un chip raddoppiava ogni anno.

La prima legge di Moore dice che le prestazioni dei processori, e il numero di transistor

Pagina 24 di 26

ad esso relativo, raddoppiano ogni 18 mesi.

Nel 1965 Moore suppose che le prestazioni dei microprocessori sarebbero raddoppiate

ogni 12 mesi. Nel 1975 questa previsione si rivelò corretta e prima della fine del decennio

i tempi si allungarono a 2 anni, periodo che rimarrà valido per tutti gli anni Ottanta. La

seconda legge di Moore, che verrà estesa per tutti gli anni Novanta e resterà valida fino

ai nostri giorni, viene riformulata alla fine degli anni Ottanta ed elaborata nella sua forma

definitiva, ovvero le prestazione dei processori raddoppiano ogni 18 mesi.

MIPS

Milioni di Istruzioni per Secondo. È una criticatissima unità di misura delle performance di

un computer oggi sostanzialmente abbandonata, ma ancora utile per valutare la storia

complessiva dell’evoluzione delle capacità di calcolo

Nel 1970, la performance di un minicomputer era comparata usando il VAX MIPS, dove il

modello della Digital VAX 11/780 era considerate la macchina da 1 MIPS. I primi 8086

avevano una potenza di poco inferiore al MIPS, mentre i primi 386 valevano circa 3 MIPS.

Reader

Dispositivo portatile con schermo e device di manipolazione particolarmente adatti alla

rappresentazione di testi digitalizzati. Nel passato vi sono già stati diversi tentativi di

vendere oggetti di questo tipo, ma la scarsa leggibilità dei vecchi schermi ne ha sempre

impedito la diffusione. La nuova generazione di Reader si baserà su nuove tecnologie

come il cosiddetto “inchiostro elettronico” e le tecnologie OLED.

Wi-fi

Abbreviazione di Wireless Fidelity, è il nome commerciale delle reti locali senza fili (WLAN)

basate sulle specifiche IEEE 802.11

Le reti Wi-Fi (Wireless Fidelity) sono infrastrutture relativamente economiche e di veloce

attivazione e permettono di realizzare sistemi flessibili per la trasmissione di dati usando

frequenze radio, estendendo o collegando reti esistenti ovvero creandone di nuove.

Pagina 25 di 26

Documento reperibile, assieme ad altre monografie, nella sezione Dossier del sito

http://www.sanpaoloimprese.com/

Documento pubblicato su licenza MATE s.r.l.

Destinazione >> ....