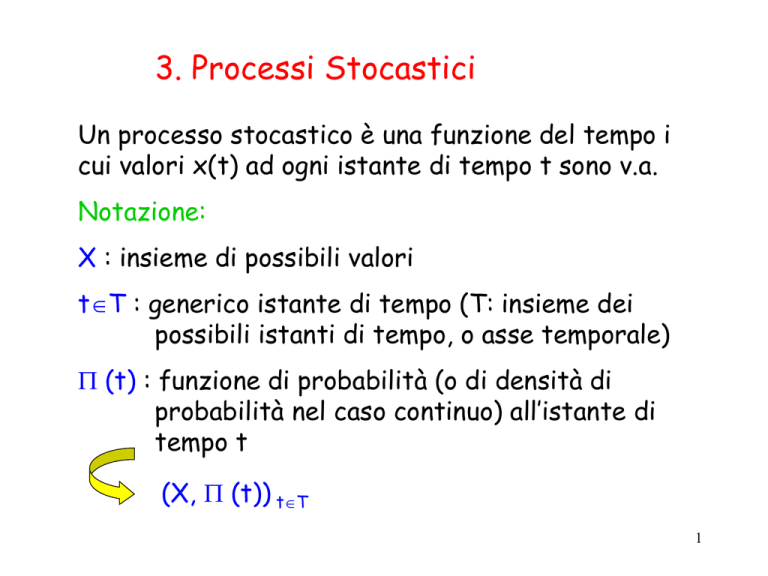

3. Processi Stocastici

Un processo stocastico è una funzione del tempo i

cui valori x(t) ad ogni istante di tempo t sono v.a.

Notazione:

X : insieme di possibili valori

tT : generico istante di tempo (T: insieme dei

possibili istanti di tempo, o asse temporale)

(t) : funzione di probabilità (o di densità di

probabilità nel caso continuo) all’istante di

tempo t

(X, (t)) tT

1

Una realizzazione di un processo stocastico (X, (t)) tT

è una particolare evoluzione x(t) per tT.

Esempio: si lancia una moneta per un numero

infinito di volte agli istanti t = 0,1,2,…

X={0,1} dove x0=0 : esce testa e

x1=1 : esce croce.

tempo

0

1

:

xi

(xi)

0

1

0

1

1/2

1/2

1/2

1/2

:

:

(X, (0))

(X, (1))

possibile

realizzazione

t

0

1

2

3

:

xi

0

0

1

0

:

2

Esempio: si lancia una moneta all’istante t=0 e la

si lascia nella stessa posizione per ogni t > 0.

La tabella (tempo, xi, (xi)) è uguale alla precedente

ma vi sono solo 2 possibili realizzazioni

tempo

0

1

:

xi

(xi)

0

1

0

1

1/2

1/2

1/2

1/2

:

:

t

0

1

2

3

:

x1

0

0

0

0

:

x2

1

1

1

1

:

La tabella (tempo, xi, (xi)) non è sufficiente per

descrivere completamente un processo stocastico.

3

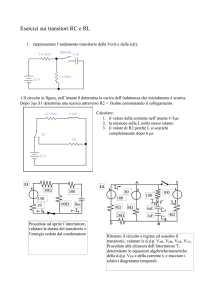

I processi stocastici vengono classificati come segue:

a stati continui

(X è un insieme

continuo, ad es.

XR)

a stati discreti

(X è un insieme

discreto, ad es.

X={x1,x2,…,xn})

a stati finiti

se n < +

sono

anche

detti

catene

a stati infiniti

se n = +

4

Esiste anche un’altra classificazione

dei processi stocastici

a tempo continuo

(T è un insieme

continuo, ad es.

T R+{0})

a tempo discreto

(T è un insieme

discreto, ad es.

T=N)

5

Esempi

1) x è pari al numero di persone in una coda

X={0,1, … } spazio di stato discreto

T= R+ {0} tempo continuo

2) x è pari all’altezza di una persona il giorno del

suo compleanno

X= R+ {0} spazio di stato continuo

T = {0,1,…,n} tempo discreto

6

Ad un processo stocastico a stati discreti

possiamo associare un numero infinito di funzioni

di probabilità congiunta:

x1,x2,…,xn(t1,t2,… ,tn) = Pr(x(t1)=x1, x(t2)=x2, … , x(tn)=xn)

n1

t1 < t2 < … < tn

x1 , x2 , … , xn X

Una definizione analoga vale per le densità di

probabilità nel caso dei sistemi a stati continui.

7

Esempio: si lancia una moneta per un numero

infinito di volte agli istanti t=0,1,2,…

X={0,1} dove x0=0 : testa e x1=1 : croce.

0(0) = Pr(x(0)=0) = 1/2

0,0(0,1) = Pr(x(0)=0, x(1)=0) = 1/4

Esempio: si lancia una moneta all’istante t=0 e la

si lascia nella stessa posizione per ogni t > 0.

0(0) = Pr(x(0)=0) = 1/2

0,0(0,1) = Pr(x(0)=0, x(1)=0) = 1/2

8

Processi stocastici stazionari

Un p.s. è detto stazionario se tutte le sue funzioni di

probabilità (o densità di probabilità) sono stazionarie

ossia invarianti per traslazioni nel tempo.

x1,x2,…,xn(t1,t2,… ,tn) = x1,x2,…,xn(t1+ ,t2+ ,… ,tn+ )

n1

t1 < t2 < … < tn

x1 , x2 , … , xn X

T

N.B.

Se un p.s. è stazionario

allora

t T x(t) =

9

Esempio: si lancia una moneta per un numero

infinito di volte agli istanti t=0,1,2,…

X={0,1} dove x0=0 : testa e x1=1 : croce.

x(0) = 1/2

x(1) = 1/2

:

Sono p.s. stazionari.

Esempio: si lancia una moneta all’istante t=0 e la

si lascia nella stessa posizione per ogni t > 0.

x(0) = x(1) = … = 1/2

10

Esempio: Una macchina può essere guasta x0=0 o

funzionante x1=1 ( X={0,1} ).

Vogliamo studiare la probabilità che la macchina sia

guasta in un certo anno T={0, 1, … , } (anni di

funzionamento).

t

xi

xi

x(t)

Ovviamente la

0

0

probabilità di guasto

0

1

1

1

aumenta con gli anni.

0

0.1

1

0.9

1

0.9

t

0(t)=1-(0.9)

0

0.19

2

0.81

1(t)=(0.9) t

1

0.81

0

0.27

3

0.73

1

0.73

Non è stazionario.

:

11

Processi stocastici ergodici

Un processo stazionario si dice ergodico se tutte le

proprietà statistiche possono essere determinate da

un’unica realizzazione del processo.

Il valore atteso della v.a. in un qualunque istante

coincide con la media temporale di una qualunque

realizzazione.

Definizione formale:

12

Si consideri un p.s. stazionario e sia μ la media di ogni

v.a. (X, (t)), al tempo t T. Per ogni possibile

realizzazione posso calcolare la media temporale:

1 n

μˆ lim x(t)

processi a tempo discreto

n n t 0

1 tfinale

processi a tempo

μˆ lim

x(t)dt

tfinale t

0

finale

continuo

Il p.s. è ergodico se:

1) il limite μ̂ esiste

2) tale limite non dipende dalla particolare realizzazione

3) μˆ μ

13

Lo studio di un p.s. ergodico può pertanto essere

effettuato sulla base di una sola realizzazione.

Esempio: si lancia una moneta per un numero

infinito di volte agli istanti t=0,1,2,…

X={0,1} dove x0=0 : testa e x1=1 : croce.

x(0) = 1/2

x(1) = 1/2 …

μ μˆ 1/2

ergodico

Esempio: si lancia una moneta all’istante t=0 e la

si lascia nella stessa posizione per ogni t > 0.

Ho solo 2 possibili realizzazioni. Il limite μ̂

esiste ma dipende dalla realizzazione.

non ergodico

14

Processi stocastici indipendenti

Un p.s. è indipendente se i valori assunti dal processo in

istanti di tempo diversi sono v.a. indipendenti.

Esempio: si lancia una moneta per un numero

infinito di volte agli istanti t=0,1,2,…

Pr(x(2)=0 | x(1)=0) = 1/2 = Pr(x(2)=0)

p.s. indipendente

Esempio: si lancia una moneta all’istante t=0 e la

si lascia nella stessa posizione per ogni t > 0.

Pr(x(2)=0 | x(1)=0) = 1 Pr(x(2)=0)

p.s. non indipendente

15

Processi stocastici markoviani

Un p.s. è markoviano (o di Markov) se la legge di

probabilità che governa i cambiamenti di stato in un

dato istante di tempo dipende solo dal valore assunto

dallo stato nell’istante di tempo precedente e non da

tutti i precedenti valori assunti dallo stato

Pr(x(tn)=xn | x(tn-1)=xn-1) =

Pr(x(tn)=xn | x(tn-1)=xn-1, x(tn-2)=xn-2, … x(t1)=x1)

Il processo non ha memoria di quanto accaduto

prima di raggiungere lo stato attuale.

16

Esempio di processo non markoviano: Ho un urna con 2

palline, una bianca e una nera.

Effettuo delle estrazioni e ogni volta rimetto 2

palline dello stesso colore di quelle che ho tolto.

Esempio di Processo markoviano: si lancia una

moneta all’istante t=0 e la si lascia nella stessa

posizione per ogni t > 0.

17

Processi stocastici semi-markoviani generalizzati

Un p.s. semi-markoviano generalizzato è una

estensione di un p.s. markoviano.

In particolare in questo caso la legge di probabilità

che governa i cambiamenti di stato in un dato istante

di tempo dipende sia dal valore assunto dallo stato

nell’istante di tempo precedente sia dal tempo di

permanenza in tale stato.

18

Processi di conteggio

Un p.s. X(t) è detto processo di conteggio se conta il

numero totale di eventi accaduti fino al tempo t, ossia

nell’intervallo (0,t].

I processi di conteggio sono una speciale classe di p.s.:

• a tempo continuo

• a stati discreti

numero di

eventi

istanti di tempo in

cui si verificano gli

eventi

19

Per definizione un processo di conteggio verifica le

seguenti condizioni:

(i) X(t) 0

(ii) X(t) N

(iii) se t’ t’’ X(t’) X(t’’)

(iv) se t’ < t’’

la v.a. X(t’’) - X(t’) conta il

numero di eventi accaduti in (t’,t’’].

20

Definizione

Un processo di conteggio ammette incrementi

indipendenti se

t 0,

h > 0,

le v.a. X(t+ h) - X(t) e X(t) sono tra loro indipendenti.

Il numero di eventi in (t,t+ h] è indipendente

dal numero di eventi in (0,t].

21

Definizione

Un processo di conteggio ammette incrementi stazionari

se

t’, t’’ 0,

h > 0,

le v.a. X(t’+ h) - X(t’) e X(t’’+ h) - X(t’’) hanno la

stessa distribuzione di probabilità.

La probabilità di avere un certo numero di

eventi in un dato intervallo di tempo dipende

solo dall’ampiezza dell’intervallo stesso.

22

Processo di Poisson

Un processo di Poisson è un caso particolare di

processo di conteggio.

È particolarmente importante perché un gran numero

di fenomeni fisici possono essere descritti (almeno in

prima approssimazione) da tale processo:

ossia conta gli eventi che si verificano in modo molto

casuale ma indipendente dal tempo.

N.B.

Nel seguito si farà sempre l’ipotesi che due eventi non

possano verificarsi mai contemporaneamente.

23

Definizione

Un p.s. X(t), t 0, è detto Processo di Poisson con

parametro (o intensità, o tasso) se:

(i) X(0) = 0

(ii) il processo ha incrementi indipendenti

(iii) t 0, h > 0, la v.a. X(t+ h) - X(t) ha

distribuzione di Poisson di parametro h.

e - x

x!

Pr(x)

0

x N

R+

altrimenti

E[X]

Var[X]

24

Proprietà:

Come conseguenza della

(iii) t 0, h > 0, la v.a. X(t+ h) - X(t) ha

distribuzione di Poisson di parametro h

• E[X(t)] = t e

• il processo ha incrementi stazionari.

Possiamo pertanto dare la seguente altra

definizione di processo di Poisson.

25

Definizione

Un processo di Poisson X(t) è un processo di

conteggio con incrementi indipendenti e stazionari

e tale per cui la v.a. X(t+ h) - X(t) ha

distribuzione di Poisson di parametro h,

t 0, h > 0.

N.B.

Il parametro ha le dimensioni dell’inverso del

tempo e rappresenta il numero di eventi nell’unità

di tempo.

Il rapporto 1/ rappresenta pertanto il tempo

medio tra due eventi successivi.

26

Proprietà (la diamo senza dimostrazione):

I tempi di inter-evento (ossia i tempi tra due eventi

successivi) di un processo di Poisson sono una

sequenza di v.a. indipendenti aventi distribuzione

esponenziale.

In particolare, la corrispondente funzione di densità

di probabilità è

λ t

λ

e

t0

(t)

t0

0

dove è il parametro caratteristico del processo di

Poisson.

Infatti:

1

0

μ t(t)dt

è il tempo medio di

inter-evento.

27

Memoryless property

Ricordiamo preliminarmente che nel caso di densità di

probabilità esponenziale con parametro , la funzione

di distribuzione cumulativa di probabilità vale:

F(t) = 1 - e- t

Ora, supponiamo che un evento si verifichi al tempo T.

Sia T + V il tempo in cui si verifica l’evento successivo.

Supponiamo che al tempo T+z > T l’evento successivo

NON si sia verificato.

Si è verificato l’evento [V>z].

28

V

T

T+z

T+z + t

età dell’evento

Calcoliamo la probabilità che si verifichi l’evento

[V z + t ] per un generico t> 0, dato che si è

verificato l’evento [V > z].

Probabilità

condizionata

29

Pr[V z t and V z]

Pr[V z t | V z]

Pr[V z]

Pr[z V z t]

1 Pr[V z]

Poiché i tempi di inter-evento sono caratterizzati

da una distribuzione esponenziale

Pr[V z] F(z) 1 - e-z

(1 - e - (z t) ) (1 - e -z )

Pr[V z t | V z]

e -z

- e -z e -t e -z

-t

1

e

e -z

30

Pr[V z t | V z] 1 e-t

Tale probabilità condizionata verifica allora le

seguenti proprietà:

(1) non dipende da z

(2) è identica a F(t) = Pr[V t]

Questa è la proprietà memoryless (priva di

memoria) della distribuzione esponenziale.

31

Teorema (la diamo senza dimostrazione):

La memoryless property vale per qualunque

distribuzione esponenziale

e

se una distribuzione gode della memoryless property

deve necessariamente essere esponenziale.

Riassumendo:

Processo di

Poisson

Tempi di interevento

esponenziali

Memoryless

property

32

Proprietà:

Il p.s. risultante dalla sovrapposizione di m processi

di Poisson mutuamente indipendenti, caratterizzati

dai parametri i, i=1, …, m, è ancora un processo di

Poisson caratterizzato dal parametro = 1 + … + m.

33

Esempio: Il processo degli arrivi in coda ad un

semaforo è Poissoniano?

Se il precedente semaforo è molto lontano potrebbe

esserlo poiché gli arrivi sarebbero indipendenti.

Se invece il precedente semaforo è vicino, allora le

macchine arrivano generalmente a piccoli gruppi e non

sono indipendenti.

Questo naturalmente nell’ipotesi che il flusso delle

macchine sia indipendente dal tempo.

34