Lezione 12: Ancora sulle matrici

La matrice inversa e il metodo di Cramer

Abbiamo detto che usando le matrici e i vettori possiamo scrivere sinteticamente un

sistema come Ax = b. Pensate ora di avere una sola equazione lineare con una sola

incognita x, cioè

ax = b

dove sia a che b sono due numeri reali (il coefficiente e il termine noto), con a diverso

da zero. Trovare la soluzione di questa equazione è ovviamente banale. Cosa facciamo? Moltiplichiamo entrambi i membri dell’equazione per l’inverso di a, a−1 = 1/a, e

otteniamo la soluzione dell’equazione

1

b

x = 1 · x = ax = ,

a

a

cioè abbiamo una “formula esplicita”per la soluzione (vi ho scritto esplicitamente tutti

i passaggi per sottolineare che stiamo usando il fatto che il prodotto tra un numero

e il suo inverso fa 1, che ha la bella proprietà di non cambiare i numeri per cui lo

moltiplichiamo, è “l’elemento neutro del prodotto”).

Nell’equazione matriciale Ax = b sarebbe bello fare la stessa cosa. Molte volte

questo sarà possibile, ma ovviamente non sarà cosı̀ banale come nel caso appena visto.

Non è difficile convincersi del fatto che se ci aspettiamo un metodo simile a quello visto

per una singola equazione, che dopo alcuni passaggi algebrici ci porti a una “formula

esplicita” per la soluzione (x = . . .), il sistema che consideriamo dovrà essere tale da

avere (sicuramente) soluzione unica, che sarà quella data dalla formula.

Mettiamoci, allora, nel caso in cui la matrice A sia quadrata. Questo vuol dire che

il sistema corrispondente ha tante equazioni quante incognite e allora la condizione

perché il sistema abbia soluzione unica è che la matrice A abbia rango massimo, ossia

det A 6= 0. Troveremo “la formula” di cui sopra sotto queste condizioni.

Ma andiamo per gradi....

La prima cosa che ci servirebbe è “l’equivalente dell’1”, cioè una matrice che moltiplicata per una qualsiasi altra matrice (con essa compatibile rispetto al prodotto righe

per colonne) la lasci invariata. Questa si dice la matrice “identità”:

Definizione 106 Tra le matrici quadrate di ordine n si chiama l’identità (di ordine

n), e si indica con In , la matrice diagonale che ha tutti gli elementi della diagonale

uguali a 1, cioè

1 0

0 ... 0

1

0 ... 0

0

.

..

.

In = .

.

0

1 0

0 ...

0 0 ... 0 1

114

Lezione 12

115

Proposizione 107 La matrice identità In (di ordine n) ha la seguente proprietà: se

A è una qualsiasi matrice m × n e B una qualsiasi matrice n × m si ha

AIn = A

e

In B = B

cioè è l’elemento neutro del prodotto righe per colonne.

Proviamo a convincerci del fatto che questa proprietà è vera attraverso qualche

esempio.

Esempio 108 Consideriamo l’indentità di ordine 2

1 0

0 1

e calcoliamo per esempio

3 −2

5 9

1 0

0 1

=

3 · 1 + (−2) · 0 3 · 0 + (−2) · 1

5·1+9·0

5·0+9·1

=

3 −2

5 9

analogamente si verifica facilmente che

1 0

0 1

3 −2

5 9

=

3 −2

5 9

(con l’identità il prodotto è “commutativo”).

Facciamo un altro esempio

Esempio 109

2

2·1+6·0+7·0

2

1 0 0

0 1 06 = 2 · 0 + 6 · 1 + 7 · 0 = 6

7

2·0+6·0+7·1

7

0 0 1

Visto? E vedrete che qualunque altro esempio vi inventiate, funziona sempre.

Bene, una volta che abbiamo la matrice identità siamo a buon punto. Ora il nostro

“problema” sarebbe risolto se data una matrice quadrata A, fossimo in grado di trovare

un’altra matrice, per ora la chiamo D, che moltiplicata per A mi dia l’identità. Allora

potremmo partire dall’equazione matriciale Ax = b, moltiplicare ambo i membri per D

e trovare la soluzione come facevamo nel caso di una semplice equazione di un incognita,

ossia

Ax = b ⇐⇒ DAx = Db ⇐⇒ x = Ix = Db !!!

Una matrice che “fa questo” con la matrice A si chiama la “matrice inversa di A”.

Definizione 110 Data una matrice quadrata A di ordine n, con det A 6= 0, si chiama

matrice inversa di A e si indica con A−1 , quella matrice quadrata di ordine n che

moltiplicata (a destra o a sinistra) per A da l’identità, cioè verifica

A−1 A = In

e

AA−1 = In .

Lezione 12

116

Nota: Se A è una matrice quadrata, allora

A ammette l’inversa se e soltanto se det A 6= 0.

Attenzione: La notazione “A−1 ” è solo un simbolo che noi usiamo per indicare che

questa matrice è “l’inversa di A”, cioè ha insieme ad A la proprietà descritta dalla

definizione, e questa matrice può essere costruita (come vedremo subito) a partire da

A. Nel caso dei numeri reali, l’inverso di un numero a 6= 0 si determina facilmente e

come sappiamo a−1 = 1/a, nel caso delle matrici, ovviamente la regola per calcolare

l’inversa sarà un po’ più complicata.

Esempio 111 Prendiamo la matrice

A=

e verifichiamo che

2 1

4 3

3

1 3 −4

− 12

2

=

.

−2 1

2 −1 2

Come facciamo a verificarlo? Basta fare il prodotto delle due e assicurarsi che il risultato

sia la matrice identità! Allora:

A−1 =

A−1 A =

3

2

− 12

−2 1

2 1

4 3

=

− 12 4 23 − 12 3

−4 + 4 −2 + 3

3

2

2

=

1 0

0 1

= I2

e vedrete che è altrettanto facile verificare che AA−1 = I2 .

Evidentemente c’è un metodo che ci permette di determinare l’inversa di una matrice quadrata con determinante non nullo. Nel caso particolare di una matrice 2 × 2 è

molto facile scriverlo esplicitamente ed è il seguente: se

A=

allora

a11

a21

a12

a22

,

1

a22 −a12

A =

.

det A −a21 a11

Fate la verifica in generale e troverete che se fate il prodotto di A con questa A−1 , trovate

come risultato l’identità indipendentemente da quali siano i valori aij . In generale (per

una matrice n × n) la regola è un po’ più complicata. Prima di darvela devo introdurre

un altra definizione, quella di matrice “trasposta” (niente di che, è solo un passaggio

intermedio che ci permette di descrivere più sinteticamente la “regola” e che comunque

si incontrerà altre volte).

−1

Definizione 112 Se A è una matrice m × n si chiama la matrice trasposta di A, e

si denota con At , la matrice n × m ottenuta da A scambiando le righe con le colonne.

Esempio 113 Se

3 −2 8 π

A=

0 4 −3 7

allora, scambiando le righe con le colonne, si ottiene

3

0

−2

4

.

At =

8

−3

π

7

Lezione 12

117

Oppure, se B = (3 6 9 0), allora

3

Bt =

6

9

.

0

Per l’operazione di “trasposizione” valgono le seguenti proprietà (piuttosto ovvie da

verificare)

1. det A = det (At ) (il determinante di A è uguale al determinante della sua trasposta)

2. (At )t (se facciamo la trasposta della trasposta di A, riotteniamo A)

3. rango A = rango At (il rango di A è uguale al rango della sua trasposta)

Ora possiamo concludere questa questione della determinazione della matrice inversa. Se A è una matrice quadrata n × n con det A 6= 0, allora per determinare la

matrice inversa

si considera la matrice ottenuta da A mettendo al posto di ogni elemento aij il

suo complemento algebrico Aij (vi ricordate? L’abbiamo definito quando abbiamo

fatto il determinante), quindi si fa la trasposta di questa matrice e la si divide

per il determinante di A, la matrice che cosı̀ si ottiene è la matrice inversa.

Scritta in formula:

A−1

A11

A12

1

.

=

det A

.

.

A1n

A21

A22

A2n

...

...

An1

An2

.

.

.

.

... Ann

Non ci vuole molto a verificare che questa formula scritta in generale si riduce a quella

che vi ho dato prima per le matrici 2 × 2. È chiaro però che già nel caso 3 × 3 (per

non parlare di matrici più grandi) la determinazione della matrice inversa può richiede

un po’ di operazioni ed essere abbastanza faticosa. È bene, però, sapere che questa

formula esiste e che all’occorrenza si può usare.

Applichiamo su un esempio semplice quello che abbiamo fatto cercando di mettere in

evidenza l’utilità della matrice inversa nella “risoluzione” dei sistemi lineari.

Esempio 114 Supponiamo di voler studiare un sistema lineare di cui fissiamo i coefficienti, ma in cui ci riserviamo di scegliere più avanti i termini noti

3x − 2y = b1

−4x + 6y = b2

.

Scritto in forma matriciale questo sistema diventa

x

A

y

=

b1

b2

con A =

3 −2

−4 6

.

Lezione 12

118

Adesso sappiamo come determinare la matrice inversa di A e di conseguenza la soluzione

corrispondente a ogni possibile scelta del termine noto. Facilmente si calcola det A = 10

e quindi la matrice inversa è data da

A−1 =

1

10

6 2

4 3

e allora, moltiplicando (a sinistra) entrambi i membri dell’equazione matriciale si ha

x

y

−1

=A

b1

b2

1

=

10

6 2

4 3

b1

b2

⇐⇒

(

x=

y=

6

b

10 1

4

b

10 1

2

+ 10

b2

3

+ 10 b2

.

Vedete il vantaggio? Abbiamo risolto il sistema una volta per tutte e ogni volta che

scegliamo dei termini noti diversi, basta sostituire i due valori di b1 e b2 in quest’ultimo

sistema e questo ci dà direttamente la soluzione corrispondente. Per esempio se avessimo

voluto risolvere il sistema con termini noti b1 = 10 e b2 = 5 avremmo ottenuto le

soluzioni

(

6

2

x = 10

10 + 10

5=7

4

3

y = 10 10 + 10 5 = 11

2

(la verifica che questa è effettivamente la soluzione è immediata).

Riassumendo abbiamo detto che se abbiamo una matrice quadrata A con det (A) 6=

0 abbiamo un’unica soluzione del sistema

Ax = b

per qualsiasi termine noto b. E sappiamo anche come trovare la soluzione: è data dalla

formula

x = A−1 b .

Se ci ricordiamo qual’è l’espressione della matrice inversa e calcoliamo esplicitamente

le coordinate della soluzione, ci accorgiamo per esempio che

x1 =

b1 A11 + b2 A21 + ... + bn An1

det (A)

xi =

b1 A1i + b2 A2i + ... + bn Ani

.

det (A)

e quindi in generale

C’è un modo più veloce di scrivere questa formula. Prendiamo la matrice, che chiamiamo Aib , che otteniamo da A mettendo al posto della i-esima colonna la colonna b. Per

esempio

b1 a12 ... a1n

b2 a22 ... a2n

.

.

1

.

Ab =

.

.

.

.

bn an2 ... ann

Ora provate a calcolare il determinante di A1b sviluppandolo con la colonna b e vedrete

che vi viene proprio

det (A1b ) = b1 A11 + b2 A21 + ... + bn An1 .

Lezione 12

119

E analogamente per tutte le altre

det (Aib ) = b1 A1i + b2 A2i + ... + bn Ani .

In altre parole abbiamo che la componente i-esima della soluzione è data da un’espressione che non è altro che il rapporto tra il determinante della matrice che otteniamo

da A sostituendo l’i-esima colonna con la colonna dei termini noti e il determinante di

A, ossia

det (Aib )

.

xi =

det (A)

Questa è nota come la regola di Cramer per la soluzione dei sistemi quadrati

determinati (che quindi non è altro che un modo esplicito di scrivere x = A−1 b).

Cenni sulle trasformazioni lineari: autovalori e autovettori

Finora, nello studio dei sistemi lineari, abbiamo fissato una matrice A ∈ Mmn e un

vettore b in V m e ci siamo domandati quale fosse la soluzione x del sistema Ax = b.

Qualche volta, invece, non abbiamo fissato b e ci siamo domandati per quali b ci fosse

soluzione.

Proviamo allora a vedere la questione da un altro punto di vista e riformuliamo la

domanda nel seguente modo: fissata la matrice A e dato un qualsiasi x ∈ V n , quali

sono i b che possiamo ottenere calcolando Ax?

In altre parole potremmo pensare che la matrice A ci fornisce una regola per

“trasformare” tutti i vettori x di V n in certi vettori b di V m .

Ossia diremo che la matrice A rappresenta una trasformazione lineare degli

elementi di V n in elementi di V m .

Cosı̀ sembra piuttosto astratto (e infatti lo è), ma proviamo a vederlo su un esempio.

Esempio 115 (di trasformazione lineare) Prendiamo la matrice

A=

3 −2

−1 4

.

x

del piano si trasforma secondo A in un altro vettore x′ =

y

ossia Ax = x′ e quindi

3x − 2y = x′

−x + 4y = y ′ .

Ogni vettore x =

x′

y′

1

1

Quindi, per esempio, il vettore

diventa

. Quindi per visualizzare la situazione

1

3

disegnamo il punto (1, 1) in un riferimento cartesiamo e il punto (1, 3) in un altro

riferimento

Lezione 12

120

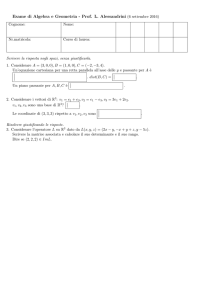

Q1

P1

Figura 57: Il punti P1 si trasforma nel punto Q1

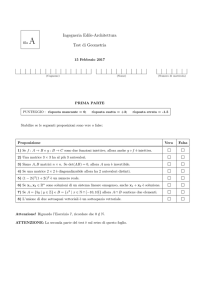

Se ora questa stessa trasformazione la facciamo per tutti i punti di un quadrato di

lato 2 centrato nell’origine otteniamo che il quadrato si trasforma in un parallelogramma.

Q4

Q1

P4

P1

P3

P2

Q3

Q2

Figura 58: Il quadrato si trasforma nel parallelogramma

Fatelo. È facile verificare che i punti P2 , P3 e P4 si trasformano rispettivamente

nei punti Q2 = (5, −5), Q3 = (−1, −3) e Q4 = (−5, 5). Vedete, guardando la figura si

capisce meglio cosa intendiamo per trasformazione.

Una trasformazione di questo tipo la troviamo in molte situazioni. Per esempio

se proiettiamo l’ombra del quadrato su un piano non parallelo al piano del quadrato.

Oppure, un esempio ancora più significativo: se il quadrato fosse fatto di materiale

elastico, si trasformerebbe in un quadrato se lo tiriamo in una opportuna direzione.

Questa interpretazione ci suggerisce un’altra domanda importante.

Domanda: Quali vettori x non cambiano direzione se li trasformiamo con A? Ossia ci

sono dei vettori x che trasformati con A che si allungano o si accorciano ma rimangono

sulla stessa retta?

Se ripensiamo all’interpretazione della deformazione elastica questo corrisponde a

Lezione 12

121

chiedere in quali direzioni dobbiamo tirare (o eventualmente comprimere) il quadrato

per deformarlo nel parallelogramma.

Sappiamo riscrivere questa domanda in termini matematici? Pensiamoci, è facile.

Ci stiamo chedendo se ci sono degli x per cui Ax è parallelo ad x, ossia se ci sono degli

x per cui esiste uno scalare λ ∈ R tale che

Ax = λx .

Nel caso che stiamo trattando questo equivale a chiedere se ci sono soluzioni non banali

del sistema omogeneo

(3 − λ)x − 2y = 0

−x + (4 − λ)y = 0 .

Che usando un po’ di algebra delle matrici possiamo scrivere come

(A − λI2 )x = 0 .

Noi sappiamo risolvere questo sistema e la risposta dipende dal rango della matrice dei

coefficienti

3 −2

1 0

3 − λ −2

A − λI2 =

−λ

=

.

−1 4

0 1

−1 4 − λ

Infatti chiedere che ci siano soluzioni non banali equivale a chiedere che il rango non

sia massimo e quindi che questa matrice abbia determinante nullo. Quindi cerchiamo

dei valori di λ per cui si abbia

det

ossia tale che

3 − λ −2

−1 4 − λ

= 0,

(3 − λ)(4 − λ) − 2 = λ2 − 7λ + 10 = 0 .

I valori di λ per cui questo determinante è nullo sono allora λ = 2 e λ = 5. Ora,

come troviamo le direzioni corrispondenti? Ossia quelle che rimangono fisse nella trasformazione lineare? È facile. Basta trovare le soluzioni non banali dei due sistemi

corrispondenti ai due valori λ = 2 e λ = 5.

Facciamo il caso λ = 2. Il sistema corrispondente è quindi

x − 2y = 0

−x + 2y = 0 .

Come è giusto il sistema si riduce a due equazioni proporzionali (infatti λ = 2 annulla il

determinante di A−λI +2). Quindi le soluzioni sono tutti i punti della retta x−2y = 0,

ossia tutti i punti della forma (2α, α). È questa la direzione che rimane fissa nella

trasformazione.

Altrettanto facile è il caso λ = 5 che dà

−2x − 2y = 0

−x − y = 0 .

Quindi i punti della retta x + y = 0 sono le soluzioni e quindi tutti quelli della forma

(−α, α)

2

−1

In conclusione abbiamo capito che i vettori paralleli ai vettori

e

non

1

1

cambiano direzione con trasformazione e si allungano rispettivamente

e 5. Ivalori

di

2

2

−1

2 e 5 si chiamano autovalori della matrice A e i vettori paralleli a

e

sono

1

1

i corrispondenti autovettori.

Lezione 12

122

Quello che abbiamo visto in questo esempio vale in generale.

Definizione 116 Data una matrice quadrata A ∈ Mnn i suoi autovalori, se esistono,

sono i valori λ1 ,..., λn che sono soluzioni della seguente equazione

det (A − λIn ) = 0 .

Se λ è un autovalore, tutti i vettori x 6= 0 che verificano

Ax = λx

si chiamano gli autovettori di A corrispondenti a λ.

Attenzione Non tutte le matrici quadrate ammettono autovalori. È chiaro infatti

che se una trasformazione fa ruotare tutti vettori di un dato angolo allora per questa

trasformazione nessuna direzione rimarra fissa.

Esempio 117 Consideriamo la matrice

Un qualsiani vettore

a

b

0 −1

1 0

.

=

si trasforma in

0 −1

1 0

a

b

−b

a

.

Quindi ogni vettore si trasforma nel suo vettore ortogonale ottenuto ruotandolo in

senso antiorario di 90 gradi.

Questo esempio lo possiamo fare anche più in generale (cosi’ con l’occasione vi

ricordo un paio di formule trigonometriche che non è male sapere che esistono). Fissiamo

un angolo θ e consideriamo la matrice

cos θ

sin θ

− sin θ

cos θ

.

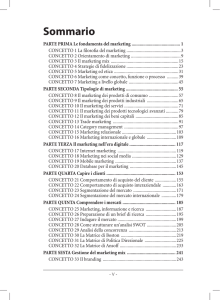

Proviamo a trasformare un qualsiasi versore usando questa matrice. Se io vi do l’angolo

che questo versore forma con l’asse delle x, diciamo che lo chiamo α, vi ricordate come si

indicano le sue coordinate. Ma è facile sono date rispettivamente da cos α e sin α. Bene

ora che conosciamo le sue coordiante siamo pronti a rasformarlo. Quindi otteniamo

cos θ

sin θ

− sin θ

cos θ

cos α

sin α

=

cos θ cos α − sin θ sin α

sin θ cos α + cos θ sin α

.

Vedete le due coordiante del vettore trasformato si possono scrivere più efficientemente

usando le due seguenti formule del

cos(α + θ) = cos(α) cos(θ) − sin(α) sin(θ)

sin(α + θ) = cos(α) sin(θ) + cos(θ) sin(α) ,

quindi il vettore trasformato è semplicemente

Ossia è stato ruotato di un angolo θ.

cos(α + θ)

sin(α + θ)

.

Lezione 12

123

sin(!+")

sin(!)

!+"

!

cos(!)

cos(!+")

Figura 59: Rotazione di un angolo θ

Esercizio 118 Determinare gli autovalori della matrice

2 0 √0

5 .

0 √3

0

5 −1

Notate che questa matrice ha una forma particolare, se cambiate le righe con le

colonne rimane uguale, ossia è uguale alla sua trasposta, A = At . Questo è dovuto al

fatto che tutti gli elementi verificano: aij = aji . Una matrice cosı̀ si dice simmetrica

(nelle applicazioni vedrete per lo più matrici simetriche). Si può dimostrare che se la

matrice è simmetrica si riescono sempre a determinare i suoi autovalori.

Facciamolo nel caso della matrice dell’Esercizio 118. Dobbiamo calcolare il determinante di A − λI3 , ossia

2−λ

0

√0

3√

−λ

det 0

5 = (2 − λ)((3 − λ)(−1 − λ) − 5) = (2 − λ)(λ2 − 2λ − 8) .

0

5 −1 − λ

Si vede facilmente che il polinomio λ2 − 2λ − 8 si annulla per λ = −2 e λ = 4 e quindi

det (A − λI3 ) = (2 − λ)(2 + λ)(4 − λ) .

Da cui si deduce facilmente per quali valori di λ questa espressione si annulli e si trovano

quindi gli autovalori, che saranno λ = 2, λ = −2 e λ = 4. E l’esercizio è svolto.

Casi particolari

1. Consideriamo la trasformazione associata alla matrice

3 0

A=

.

0 3

È facile vedere che questa trasformazione allunga tutti i vettori di 3 (infatti per

qualsiasi vettore x si ha Ax = 3x). Allora è chiaro che gli autovalori sono dati

dal solo valore λ = 3 e tutte le direzioni rimangono ferme (ossia tutti i vettori

del piano sono autovettori).

Una trasformazione cosı̀ si chiama omotetia. In generale una matrice della forma

A=

α 0

0 α

.

Lezione 12

124

Figura 60: L’omotetia dilata tutto

2. Un altro esempio significativo è il caso delle matrici diagonali. Prendiamo per

esempio

1 0

A=

.

0 2

Come trasforma il quadrato questa matrice? È facile, non cambia la prima coordianta e raddoppia la seconda, quindi trasforma il quadrato in un rettangolo.

Figura 61: Allunga diversamente le due direzioni coordiante

Allora è anche chiaro che gli autovalori sono proprio i due valori sulla diagonale

1 e 2 e gli autovettori corrispondenti saranno tutti i vettori sull’asse x e tutti

i vettori sull’asse y, rispettivamente (infatti Ae1 = e1 e Ae2 = 2e2 ). È chiaro

quanto detto è vero per qualsiasi matrice diagonale, come per esempio

A=A=

α1

0

0

α2

.

3. L’ultimo esempio che voglio mostrarvi è dato dalla matrice

A=

0 1

1 0

.

È chiaro che questa matrice trasforma un qualsiasi vettore

ossia

x

y

nel vettore

y

,

x

0 1

x

y

=

.

1 0

y

x

Quindi scambia l’asse x con l’asse y. Provate a trasformare il quadrato di vertici

(1, 1), (2, 1), (2, 0) e (1, 0) e capirete in che consiste questa trasformazione.

Lezione 12

125

Figura 62: Allunga diversamente le due direzioni coordiante

Ma quindi è chiaro cosa succede, questa trasformazione è un ribaltamento del

piano lungo la bisettrice del primo e terzo quadrante. Ma allora è facile capire

quali sono le rette che rimangono fisse: le due busettrici. Infatti tutti i vettori

sulla bisettrice del primo e terzo quadrante rimango fermi e tutti i vettori sulla

bisettrice del secondo e quarto

quadrante

cambiano verso (fate la prova). Quindi

1

−1

gli autovettori sono

e

e i corrispondenti autovalori sono 1 e −1.

1

1

Matrici a blocchi

Concludo questa lezione accennandovi a un “modo di scrivere” le matrici che a volte

è utile quando si considerano matrici “molto grandi” (e questo in futuro vi capiterà!

Infatti è molto raro che in una “vera” applicazione si abbia a che fare con solo due o

tre incognite). In questo caso può essere comodo scrivere la matrice “usando” delle sue

sottomatrici.

Usando delle righe orizzontali o verticali possiamo suddividere una matrice A in

varie sottomatrici (blocchi)

3

4 5 1

−2 −1 3 0

2

8 1 0

1

0 3 0

0

1

0

0

0

0

1

0

In questo caso diremo che A è una matrice a blocchi. È evidente che ci sono

diversi modi di dividere a blocchi una matrice, per esempio la matrice appena vista

può essere divisa anche come segue

Lezione 12

126

3

4 5 1

−2 −1 3 0

2

8 1 0

1

0 3 0

0

1

0

0

0

0

1

0

La prima volta l’abbiamo divisa in quattro blocchi, la seconda in due e ovviamente ci

sono tanti altri modi di dividerla in blocchi. L’utilità di questa procedura sta nel fatto

che possiamo scrivere più velocemente una matrice “grande” specificandone i singoli

blocchi (che magari hanno caratteristiche particolari) e poi che possiamo fare anche le

operazioni sui singoli blocchi, come fossero veri e proprio elementi della matrice.

Per essere più esplicita. Se scrivo la matrice

B =

A

I2

dove la matrice A è quella dell’esempio precedente e I2 è identità di ordine 2, intendo

la matrice

3 −2 1 0

B=

.

−4 6 0 1

Se ora per esempio voglio fare delle “operazioni” su B, posso farle sui singoli blocchi

di B. Quindi

2B =

2A

A B =

I2

2I2

oppure

−1

A

−1

sono stata un po’ sbrigativa, ma fate la verifica e vedrete che torna.

E qui....chiudo.