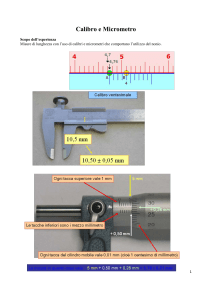

LE MISURE

CONCETTI PRELIMINARI: MISURA, ATTENDIBILITÀ, PRECISIONE, ACCURATEZZA

Il modo corretto di fornire il risultato di una qualunque misura è quello di dare la migliore stima della quantità in questione

(x) e l’intervallo all’interno del quale si è confidenti che la misura si trovi (δx): infatti non sarà mai possibile misurare con

assoluta certezza una qualsiasi grandezza che quindi assume un valore vero (X), sempre ignoto.

ATTENDIBILITÀ

La differenza tra la misura generica misura (chiamata in questo caso xi) ed il valore vero della grandezza prende il nome

di attendibilità della misura:

attendibilità = xi - X

L’attendibilità viene anche indicata come l’errore totale che inevitabilmente si commette in un’operazione di misura.

1

ERRORI SISTEMATICI ED ERRORI CASUALI

Gli errori di misura possono essere classificati in:

- errori sistematici

- errori casuali

Gli errori sistematici si manifestano nella tendenza deterministica di uno strumento a sovrastimare (ovvero sottostimare) il

valore vero della grandezza in esame. Quindi, anche se si eseguono un certo numero di misure della grandezza in

esame, si ottiene un valore medio delle misure che sarà diverso dal valore vero della grandezza. Chiamando valore

medio di N misure (x1, x2, …xN) la seguente quantità, indicata con x ,:

N

∑

xi

x1 + x 2 + ... + x N

i =1

=

x=

N

N

si definisce errore sistematico la differenza tra il valore medio delle N misure realizzate ed il valore vero della grandezza;

l’errore sistematico è anche definito come accuratezza:

accuratezza = x − X

Misure ripetute, in condizioni simili (per quanto possibile), portano a valori xi diversi in quanto non si riesce mai a ripetere

le misurazioni in modo identico. Quindi, se si eseguono un certo numero di misure della grandezza in esame, si ottengono

una serie di valori (x1, x2, …xN) che si discostano dal valore x di una certa entità imputabile all’errore casuale. Si

definisce quindi errore casuale la differenza tra il valore della singola misura ed il valore medio delle N misure realizzate;

l’errore casuale è anche definito come precisione:

precisione = xi − x

L’errore totale di una generica misura, xi, può quindi essere espresso come somma di una componente casuale ed una

componente sistematica:

2

xi – X =

attendibilità

errore totale

x

X

xi − x

+ x−X

= precisione

+

= errore casuale +

x

X

x

X

accuratezza

errore sistematico

x

X

3

ANALISI STATISTICA DEGLI ERRORI CASUALI

LA MEDIA E LA DEVIAZIONE STANDARD

N

media =

xbest

∑

xi

x1 + x 2 + ... + x N

i =1

=x =

=

N

N

Ogni singola misura si discosta poi dal valor medio di una quantità che definiamo deviazione e che esprimiamo come:

deviazione =

di = xi − x

La deviazione è dunque una valutazione di quanto la misura i-esima si discosta dalla media.

Si definisce deviazione standard, σx, la seguente quantità:

1 N

2

⋅ ( di )

N i =1

∑

σx =

ovvero la deviazione quadratica media delle N misure effettuate. σx caratterizza l’incertezza media delle N misure

effettuate.

La deviazione standard viene anche talvolta definita come:

σx =

N

1

2

⋅ ( di )

N − 1 i =1

∑

4

LA DISTRIBUZIONE NORMALE E LE SUE PROPRIETÀ

Una distribuzione limite, che può essere praticamente rappresentata da un curva continua, come la curva in rosso,

definisce una funzione f ( x ) ; la frazione di misure che cadono in un qualunque piccolo intervallo compreso tra x e x + dx

sarà pari all’area f ( x ) ⋅ dx .

5

Più in generale il numero di misure che cadono tra due qualsivoglia valori a e b è l’area totale sotto il grafico tra

x =b:

x =a

e

b

frazioni di misure che cadono tra

x =a

e

x =b

=

∫ f ( x ) ⋅ dx

a

In altri termini, f ( x ) ⋅ dx rappresenta la probabilità che una misura di

x

dia un risultato compreso tra

x

e

x + dx

Se pertanto si conosce la distribuzione limite f ( x ) per la misura di una data grandezza

strumentazione, allora si conosce la probabilità di ottenere un risultato in una qualsiasi intervallo

Dal momento che la probabilità di ottenere un risultato in un qualunque punto tra

distribuzione limite deve soddisfare:

−∞

e

+∞

x

con un data

a ≤ x ≤b.

deve essere pari ad uno, la

+∞

∫ f ( x ) ⋅ dx = 1

−∞

Tale relazione è perfettamente equivalente alla condizione di normalizzazione precedentemente introdotta

∑F

k

=1 ;

una

k

funzione che soddisfi tale relazione viene detta normalizzata.

6

+∞

media:

x=

∫ x ⋅ f ( x ) ⋅ dx

−∞

+∞

deviazione standard: σ

2

x

=

∫ (x − x )

2

⋅ f ( x ) ⋅ dx

−∞

rappresenta lo scostamento medio delle innumerevole misure effettuate rispetto alla media

x

.

distribuzione normale o funzione di Gauss.

fX ,σ ( x ) =

1

σ ⋅ 2π

2

− x −X

⋅e ( )

2σ 2

in cui i pedici X e σ indicano il centro e la larghezza della distribuzione. Tale funzione descrive pertanto la distribuzione

dei risultati in una misura di una generica grandezza x, caratterizzata soltanto da errori casuali ed il cui valore vero è X.

Tutte le misure, la cui distribuzione limite è data dalla funzione di Gauss, sono distribuite normalmente.

7

Intervallo di confidenza

X +t ⋅σ

∫

fX ,σ ( x ) ⋅ dx

X −t ⋅σ

fornisce la probabilità di trovare un risultato della misura entro

t ⋅σ

di X (Fig.13)

Tale integrale è chiamato funzione degli errori o integrale normale degli errori. Non può essere risolto analiticamente, ma

può essere calcolato numericamente ottenendo la curva che segue.

Se assumiamo la deviazione standard σ x come incertezza in una misura:

x = x ± δ x = x ± σx

allora il valore vero della grandezza misurata ricade entro l’intervallo individuato con una probabilità del 68% circa.

Analogamente se si assume:

x = x ± 2 ⋅σx

allora il valore vero della grandezza misurata ricade entro l’intervallo individuato con una probabilità di oltre il 95%.

8

9

LA PROPAGAZIONE DEGLI ERRORI

Il problema della propagazione degli errori sorge quando si misurano più grandezze ( x , ..., z ) , tutte con incertezze

(δ x , ..., δ z ) e poi si utilizzano i valori misurati per calcolare una qualsiasi grandezza q ( x , ..., z ) . A partire da tali informazioni

è necessario valutare l’incertezza nel risultato, δ q .

Incertezza max assoluta

Quando le incertezze non sono indipendenti tra di loro, si può procedere alla valutazione dell’errore cosiddetto massimo.,

che per somme e differenze si esprime come:

δ q = δ x + ... + δ z

mentre per prodotti e quozienti come:

δq

q

=

δx

x

+ ... +

δz

z

Quando si somma o si sottrae un qualsiasi numero di grandezze, allora l’errore nel valore calcolato q è la somma degli

errori delle singole grandezze.

10

Incertezza nelle somme e nelle differenze

Se le grandezze x, z, u, …, w sono misurate con incertezze δx, …,δw, ed i valori

misurati sono utilizzati per calcolare:

q=x+…+z-(u+…+w)

allora l’errore nel valore calcolato di q è la somma

δq=δx+…+δz+δu+…+δw

di tutti gli errori originali.

Incertezza nei prodotti e nei quozienti

Se le grandezze x, z, u, …, w sono misurate con piccoli errori δx, δz, δu …, δw, ed i

valori misurati sono utilizzati per calcolare:

q=(x*…*z)/(u*…*w)

allora l’errore relativo nel valore calcolato di q è la somma:

δq/q=δx/x+…+δz/z+δu/u+…+δw/w

di tutti gli errori relativi originali.

Prodotto di una grandezza misurata per un numero esatto

Se la grandezza x è misurata con un errore δx ed è utilizzata per calcolare il prodotto:

q=B*x

dove B non ha errore, allora l’errore in q è B volte quello in x:

δq=⎢B⎢*δx

Incertezza in una potenza

Se la grandezza x è misurata con un errore δx ed è utilizzata per calcolare la potenza

potenza:

q=xn

allora l’errore relativo in q è n volte quello in x:

δq/q=n*(δx/x)

11

LA PROPAGAZIONE DEGLI ERRORI

CON MISURE DISTRIBUITE NORMALMENTE

Le incertezze calcolate in base alle regole sopra indicate possono essere più grandi del necessario. Se, infatti, gli errori

sono indipendenti e casuali è abbastanza improbabile che, ad esempio in una somma, la massima sovrastima di x sia

accompagnata da una massima sovrastima di y.

INCERTEZZA MAX PROBABILE (95%)

Avendo a che fare con tutte misure distribuite normalmente, il valore calcolato sarà ancora distribuito normalmente e la

sua deviazione standard è calcolabile in base alle regole precedentemente esposte. Se l’intervallo di confidenza richiesta

è il 95%, la deviazione standard deve essere moltiplicata per un fattore di copertura pari a 2 e si giunge quindi all’errore

sulla grandezza calcolata.

Se le grandezze misurate sono soggette soltanto ad errori casuali, allora saranno distribuite normalmente con parametri

di larghezza (σ x , ..., σ z ) che sono correlate alle incertezze associate ad ogni singola misura delle grandezze

corrispondenti.

Un ulteriore esempio di propagazione degli errori è rappresentato dalla somma di due grandezze indipendenti

sono distribuite normalmente attorno ai loro valori X e Y con larghezze σ x e σ y . Si dimostra che i valori di

x

e

y

che

q=x+y

sono normalmente distribuiti; si dimostra altresì che il valore vero di

q

è pari a :

q = X +Y

e la larghezza di distribuzione dei valori

q

è pari a:

σ q = σ x2 + σ y2

ovvero, come già ricavato nella trattazione precedente, se x e y sono soggetti soltanto ad incertezze indipendenti casuali,

allora l’incertezza in q = x + y è la somma quadratica delle incertezze separate x e y .

12

Incertezza nelle somme e nelle differenze

Supponiamo che le grandezze x, z, u, …, w sono misurate con incertezze δx, δz, δu

…,δw, ed i valori misurati sono utilizzati per calcolare:

q=x+…+z-(u+…+w)

Se gli errori nelle grandezze di partenza sono indipendenti e causali allora l’errore in q è

la somma in quadratura delle singole incertezze:

δq =

(δ x )

2

+ ... + (δ z ) + (δ u ) + ... + (δ w )

2

2

2

In ogni caso δq non sarà mai più grande della loro somma:

δq≤δx+…+δz+δu+…+δw

Incertezza nei prodotti e nei quozienti

Supponiamo che le grandezze x, z, u, …, w sono misurate con incertezze δx, δz, δu

…,δw, ed i valori misurati sono utilizzati per calcolare:

q=x*…*z/(u*…*w)

Se gli errori nelle grandezze di partenza sono indipendenti e causali allora l’errore

relativo in q è la somma in quadratura dei singoli errori relativi originali:

2

2

2

⎛δx ⎞

⎛ δ z ⎞ ⎛ δu ⎞

⎛ δw ⎞

= ⎜

⎟⎟ + ... + ⎜⎜ ⎟⎟ + ⎜⎜

⎟⎟ + ... + ⎜⎜

⎟⎟

⎜

q

⎝ x ⎠

⎝ z ⎠ ⎝ u ⎠

⎝ w ⎠

δq

2

In ogni caso δq/q non sarà mai più grande della loro somma:

⎛δx ⎞

⎛ δ z ⎞ ⎛ δu ⎞

⎛ δw ⎞

≤⎜

+ ... + ⎜ ⎟ + ⎜

+ ... + ⎜

⎟

⎟

⎜ z ⎟ ⎜ u ⎟

⎜ w ⎟⎟

q ⎜⎝ x ⎟⎠

⎝ ⎠ ⎝

⎠

⎝

⎠

δq

13

Incertezza in una qualunque funzione di una variabile

Supponiamo che la grandezza x sia misurata con un’incertezza δx, ed il suo valore

misurato venga utilizzato per calcolare una generica funzione:

q(x)

Allora l’errore in q si esprime come:

δq =

dq

⋅δ x

dx

A questo punto, un qualsiasi problema di propagazione degli errori si può risolvere per passi successivi, combinando gli

errori di singole operazioni separate.

14

Si può concludere fornendo una regola generale dalla quale tutte le altre possono essere derivate e grazie alla quale un

qualunque problema di propagazione degli errori può essere risolto. Tale procedimento si dimostra particolarmente utile

quando la funzione in oggetto involve una stessa variabile più volte. In questi casi, infatti, alcuni errori possono cancellarsi

tra loro, mentre un calcolo dell’errore passo-passo potrebbe condurci ad un errore finale sovrastimato. La regola generale

può essere così espressa:

Incertezza in una funzione di più variabili

Supponiamo che le grandezze x,… ,z sono misurate con incertezze δx,… δz, ed i valori

misurati sono utilizzati per calcolare:

q=q(x, …z)

Se gli errori nelle grandezze di partenza sono indipendenti e causali allora l’errore in q

può essere espresso come:

⎛ ∂q

⎞

2

⎛ ∂q

⎞

2

δ q = ⎜ ⋅ δ x ⎟ + ... + ⎜ ⋅ δ z ⎟

⎝ ∂x

⎠

⎝ ∂z

⎠

In ogni caso δq non sarà mai più grande di:

δq ≤

∂q

∂q

⋅ δ x + ... +

⋅δz

∂x

∂z

Da tale regola generale, possono essere ricavate come regole particolari tutte quelle introdotte precedentemente.

15