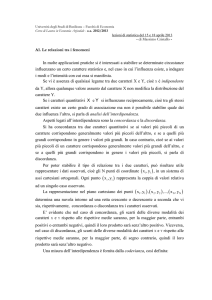

UNIVERSITA’ DEGLI STUDI DI BASILICATA

FACOLTA’ DI ECONOMIA

Corso di laurea in Economia Aziendale

anno accademico 2012/2013

Lezioni di Statistica

del 15 e 18 aprile 2013

Docente: Massimo Cristallo

LA RELAZIONE TRA FENOMENI

In molte applicazioni pratiche si è interessati a stabilire se determinate

circostanze influenzano un certo carattere statistico e, nel caso in cui

l’influenza esista, indagare i modi e l’intensità con cui essa si manifesti.

Se vi è assenza di qualsiasi legame tra due caratteri X e Y, cioè X è

indipendente da X, allora qualunque valore di X non modifica la

distribuzione di Y.

ESEMPIO (dipendenza tra due caratteri)

A) Relazione del carattere “reddito” con la “spesa per consumi”.

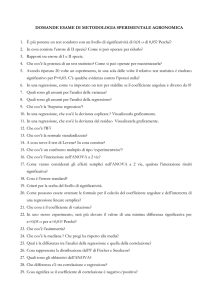

ANALISI DELLA REGRESSIONE

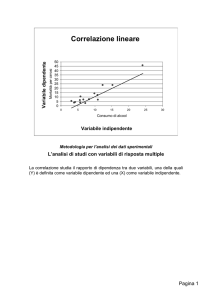

Fase 1- Diagramma di dispersione

• Una relazione fra due caratteri quantitativi si rappresenta ponendo

la variabile indipendente sull' asse delle ascisse (simbolizzato da

una x) e la variabile dipendente sull'asse delle ordinate

(simbolizzata da una y) di un diagramma a dispersione.

• In corrispondenza di ogni intensità xi , con i = 1, 2, …, N, si

dispone delle manifestazioni di una certa circostanza concomitante.

• Ogni punto (xi, yi) rappresenta la coppia di valori relativa ad un

singolo caso osservato.

.

ANALISI DELLA REGRESSIONE

Fase 2 – Scelta del tipo di funzione

- La rappresentazione grafica dei dati osservati potrà orientarci sulla

scelta del tipo di funzione da utilizzare nei casi concreti, salvo che

disponiamo di una conoscenza specifica riguardo alla relazione che

lega i due caratteri quantitativi in esame.

- Per questioni di semplicità, ci limiteremo al caso di una funzione

lineare (cioè ad una retta, poiché si dispone di due caratteri

quantitativi x e y).

ANALISI DELLA REGRESSIONE

Fase 3 – Stima dei parametri della retta

yˆ = α + β ⋅ x

ove si dimostra (con il metodo dei minimi quadrati) che :

n

β=

∑ xi yi − N x y

i =1

N ⋅ Var ( x )

α = y −β⋅ x

è il coefficiente di regressione di y da x

è l'intercetta della retta

in cui x e y sono, rispettivamente, la media dei caratteri x e y.

ANALISI DELLA REGRESSIONE

Fase 4 – Verifica della bontà di adattamento del modello

Esistono una serie di indici che permettono di stabilire se il modello

stimato presenta, o meno, un buon adattamento ai dati osservati.

L’indice più usato al riguardo è l’indice di determinazione:

R2 =

N

∑ ( yˆi − y )

2

i =1

N

∑ ( yi − y )

2

i =1

che varia tra 0 (caso di indipendenza) e 1 (caso di perfetto legame

funzionale tra i due caratteri).

Se il modello è buono, può essere utilizzato per fare previsioni sul fenomeno

oggetto di indagine.

ANALISI DELL’INTERDIPENDENZA

In molte situazioni in cui vengono rilevati due caratteri quantitativi x e y

non è possibile stabilire quale dei due caratteri sia quello antecedente,

pur essendoci tra gli stessi un certo grado di associazione.

Si parla in questi casi di analisi dell’interdipendenza.

Anche in tale analisi, per poter stabilire il tipo di relazione tra i due

caratteri, può risultare utile rappresentare i dati osservati, cioè gli N punti

di coordinate (xi, yi), su un sistema di assi cartesiani ortogonali.

ASPETTI DELL’INTERDIPENDENZA

• Aspetti dell’interdipendenza sono la concordanza e la discordanza.

• Si ha concordanza tra due caratteri quantitativi se ai valori più

piccoli di un carattere corrispondono generalmente valori più

piccoli dell’altro, e se a quelli più grandi corrispondono in genere i

valori più grandi.

• In caso contrario, cioè se ai valori più piccoli di un carattere

corrispondono generalmente valori più grandi dell’altro, e se a

quelli più grandi corrispondono in genere i valori più piccoli,

parleremo di discordanza.

.

UNA MISURA ASSOLUTA DELL’INTERDIPENDENZA - La Codevianza

E’ evidente che nel caso di concordanza, gli scarti delle diverse modalità dei

caratteri x e y rispetto alle rispettive medie saranno, per la maggior parte,

entrambi positivi o entrambi negativi, quindi il loro prodotto sarà senz’altro

positivo. Viceversa, nel caso di discordanza, gli scarti delle diverse modalità

dei caratteri x e y rispetto alle rispettive medie saranno, per la maggior parte,

di segno contrario, quindi il loro prodotto sarà senz’altro negativo.

Una misura dell’interdipendenza si ottiene, allora, nel modo seguente:

Codev (x, y) = ∑ ( x i − x )( yi − y ) = ∑ x i yi − N x y

N

N

i =1

i =1

che, ovviamente, assume valori positivi o negativi, a sec onda

che vi sia, rispettivamente, concordanza o discordanza.

UNA MISURA DELL’INTERDIPENDENZA - La Covarianza

Un indicatore più utile è la covarianza, ottenuta rapportando la codevianza

al numero delle unità rilevate, in modo da eliminare l’influenza della

numerosità delle osservazioni. Per le cose dette si ottiene, allora, la seguente

formula:

N

N

∑ ( x i − x )( yi − y ) ∑ x i yi

i =1

i =1

Cov (x, y) =

=

−x y

N

N

che assume valori positivi o negativi a sec onda

che vi sia, rispettivamente, concordanza o discordanza.

N.B.

Si noti la similitudine della formula della covarianza con quella

della varianza.Infatti,se i caratteri x e y sono coincidenti

si ottiene esattamente la formula della varianza.

UNA MISURA RELATIVA DELL’INTERDIPENDENZA - Il coefficiente di

correlazione di Bravais - Pearson

La covarianza misura l’associazione lineare tra due caratteri quantitativi.

Tale misura, però, ha il difetto di essere influenzata dal grado di variabilità

dei caratteri esaminati. Per avere un indicatore dell’associazione lineare tra

due variabili x e y, che risulti indipendente dalla loro variabilità, si ricorre al

coefficiente di correlazione r di Bravais – Pearson:

Cov ( x, y )

=

r=

Var ( x) Var ( y )

Codev ( x, y )

Dev ( x) Dev ( y )

ove il denominatore rappresenta il massimo valore

che può assumere il numeratore, e quindi r può

assumere valori compresi tra -1 (massima discordanza)

e +1 (massima concordanza).

Interpretazione del coefficiente di correlazione di Bravais - Pearson

L’interpretazione del coefficiente di correlazione è in alcuni casi complicata

dalla circostanza che altri fattori variabili influiscono più o meno fortemente

quelli presi in considerazione.

In questi casi la correlazione tra x e y è per la maggior parte dovuta a quella

esistente tra ciascuna variabile e una o più altre variabili.

Esempio

La correlazione positiva tra la produzione nel tempo di alcune coppie di

prodotti agricoli, come ad esempio il grano e il vino, potrebbe essere dovuta

all’influenza esercitata dalle condizioni meterologiche su entrambi i prodotti

considerati.