Statistica Industriale Lez. 9

La regressione logistica

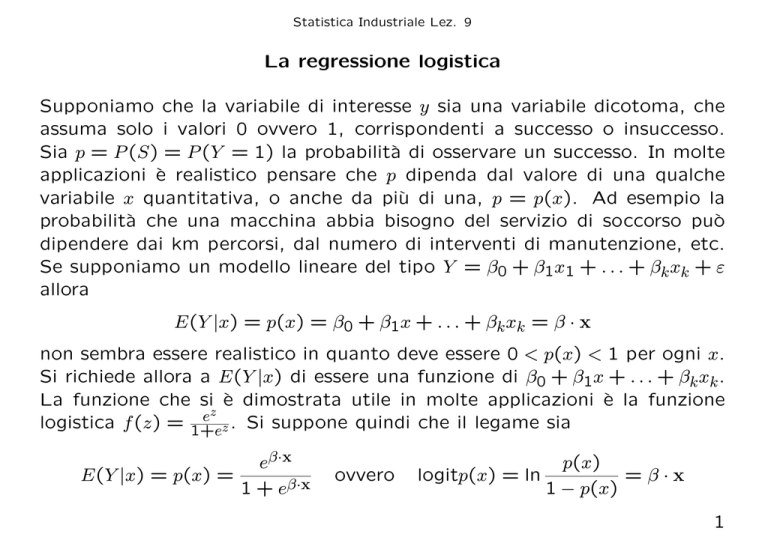

Supponiamo che la variabile di interesse y sia una variabile dicotoma, che

assuma solo i valori 0 ovvero 1, corrispondenti a successo o insuccesso.

Sia p = P (S) = P (Y = 1) la probabilità di osservare un successo. In molte

applicazioni è realistico pensare che p dipenda dal valore di una qualche

variabile x quantitativa, o anche da più di una, p = p(x). Ad esempio la

probabilità che una macchina abbia bisogno del servizio di soccorso può

dipendere dai km percorsi, dal numero di interventi di manutenzione, etc.

Se supponiamo un modello lineare del tipo Y = β0 + β1x1 + . . . + βk xk + ε

allora

E(Y |x) = p(x) = β0 + β1x + . . . + βk xk = β · x

non sembra essere realistico in quanto deve essere 0 < p(x) < 1 per ogni x.

Si richiede allora a E(Y |x) di essere una funzione di β0 + β1x + . . . + βk xk .

La funzione che si è dimostrata utile in molte applicazioni è la funzione

ez . Si suppone quindi che il legame sia

logistica f (z) = 1+e

z

eβ·x

E(Y |x) = p(x) =

1 + eβ·x

ovvero

logitp(x) = ln

p(x)

=β·x

1 − p(x)

1

0.8

0.6

0.4

p(x)

0.6

0.4

β1 > 0

0.0

0.0

0.2

β1 < 0

0.2

p(x)

0.8

1.0

1.0

Statistica Industriale Lez. 9

0

2

4

6

x

8

10

0

2

4

6

8

10

x

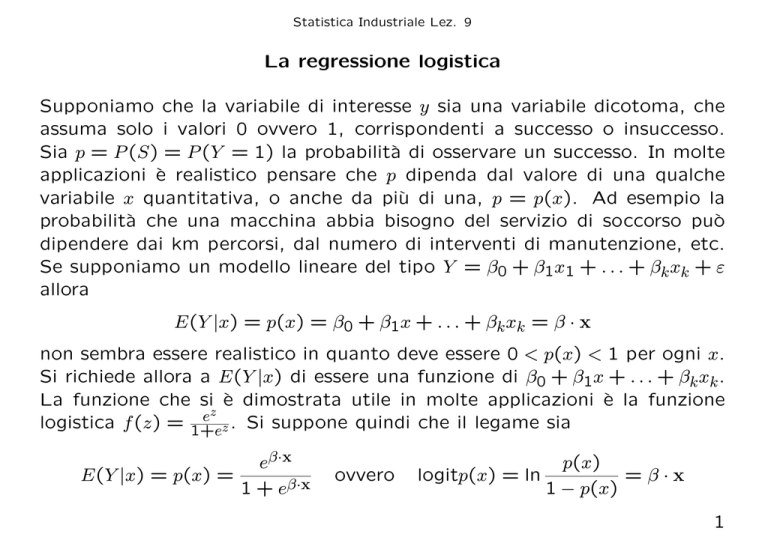

I grafici rappresentano la funzione p(x) per particolari valori di β0 e β1. In

particolare per β1 < 0 la probabilità di successo decresce al crescere di x,

mentre per β1 > 0 la probabilità del successo cresce al crescere di x.

p(x)

La funzione 1−p(x)

è detto ODDS RATIO e rappresenta quante volte il

successo è più plausibile dell’insuccesso.

2

Statistica Industriale Lez. 9

La regressione logistica è una caso particolare di Modello lineare generalizzato (glm). In questi modelli è una trasformazione (tramite la link

function) di E(Y ) che segue un modello lineare. Nel modello logit la link

function è la funzione logit. Abbiamo infatti

p

E(Y ) = p ln

=β·x

1−p

La stima dei parametri avviene, una volta costruita la funzione di verosimiglianza per le osservazioni Yi, con metodi iterativi in quanto non si riesce

a dare una forma esplicita al massimo della logverosimiglianza. Il metodo

usato è l’IWLS (iterative weighted least squares). Si noti che nella regressione logistica si ipotizza che Y è distribuita come una Binomiale con

parametri n = 1 e p incognita.

Si può dimostrare che asintoticamente i parametri si distribuiscono normalmente per cui si possono effettuare i test di significatività sui parametri, e

quando ci sono più parametri i test sull’opportunità di includerli nel modello.

3

Statistica Industriale Lez. 9

Esempio: Si considerino i dati relativi alla temperatura di lancio e all’incidenza dei fallimenti per gli O rings in 24 lanci dello Space Shuttle prima

del disastro del Challenger nel gennaio 1986.

1

2

3

4

5

6

7

8

Temp

53

56

57

63

66

67

67

67

Failure

Y

Y

Y

N

N

N

N

N

9

10

11

12

13

14

15

16

Temp

68

69

70

70

70

70

72

73

Failure

N

N

N

Y

Y

Y

N

N

17

18

19

20

21

22

23

24

Temp

75

75

76

76

78

79

80

81

Failure

N

Y

N

N

N

N

N

N

In questo caso abbiamo solo una variabile esplicativa, Temp. Ipotizziamo

un modello logistico per l’incidenza dei successi (No Failure= successo).

p(x)

ln

= β0 + β1 x

1 − p(x)

p(x) è la probabilità di successo, ovvero di Failure=No, quando osserviamo

T emp = x.

4

Statistica Industriale Lez. 9

I valori dei parametri stimati sono riportati nella seguente tabella

(Intercept)

Temp

Estimate

−10.8753

0.1713

Std. Error

5.7029

0.0834

z value

−1.91

2.05

Pr(>|z|)

0.0565

0.0400

La curva stimata per p(x) è data da

1.0

La funzione p(x) stimata

● ●

● ●

●

●

0.8

●

●

●

●

●

0.6

●

p(x)

●

0.4

●

●

0.2

●

●

50

55

60

65

70

75

80

85

x

Siamo in grado anche di stimare l’odds ratio per x = 31 (Temp per il

Challenger esploso) che vale 0.0038172 cioè la probabilità di un successo

(N) è 0.004 volte quella di un insuccesso (Y).

5

Statistica Industriale Lez. 9

Regressione non lineare

A volte, per motivi teorici o esaminando i risultati della diagnostica basata

sull’analisi dei residui, il modello lineare semplice o multiplo può risultare

non adatto a spiegare la variabilità della variabile y. Si ricorre allora a

modelli alternativi.

Consideriamo una vasta gamma di modelli che non sono lineari nei parametri o nella variabili esplicative. Supponiamo che il legame tra le variabili

y e x sia del tipo y = f (x) ma a causa di un errore non osserviamo y ma il

valore di una v.c.

Y = f (x) + ε

In generale f è una funzione che dipende da un certo numero di parametri

(θ) e da un certo numero di variabili esplicative x. Il termine di errore ε

si suppone normalmente distribuito. Se la forma della funzione f è nota a

meno di un numero finito di parametri si parla di regressione parametrica.

Se la f è totalmente incognita si parla di regressione non parametrica.

6

Statistica Industriale Lez. 9

Se il modello è del tipo

Y = f (x, θ) + ε,

θ = (θ1, . . . , θp),

E(ε) = 0,

V ar(ε) = σ 2

supponiamo di avere n osservazioni indipendenti (xi, yi) che soddisfano

yi = f (xi, θ) + εi,

θ = (θ1, . . . , θp),

εi i.i.d,

E(εi) = 0,

V ar(εi) = σ 2

Introducendo la notazione matriciale

y = (y1, . . . , yn)0,

f (x, θ) = (f (x1, θ), . . . , f (xn, θ))0,

= (ε1, . . . , εn)0

la stima ai minimi quadrati è data da

θ̂ = argminθ SSE, dove SSE = |y

− f (x, θ)|2 =

n

X

(yi − f (xi, θ))2

i=1

La procedura che ci da la stima θ̂ si chiama NLS (non linear least squares)

e differisce da quella OLS in quanto:

a) non c’è una formula esplicita per la stima θ̂

b) per trovare θ̂ si usano procedure iterative

c) occorre fornire dei valori iniziali ai parametri

7

Statistica Industriale Lez. 9

La procedura iterativa

Seppure esistano numerose tecniche per trovare θ̂ = argminθ SSE, molte seguono questo schema. Sia θ(0) un valore iniziale del parametro θ.

Possiamo scrivere

f (x, θ) = f (x, θ(0)) +

p

X

(0) ∂

(θj − θj )

f (x, θ) θ=θ(0)

∂θj

j=1

Questo definisce un piano tangente alla superficie definita da f nel punto

θ(0).

Posto

∂

(0)

f (xk , θ) θ=θ(0)

Fkj (xk , θ ) =

∂θj

p

X

(0)

(0)

(0)

wk = f (xk , θ ) −

θj Fkj (xk , θ(0))

j=1

possiamo riscrivere

f (x, θ) = w(0) + F (x, θ(0)) · θ,

(0)

(0)

dove w(0) = (w1 , . . . , wn )0 e F (x, θ(0)) è la matrice di componenti Fkj (xk , θ(0)),

k = 1, . . . , n, j = 1, . . . , p.

8

Statistica Industriale Lez. 9

Il processo iterativo consiste nel regredire f sul piano tangente con intercetta w(0). Il modello approssimato diviene, posto F (x, θ) = F (θ)

y = w(0) + F (θ(0)) · θ

e la stima ai minimi quadrati ci da l’approssimazione successiva

−1

(1)

(0)

T

(0)

θ

= F (θ ) F (θ )

F (θ(0))T (y − w(0))

Il processo continua fino a convergenza, cioè fino a quando la differenza

tra due valori successivi di θ(k) non è più piccolo di un valore prefissato.

La stima θ̂ ottenuta è una approssimazione della stima θ̂ NLS.

Si noti che nel modello lineare w(0) = 0, F (θ(0)) = X e il processo converge

in un passo.

9

Statistica Industriale Lez. 9

Inferenza per θ̂

Sotto opportune ipotesi (legate alla derivabilità) sulla funzione f si ha che

asintoticamente (quando il numero delle osservazioni n → ∞)

θ̂ ∼ N (θ, σ 2(F (θ)0F (θ))−1).

La stima della varianza asintotica di θ̂ si ottiene sostituendo F (θ) con una

sua stima F̂ = F (θ̂) e come stima di σ 2 la quantità s2 = SSE

n−p . La stima della

matrice di varianza e covarianza di θ̂ risulta quindi s2(F̂ 0F̂ )−1. In analogia

a quanto fatto nel caso dell’analisi di regressione multivariata, indichiamo

con C = (F̂ 0F̂ )−1. L’intervallo di confidenza (asintotico) a livello di fiducia

1 − α per il parametro θi è dato da

q

q

θ̂i − t1−α/2 s2cii; θ̂i + t1−α/2 s2cii ,

dove cii sono gli elementi sulla diagonale principale della matrice C.

La verifica di ipotesi per la significatività dei parametri θ si basa sulla

statistica che asintoticamente si distribuisce come una tn−p.

θ̂i − θi0

t= q

s2cii

10

Statistica Industriale Lez. 9

Modelli intrinsecamente lineari

Una funzione y = f (x) è detta intrinsecamente lineare se attraverso una

trasformazione di x, di y o di entrambe le variabili la funzione può essere

espressa come y 0 = β0 + β1x0, y 0 = g(y), x0 = h(x).

Le più utilizzate funzioni di questo tipo sono descritte nella tabella seguente

dove si riportano anche le trasformazioni da applicare per rendere il legame

lineare

Funzione

y = αeβx

y = αxβ

y = α + β log x

y = α + β1

x

Trasf. variabile x

–

x0 = log x

x0 = log x

x0 = 1

x

Trasf. variabile y

y 0 = ln y

y 0 = ln y

–

–

Forma Lineare

y 0 = ln(α) + βx

y 0 = ln(α) + βx0

y = α + βx0

y = α + βx0

Un modello probabilistico che lega il valore di una v.c. Y a x è detto

intrinsecamente lineare se attraverso una trasformazione di x o di Y o di

entrambe le variabili la funzione può essere espressa come

Y 0 = β0 + β1x0 + ε0

11

1

2

3

4

5

xβ

0

0

1

2

4

5

0

1

2

x

3

4

5

0

1

2

x

4

6

4

5

y=α

2

5

β<0

y=α

0

−4

2

2

0

α + β1 x

6

−2

3

1

β<0

4

α + β1 x

4

βlog(x)

5

8

4

2

4

x

3

β<0

0

βlog(x)

β>0

3

10

x

3

0<β<1

0.0

5

0.5

β>1

1.0

1.5

20

xβ

15

0.6

0.2

0.0

0

0

β<0

10

β>0

50

β<0

0.4

e(βx)

e(βx)

100

0.8

2.0

25

1.0

150

Statistica Industriale Lez. 9

0

1

2

3

x

4

5

0

1

2

3

x

4

5

0

1

2

3

x

4

5

0

1

2

3

x

12

Statistica Industriale Lez. 9

I modelli probabilistici che corrispondono alle quattro funzioni della tabella

precedente sono

Il modello esponenziale moltiplicativo: Y = αeβx · ε

Con la trasformazione Y 0 = ln Y otteniamo il modello Y 0 = β0 +β1x0 +ε0 con

x0 = x, β0 = ln α β1 = β e ε0 = ln ε. Se ε ha una distribuzione Lognormale

2

2

2

con E(ε) = eσ /2 e V ar(ε) = eσ (eσ − 1) allora ε0 è N (0, σ 2).

Il modello con potenza moltiplicativo: Y = αxβ · ε

Otteniamo il modello Y 0 = β0 + β1x0 + ε0 con Y 0 = ln Y , x0 = ln x, β0 = ln α

2

β1 = β e ε0 = ln ε. Se ε ha una distribuzione Lognormale con E(ε) = eσ /2

2

2

e V ar(ε) = eσ (eσ − 1) allora ε0 è N (0, σ 2).

13

Statistica Industriale Lez. 9

Il modello logaritmico additivo: Y = α + β log x + ε

Otteniamo il modello Y 0 = β0 + β1x0 + ε0 con Y 0 = Y , x0 = log x, β0 = α

β1 = β e ε0 = ε. In questo caso ε = ε0 è N (0, σ 2).

Il modello reciproco additivo: Y = α + β 1

x +ε

Otteniamo il modello Y 0 = β0 + β1x0 + ε0 con Y 0 = Y , x0 = 1

x , β0 = α β 1 = β

e ε0 = ε. In questo caso ε = ε0 è N (0, σ 2).

Si noti che il modello esponenziale additivo Y = αeβx + ε e il modello con

potenza additivo Y = αxβ + ε non sono intrinsecamente lineari.

I parametri dei modelli trasformati si possono direttamente stimare utilizzando OLS per i dati trasformati y 0 e x0. Dalle stime di di β̂0 e β̂1 si può

eventualmente risalire ai parametri dei modelli di partenza trasformandoli

opportunamente.

Queste stime in generale non coincidono con quelle ottenute direttamente

con NLS sui dati non trasformati.

14

Statistica Industriale Lez. 9

Esempio: I seguenti dati sono tratti dall’articolo Thermal Endurance of

Polyester Enameled Wires Using Twisted Wire Specimens, IEEE Trans.

Insulation, 1965, 38–44, dove in un test per verificare la resistenza termica

si vuole capire il legame tra la temperatura e il tempo di vita del filo di

poliestere smaltato.

Temp

Lifetime

1

200

5933

Temp

Lifetime

2

200

5404

10

220

768

3

200

4947

11

220

609

12

220

777

4

200

4963

13

240

258

5

200

3358

14

240

299

6

200

3878

15

240

209

7

220

1561

16

240

144

8

220

1494

17

240

180

9

220

747

18

240

184

I seguenti grafici riportano i dati con varie trasformazioni sia per la variabile

x che per la variabile y.

15

●

●

6000

Lifetime

●

●

4000

4000

●

●

●

●

●

●

●

2000

6000

●

2000

Lifetime

Statistica Industriale Lez. 9

●

●

●

●

●

●

200

210

220

230

0

0

●

●

240

●

●

0.0042

0.0044

●

●

●

●

●

220

Temp

230

240

7

●

●

6

6

●

●

●

●

5

log(Lifetime)

7

●

●

210

0.0050

●

●

●

●

●

8

●

●

●

●

●

200

0.0048

1/Temp

5

log(Lifetime)

8

Temp

0.0046

●

●

●

●

●

0.0042

0.0044

0.0046

0.0048

0.0050

1/Temp

16

Statistica Industriale Lez. 9

Se applichiamo il modello lineare semplice Y = β0 + β1x + ε otteniamo la

retta riportata in figura

3000

●

●

●

●

●

2000

Lifetime

4000

5000

6000

Modello 1

1000

●

●

●

●

−1000

0

●

●

●

●

200

210

220

230

240

Temp

Le stime dei parametri sono β0 = 26925.64 e β1 = −113.37, entrambi

significativi, la statistica r 2 = 0.8113 denota un discreto adattamento ma

dal grafico si nota come i valori previsti per x = 240 siano negativi (y è un

tempo di attesa!)

L’analisi dei residui mostra delle patologie per cui il modello lineare non

sembra adatto a spiegare la dipendenza di y da x.

17

Statistica Industriale Lez. 9

x vs residui

y stimati vs residui

●

●

●

●

●

●

210

220

230

1.5

0

2000

3000

y vs y stimati

Normal Q−Q Plot

●

1000

●●

●

3000

y

4000

5000

6000

●

● ●

● ● ● ●

●

●

●

● ●

●

−1.5

2000

4000

●

1.5

●

Sample Quantiles

●

0

1000

1000

y^i

3000

y^i

0.5

240

●

●

●●

●

0

●

●

●

xi

●

●●

●

●

●

●

0.5

200

●

●

●

●

●

−0.5

●

●

●

●

−0.5

−0.5

0.5

●

●

−1.5

●

Residui Standardizzati

1.5

●

−1.5

Residui Standardizzati

●

●

−2

●

●

●

−1

0

1

2

Theoretical Quantiles

18

Statistica Industriale Lez. 9

La relazione tra ln(y) e x sembra essere lineare per cui ipotizziamo un

legame esponenziale del tipo y = αeβx. Il modello trasformato risulta

ln y = ln α + βx. Supponendo che il modello probabilistico sia il modello esponenziale moltiplicativo, possiamo stimare con il metodo OLS

i parametri del modello trasformato

y 0 = β 0 + β 1 x0

Otteniamo i seguenti risultati

(Intercept)

Temp

Estimate

24.0183

−0.0780

Std. Error

0.9350

0.0042

t value

25.69

−18.39

Pr(>|t|)

0.0000

0.0000

Inoltre r2 = 0.95. Questo valore si riferisce all’adattibilità della retta ai

dati trasformati. Per misurare la performance del modello è meglio risalire

0

ŷ

0

i

dai valori previsti dal modello ŷi tramite l’antitrasformata ai dati ŷi = e e

quindi effettuare il grafico di yi contro ŷi

19

Statistica Industriale Lez. 9

Modello 2

y vs y stimati Modello 2

●

●

●

●

●

3000

8

●

●

y^i

7

●

●

2000

●

●

●

●

●

1000

6

log(Lifetime)

●

4000

●

●

●

●●

●

●●

5

●

●

●

●

200

210

220

Temp

230

240

●

●

●●●

0

1000

2000

3000

4000

5000

6000

y

Una ulteriore misura della performance del modello può essere valutata

andando a calcolare la somma dei residui sui dati di partenza per entrambi

i modelli.

20

Statistica Industriale Lez. 9

Osservando il grafico dei dati originari si può anche ipotizzare un modello

del tipo

y = αe

β1

x

In questo caso le stime sono

(Intercept)

I(1/Temp)

Estimate

−10.2045

3735.4511

Std. Error

0.9366

204.3551

t value

−10.89

18.28

Pr(>|t|)

0.0000

0.0000

Si noti che calcolare la stima di s per i tre modelli sui dati originali da questi

risultati

s1 = 947.0366,

s2 = 596.3623,

s3 = 591.3055

poichè il numero di parametri utilizzati nei tre modelli è lo stesso si preferisce il terzo.

21

Statistica Industriale Lez. 9

I grafici riportano la retta stimata per i dati trasformati e il grafico dei

valori y contro i valori ŷ ottenuti ritrasformando i dati previsti con il modello

lineare

Modello 3

y vs y stimati Modello 3

●

●

●

●

●

●

3000

8

y^i

7

●

●

2000

●

●

●

1000

6

log(Lifetime)

●

●

4000

●

●

●

●

●

●●

●

●●

5

●

●

●

●

0.0042

●

●

●●●

0.0044

0.0046

1/Temp

0.0048

0.0050

0

1000

2000

3000

4000

5000

6000

y

Si noti come l’adattabilità sia lievemente migliorata rispetto al modello 2.

22

Statistica Industriale Lez. 9

Osservazioni

1. Stimare i parametri β0 e β1 del modello lineare trasformato e poi trasformare questi parametri per ottenere i parametri del modello originario non è

come stimare con il metodo NLS i parametri del modello non linearizzato.

2. Se i modelli non sono intrinsecamente lineari occorre ricorrere direttamente alla stima dei parametri del modello tramite NLS. Le soluzioni si

trovano con procedure iterative

3. Per i modelli trasformati le stime ottenute con OLS sono ottime per la

stima dei parametri trasformati. L’ottimalità non si trasmette sulla stima

dei parametri dei modelli originari ottenuta trasformando le stime ottenute

con OLS.

4. Una volta stimati i parametri del modello trasformato, r2 si riferisce

all’adattabilità di questo modello ai dati trasformati. Sebbene un r2 alto

sia indice di una buona adattabilità del modello originario non lineare ai

dati osservati, questo valore non è riferito alle osservazioni originarie.

23

Statistica Industriale Lez. 9

Minimi quadrati pesati WLS

In molti contesti applicativi non è realistico pensare ad errori omoschedastici. Ad esempio se pensiamo ad uno studio sulla dipendenza del profitto

di un impresa dal livello di investimenti in ricerca e sviluppo è ragionevole

pensare che la variabilià del profitto cresca all’aumentare degli investimenti.

90

85

80

y

95

100

Errori Eteroschedastici

16

18

20

22

24

x

24

Statistica Industriale Lez. 9

Supponiamo che gli errori del modello Y = Xβ + siano tali che

E(εi) = 0

e

Var(εi) = λiσ 2,

Cov(εi, εj ) = 0

con λi noti e σ 2 incognito. Se denotiamo con Ω la matrice (n × n) varianza

e covarianza del vettore il miglior stimatore lineare non distorto risulta

β̂ = (X T Ω−1X)−1X T Ω−1y

β̂ è detto stima ai minimi quadrati pesati (WLS, weighted least squares) in

quanto è ottenuto con OLS sui dati trasformati opportunamente in modo

da ricondursi ad errori omoschedastici.

La matrice varianza e covarianza per lo stimatore β̂ è

Varβ̂ = σ 2(X T Ω−1X)−1

25

Statistica Industriale Lez. 9

Esempio: il seguente grafico rappresenta i dati rilevati su 39 aziende relativi agli investimenti effettuati in ricerca e sviluppo (x in migliaia di euro)

e il profitto (y in centinaia di migliaia di euro)

Scatter−plot

35

●

30

●

●

●

●

20

●

●

●

●

●

15

●

10

●

●●

●

●

●

●

●

●

● ●

●

●

0

●

●●

●

●●

5

y

25

●

●

●

●

●

●

●

●

●

5

10

15

20

x

26

Statistica Industriale Lez. 9

Dalla regressione lineare otteniamo i seguenti risultati

(Intercept)

x

Estimate

1.7005

1.2850

Std. Error

1.6334

0.1371

t value

1.04

9.37

Pr(>|t|)

0.3046

0.0000

con un standard error pari a s = 4.819 e r2 = 0.7036.

27

Statistica Industriale Lez. 9

L’analisi dei residui mostra una forte eteroschedasticità.

10

●

10

●

●

●

●

●

●

●

●

●

●

●

●

●

●●

●

●

●

●●

●●

●

●

●

●

●

●

●

●

●

●

●

−5

●●

●

●

●

●

●

●

−10

●

−10

●

●

●●

●

●

●●

●

●●

●

●

●

●

−5

●

●

0

●

●

●

●

●

Residui

●●

●

0

●

5

5

●

●

Residui

●

●

●

●

●

●

5

10

x

15

●

20

5

10

15

20

25

Valori Stimati

28

Statistica Industriale Lez. 9

Proponiamo quindi una regressione con errori eteroschedastici e con i WLS

otteniamo i seguenti risultati

(Intercept)

x

Estimate

3.0990

1.1232

Std. Error

0.3173

0.0800

t value

9.77

14.03

Pr(>|t|)

0.0000

0.0000

con un standard error pari a 0.7451 e r 2 = 0.8418.

29