Statistica Industriale Lez. 8

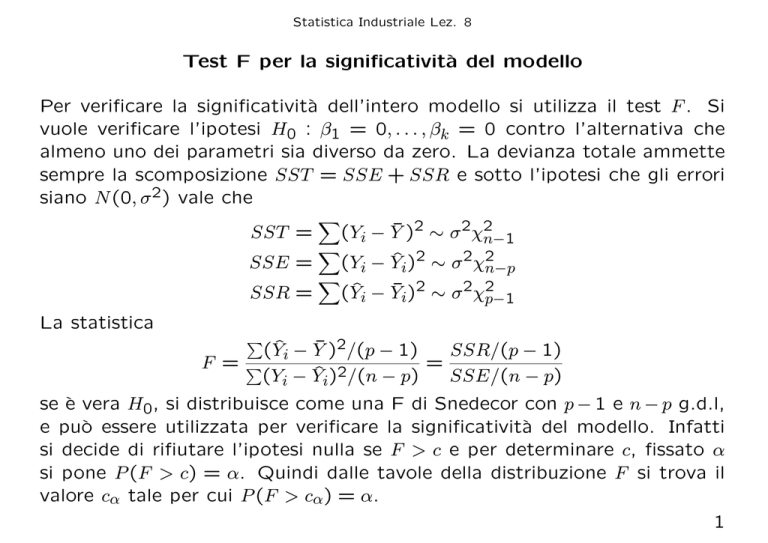

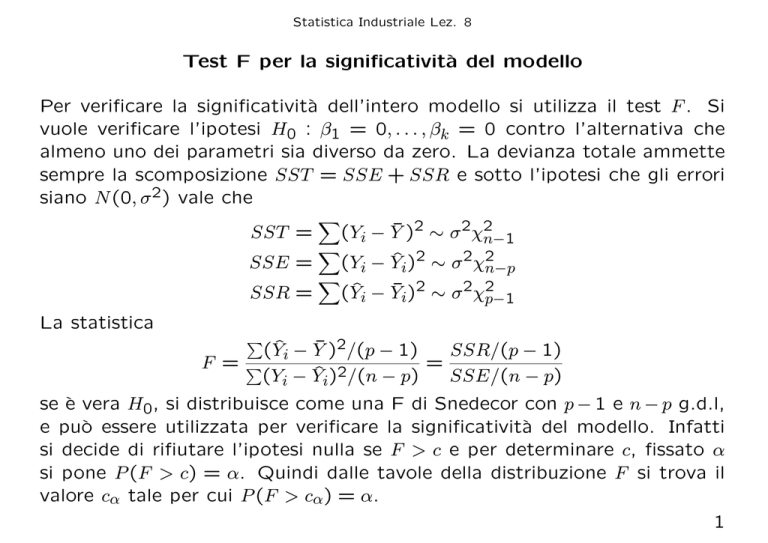

Test F per la significatività del modello

Per verificare la significatività dell’intero modello si utilizza il test F . Si

vuole verificare l’ipotesi H0 : β1 = 0, . . . , βk = 0 contro l’alternativa che

almeno uno dei parametri sia diverso da zero. La devianza totale ammette

sempre la scomposizione SST = SSE + SSR e sotto l’ipotesi che gli errori

siano N (0, σ 2) vale che

SST =

X

(Yi − Ȳ )2 ∼ σ 2χ2

n−1

SSE =

X

(Yi − Ŷi)2 ∼ σ 2χ2

n−p

SSR =

X

(Ŷi − Ȳi)2 ∼ σ 2χ2

p−1

La statistica

SSR/(p − 1)

(Ŷi − Ȳ )2/(p − 1)

=

F =P

(Yi − Ŷi)2/(n − p)

SSE/(n − p)

P

se è vera H0, si distribuisce come una F di Snedecor con p − 1 e n − p g.d.l,

e può essere utilizzata per verificare la significatività del modello. Infatti

si decide di rifiutare l’ipotesi nulla se F > c e per determinare c, fissato α

si pone P (F > c) = α. Quindi dalle tavole della distribuzione F si trova il

valore cα tale per cui P (F > cα) = α.

1

Statistica Industriale Lez. 8

Test F per il modello ridotto

Supponiamo di avere il modello completo

Y = β 0 + β 1 x 1 + β 2 x 2 + . . . + β k xk + ε

Vogliamo verificare l’ipotesi

H0 : β1 = β2 = . . . = βq = 0,

q<k

Se fosse vare l’ipotesi H0 il modello sarebbe

Y = β0 + βq+11xq+1 + βq+21xq+2 + . . . + βk xk + ε

Denotiamo con SSRr e SSEr le somme dei quadrati spiegati e residui del

modello ridotto. La statistica

(SSEr − SSE)/q

(SSR − SSRr )/q

=

SSE/(n − p)

SSE/(n − p)

sotto l’ipotesi nulla si distribuisce come una F con q e n − p gradi di libertà.

2

Statistica Industriale Lez. 8

Test F per l’aggiunta delle variabili nel modello

Si parte dal modello con nessuna variabile e si aggiungono le varibili ad una

ad una. Il modello j-esimo è

Y = β0 + β1x1 + β2x2 + . . . + βj xj + ε, j = 1, . . . , p

Si vuole sapere come l’aggiunta delle variabili nel modello riesca a spiegare

la variabilità totale della variabile da spiegare. Si calcola allora la SSR(1)

per il modello con una sola variabile, la SSR(2) del modello con due variabili e cosı̀ via. La differenza SSR(2) − SSR(1) ha il significato di quanta

variabilità il secondo modello riesce a spiegare in più rispetto al primo.

Si confrontano i due modelli successivi. Il test consiste nel verificare per il

modello j-esimo l’ipotesi nulla.

H0 : βj = 0,

La statistica test

SSR(j) − SSR(j − 1)

∼ F1,n−p, j = 2, . . . , p − 1

SSE/(n − p)

porta a rifiutare l’ipotesi nulla (e quindi l’aggiunta della variabile è significativa) per alti valori.

3

Statistica Industriale Lez. 8

Variabili indipendenti qualitative

Di solito le variabili nella regressione sono variabili continue.

In molte applicazioni si rende necessario l’introduzione di un fattore a due

o più livelli.

Ad esempio: i dati provengono dalla produzione di tre macchine differenti,

oppure un’azienda si serve o meno di alcuni strumenti, oppure vi sono 5

operatori diversi.

Possiamo assegnare a queste variabili dei livelli in modo da poter appurare

se hanno un qualche effetto sulla variabile da spiegare.

Queste variabili si chiamano dummy. Sono variabili che assumono in genere solo i valori (0, 1) a seconda che il fattore di interesse abbia assunto una

delle sue modalità. Se il fattore ha solo due modalità basta una variabile

dummy, altrimenti per k modalità servono k − 1 dummy.

4

Statistica Industriale Lez. 8

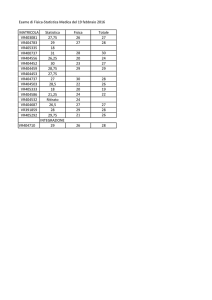

Esempio:

Il peso e l’età di 13 tacchini consumati durante il Giorno

del Ringraziamento sono riportati nella seguente tabella, con la regione di

provenienza.

1

2

3

4

5

6

7

8

9

10

11

12

13

age

28.00

20.00

32.00

22.00

29.00

27.00

28.00

26.00

21.00

27.00

29.00

23.00

25.00

weight

13.30

8.90

15.10

10.40

13.10

12.40

13.20

11.80

11.50

14.20

15.40

13.10

13.80

county

G

G

G

G

V

V

V

V

W

W

W

W

W

5

Statistica Industriale Lez. 8

Il grafico seguente mostra il grafico a dispersione dei punti osservati:

14

15

●

12

11

●

10

●

9

Weight

13

●

gruppo G

gruppo V

gruppo W

●

20

22

24

26

28

30

32

Age

6

Statistica Industriale Lez. 8

Stimiamo i parametri della retta di regressione y = β0 + β1x + ε dove con

y indichiamo il peso e con x l’età. La bontà di adattamento è R2 = 0.66,

la stima di s = 1.096.

(Intercept)

age

Estimate

1.9833

0.4167

Std. Error

2.3327

0.0892

t value

0.85

4.67

Pr(>|t|)

0.4133

0.0007

Come mostrano i grafici seguenti, i residui sembrano distribuirsi in maniera casuale, ma se li rappresentiamo per i diversi valori della regione di

provenienza, si nota un particolare andamento patologico.

Si osserva quindi che la regione di provenienza sembra avere una qualche

influenza sul peso dei tacchini.

7

Statistica Industriale Lez. 8

●

●

2.0

●●

●

●

●

●

●

1.5

−0.5

11

Regione

●

●

●

●

●

20

22

24

26

Age

28

30

32

●

●

1.0

−1.5

−1.0

10

9

●●

0.5

●

●

0.0

13

●

Residui

●

●

●

●

●

●

●

●

2.5

●

14

●

●

12

Weight

●

1.0

15

●

Grafico dei residui vs la regione di provenienza

3.0

Grafico dei Residui vs. Valori stimati

1.5

I punti osservati e la retta stimata

●

11

12

13

Valori Stimati

14

15

●

−1.5

●

−1.0

●

−0.5

●

0.0

0.5

1.0

1.5

Residui

Cerchiamo di inserire la variabile che indica il paese di provenienza nel

modello.

8

Statistica Industriale Lez. 8

Variabili indipendenti qualitative

Poiché il fattore assume tre valori introduciamo due variabili z1 e z2 ciascuna

delle quali assume solo i valori (0, 1) in modo che il modello sia

Y = β 0 + β 1 x1 + α 1 z 1 + α 2 z 2 + ε

(1)

In pratica quando entrambe le dummy valgono zero si ha il modello di

riferimento, quando una delle due vale 1 si hanno gli altri due modelli da

confrontare con quello di riferimento:

Y = β 0 + β 1 x1 + ε

Y = (β0 + α1) + β1x1 + ε

Y = (β0 + α2) + β1x1 + ε

Se si usassero tre variabili dummy la matrice X dei coefficienti del modello

(1) non avrebbe rango massimo perché una colonna sarebbe combinazione

delle altre. La matrice X per il modello (1) è riportata nella pagina seguente

insieme alla matrice di varianza e covarianza dei coefficienti stimati: Σ̂ =

(X 0X)−1s2,

9

Statistica Industriale Lez. 8

1

1

1

1

1

1

1

1

1

1

1

1

1

x

28

20

32

22

29

27

28

26

21

27

29

23

25

z1

0

0

0

0

1

1

1

1

0

0

0

0

0

z2

0

0

0

0

0

0

0

0

1

1

1

1

1

0.45

13 337

4

5

337 8887 110 125

0

XX=

4

110

4

0

5

125

0

5

-0.02

0.01

-0.02 0.00 -0.00

Σ = (X 0X)−1s2 =

0.01 -0.00 0.05

-0.03

0.00

0.02

-0.03

0.00

0.02

0.04

10

Statistica Industriale Lez. 8

I risultati della stima sono riassunti nella seguente tabella:

(Intercept)

age

countyV

countyW

Estimate

−0.4875

0.4868

−0.2735

1.9184

Std. Error

0.6734

0.0257

0.2184

0.2018

t value

−0.72

18.91

−1.25

9.51

Pr(>|t|)

0.4875

0.0000

0.2421

0.0000

I valori delle stime in corrispondenza delle righe denominate countyV e

countyW sono rispettivamente i valori di α1 e α2. Il modello stimato risulta

quindi:

ŷ = −0.4875 + 0.4868x − 0.2735z1 + 1.9184z2

Ovvero:

ŷ = −0.4875 + 0.4868x

per G

ŷ = −0.761 + 0.4868x

per V

ŷ = 1.4309 + 0.4868x

per W

11

Statistica Industriale Lez. 8

Il valore di R2 = 0.9794 è notevolmente cresciuto, quindi la provenienza

ha un peso non indifferente nello spiegare y. Il significato dei parametri è

il seguente:

α1 stima la differenza della risposta tra il gruppo G di riferimento e il gruppo

V . Il test H0 : α1 = 0 ci porta a concludere che questa ipotesi è plausibile,

cioè tra i due gruppi la differenza non è significativa.

α2 stima la differenza della risposta tra il gruppo G di riferimento e il gruppo

W . Il test H0 : α2 = 0 ci porta a concludere che questa ipotesi va rigettata,

cioè tra i due gruppi la differenza è significativa.

La differenza tra i gruppi V e W è data da α1 − α2 = −2.1919. La varianza

la otteniamo da

Var(α1 −α2) = Var(α1)+Var(α2)−2Cov(α1, α2) = .048+.041−2·.022 = .045

√

La statistica T vale t = −2.1919/( .0447) = −10.35 che porta a rifiutare

l’ipotesi nulla che i due paramentri siano uguali, e quindi a concludere che

la differenza nei due gruppi è significativa.

12

Statistica Industriale Lez. 8

Il grafico mostra le tre rette stimate

I punti osservati e le rette stimate

●

15

●

14

●

●

13

●

12

●

●

11

●

grupp G

gruppo V

gruppo W

10

●

9

Weight

●

●

●

●

20

22

24

26

28

30

32

Age

13

Statistica Industriale Lez. 8

Se vogliamo verificare l’ipotesi nulla

H0 : α1 = α2 = 0

Utilizziamo ancora la statistica la statistica F . La tavola della varianza

age

county

Residuals

Df

1

2

9

Sum Sq

26.20

12.40

0.81

Mean Sq

26.20

6.20

0.09

F value

290.71

68.81

Pr(>F)

0.0000

0.0000

In corrispondenza della colonna della somma dei quadrati, nella prima riga

abbiamo la devianza spiegata dal modello con solo la variabile age. Cioè

S2 = SSRr = 26.20 dove il modello ridotto è Y = β0 + β1x1 + ε. Nella

seconda riga abbiamo la differenza tra la devianza spiegata del modello

completo, Y = β0 + β1x1 + α1z1 + α2z2 + ε e quella del modello ridotto,

SSRc − SSRr = 12.40. Tanto più questa differenza è grande, tanto più il

modello completo è plausibile. Si verifica che la differenza S1 − S2 ∼ σ 2χ2

2,

dove S2 = SSRc, ed è indipendente da s2. Quindi possiamo costruire il test

F

14

Statistica Industriale Lez. 8

La statistica F sotto l’ipotesi nulla si distribuisce come una F di Snedecor

con 2 e 9 gradi di libertà e il suo valore è

(SSRc − SSRr )/2

12.40/2

=

= 68.81

SSE/(13 − 4)

0.81/9

In questo caso rifiutiamo l’ipotesi nulla. Possiamo concludere che la regione

di provenienza influenza il peso dei tacchini.

15

Statistica Industriale Lez. 8

Analisi della varianza per il confronto di più medie

Pensiamo ad una variabile quantitativa il cui valore dipenda da variabili qualitative. Ad esempio vogliamo analizzare una risposta quantitativa su una

popolazione che ha subito più di due trattamenti: l’efficienza del motore di

un’automobile quando sono stati utilizzati 5 differenti marchi di benzina.

Siano k il numero di trattamenti e µ1, µ2, . . . , µk la media nelle rispettive

popolazioni che hanno subito il trattamento 1, 2, . . . , k.

Denotiamo con yij l’osservazione j-esima nell’i-esimo gruppo, i = 1, . . . , k,

P

j = 1, . . . , ni,

ni = n. Possiamo decomporre l’osservazione come

yij = ȳi. + (yij − ȳi.)

Il termine (yij − ȳi.) è lo scostamento dell’osservazione dalla media del suo

gruppo.

Possiamo supporre il modello teorico

Yij = µi + εij , εij ∼ N (0, σ 2)

(2)

Pni

yij , (yij − ȳi.) risulta una stima di εij e

Uno stimatore per µi è ȳi. = n1 j=1

i

il valore previsto per yij da questo modello è ȳi..

16

Statistica Industriale Lez. 8

Possiamo decomporre l’osservazione come

yij = ȳ.. + (ȳi. − ȳ..) + (yij − ȳi.)

Il termine (ȳi. − ȳ..) è lo scostamento della media del gruppo dalla media

totale, mentre (yij − ȳi.) è lo scostamento dell’osservazione dalla media del

suo gruppo.

Il modello teorico risulta quindi

Yij = µ + αi + εij ,

εij ∼ N (0, σ 2),

k

X

αi = 0

(3)

i=1

Pni

1 Pk

In questo caso ȳ.. = n

i=1 j=1 yij è la stima di µ mentre (ȳi. − ȳ.. ) è la

stima di αi. Ora poiché

k

X

ni(ȳi. − ȳ..) = 0

i=1

si deduce che i parametri αi non sono univocamente determinabili, per cui

Pk

occorre porre il vincolo i=1 αi = 0.

17

Statistica Industriale Lez. 8

Il modello si può vedere come un modello di regressione. Supponiamo di

avere k trattamenti. Allora possiamo riscrivere il modello (2) come

Y = Xα + dove Y = (y11, . . . y1n1 , y21, . . . y2n2 , . . . , yk1, . . . yknk )0, è l’analogo vettore

degli errori, α = (α1, α2, . . . , αk )0 e la matrice del disegno sperimentale è

1

..

.

1

1

...

X=

1

.

..

1

..

.

1

0

...

0

1

...

1

...

0

...

0

0

...

0

0

...

0

...

0

...

0

...

...

...

...

...

...

...

...

...

...

0

...

0

0

...

0

...

1

...

1

La matrice X ha dimensioni n = n1 + · · · + nk righe e k colonne.

18

Statistica Industriale Lez. 8

In questo caso il modello è

Y = β0 + α1z1 + α2z2 + . . . + αk−1zk−1 + ε

Le variabili z1, . . . , zk−1 sone le variabili dummy per identificare i k trattamenti. Il trattamento va visto come una variabile qualitativa con k fattori.

In questo caso le osservazioni dal k-esimo fattore costituiscono il gruppo

di riferimento, identificato con zi = 0 per ogni i. Quindi la stima di β0 sarà

data dalla media di y calcolata sul k-esimo gruppo. Ciascun parametro αi

invece è la differenza tra la media nel gruppo i e la media nel gruppo k.

19

Statistica Industriale Lez. 8

Verificare l’ipotesi che le medie siano tutte uguali equivale a verificare

l’ipotesi

H0 : α1 = α2 = . . . = αk−1 = 0

Se indichiamo con SSRc la varianza spiegata dal modello completo, abbiamo che

SSRc ∼ σ 2χ2

k−1

e risulta essere indipendente da S 2. Quindi la statistica

SSRc/(k − 1)

SSE/(n − k)

Si distribuisce come una F di snedecor con gradi di libertà k − 1 e n − k,

dove con SSE si è indicata la varianza residua del modello completo.

Tanto più SSRc è grande rispetto a SSE tanto più siamo portati a rifiutare

l’ipotesi nulla

20

Statistica Industriale Lez. 8

Esempio. Per studiare l’effetto che un tipo di cuscinetto ha sulla vibrazione

del motore, 5 diversi tipi di cuscinetti sono stati montati ciascuno su 6

motori. La quantità di vibrazione (misurata in micron) è stata registrata

per i 30 motori. I risultati sono riportati nella seguente tabella

Gruppo

1

2

3

4

5

13.10

16.30

13.70

15.70

13.50

15.00

15.70

13.90

13.70

13.40

14.00

17.20

12.40

14.40

13.20

14.40

14.90

13.80

16.00

12.70

14.00

14.40

14.90

13.90

13.40

11.60

17.20

13.30

14.70

12.30

Media

13.68

15.95

13.67

14.73

13.08

Si vuole capire se il tipo di cuscinetto ha qualche effetto sulla riduzione

della vibrazioni del motore.

Il grafico nella pagina seguente ci rappresenta le osservazioni nei 5 gruppi

21

13

14

●

●

12

vibration

15

16

17

Statistica Industriale Lez. 8

1

2

3

4

5

Brand

22

Statistica Industriale Lez. 8

Esaminiamo i coefficienti per il modello proposto per i dati dell’esempio.

(Intercept)

Brand2

Brand3

Brand4

Brand5

Estimate

13.6833

2.2667

−0.0167

1.0500

−0.6000

Std. Error

0.3902

0.5518

0.5518

0.5518

0.5518

t value

35.07

4.11

−0.03

1.90

−1.09

Pr(>|t|)

0.0000

0.0004

0.9761

0.0686

0.2873

I coefficienti non vanno interpretati come nel modello lineare. In questi modelli l’intercetta è la media del primo gruppo, mentre gli altri coefficienti

sono gli scostamenti della media degli altri gruppi dal primo. Per α = 0.05

dalla tavola deduciamo che solo la media del secondo gruppo è significativamente diversa dalla media del primo gruppo. Per α = 0.1 risulta diversa

dalla media del primo gruppo anche la media del quarto gruppo.

23

Statistica Industriale Lez. 8

La tavola dell’analisi della varianza è

Brand

Residuals

Df

4

25

Sum Sq

30.86

22.84

Mean Sq

7.71

0.91

F value

8.44

Pr(>F)

0.0002

Nella prima colonna dopo la colonna dei gradi di libertà sono riportati i

valori SSRc e SSR.

Nella colonna successiva vi sono le somme dei quadrati divise per i rispettivi

gradi di libertà.

Il valore della statistica F è ottenuto come rapporto tra i due Mean Sq. Il

p-value pari a 0.0002 ci porta a rifiutare l’ipotesi nulla che le medie siano

uguali nei 5 gruppi ad un livello di significatività α = 0.01.

Una volta che il test F ha mostrato che c’è una qualche differenza tra le

medie occorre andare a cercare dove si trova questa differenza. È necessario

confrontare i gruppi tra loro.

Parte di questa informazione l’abbiamo già vista e si trova nei coefficienti

del modello e nella loro significatività rispetto al test t.

24

Statistica Industriale Lez. 8

La tavola dei coefficienti ci permette di confrontare la significatività solo

tra il gruppo di riferimento e gli altri. Per un confronto globale possiamo

effettuare il confronto per ogni coppia di gruppi. Ricordiamo che per verificare se le medie di due popolazioni sono uguali si può utilizzare il test t.

2 sono le medie e le varianze campionarie di due campioni

Se x̄1, x̄2, s̄2

e

s̄

1

2

di ampiezza n1 ed n2, si può costruire un test t per verificare l’ipotesi nulla

H0 : µ1 = µ2 contro le usuali alternative, basato sulla statistica

x̄1 − x̄2

r

t=

s̄ n1 + n1

1

2

dove

v

u

u (n − 1)s̄2 + (n − 1)s̄2

1

2

1

2

s̄ = t

n1 + n2 − 2

Poiché la statistica t si distribuisce come una t di Student con g = n1 +n2 −2

d.f, il test di livello α corrisponde alle seguenti regole di decisione

g

quando H1 : µ1 6= µ2,

Rifiutare H0 se |t| > t1− α

quando H1 : µ1 > µ2,

Rifiutare H0 se t > t1−α

quando H1 : µ1 < µ2,

Rifiutare H0 se t < tα

2

g

g

25

Statistica Industriale Lez. 8

I valori del p-value per i test per il confronto delle medie dei gruppi a due

a due per i dati dell’esempio sono riportati nella tabella seguente.

2

3

4

5

1

0.00

0.98

0.32

0.86

2

–

0.00

0.22

0.00

3

–

–

0.32

0.86

4

–

–

–

0.04

Per α = 0.05 la media del gruppo 2 è significativamente diversa dalla media

dei gruppi 1,3,5. Per lo stesso livello risultano diverse anche le medie dei

gruppi 4 e 5.

In pratica sono stati calcolati k(k − 1)/2 intervalli di confidenza per µi − µl e

sono state ritenute diverse le medie i cui intervalli non contengono lo zero.

Un metodo alternativo consiste nel controllo simultaneo di questi intervalli

ed è noto come Procedura di Tukey

26

Statistica Industriale Lez. 8

La Procedura di Tukey si basa sull’ utilizzo di una statistica detta Range

Studentizzato e la cui distribuzione è detta distribuzione di Tukey.

Supponiamo che ogni gruppo abbia la stessa numerosità n0, quindi n = kn0.

Sia s2 = M SE/n0. Allora il range Studentizzato è definito da

qk,n−k =

max

1≤i<l≤k

|ȳi. − ȳl.|

√s

n0

La distribuzione del Range Studentizzato si chiama ditribuzione di Tukey

ed è denotata con Qk,n−k e i valori dei quantili si trovano in apposite tavole

al variare dei parametri. L’intervallo di confidenza per la differenza µi − µl

è dato da

s

s

ȳi. − ȳl. − qα;k,n−k √

≤ µi − µl ≤ ȳi. − ȳl. − qα;k,n−k √

n0

n0

dove qα;k,n−k è tale che P (Qk.n−k ≤ qα;k,n−k ) = 1 − α.

27

Statistica Industriale Lez. 8

Il test di Tukey eseguito sulle 10 differenze da i seguenti risultati. Le

differenze sono prese dalla più piccola alla più grande e in modo che siano

sempre positive.

3-5

1-5

4-5

2-5

1-3

4-3

2-3

4-1

2-1

2-4

diff

0.58

0.60

1.65

2.87

0.02

1.07

2.28

1.05

2.27

1.22

lwr

-1.04

-1.02

0.03

1.25

-1.60

-0.55

0.66

-0.57

0.65

-0.40

upr

2.20

2.22

3.27

4.49

1.64

2.69

3.90

2.67

3.89

2.84

Da questa tabella si deduce che i gruppi con medie significativamente

differenti sono quelli in cui l’intervallo di confidenza non contiene lo zero. In

questo caso abbiamo 4-5, 2-5, 2-3, 2-1. I risultati di questo test coincidono

a livello 0.05 con quelli ottenuti con i test t.

28