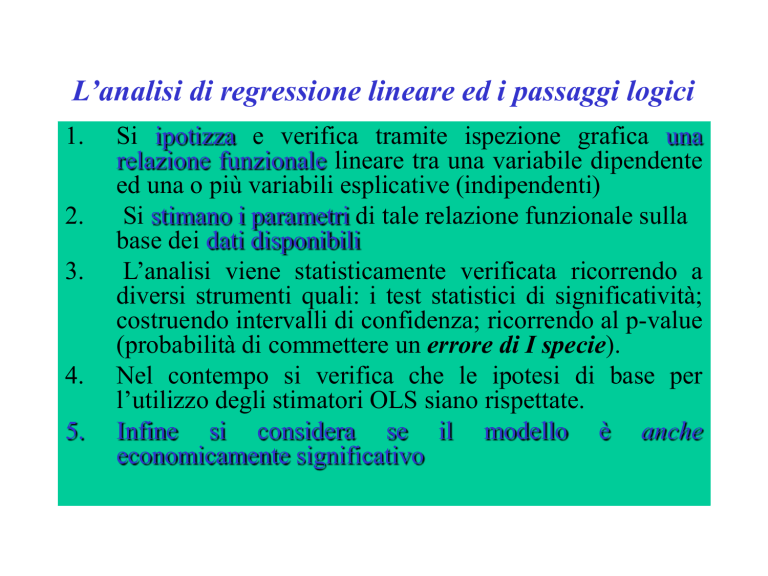

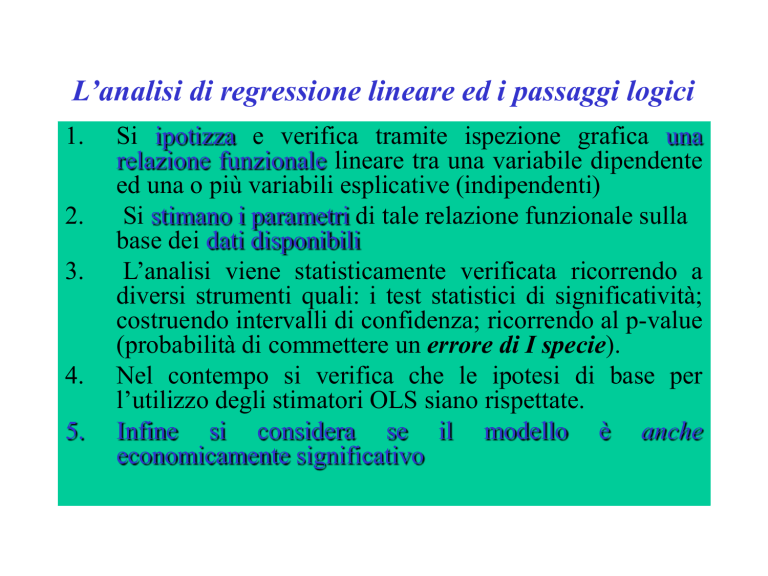

L’analisi di regressione lineare ed i passaggi logici

1.

2.

3.

4.

5.

Si ipotizza e verifica tramite ispezione grafica una

relazione funzionale lineare tra una variabile dipendente

ed una o più variabili esplicative (indipendenti)

Si stimano i parametri di tale relazione funzionale sulla

base dei dati disponibili

L’analisi viene statisticamente verificata ricorrendo a

diversi strumenti quali: i test statistici di significatività;

costruendo intervalli di confidenza; ricorrendo al p-value

(probabilità di commettere un errore di I specie).

Nel contempo si verifica che le ipotesi di base per

l’utilizzo degli stimatori OLS siano rispettate.

Infine si considera se il modello è anche

economicamente significativo

La scelta del legame funzionale

• Il concetto di regressione è indipendente dalla linearità del

modello utilizzato

• Viene utilizzato il modello lineare perché è più facile da

interpretare

• Quando i dati disponibili, dovessero seguire un andamento

diverso rispetto a quello lineare – laddove possibile – si

interviene sulle variabili per “linearizzarle” (anamorfosi

lineare)

• Nella regressione semplice il primo strumento per fare

un’analisi preventiva della linearità è il diagramma a

dispersione

La regressione e la natura dei dati

• I dati che possono essere utilizzati nella regressione

possono essere quantitativi e qualitativi;

• I dati qualitativi, se riguardanti variabili indipendenti,

possono essere utilizzati attraverso l’uso delle dummy

(ad.esempio maschio =1 e femmina = 0; si veda come

esempio la matrice dei dati in Verbeek bwages)

• Se invece l’utilizzo delle variabili dummy riguarda le

variabili dipendenti, noi ci troviamo innanzi ai modelli: A)

LPM (Linear Probability Model); B) LOGIT model; C)

PROBIT model;

….e i dati di conteggio

• Occorre anche fare attenzione che la variabile dipendente

non utilizzi dati di conteggio (ad esempio il numero di

brevetti).

• Ed infatti in questo caso, nonostante le risposte siano

discrete ed ordinate è possibile evidenziare due differenze

importanti rispetto al caso di risposte discrete ed ordinate:

- il valore osservato può avere un significato cardinale e

non semplicemente ordinale;

- Non esiste un limite superiore naturale per il risultato

La classe dei modelli in questo caso sono i modelli di

Poisson e la binomiale negativa

La regressione lineare semplice

Su n unità statistiche sono stati osservati i valori relativi a due

distinte variabili:

Yi X i ui

Y variabile dipendente o variabile risposta

X variabile indipendente o variabile esplicativa

Sulla base dei dati osservati, effettuata una rappresentazione

grafica delle osservazioni, può essere formulata la seguente

relazione lineare

I parametri della retta di regressione

Yi X i ui

Dove:

- α e β sono i parametri del modello di regressione

- α è chiamata intercetta; β coefficiente di regressione

Occorre inoltre ricordare che mentre il termine di errore è

una variabile casuale, la xi è “solitamente” considerata una

variabile matematica.

Il modello matematico e il modello statistico

• Il termine ui, indica il passaggio da una relazione certa ad

una incerta.

• Nel modello matematico la 1] viene riscritta senza il

termine di errore; ad ogni valore di xi corrisponde un

valore esatto di yi

• Nel modello statistico la relazione non è certa perché esiste

il termine di errore.

• Per poter sviluppare una teoria econometrica è però

importante fare delle ipotesi sugli errori.

…..cosa troviamo nell’errore

- Nell’errore troviamo tutte le variabili non esplicitate nel

modello

- Nell’errore troviamo anche gli errori di misurazione;

- Analizzare il comportamento dell’errore (le ipotesi) è

importante per comprendere lo stesso significato della

regressione

Ma cosa rappresenta una regressione?

• Regredire una variabile sull’altra, significa spiegare il

comportamento

di

una

variabile

mediante

il

comportamento di un’altra

• La retta di regressione esprime una tendenza; questo vuol

dire che mediamente al variare della xi la yi assumerà certi

valori (ricorda che c’è sempre un termine di errore!)

• Possiamo fare una considerazione di ordine generale:

-la regressione rappresenta lo stesso concetto studiato con

la media aritmetica;

-l’errore standard (media dei quadrati degli errori) della

retta di regressione equivale allo scarto quadratico medio.

• Il modello di regressione quindi esprime una misura di

tendenza, alla quale viene associata una misura della

variabilità (errore standard della regressione)

…quale ipotesi sugli errori

1] La media degli errori deve essere uguale a zero: E(u) = 0

2] La varianza degli errori deve essere costante

(omoschedasticità): E(u2) = σ2u

3] Gli errori devono essere tra loro incorrelati: Cov(ui,uj) = 0

Dalla 1 e 2 segue – importante per fare inferenza statistica su

parametri della retta di regressione:

4] Gli errori devono distribuirsi normalmente.

…ancora sulle ipotesi di regressione

• Tra la 1 e la 2 è possibile inserire un’ ulteriore ipotesi che in

molti casi viene implicitamente contenuta nella 1 e 2, ovvero:

2a) Gli errori sono indipendenti da Xi.

Le condizioni appena elencate possono essere così riassunte:

I termini di errore ui sono estrazioni indipendenti da una

distribuzione normale (n.i.d) di media nulla e varianza

costante

Sul metodo di stima

• Il metodo di stima utilizzato per la specificazione dei

parametri nel modello di regressione lineare è il metodo

dei minimi quadrati;

• Esso impone che la distanza tra i valori osservati ed i valori

teorici al quadrato sia un minimo considerando che l’errore

o residuo è 5]:

ei Yi Yˆi Yi a bX i

….dalla popolazione alla retta di regressione

campionaria e viceversa

• Il termine errore utilizzato nella vera retta di regressione

della popolazione, diventa il residuo nella retta di

regressione campionaria

• I coefficienti a e b, rappresentati nella 5] sono degli

stimatori di α e β

• Cosa permette di utilizzare a e b come stimatori di α e β ?

• Il rispetto delle ipotesi 1] e 3], ci permette di affermare che

lo stimatore OLS b, è il migliore stimatore corretto e

lineare di β.

• Si dice così che b è lo stimatore BLUE (Best Linear

Unbiased Estimator)

…ancora sulla stima dei parametri

• Applicando il metodo dei minimi quadrati, a e b, sono

scelti in modo da minimizzare la somma dei quadrati dei

residui campionari 6]:

n

n

f (a, b) e Yi a bX i

i 1

2

i

i 1

2

….e sul procedimento matematico

Le condizioni necessarie per un punto stazionario sono date da

f ( a, b) f ( a, b)

0

a

b

7]:

applicando queste condizioni, si ottiene il seguente sistema di

n

n

n

n

equazioni

nelle incognite

a e b,n da cui si ricava:

2

X

Y

a

X

b

X

ii i i

Yi na b X i

i 1

8]:

i 1

i 1

i 1

i 1

….ancora sul procedimento matematico

• Da cui si ottengono le seguenti 8] e 9] stime dei parametri

considerando xi e yi come scarti dalla media:

a Y bX

n

b xi yi

i 1

n

2

x

i

i 1

Ancora qualche riflessione

• Ricorda che:

- I dati campionari sono solo una delle possibili

determinazioni, ovvero quella che è stata “estratta”

- Che yi e ui, sono variabili casuali

- Al variare del campione e, quindi, dei dati disponibili, si

modificherà anche la retta di regressione stimata;

- ci muoviamo nell’ambito del campionamento casuale; la

distribuzione dei campioni, come ricorderai ha, sotto

specifiche ipotesi, un andamento normale;

- Questo vuol dire che la possibilità di avere “cattivi

campioni” è minore rispetto a quella di avere “buoni”

campioni;

- Gli stimatori hanno anch’essi una distribuzione normale,

e, quindi, la possibilità di commettere grandi errori è bassa.

….è importante ricordare

• Lo stimatore b ha anch’esso una distribuzione normale, esso

inoltre è corretto, ovvero mediamente è pari al vero valore β

della popolazione

• Per la correttezza dello stimatore OLS è sufficiente che i

termini di errore abbiano media nulla e siano indipendenti

da tutte le variabili esplicative, anche in presenza di

autocorrelazione e eteroschedasticità.

• In presenza di autocorrelazione ed eteroschedasticità lo

stimatore OLS può essere comunque corretto e consistente,

ma solo relativamente efficiente (non è più BLUES)

…come intervenire

• In questi casi lo stimatore OLS, sebbene corretto, non è il

migliore

• A questo punto si aprono due possibilità:

1] Si può derivare un nuovo stimatore (GLS o minimi

quadrati ponderati) che è BLUE

2] Si può continuare ad utilizzare lo stimatore OLS,

correggendo gli standard error per ammettere la possibilità

di eteroschedasticità e/o autocorrelazione

….esiste però una terza possibilità

• Si ricordi infine che in molti casi la presenza di

eteroschedasticità e/o autocorrelazione, indica una non

corretta specificazione del modello.

• Si può quindi intervenire in un altro modo, ovvero

riconsiderare il modello.

La regressione lineare multipla

• Il modello statistico di riferimento può essere così

stilizzato:

y 1x1 2 x2 ... k xk u

Quanto detto per la regressione semplice sulle iotesi di

base, può essere riproposto per la regressione multipla

…la multicollinearità come ipotesi aggiuntiva

• Consiste nella dipendenza lineare o quasi dipendenza

lineare (un legame molto intenso anche se non perfetto) di

due o più variabili esplicative, sebbene in letteratura non

sia stata individuata una precisa “soglia”

• In presenza di una forte combinazione lineare delle

variabili esplicative, si ha una perdita di efficienza degli

stimatori;

• Si registra infatti un aumento della variabilità delle stime

che quindi diventano meno precise

• Da un punto di vista concettuale, se una variabile è

“collineare” con un’altra, vuol dire che è “ridondante” per

spiegare la variabile dipendente (principio della

parsimonia)

….può essere misurata?

• Può anche essere computato il VIF (Variance Inflation

Factor), basato sul coefficiente di determinazione multiplo

R2j

relativo alla regressione della j-sima variabile

esplicativa

1

possono

• Valori superiori VIF

a 4-5

iniziare ad essere

2

1 Rj

considerati sospetti

• L’inverso del VIF è il TOL = (1-R2)

• TOL= 0 perfetta collinearità tra i regressori; TOL = 1 non

c’è collinearità tra i regresssori

…i rimedi possibili

• I rimedi possono essere diversi:

• A) eliminare la variabile collineare;

• B) trasformare le variabili iniziali, ad esempio inserendo

una nuova variabile combinazione di quelle correlate.

• Se i dati sono in serie storica, può essere utile una

trasformazione logaritmica, oppure una differenziazione

Il modello si adatta bene ai dati?..L’R2

• Il coefficiente di determinazione “R2”, misura la quota di

variabilità della Y spiegata dal modello, utilizzando quelle

variabili.

• La devianza totale può essere scomposta nella devianza di

regressione (devianza spiegata) e nella devianza residua

(devianza non spiegata).

2

ˆ

Y

Y

Y

Y

e

i

i

i

n

i 1

2

n

i 1

2

n

i 1

ancora sulla valutazione del modello

• Il coefficiente di determinazione R2=Devianza di

regressione/Devianza Totale e varia tra 0 (indica che il

modello non si adatta per niente ai dati) e 1 (il modello si

adatta perfettamente ai dati).

• Può anche essere espresso come il complemento a 1 del

rapporto tra la Devianza Residua/Devianza Totale

• Per valutare la bontà di una regressione è importante però

guardare sempre gli errori standard

• Inoltre se si vuole confrontare l’R2 di due regressioni

diverse sarà bene considerare la numerosità delle

osservazioni e il numero delle variabili esplicative inserite

nel modello

• Si perviene così all’R2 corretto

…continua

• Si perviene così all’R2 corretto

RSS (n k )

n 1

R 1

1

1 R2

TSS (n 1)

nk

2

• Se l’R2 è alto, ma le t hanno un basso livello di

significatività statistica, questo è un segnale di

multicollinearità

• Anche la matrice di correlazione è uno strumento

diagnostico utile.

Significatività statistica dei parametri nel loro

complesso

• Si può analizzare la significatività statistica dei parametri

nel loro complesso

• La statistica F della tavola ANOVA può essere impiegata

per effettuare un test di significatività per l’intero modello

utilizzando come ipotesi nulla e alternativa:

H0:

H1:

β2 = β3 = … = β k = 0

almeno un βj ≠ 0

j=2, …, k

• Ipotesi nulla (H0): le variabili esplicative non influiscono

su Y

• Ipotesi alternativa (H1):almeno una delle variabili

esplicative influisce su Y

Il Test F

• Sotto H0 il rapporto delle due quantità ESS (devianza

spiegata) e RSS (devianza residua) - divise per i rispettivi

gradi di libertà - si distribuisce come una variabile F di

Fisher con (k-1) e (n-k) gradi di libertà

• Per sottoporre a verifica l’ipotesi nulla si procede come

precedentemente fatto per la t;

• Si confronta - ad un determinato livello di significatività α

- il valore F calcolato con il corrispondente valore della

distribuzione F di Fisher teorico

…ancora sulla F

• Se vale la seguente relazione (così come accadeva per la t),

si rifiuta l’ipotesi nulla e quindi la regressione è nel

complesso statisticamente significativa

ESS /(k 1)

F

F , k 1, nk

RSS /(n k )

• Ricorda infine che tra la statistica T e la F esiste una

precisa relazione

• Si può utilizzare anche il p-value che per rifiutare l’ipotesi

nulla dovrà essere inferiore al livello di significatività

prescelto

L’analisi dei residui

•

Sia nella regressione lineare semplice, sia in quella

multipla, l’analisi dei residui consente di diagnosticare il

rispetto delle condizioni di base.

•

Si ricordi che la violazione delle ipotesi di base, produce

stime non efficienti e, comunque, possono portare a

risultati fuorvianti.

•

L’analisi dei residui è quindi determinante e può essere

condotta mediante

A) ispezione grafica;

B) utilizzo di test statistici;

L’Ispezione Grafica

Il grafico utilizzato è il diagramma a dispersione che riporta i

residui eis in ordinata mentre, in ascissa è possibile

riportare:

- i valori stimati della variabile dipendente Ŷi (si evince la

linearità del modello)

- i valori osservati di una delle variabili indipendenti Xj

(questo è il diagramma più corretto per evidenziare

l’eteroschedasticità)

Se le assunzioni sono verificate, i residui danno luogo ad una

nuvola di punti, e quindi non esiste una particolare

struttura (andamento)

I punti del diagramma tendono a disporsi casualmente intorno

allo 0

…il grafico a dispersione….se le cose vanno bene

2,5

2

1,5

1

0,5

es i0

-0,5 0

50

100

150

-1

-1,5

-2

Ŷi

200

250

Il ricorso ai test..

• A) Esiste il Test di Linearità (Test Reset_Regression

Equation specification Error Test)

• B) Esiste il Test per la verifica della Normalità degli

errori/residui

• C) Esiste il Test per la verifica dell’Eteroschedasticità degli

errori/residui

• D) Esiste il Test per la verifica dell’Autocorrelazione dei

errori/residui

Violazione dell’ipotesi di linearità

Si può diagnosticare principalmente in due modi:

1. osservando una certa struttura nei residui mediante

ispezione grafica

2

1,5

Residui stud.

1

0,5

0

-50

-0,5 0

50

100

-1

-1,5

-2

Vendite (valori stimati)

2. Ricorrendo al Test Reset

150

200

Come intervenire…

Laviolazione delle ipotesi possono essere risolte trasformando

le variabili:

1) Per la normalizzazione dei Residui1) Y X u

2) Per stabilizzare la Varianza errori 2) logY X u

3-4) Per linearizzare le relazione

3) Y log X u

4) log Y log X log u

Ancora ispezione grafica

Per avvalorare l’ipotesi che la relazione stimata sia lineare

nella trasformata, si esaminano i residui della nuova

regressione e si verifica che non ci sia nessuna particolare

struttura

Violazione dell’ipotesi di omoschedasticità

2,5

2

Residui studentizzati

1,5

1

0,5

0

-0,5

-1

-1,5

-2

-2,5

-3

Variabile X

…ancora sull’omoschedasticità

2

Residui studentizzati

1,5

1

0,5

0

-0,5

-1

-1,5

-2

Variabile X

I test dell’eteroschedasticità…

• Sono diversi ma noi considereremo solamente il Test di

Breusch-Pagan (BP) e il test di White

• Il metodo di White è estremamente generale e la potenza

del test è estremamente bassa se il numero di osservazioni

è modesto

• Il test di (BP) è, spesso, anche per la facilità di calcolo il

più utilizzato.

• Si ricorre ad una regressione ausiliara degli errori rispetto

alle variabili esplicative, testando l’ipotesi nulla

Eteroschedasticità non presente

…la soluzione per l’eteroschedasticità

• Le soluzione consiste, come precedentemente illustrato:

• A) Nel trasformare le variabili in logaritmi;

B) Oppure, applicare stimatori diversi agli OLS, ad

esempio il metodo GLS come il metodo dei minimi

quadrati ponderati (WLS)

• Gretl esempio Price-Sqrm

La regressione in serie storica

…le ipotesi di base sono sempre valide

• Queste ipotesi però vanno rispettate tenuto conto che esse

si manifestano in serie storica.

• Formalmente le ipotesi di base così come formulate nella

regressione cross-section, sostituisconi a i, t

• Lo stesso avviene per la stilizzazione della regressione

lineare semplice

1] ytα0+β1xt+εt (vedremo che il modello presenta alcune

particolarità)

esempio:

• inflazione = α0 + β1 disoccupazionet+ εt (vedremo che il

modello presenta delle particolarità)

…però ci sono anche i modelli dinamici

• I modelli 1] sono anche definiti modelli statistici;

mentre

2] ytα0+β0xt+ β2xt-1+εt

• Sono detti anche modelli dinamici e pur non mutando il

significato del coefficiente di regressione essi presentano

alcune particolarità

• Ad esempio nei modelli dinamici, come la 2] la somma dei

coefficienti descrive l’effetto cumulato sulla y (long-run

propensity)

…cross-sectional e time series…

• Dal punto di vista metodologico il Pil nei diversi anni, il

valore in ciascun anno rappresenta una variabile casuale,

come particolare realizzazione;

• La distinzione tra processo stocastico e la sua realizzazione

è la stessa distinzione che abbiamo fatto tra la popolazione

ed il campione nei dati crss-sectional.

• Così come accadeva nel ragionamento cross-sectional, che

utilizzavamo i dati campionari per fare inferenza sulla

popolazione, nelle serie storiche noi utilizziamo i dati per

fare inferenza sul processo stocastico sottostante che li ha

generati.

…anche nella regressione in serie storica

• Valgono le ipotesi di base che abbiamo già visto per

l’utilizzo degli stimatori OLS nella regressione crossection (teorema Gauss-Markov)

• Si ricordi che però l’ipotesi di errori non correlati, acquista

maggiore rilevanza

• Le considerazioni fatte in merito alla forma funzionale,

valgono anche nella regressione in time-series.

• Spesso nei lavori applicati, viene utilizzata la

trasformazione logaritmica delle variabili;

…variabili e “tempo”

• Spesso le variabili dummy possono essere utilizzate per

isolare certi periodi che possono essere sistematicamente

differenti da altri periodi.

• Molte serie storiche hanno una tendenza comune a crescere

nel tempo e questo è il principale problema.

• Se le serie storiche contengono un trend nella

stessa/opposta direzione, possiamo concludere in maniera

sbagliata che un cambiamento in una delle variabili, causa

un cambiamento nell’altra.

• Questo fenomeno è noto come regressione spuria

…la stazionarietà…ovvero non c’è l’influenza del

tempo

• Un particolare processo stocastico utilizzato nelle analisi di

serie storiche è il processo stocastico stazionario;

• Un processo stocastico è un insieme di variabili ordinate

rispetto al tempo;

• La stazionarietà di un processo si ha quando la sua media e

la sua varianza sono costanti nel tempo e la sua covarianza

dipende solamente dalla distanza legata ai due periodi

…in sintesi si ha

Per la media

E(Yt) = μ

Per la varianza

Var (Yt) = E(Yt-μ)2=σ2

Per la Covarianza

γk =E[(Yt-μ)(Yt+K-μ)

Sono quindi invariati rispetto al tempo

…un particolare tipo di processo stazionario

• Se il processo stocastico ha media 0, varianza costante ed è

serialmente incorrelato allora siamo davanti ad un processo

white noise

• Molte serie storiche economiche non sono stazionarie, il

più chiaro esempio è il modello random walk

1] yt= yt-1+μt

Si può dimostrare che Var(yt) = tσ2

…la radice unitaria e i trend stocastici

1] yt= ρyt-1+μt

Se nella 1, ρ=1 siamo in presenza di una radice unitaria che

indica una non stazionarietà del processo;

Il termine non stazionarietà, passeggiata aleatoria (random

walk), radice unitaria, trend stocastico possono essere

utilizzati con lo stesso significato

…ma le differenze prime sono stazionarie

• Ma è interessante notare che :

(Yt-Yt-1) = ΔYt= ut

• Quindi se Yt non è stazionario, la sua differenza prima è

invece stazionaria

• Se dalla 1 passiamo alla 2 si ha:

2] yt=α+yt-1+μt

• Si ottiene un random walk with drift

• Il modello random walk è un esempio di quello che

chiamiamo un processo a radice unitaria

…il trend deterministico ed il trend stocastico

• Se il trend di una serie storica è una funzione deterministica

del tempo, lineare quadrata, ecc.. Si dice che il trend è

deterministico

• Il trend detrministico è quindi prevedibile infatti la 3]

3] yt= β1+ β2t+μt

È chiamata anche trend stazionario. Questo vuol dire che

mentre la media di yt è β1+ β2t, e quindi non è costante, lo è

la sua varianza.

… in una serie storica possono coesistere trend

deterministici e trend stocastici

4] yt= β1+β2 t+ β3yt-1+ μt

Se β1e β2 sono diversi da 0, ma β3<1

Indica un trend stazionario intorno ad un trend deterministico

Si ricordi che un processo è integrato di ordine p, I(d),se viene

differenziato d volte

Se viene utilizzata la differenza prima diciamo che la serie è

differenziata di ordine 1, I(1)

La serie differenziata è uno strumento che può rendere la serie

stazionaria, eliminando il problema relativo al trend

stocastico o radice unitaria

…per evidenziare la stazionarietà..

• Abbiamo l’ispezione grafica dei dati originari.

• Il correlogramma

• I test di stazionarietà (Dickey-Fuller test)