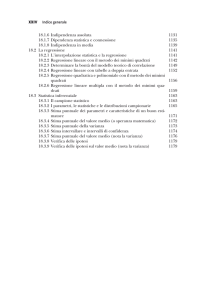

Modello di regressione lineare semplice

Analizzando la dipendenza tra due variabili possiamo cercare

la relazione che esiste Usando una funzione matematica

Studieremo la relazione tra una variabile dipendente da una

variabile indipendente o esplicativa

Qual è la funzione matematica più adatta a descrivere la

relazione tra le due variabili? Se si assume che il legame è

lineare la funzione più adatta è l’equazione di una retta

Y = f(x) = a + β x

a = intercetta

Β = coefficiente angolare

Retta di regressione lineare semplice

Una retta di regressione lineare descrive come cambia una

variabile dipendente y quando cambia la variabile

esplicativa x

Obiettivo è individuare la retta che interpreta meglio i punti

empirici ossia che interpola meglio i punti sul piano

Operativamente utilizziamo il metodo dei minimi quadrati: la

retta migliore sarà quella che minimizza la somma degli

scarti (residui) tra i valori osservati (yi) e i valori teorici

trovati sulla retta (yi*)

∑ (yi - yi*)2 = min

∑ (yi – a – βxi)2 = min

Retta di regressione lineare semplice

Attraverso il calcolo dei minimi quadrati ottengo le seguenti

soluzioni

a = μy – βμx

Β = σ(x,y) / σ2(x)

Codevianza (x,y) = σ(x,y) = ∑ (xi – μx)*(yi – μy)

devianza (x) = σ2(x) = ∑ (xi – μx)2

devianza (y) = σ2 (y) = ∑ (yi – μy)2

Retta di regressione lineare semplice

Y = a + βx + ε

I punti non sono quasi mai allineati perfettamente sulla retta

per cui l’equazione che ci da il vero valore di y è

Y = a + βx + ε (dove ε sono i residui o errori)

Significati dei coefficienti:

β - Il coefficiente angolare β misura la pendenza della retta

ed è positivo quando la retta cresce ed è negativo quando

la retta decresce

β - Misura inoltre di quanto varia in media y al variare di una

unità di x

a - a misura il valore di y quando x = 0

Retta di regressione lineare semplice

devianza (y) = σ(y) = ∑ (yi – μy)2

Si dimostra che la devianza di y può essere scomposta in due

parti

σ(y) = ∑ (yi* – μy)2 + ∑ (yi – yi*)2

Dove ∑ (yi* – μy)2 rappresenta la parte di devianza totale

spiegata dalla regressione e si chiama devianza di

regressione Dev(R)

e ∑ (yi – yi*)2 rappresenta la parte di devianza non spiegata

dalla regressione denominata devianza dei residui Dev(E)

ed è la quantità da minimizzare con il metodo dei minimi

quadrati

Dev(y) = Dev(R) + Dev(E)

Retta di regressione lineare semplice

Posso calcolare l’indice di determinazione che è

R2 = Dev(R) / Dev(y)

È un indice normalizzato che varia tra 0 e 1

Quando la Dev(R) è nulla R2 è nullo e la variabilità di y non è

spiegata dalla retta di regressione

Quando Dev(R) = Dev(y), R2 è uguale a 1 e la variabilità è

spiegata intermente dalla retta di regressione

Regressione logistica

La regressione logistica binomiale è un caso particolare di

modello lineare generalizzato. Si tratta di un modello di

regressione applicato nei casi in cui la variabile dipendente

y sia di tipo dicotomico riconducibile ai valori 0.

Il modello di regressione logistica modella la relazione tra

l’esito dicotomico da esaminare (la propensione alla

vacanza, il rischio di contrarre una malattia, ecc.) e un set di

variabili che possono essere sia dicotomiche (ad. esempio

presenza di figli con 10 anni o meno: si/no, essere

sottoposto a cura antibiotica: si/no) che categoriche (ad

esempio: ripartizione geografica: Nord-Ovest; Nord-Est,

Centro, Sud, Isole).

Regressione logistica

L’equazione logistica produce la stima dei valori medi della

variabile dicotomica dipendente (y) in corrispondenza dei

valori assunti dalle variabili indipendenti (xi)

Essendo la y una variabile dicotomica la sua media è uguale

alla proporzione di casi che assumono il valore 1.

Si parla generalmente della probabilità di (propensione di) y

ad assumere il valore 1 in combinazione dei valori delle

variabili indipendenti xi

Quando trattiamo dei valori che esprimono probabilità (di un

evento) non possiamo concepire delle relazioni lineari con

le altre variabili

Regressione logistica

Facciamo un trasformazione matematica sulle variabili linearizzando

una equazione non lineare. La probabilità da stimare si trasforma in

una funzione detta logit (o logistica)

Logit (P)= ln (P/1-P) = a + b1x1 + b2x2 + bixi + bnxn

dove P = probabilità dell’evento

Ln = logaritmo naturale

Solitamente anche le variabili indipendenti sono dicotomiche o

categoriale con una modalità che viene presa come modalità di

riferimento. I coefficienti vanno interpretati come il cambiamento

nella probabilità della variabile dipendente esercitato dal passaggio

dalla modalità di riferimento ad una altra modalità per la variabile

indipendente in esame, quando le altre variabili rimangono costanti

Regressione logistica

I coefficienti vanno interpretati come il cambiamento nella

probabilità della variabile dipendente esercitato dal passaggio

dalla modalità di riferimento ad una altra modalità per la

variabile indipendente in esame, quando le altre variabili

rimangono costanti

Questo perché rappresentano il logaritmo degli odds-ratio, ossia

dei rapporti

Solitamente i software traducono i logaritmi negli odd-ratio per

cui è più semplice poi interpretarli

Odds e odds-ratio

Gli odds sono dei rapporti di probabilità che assumono valore 1

quando le due categorie a confronto hanno la stessa

frequenza e variano tra 0 e infinito

Vengono calcolati sulla tabella di contingenza

Gli odds-ratio è il confronti tra due odds condizionati ed è a

tutti gli effetti una misura di associazione

Varia tra 0 e infinito

Assume 1 quando c’è la massima indipendenza

Valori > 1 indicano una concordanza (associazione diretta)

Valori < 1 indicano una associazione di discordanza